Lenovo ThinkSystem SR650 ist ein 2U-Rack-Server mit 2 Sockets, der für eine Vielzahl kleiner, mittlerer und großer Unternehmen geeignet ist, z. B.: DBMS, Virtualisierung und Cloud, virtuelle Desktop-Infrastruktur (VDI), verschiedene Unternehmensanwendungen und Business Intelligence. und Big Data.

Geschwindigkeit, Zuverlässigkeit, Sicherheit und einfache Verwaltung

Der SR650 verfügt über viele Funktionen zur Steigerung Ihrer Produktivität. Dies wird hauptsächlich durch die Verwendung der Intel Xeon Scalable-Prozessorfamilie der zweiten Generation mit bis zu 28 Kernen pro Prozessor erreicht. Insgesamt unterstützt der Server zwei Prozessoren und dementsprechend bis zu 56 Kerne.

Der Server verfügt über 24 RAM-Steckplätze und eine maximale Kapazität pro Server von bis zu 3 TB bei einer Speicherfrequenz von bis zu 2933 MHz.

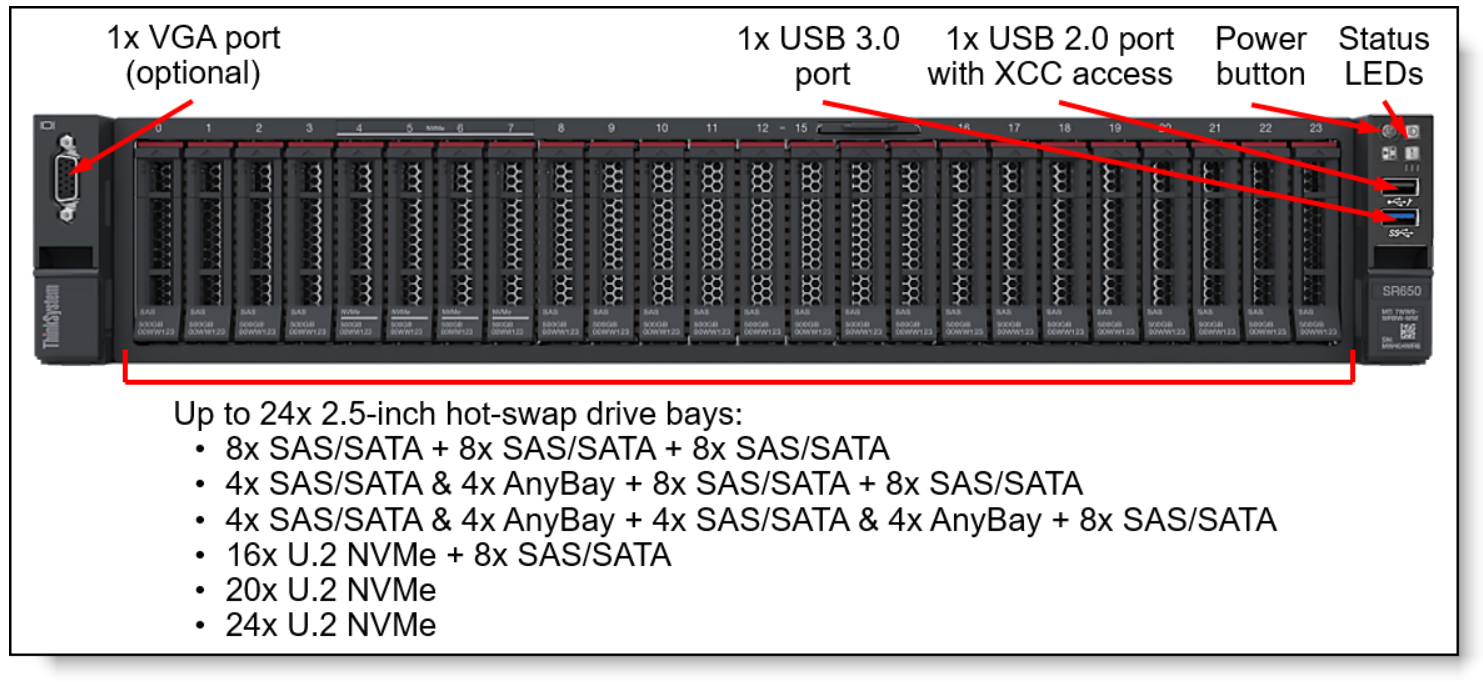

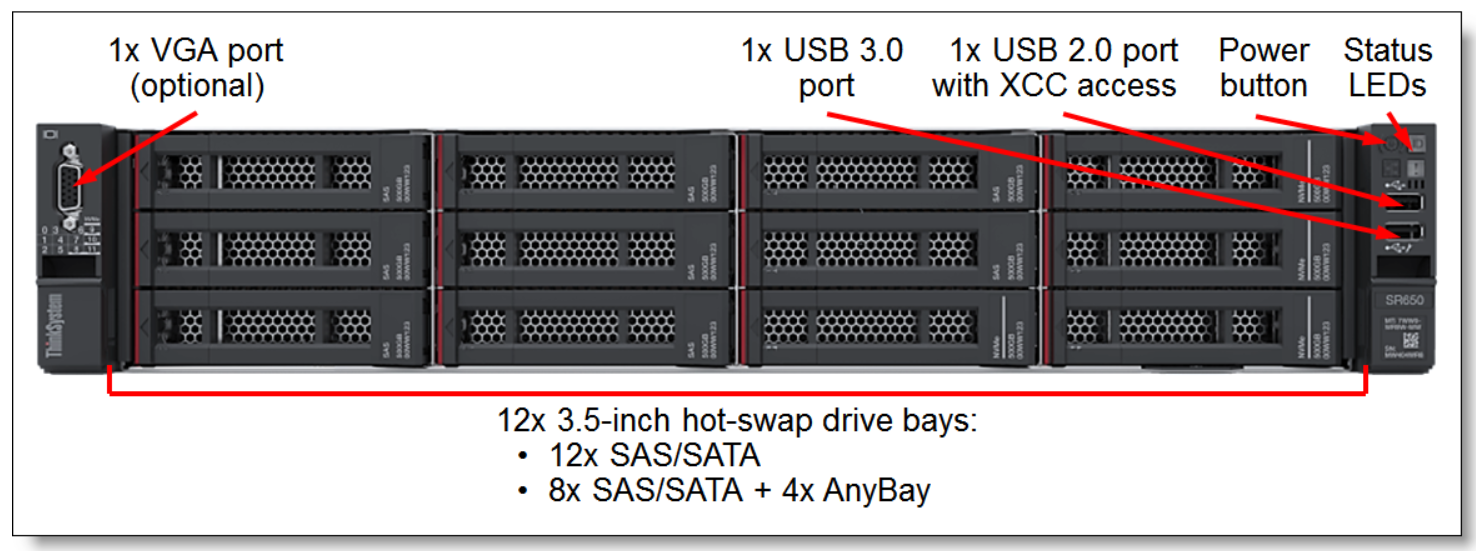

Das SR650 Disk Subsystem bietet flexiblen und skalierbaren internen Speicher in einem Formfaktor mit 24 2,5-Zoll- und 2 3,5-Zoll-Laufwerken für leistungsoptimierte Konfigurationen oder bis zu 14 3,5-Zoll-Laufwerken für kapazitätsoptimierte Konfigurationen Wahlweise SAS / SATA HDD / SSD und PCIe NVMe SSD. Ein wichtiges Plus ist, dass SAS-, SATA- oder NVMe-PCIe-Laufwerke in denselben AnyBay-Laufwerksschächten verwendet werden können.

In Bezug auf Stromversorgung und Kühlverfügbarkeit verfügt der SR650 über redundante Hot-Swap-fähige Netzteile und Hot-Swap-fähige Lüfter an Bord.

Auf der Rückseite des Servers können bis zu fünf PCI-e installiert werden, von denen zwei für Grafikadapter zum Organisieren von Grafik-VDI verwendet werden können.

Zusätzlich wird eine LOM-Karte bereitgestellt, die 4 weitere 1- oder 10-Gbit-Ethernet-Ports bereitstellen kann.

Außerdem ist der SR650-Server in Bezug auf Änderungen und Wartung äußerst praktisch. Die Serverabdeckung kann ohne Verwendung eines Schraubendrehers entfernt werden, was dem Administrator erheblich Zeit spart.

Leistungsstarke Verwaltungsfunktionen, die auf der XClarity-Verwaltungssoftware basieren, vereinfachen die lokale und Remoteverwaltung des SR650.

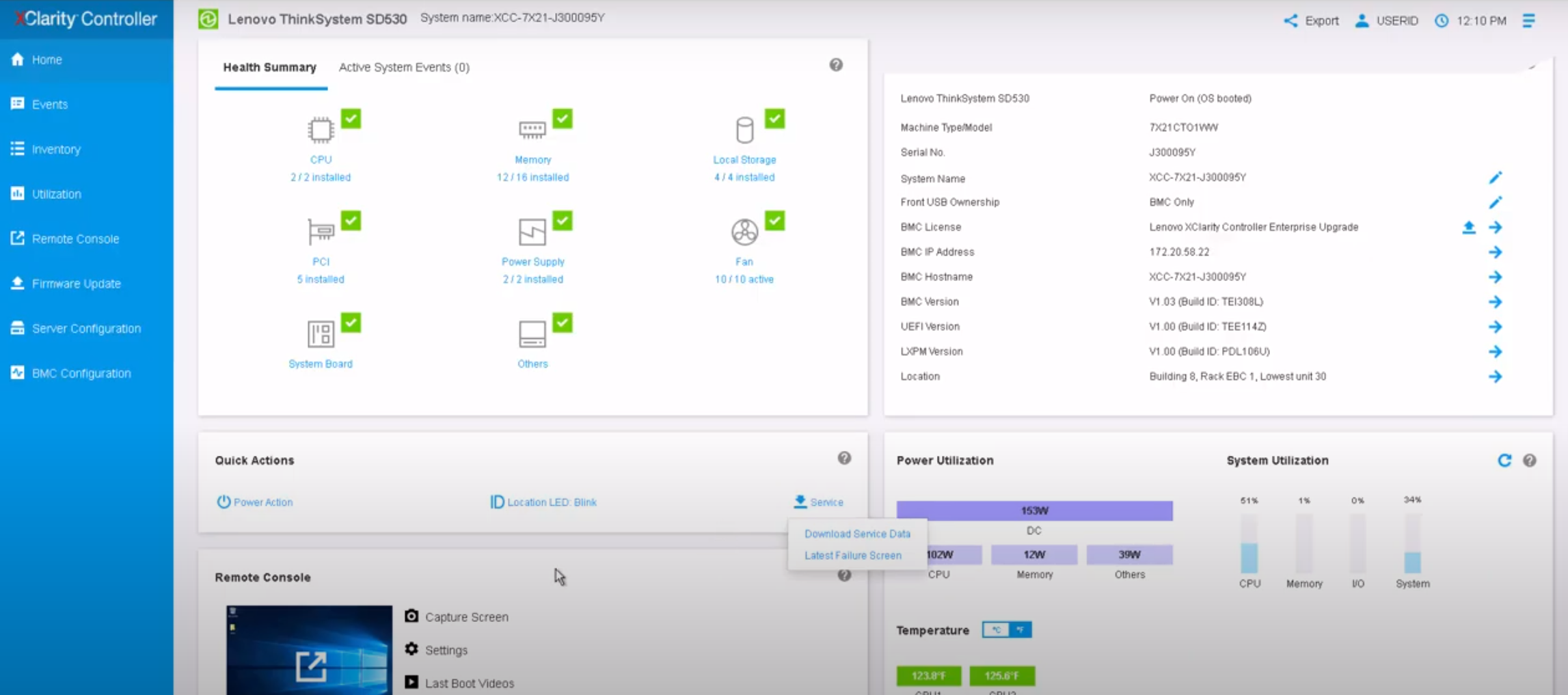

Der XClarity Controller bietet erweiterte Verwaltungs-, Überwachungs- und Warnfunktionen.

Mit XClarity Controller können Sie Systemparameter kontinuierlich überwachen und automatisch Warnungen auslösen, um im Fehlerfall Wiederherstellungsaktionen durchzuführen.

Der integrierte XClarity Provisioning Manager vereinfacht die Einrichtung, Konfiguration und Aktualisierung des Systems.

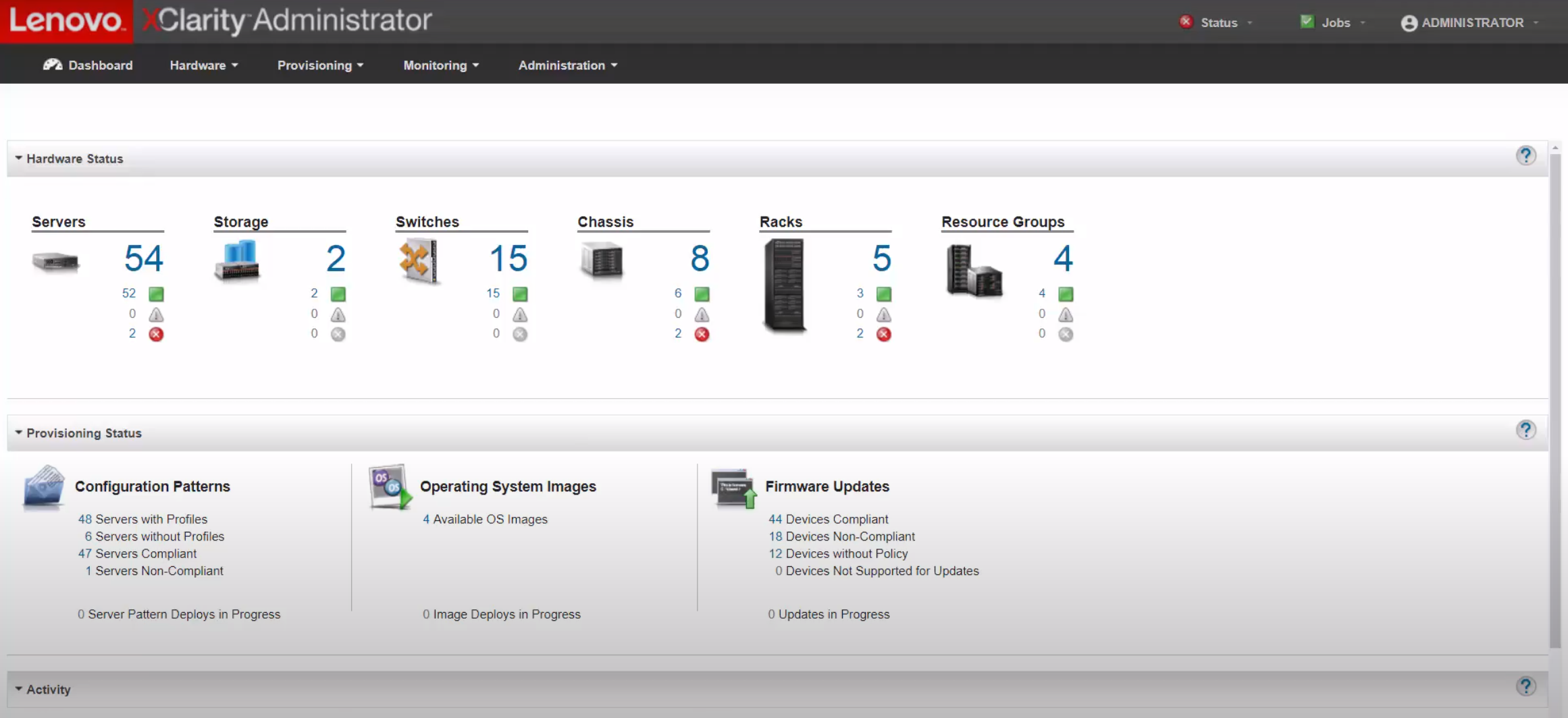

Für die Verwaltung einer großen Serverflotte wird Lenovo XClarity Administrator unterstützt, der eine umfassende zentrale Verwaltung von überall aus ermöglicht - nicht nur von einem Computer aus, sondern auch mithilfe der mobilen Lenovo XClarity-Anwendung.

Für die Integration mit anderen gängigen Verwaltungssystemen stehen Lenovo XClarity Integrators zur Verfügung, die VMware vCenter und Microsoft System Center unterstützen, die XClarity Administrator-Funktionalität auf Tools für die Virtualisierungsverwaltungssoftware erweitern und es dem Administrator ermöglichen, die Infrastruktur von Anfang bis Ende bereitzustellen und zu verwalten.

Kampfcheck. Testergebnisse laden

Im März 2019 führte TPC Benchmark-E (TPC-E) Stresstests des SR650-Servers als Server für das Hochlast-MS SQL Server-DBMS durch.

Informationen zum TPC-E

TPC-Benchmark E (TPC-E) ist eine OLTP-Workload (Online Transaction Processing). Es ist eine gemischte Ladung von lesungs- und aktualisierungsintensiven Transaktionen, die komplexe OLTP-Anwendungsumgebungen imitieren. Das Datenbankschema, Datenpopulationen, Transaktionen und Testimplementierungsregeln wurden entwickelt, um einen umfassenden Überblick über die Workloads in modernen OLTP-Systemen zu bieten. Der Benchmark untersucht eine breite Palette von Systemkomponenten, die mit solchen Umgebungen verbunden sind und die gekennzeichnet sind durch:

- Gleichzeitige Ausführung mehrerer Arten von Transaktionen unterschiedlicher Komplexität;

- - ;

- ;

- ;

- , , .

Für den realen Test simuliert der TPC-E-Test die OLTP-Arbeitslast eines Maklerunternehmens. Der Benchmark konzentriert sich auf eine zentrale Datenbank, die Transaktionen im Zusammenhang mit den Kundenkonten des Unternehmens ausführt. Um die Leistungsmerkmale eines Datenbanksystems zu messen, versucht der Benchmark nicht, den komplexen Datenfluss zwischen mehreren Anwendungssystemen zu messen, die in einer realen Umgebung vorhanden sein könnten.

Die verschiedenen Arten von Transaktionen simulieren die Interaktion eines Unternehmens mit seinen Kunden und Geschäftspartnern. Unterschiedliche Arten von Transaktionen haben unterschiedliche Anforderungen an die Ausführungszeit.

Der Test bestimmt:

- Zwei Arten von Transaktionen zur Simulation von Customer-to-Business- und Business-to-Business-Transaktionen (dh Interaktion zwischen Geschäftspartnern);

- Mehrere Transaktionen für jede Art von Transaktion;

- Unterschiedliche Ausführungsprofile für jede Art von Transaktion;

- Eine bestimmte Kombination von Ausführungszeiten für alle definierten Transaktionen.

Beispielsweise führt eine Datenbank gleichzeitig Transaktionen aus, die von Systemen generiert werden, die mit Kunden interagieren, sowie Transaktionen, die von Systemen generiert werden, die mit Finanzmärkten interagieren, sowie von Verwaltungssystemen. Das Benchmarking-System interagiert mit einer Reihe von Anwendungen, die verschiedene Transaktionsquellen simulieren.

Die TPC-E-Leistungsmetrik ist ein Maß für den „Geschäftsdurchsatz“, der die Anzahl der abgeschlossenen Transaktionen mit den Ergebnissen der pro Sekunde verarbeiteten Geschäftsaktivitäten (Handelsaktivitäten) sowie die Kosten einer Transaktion in US-Dollar widerspiegelt. Mehrere Transaktionen werden verwendet, um die Geschäftsaktivität der Transaktionsverarbeitung zu simulieren, und jede Transaktion erfordert eine Antwort. Die Benchmark-Leistungsmetrik wird in Transaktionen pro Sekunde-E (tpsE) ausgedrückt.

Prüfstandszusammensetzung

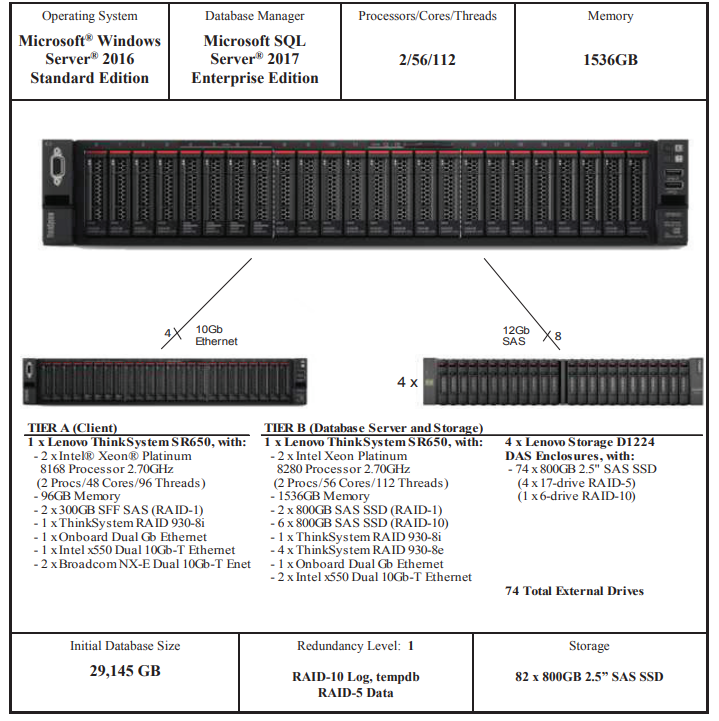

Server - Client DBMS: Lenovo ThinkSystem SR650:

- 2xXeon Platinum 8168 2,7 GHz (2 CPUs / 48 Kerne / 96 Threads)

- 96 GB RAM

- 2x300GB SAS HDD RAID-1

DBMS-Server: Lenovo ThinkSystem SR650:

- 2xXeon Platinum 8260 2,7 GHz (2 CPUs / 56 Kerne / 112 Threads)

- 1536 GB RAM

- 2x800GB SAS SSD RAID-1

- 6x800GB SAS SSD RAID-10

- 4xLenovo Storage D1224 (12 Gbs SAS-Festplattenregale, 74x800 GB SAS-SSD, konfiguriert in zwei RAID-Gruppen: 4x17 RAID-5, 1x6 RAID-10)

Die Server sind über 4 10-GbE-Verbindungen miteinander verbunden.

Eine detailliertere Standkonfiguration finden Sie unten.

Detaillierte Daten zur Hardwarekonfiguration, Software sowie zur Testmethode können direkt im öffentlich zugänglichen TPC-E-Bericht eingesehen werden: tpc.org/4084

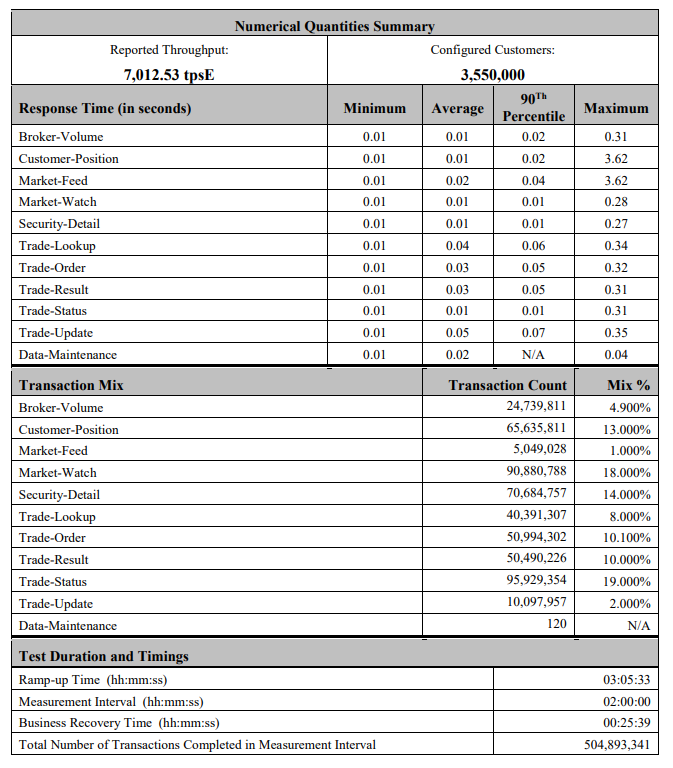

Testergebnisse Die

Testergebnisse bestehen aus drei Gruppen von Tests:

- Normale Operation

- Datenverfügbarkeit

- Notfallwiederherstellung

Normalmodus Das

Testen im Normalmodus besteht aus zwei Schritten. In der ersten Phase wird das System "aufgewärmt", um es in einen stabilen Arbeitszustand zu versetzen, dessen Messung wiederum das Ziel eines regelmäßigen Tests ist.

Bei stationären Benchmark-Ergebnissen behält der SR650 eine Rate von etwas mehr als 7000 Transaktionen pro Sekunde bei.

Die Ergebnisse der Routinetests sind in der folgenden Grafik dargestellt.

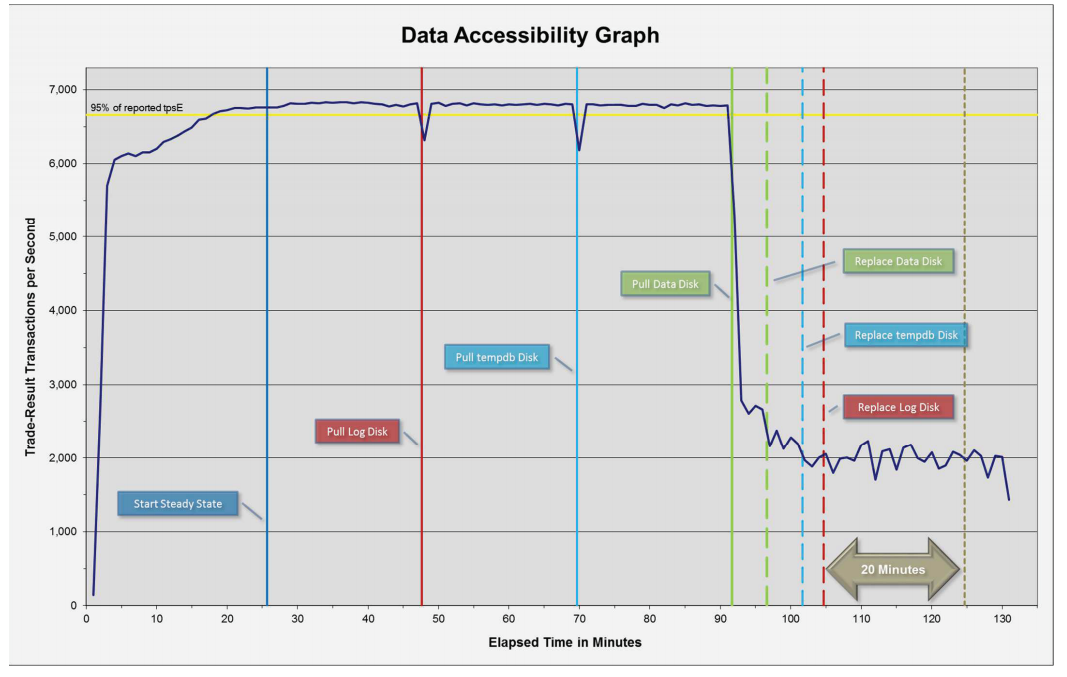

Datenverfügbarkeit Um die

Datenverfügbarkeit zu messen, müssen verschiedene Vorgänge ausgeführt werden, die Ausfälle des Festplattensubsystems simulieren.

Die Datenverfügbarkeit wird durch die Tatsache demonstriert, dass eine Anwendung Datenbankoperationen mit vollem Zugriff auf die Daten nach dauerhaften, nicht behebbaren Fehlern einer einzelnen Festplatte mit Datenbanktabellen, Wiederherstellungsprotokolldaten oder Datenbankmetadaten unterstützen kann.

Datenverfügbarkeitstests werden durchgeführt, indem Festplatten deaktiviert werden, auf denen verschiedene Datentypen gespeichert sind, während der Anwendungszugriff auf die Daten überwacht wird.

Nachfolgend sind die Arten von Festplatten-Arrays aufgeführt, in denen verschiedene Datentypen gespeichert sind.

Während des Datenverfügbarkeitstests wurden die folgenden Schritte ausgeführt:

- Ein Festplattenfehler im Datenbankprotokollarray (Festplatte physisch vom Server entfernt) wurde verursacht.

- 5 , tempdb.

- 5 , .

Da alle Arrays durch unterschiedliche RAID-Level geschützt sind, wurde der Datenzugriff nicht unterbrochen, und abgesehen von einem kurzfristigen Leistungsabfall gab es keine Auswirkungen.

Einige Minuten später wurden drei neue Festplatten nacheinander installiert, um die "ausgefallenen" zu ersetzen, und der Prozess der Wiederherstellung des Datenarrays begann. Der Wiederherstellungsprozess hat die Leistung drastisch reduziert. Dies ist ein normales Verhalten, da einige der E / A-Ressourcen für die Neuerstellung und nicht für DBMS-Vorgänge aufgewendet werden, bis alle Datasets vollständig wiederhergestellt sind.

Unten finden Sie eine Grafik zum Testen der Datenverfügbarkeit.

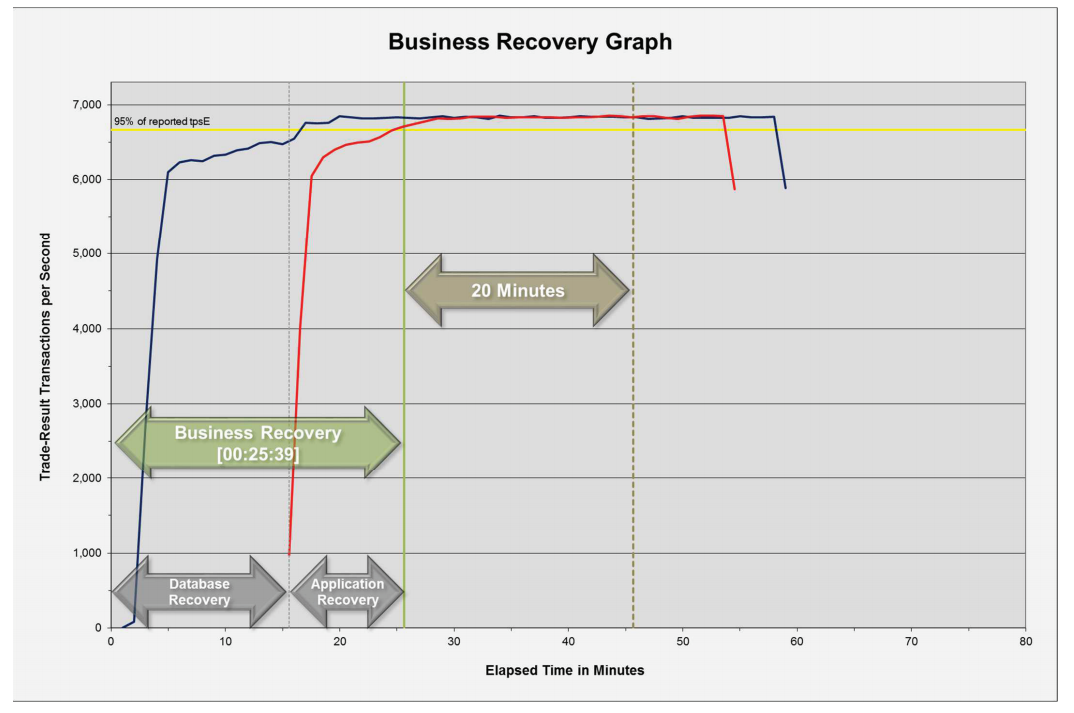

Notfallwiederherstellung

Der letzte Disaster Recovery-Test ist der Prozess der Wiederherstellung des gesamten Systems nach einer schwerwiegenden Katastrophe, bei der der DBMS-Server vollständig deaktiviert wurde. Die Notfallwiederherstellung wird als erfolgreich angesehen, wenn die Arbeitslast wieder normal ~ 7000 tpsE ist.

Die folgenden Schritte wurden ausgeführt, um die Notfallwiederherstellung zu testen:

- Alle Netzkabel wurden vom DBMS-Server entfernt, wodurch dieser sofort heruntergefahren wurde. Alle Inhalte des Hauptspeichers und der Server-Caches sind verloren gegangen. Alle RAID-Festplattencontroller im Server wurden ohne Batterien ausgeführt, sodass auch der gesamte Cache-Inhalt des Festplattencontrollers verloren ging.

- Stromkabel werden angeschlossen und der DBMS-Server wird eingeschaltet.

- Alle Daten- und Protokolldateien für tempdb wurden entfernt.

- SQL Server. . SQL Server , tpce , .

- SQL Server « » . 15 .

Da zwischen dem Ende der Datenbankwiederherstellung und dem Beginn der Wiederherstellung aller Anwendungen ein Zeitintervall lag und eine Reihe von Transaktionen neu gestartet (und nicht nur fortgesetzt) werden mussten, wurden diese Transaktionen erst nach der Wiederherstellung der Datenbank ausgeführt (siehe rote Linie in der Grafik), was mehr Zeit in Anspruch nahm etwa 10 Minuten.

Somit ist das Ende der Notfallwiederherstellung die vollständige Wiederherstellung der Arbeitslast aller Anwendungen, d. H. Der Zeitpunkt in der Grafik, an dem die blauen und roten Linien den Nennwert von ~ 7000 tpsE erreichen.

Gesamt:

- Die Zeit zum Wiederherstellen der Datenbank ist 00:15:33.

- Die Wiederherstellungszeit der Anwendung beträgt 00:10:06.

- Die vollständige Notfallwiederherstellungszeit beträgt 00:25:39.

- Die nach Transaktionsarten aufgeschlüsselte Zusammenfassung des Berichts ist nachstehend aufgeführt:

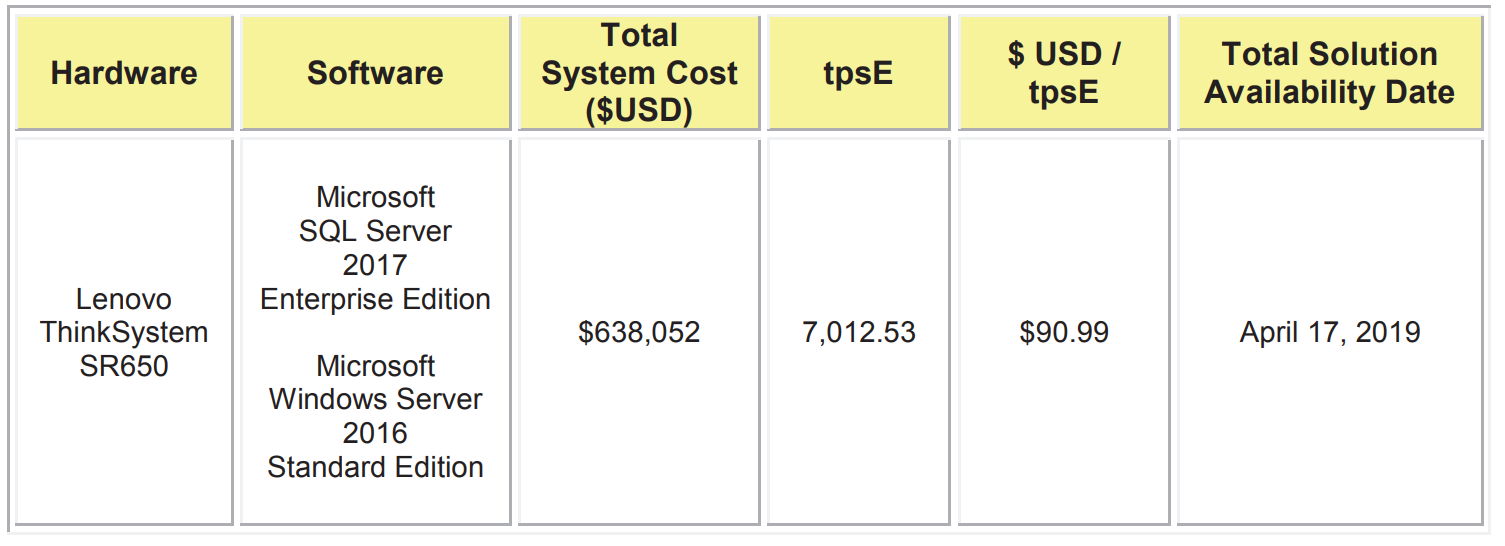

Die endgültige Schlussfolgerung mit dem erzielten tpsE und den Kosten einer Transaktion ist nachstehend aufgeführt:

Ein Indikator von 7012,53 tpsE mit Transaktionskosten von 90,99 USD belegte den zweiten Platz in der Bewertung der TPC-E-Top-Leistungsergebnisse, wobei der Top-Server Lenovo ThinkSystem SR860 V2 an erster Stelle steht ( tpc.org/tpce/results/tpce_perf_results5.asp?resulttype=all ) sowie den dritten Platz in der TPC-E-Bewertung für Top-Preis- / Leistungsergebnisse, wobei SR860 ebenfalls an erster Stelle steht und die Lösung eines Mitbewerbers an zweiter Stelle steht .

Dies ist ein sehr anständiger Indikator. Als Ergebnis verfügen wir über einen leistungsstarken, flexiblen, verwaltbaren und zuverlässigen Server, der wie andere Lenovo Produkte auch einen moderat wettbewerbsfähigen Preis aufweist. Diese Kombination von Eigenschaften hat das Lenovo ThinkSystem SR650 zum meistverkauften Lenovo Server der Welt gemacht. Folgen Sie dem Link , um eine Anfrage für den Lenovo ThinkSystem SR650-Server zu hinterlassen .