... sowie Deep Learning basierend auf Cloud Computing und akustischer Modellierung

Um Organgewebe aus Zellen im Labor zu züchten, benötigen Forscher eine nicht-invasive Methode, um Zellen an einem Ort zu halten. Ein vielversprechender Ansatz ist die akustische Strukturierung, bei der akustische Energie verwendet wird, um Zellen in einer gewünschten Position zu positionieren und zu halten, während sie sich im Gewebe entwickeln. Durch Anlegen von Schallwellen an Mikrofluidikgeräte verwandelten die Forscher Zellen im Mikrometerbereich in einfache Muster wie gerade Linien und Gitter.

Meine Kollegen und ich haben einen kombinierten Ansatz für tiefes Lernen und numerische Modellierung entwickelt, der es uns ermöglicht, Zellen in viel komplexeren Schaltkreisen unserer eigenen Architektur anzuordnen. Wir haben wochenlangen Aufwand gespart, indem wir den gesamten Workflow in MATLAB ausgeführt und paralleles Computing verwendet haben, um wichtige Schritte wie das Generieren eines Trainingsdatensatzes aus unserem Simulator und das Trainieren eines Deep-Learning-Neuronalen Netzwerks zu beschleunigen.

Akustische Modellierung mit Mikrokanälen

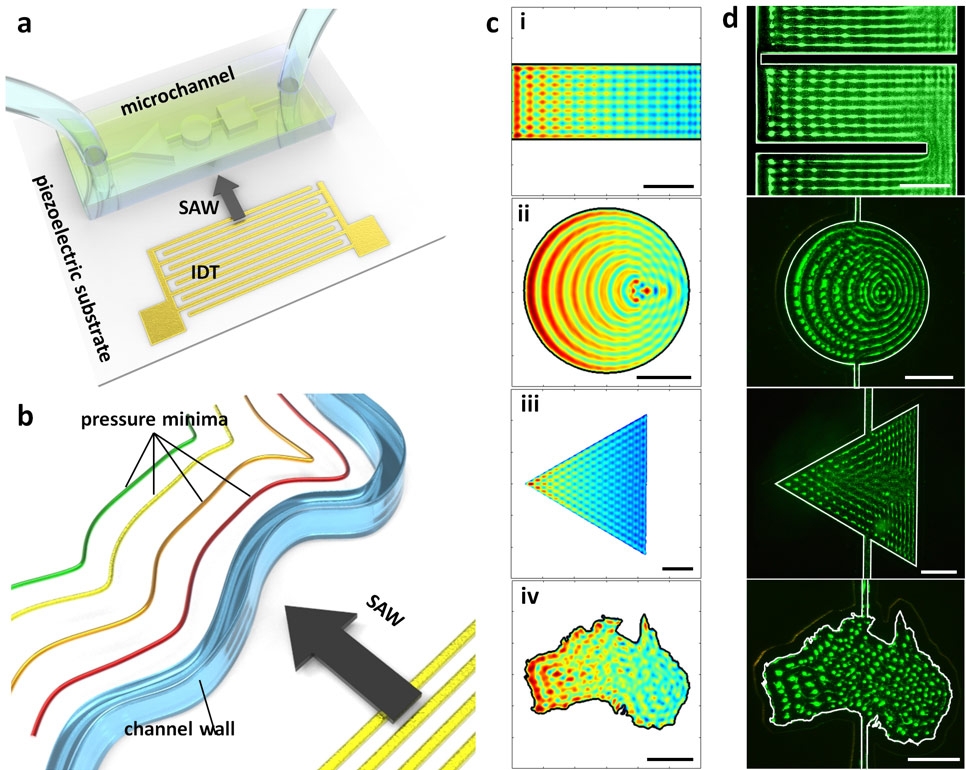

In einer Mikrofluidikvorrichtung werden Fluidpartikel und Fluidpartikel oder -zellen in Mikrokanälen mit einer Größe von weniger als einem Millimeter angetrieben, die in verschiedenen Formen gebildet werden können. Um akustische Muster innerhalb dieser Mikrokanäle zu erzeugen, erzeugt ein Interdigitalwandler (IDT) eine akustische Oberflächenwelle (SAW), die auf die Kanalwand gerichtet ist (Fig. 1a). In der Flüssigkeit im Kanal erzeugen Schallwellen einen minimalen und maximalen Druck, der dem Druck der Kanalwand entspricht (Abb. 1b). Daher kann die Form der Kanalwände so angepasst werden, dass bestimmte akustische Felder im Kanal entstehen [1] (Abb. 1c). Akustische Felder verteilen Partikel in der Flüssigkeit in Mustern, die den Stellen entsprechen, an denen die Kräfte dieser akustischen Wellen minimiert werden (Abbildung 1d).

Abbildung 1 - Akustische Strukturierung in Mikrokanälen

Während es möglich ist, das akustische Feld zu berechnen, das sich aus einer bestimmten Kanalform ergibt, ist das Gegenteil nicht möglich: Das Entwerfen der Kanalform zur Erzeugung des gewünschten Bereichs ist für nichts eine triviale Aufgabe, aber nicht für einfache Muster wie ein Gitter. Da der Lösungsraum praktisch unbegrenzt ist, sind analytische Ansätze nicht anwendbar.

Der neue Workflow verwendet eine große Sammlung simulierter Ergebnisse (randomisierte Formulare) und Deep Learning, um diese Einschränkung zu überwinden. Meine Kollegen und ich haben zum ersten Mal ein direktes Problem gelöst, indem wir Druckfelder aus bekannten Formen in MATLAB simuliert haben. Wir haben die Ergebnisse dann verwendet, um ein tiefes neuronales Netzwerk zu trainieren, um das inverse Problem zu lösen: die Form des Mikrokanals zu bestimmen, der zur Erzeugung des gewünschten akustischen Feldes benötigt wird.

Lösung des direkten Problems: Modellierung von Druckfeldern

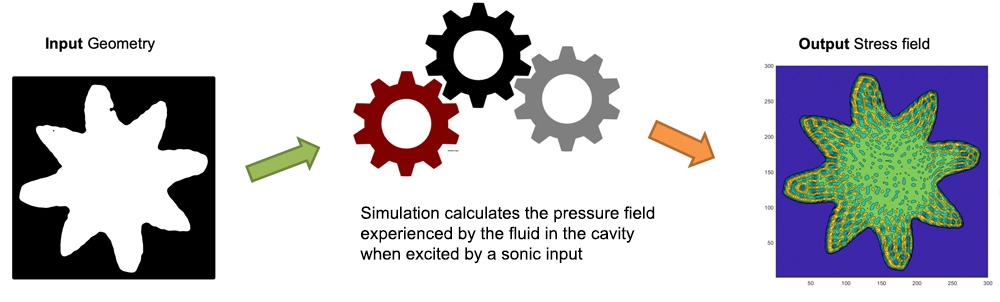

In früheren Arbeiten hat unser Team in MATLAB eine Simulationsmaschine entwickelt, die das Problem der Bestimmung des Druckbereichs für eine bestimmte Kanalgeometrie mithilfe des Huygens-Fresnel-Prinzips löst, bei dem davon ausgegangen wird, dass jeder Punkt auf einer ebenen Welle eine Punktquelle für sphärische Wellen ist (Abb. 2).

Abbildung 2 - Das für eine bestimmte Kanalgeometrie erzeugte Schalldruckfeld

Die Simulationsmaschine basiert auf verschiedenen Matrixoperationen. Da diese Operationen in MATLAB ausgeführt werden, dauert jede Simulation einen Bruchteil einer Sekunde, und wir mussten Zehntausende eindeutiger Formen und ihre entsprechenden 2D-Druckbereiche simulieren. Wir haben diesen Prozess beschleunigt, indem wir mithilfe der Parallel Computing Toolbox parallel Simulationen auf einer Multi-Core-Workstation ausgeführt haben.

Sobald wir die Daten hatten, die wir brauchten, wurde es verwendet, um das Deep-Learning-Netzwerk zu trainieren, um die Form des Kanals aus einem bestimmten Druckbereich abzuleiten, wobei die Reihenfolge von Eingabe und Ausgabe im Wesentlichen umgekehrt wurde.

Trainieren Sie das neuronale Netzwerk des tiefen Lernens, um das inverse Problem zu lösen

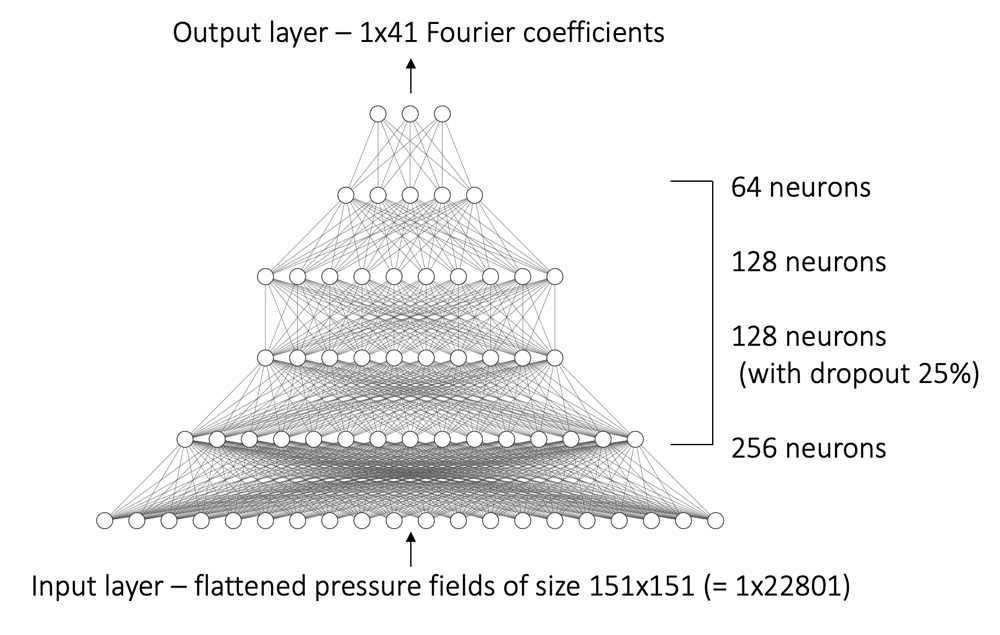

Um den Trainingsprozess zu beschleunigen, wurde zunächst ein Schwellenwert für den simulierten Druckbereich bestimmt. Als Ergebnis wurden zweidimensionale boolesche Matrizen 151 x 151 erstellt, die wir in einen eindimensionalen Vektor transformierten ("abgeflacht"), was wiederum eine Eingabe in das Deep-Learning-Netzwerk werden würde. Um die Anzahl der Ausgangsneuronen zu minimieren, haben wir die Darstellung des Fourier-Koeffizienten verwendet, der die Kontur der Kanalform erfasst (Abb. 3).

Abbildung 3 - Approximation der Fourier-Reihe eines um 20 Grad gedrehten gleichseitigen Dreiecks mit Koeffizienten (von links nach rechts) 20, 3, 10 und 20

Wir haben das ursprüngliche Netzwerk mit der Anwendung Deep Network Designer erstellt und programmgesteuert verbessert, um Genauigkeit, Vielseitigkeit und Lerngeschwindigkeit auszugleichen ( Abb. 4). Wir haben das Netzwerk mit einem adaptiven Drehmomentschätzungslöser (ADAM-Optimierer) auf einer NVIDIA Titan RTX-GPU trainiert.

Abbildung 4 - Vollständig verbundenes neuronales Netzwerk mit vier verborgenen Schichten

Ergebnisse überprüfen

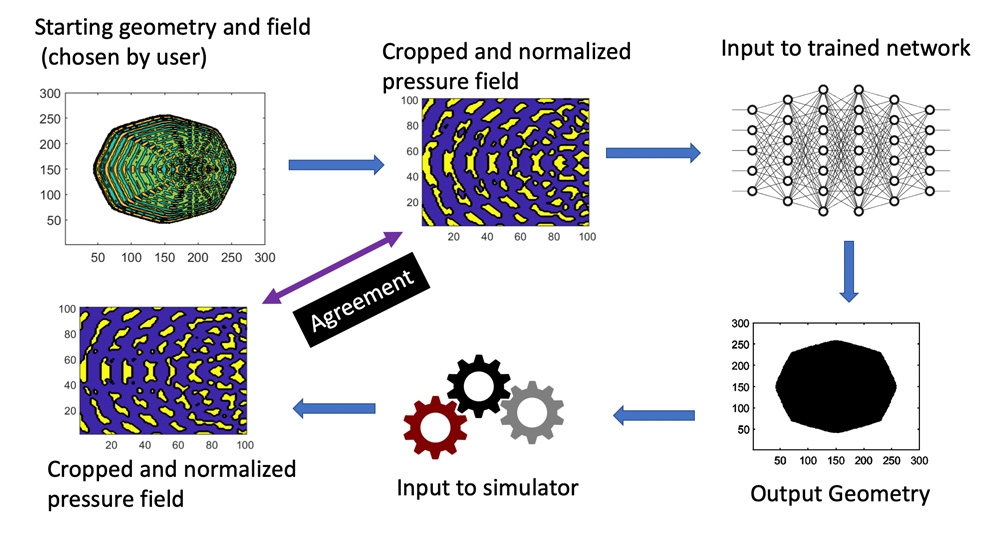

Um das trainierte Netzwerk zu validieren, haben wir es verwendet, um die Kanalgeometrie aus einem bestimmten Druckfeld abzuleiten, und diese Geometrie dann als Eingabe für die Simulationsmaschine verwendet, um das Druckfeld zu rekonstruieren. Wir haben dann das Original verglichen und Druckfelder erstellt. Der minimale und maximale Druck in den beiden Feldern liegen nahe beieinander (Abb. 5).

Abbildung 5 - Workflow zur Überprüfung des Deep Learning-Netzwerks

Dann haben wir eine Reihe von echten Tests durchgeführt. Um die Bereiche anzugeben, in denen wir die Partikel sammeln wollten, haben wir spezielle Bilder mit Microsoft Paint gemalt. Sie enthielten viele verschiedene ein- und mehrzeilige Bilder, die ohne unsere Methode nur schwer zu erhalten gewesen wären. Das trainierte Netzwerk wurde dann verwendet, um die Geometrie der Kanäle zu definieren, die zum Erstellen dieser definierten Bereiche benötigt werden. Schließlich haben wir mit Hilfe unserer Partner eine Reihe von Mikrofluidikgeräten hergestellt, die auf der beabsichtigten Geometrie basieren. Jede dieser Vorrichtungen wurde dann mit 1 & mgr; m Polystyrolpartikeln, die in der Flüssigkeit suspendiert waren, in die gebildeten Kanäle injiziert, und ein Tensid wurde auf der Vorrichtung induziert. Die Ergebnisse zeigten eine Partikelaggregation entlang der Regionen, die in unseren Spezialbildern angegeben wurden (Abb. 6).

Abbildung 6 - Unten: In Microsoft Paint (lila) gezeichnete Bereiche werden dem simulierten akustischen Feld überlagert, das für die Partikelaggregation in diesen Bereichen erforderlich ist. oben: Das Ergebnis ist eine Probe suspendierter Polystyrolpartikel in einer hergestellten Mikrofluidikvorrichtung

In die Wolke gehen

In Erwartung der nächsten Phase dieses Projekts aktualisieren wir unser Deep-Learning-Netzwerk, um akustische Feldbilder als Eingaben zu verwenden und Kanalformbilder als Ausgaben zu generieren, anstatt gequetschte Vektor- bzw. Fourier-Koeffizienten zu verwenden. Die Hoffnung ist, dass diese Änderung es uns ermöglicht, Kanalformen zu verwenden, die mit der Fourier-Reihe nicht einfach zu bestimmen sind und die sich im Laufe der Zeit ändern können. Für die Schulung sind jedoch ein viel größerer Datensatz, eine komplexere Netzwerkarchitektur und erheblich mehr Rechenressourcen erforderlich. Infolgedessen übertragen wir das Netzwerk und seine Trainingsdaten in die Cloud.

Glücklicherweise bietet das MathWorks Cloud Center eine praktische Plattform für das schnelle Hochfahren und Verlassen von HPC-Cloud-Instanzen. Einer der langwierigeren Aspekte der wissenschaftlichen Forschung in der Cloud ist die Interoperabilität, bei der unsere Algorithmen und Daten zwischen der Cloud und unserer lokalen Maschine verschoben werden. MATLAB Parallel Server abstrahiert die komplexeren Aspekte des Cloud Computing und ermöglicht es uns, mit wenigen einfachen Menüklicks lokal oder in der Cloud zu arbeiten. Diese Benutzerfreundlichkeit ermöglicht es uns, uns auf das wissenschaftliche Problem zu konzentrieren und nicht auf die Werkzeuge, die zur Lösung des Problems erforderlich sind.

Mit MATLAB mit NVIDIA GPU-gestützten Amazon Web Services-Instanzen planen wir, das aktualisierte Netzwerk auf Daten zu trainieren, die in Amazon S3-Buckets gespeichert sind. Wir können dann das trainierte Netzwerk auf lokalen Workstations verwenden, um Schlussfolgerungen zu ziehen (für die kein Hochleistungsrechnen erforderlich ist) und mit verschiedenen Mustern und akustischen Feldern zu experimentieren. Diese Arbeit liefert uns die Rohdaten für andere Projekte des maschinellen Lernens unter Verwendung von Physik.

Wenn Sie mehr über maschinelles und tiefes Lernen erfahren möchten, lesen Sie unseren entsprechenden Kurs. Es wird nicht einfach, aber aufregend. Und der HABR- Promo-Code hilft Ihnen bei Ihrem Bestreben, neue Dinge zu lernen, indem er 10% zum Rabatt auf das Banner hinzufügt.

- Kurs für maschinelles Lernen

- Fortgeschrittenenkurs "Maschinelles Lernen Pro + Deep Learning"

- Data Science

- Data Analyst