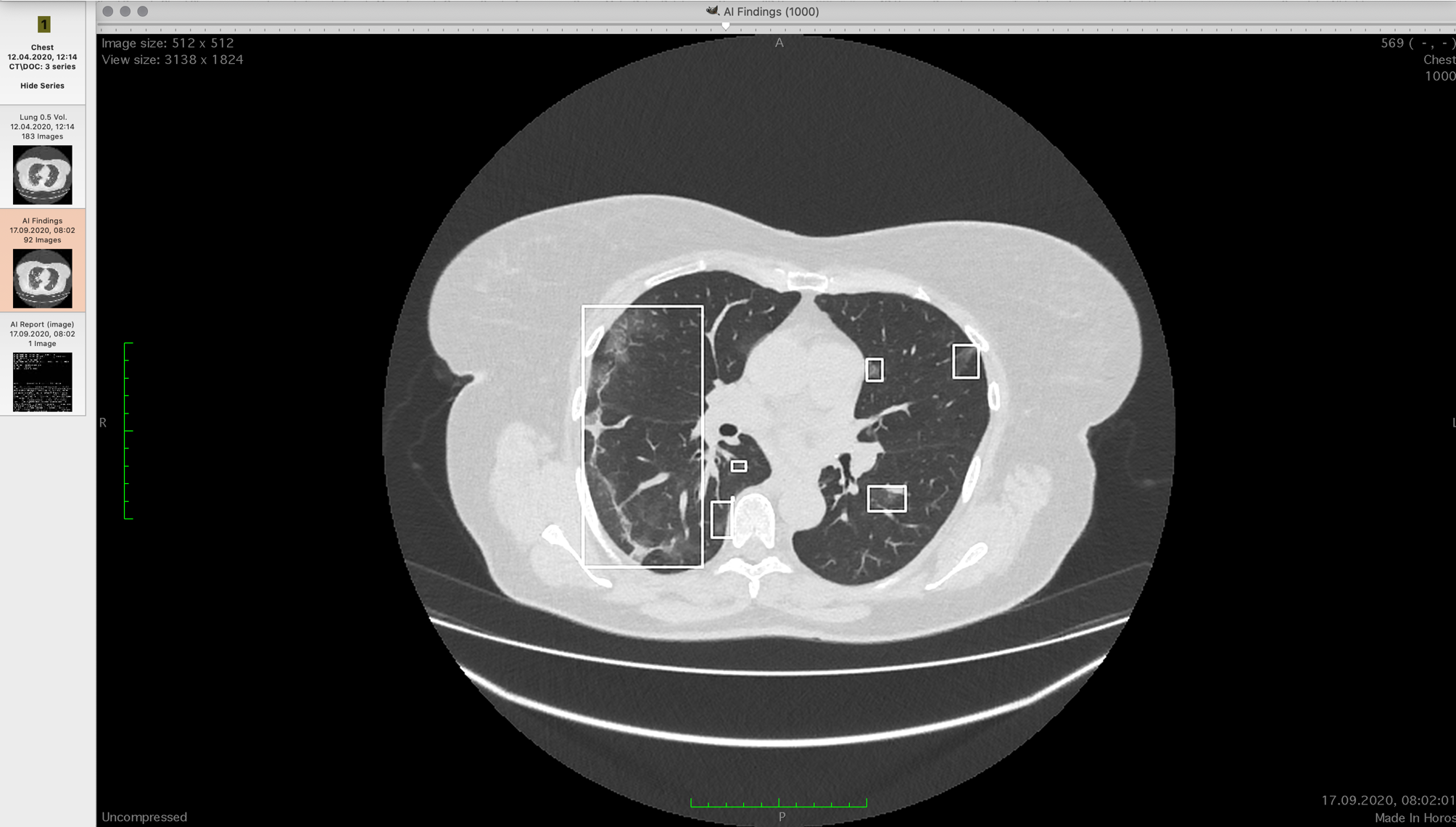

CT-Scan mit Milchglasflächen

Patienten mit bestätigtem COVID-19 werden einer Computertomographie der Lunge unterzogen. Wenn Sie Glück haben - einmal, wenn nicht - mehrmals. Zum ersten Mal müssen Sie die Schadenshöhe in Prozent schätzen. Das weitere Behandlungsschema wird in Abhängigkeit vom Quartil des Schadensgrades festgelegt und ist auffallend unterschiedlich. Im April 2020 haben wir erfahren, dass es zwei Schwierigkeiten gibt:

- CT ist ein dreidimensionales Bild, jede Schicht eines solchen Bildes wird als Schicht bezeichnet. Mit 300-800 Lungenschnitten im CT verbringen Ärzte 1 bis 15 Minuten damit, nach charakteristischen Bereichen zu suchen, um das Ausmaß der Läsion zu bestimmen. Eine Minute ist "per Auge", 30 Minuten sind der Durchschnitt für die manuelle Auswahl und Zählung von Bereichen mit geschädigtem Gewebe. In schwierigen Fällen kann das Ergebnis bis zu einer Stunde verarbeitet werden.

- Die Genauigkeit der Diagnose des Ausmaßes der Coronavirus-Infektion durch Experten "per Auge" ist an den Grenzen von 0 bis 30% und 70 bis 100% hoch. Im Bereich von 30 bis 70 ist der Fehler sehr hoch, und wir haben festgestellt, dass einige der Radiologen den Prozentsatz der Augenschädigung in der Regel systematisch überschätzen, während andere ihn unterschätzen.

Die Aufgabe beschränkt sich darauf, das geschädigte Gewebe der Lunge zu bestimmen und das Verhältnis ihres Volumens zur gesamten Lunge zu berechnen.

Ende April erstellten wir in Zusammenarbeit mit Kliniken einen Datensatz anonymisierter Studien mit Patienten mit bestätigter PCR-Analyse von COVID-19, gaben ein Komitee von zehn exzellenten Radiologen und entwarfen eine Probe für die Ausbildung mit einem Lehrer.

Ende Mai gab es Beta. Im Juli gab es ein fertiges Modell für verschiedene Arten von CT-Geräten in Russland. Wir sind ein Team im Labor für künstliche Intelligenz der Sberbank. Im Allgemeinen veröffentlichen wir unsere Entwicklungen in der wissenschaftlichen Literatur (MICCAI, AIME, BIOSIGNALS) und werden darüber auch auf AI Journey sprechen.

Warum ist es wichtig?

Radiologen haben bereits Ende April Warteschlangen erhalten. Es war wichtig:

- Erhöhen Sie den Punktedurchsatz mit CT-Untersuchungen.

- Erhöhen Sie zweitens die Genauigkeit der Forschung.

- Machen Sie es möglich, die Veränderung des Läsionsniveaus zwischen den Bildern eines Patienten genau zu sehen (und dies kann ein paar Prozent sein, es ist wichtig zu verstehen, ob es mehr oder weniger geworden ist).

In der ersten Welle verschlechterte sich die Situation weiter, da erfahrene Radiologen krank wurden und den Prozess verließen. Genauigkeit und Geschwindigkeit sanken.

Künstliche Intelligenz ist gut bei der Klassifizierung medizinischer Daten. Eine korrekte Priorisierung der Patienten rettet Leben, denn je genauer wir den Grad der Verletzung bestimmen, desto größer ist die Wahrscheinlichkeit, dass eine schwerkranke Person rechtzeitig die erforderlichen Medikamente und (wenn alles schlechter wird) die mechanische Beatmung erhält. Und dass eine Person, deren Lunge nicht so stark betroffen ist, seinen Platz im Krankenhaus nicht einnimmt.

Die Beurteilung des Schadensanteils ist eine der schwierigsten und ressourcenintensivsten Aufgaben für eine Person in der Diagnostik, da eine große Anzahl unregelmäßiger Herde bewertet werden muss, die in viele Abschnitte unterteilt sind.

Die Aufgabe selbst

Am Eingang - axiale Scheiben einer bestimmten Dicke. Normalerweise werden die Einstellungen von 0,5 mm bis 2,5 mm eingestellt. Der Brustkorb besteht aus 300 bis 800 2D-Bildern. Sie werden in ungefähre Entsprechung miteinander gebracht, das heißt, sie wurden bereits transformiert, so dass es möglich ist, Bilder auf einem durchscheinenden Film einer gegebenen Dicke unter bestimmten Bedingungen aufzubauen, und ein Modell der Brust würde erhalten. Aber natürlich ist schon lange alles in digitaler Form.

Betrachter können CT-Scans in Ebenen anzeigen oder ein 3D-Modell erstellen. Die Modelle sind für Ärzte nicht sehr informativ, da es schwierig ist, die Lokalisierung von Herden dieser Art von Läsion anhand dieser Modelle zu verstehen. Profis verwenden häufig eine multiplanare Rekonstruktion - sie zeigen drei orthogonale Projektionen - horizontal, frontal und sagittal. Anschließend scannen sie jede Achse entlang der Abschnitte und suchen nach den erforderlichen Elementen. Dies geschieht in der Praxis schnell. Sie müssen 500 dieser Bilder dreimal betrachten:

Verschiedene Ärzte erhalten unterschiedliche Ergebnisse in Bezug auf den Prozentsatz des Schadens nach einem solchen Blick.

Wir müssen das Volumen der Lunge in der Brust messen und dort alle Konsolidierungen finden und dann ihr Volumen schätzen. In der ersten Stichprobe haben wir 60.000 rekonstruierte CT-Schnitte genommen (das Gerät schießt in einer Achse, aber die erforderlichen Projektionen können mithilfe von Transformationen erhalten werden).

Unsere zehn Ärzte bewerteten nicht mit dem Auge, sondern wählten alle Konsolidierungen manuell aus und untersuchten jeden Abschnitt sorgfältig. Wir haben das Trainingsset leicht durch Augmentation bereichert - eine Kombination aus Dehnungen, Quetschungen, Rotationen und Verschiebungen am vorhandenen Set.

Der Algorithmus bestimmt das Vorhandensein einer Konsolidierung für jeden Punkt. Das verwendete neuronale Netzwerkmodell basiert auf der 2016 veröffentlichten U-Net-Architektur ... Der Vorteil der U-Net-Architektur besteht darin, dass das neuronale Netzwerk die Originalbilder in verschiedenen Maßstäben analysiert und dies den Faltungsschichten ermöglicht, Bereiche des Bildes zu "betrachten", deren Größe mit zunehmender Tiefe des neuronalen Netzwerks exponentiell zunimmt. Mit anderen Worten, jede Falte "schaut" auf einen kleinen 3 × 3 px-Bereich. Dann wird der Maßstab um das Zweifache verringert, dann um zwei weitere: Jede nächste Faltung betrachtet einen Bereich von 3 × 3 Pixeln, aber hinter diesen Pixeln befinden sich Teile des Bildes, die mehrmals verkleinert wurden (6 × 6, 12 × 12, ...). Das letzte Ensemble enthält zwei weitere Faltungs-Neuronale Netze ähnlicher Architektur, die auf U-Net basieren, mit einem schwereren "Komprimierungs" -Teil als im Originalartikel.

Wo das Netzwerk schief geht, aber Ärzte nicht falsch liegen

Manchmal gibt es auf den Bildern sogenannte Artefakte, sei es das Ergebnis von Atmung oder Körperbewegung. In diesem Fall werden auf den Bildern Bereiche angezeigt, die Änderungen der Eigenschaften ähneln. Dies ist jedoch keine Pathologie. Selbst wenn das Modell diese Bereiche identifiziert hat, beträgt ihr Gesamteinfluss auf das Ergebnis mehrere Zehntel Prozent, und Entscheidungen werden von Quartilen getroffen, dh der Patient muss je nach Schadensgrad einer von vier Kategorien zugeordnet werden. Deshalb haben wir diesen Teil der Aufgabe vernachlässigt. Es war viel wichtiger, das Netzwerk für jeden im Land verwendeten Gerätetyp zu konfigurieren.

Normalisierung

Tomographen schreiben Dateien im DICOM-Standard, aber die Interpretation des Standards und der Aufnahmeformate kann sehr unterschiedlich sein, so dass die Pflege der Dateien, die alle CT-Geräte schreiben, viel Zeit und Nerven gekostet hat. Infolgedessen verfügen wir auch über ein Tool zum Reduzieren aller DICOM-Dateien auf einen einzigen Standard und ein einziges Formular, das zur Lösung diagnostischer Probleme hilfreich sein wird, wenn wir sie übernehmen. Und nicht nur COVID-19.

Unsere Software stört den Arzt nicht, sondern wird parallel installiert. Er hat seine üblichen Werkzeuge und unsere Lösung, die eine zusätzliche Reihe mit einem Analysebericht und der Lokalisierung der gefundenen Konsolidierungen zeigt. Der Analysebericht sieht folgendermaßen aus:

Die Software wird von On-Premise bereitgestellt und ist im Workflow der Klinik enthalten. Die Arbeit mit CT-Geräten und Arztarbeitsplätzen unter Verwendung des DICOM-Protokolls wird auf den Servern der Klinik in einem geschützten Schaltkreis installiert. Für das Funktionieren des neuronalen Netzwerks ist eine leistungsstarke GPU erforderlich. Es gibt auch eine Cloud-Lösung, die sich nicht jede regionale Klinik leisten kann. Es gibt Funktionen bei der Übertragung von medizinischen Daten, Sie müssen garantiert depersonalisiert sein.

Warum haben die Hersteller von Tomographen nichts unternommen?

Es scheint, dass wir die einzigen Helden sind, die diese Aufgabe übernommen haben. Nein, es gab andere Ansätze. Meistens haben die Hersteller von Tomographen das Sortieren nach der Hounsfield-Skala (Gewebedichte) abgeschlossen und entweder fertige, ähm ... separat lizenzierte Plug-Ins oder Richtlinien zum Einstellen der Einstellungen veröffentlicht, sodass nur ein bestimmter Gewebetyp angezeigt wird. Dies ermöglichte es, die Konsolidierungen besser zu sehen (idealerweise blieben nur Gewebe, die für sie hinsichtlich der Dichte für den Strahlungsfluss charakteristisch sind, im Rahmen), erlaubten ihnen jedoch immer noch nicht, automatisch zu zählen. Darüber hinaus war das Entsperren einer solchen Funktion für sie häufig teurer als einige unserer Implementierungen und GPU-Server.

Wo kann man mehr Details sehen?

Genau hier .

Weitere Details .