Britische Wissenschaftler haben KI geschult, um gesprochene Sprache mit einem virtuellen Gebärdensprachdolmetscher in Video umzuwandeln . Der Algorithmus bewertet unabhängig die Qualität der Arbeit. Das neuronale Netzwerk hilft Menschen mit teilweisem oder vollständigem Hörverlust, die Wahrnehmung von Inhalten zu verbessern und sich bei öffentlichen Veranstaltungen freier zu fühlen.

Es gibt zig Millionen gehörloser und schwerhöriger Menschen auf der Welt, die die Gebärdensprache als primäres Kommunikationsmittel verwenden. Einerseits wird in der Online-Welt das Kommunikationsproblem für hörgeschädigte Menschen mit Hilfe von Untertiteln gelöst. Andererseits müssen jetzt beliebte Webinare, Streams und andere Inhalte in Echtzeit in die Gebärdensprache übersetzt werden. Wissenschaftler haben dieses Problem lange untersucht und nach einer Lösung gesucht.

Forscher suchen jetzt nach Neurotechnologie. An der Universität von Surrey haben Entwickler einen Übersetzungsalgorithmus für Gebärdensprachen der neuen Generation entwickelt. KI wandelt gesprochene Sprache in Bewegungen des menschlichen Skeletts um. Das Skelett erhält dann ein menschliches Aussehen und es wird ein realistisches Filmmaterial erstellt. Mit Hilfe der Technologie können Sie auch Videos basierend auf Text erstellen.

Warum solche Schwierigkeiten und warum ist die Bewegung des gesamten Skeletts wichtig? In der Gebärdensprache geht es nicht nur um Handzeichen, sondern um alle Körperteile und sogar um Mimik. Frühere Technologien erzeugten häufig verschwommene Modelle, die zu Bedeutungsverzerrungen oder sogar zu Missverständnissen der Sprache des virtuellen Gebärdensprachdolmetschers führten.

Foto: ru.freepik.com

Wie das neue neuronale Netzwerk funktioniert

Der Algorithmus basiert auf Folgendem: Das Empfangssignal kommt in Form von Audio und wird dann in ein schematisches Modell des menschlichen Skeletts umgewandelt, das Sprache mit den entsprechenden Gesten reproduziert. Die Folge von Posen wird dann dem Faltungs-Neuronalen U-Net-Netzwerk zugeführt. Das Web wandelt Bewegungen und Posen in lebensechte Videos um.

Algorithmus eines virtuellen Gebärdensprachdolmetschers

Um hohe Ergebnisse zu erzielen, trainierten Wissenschaftler ein neuronales Netzwerk mit Videos von echten Gebärdensprachdolmetschern.

Um das resultierende Modell zu bewerten, führten die Entwickler Experimente unter Beteiligung von Freiwilligen durch. Deshalb baten sie sie, die neue Methode mit anderen zuvor verwendeten Sprachtransformationsmethoden zu vergleichen. Von den 46 Personen sprachen 13 Gebärdensprache. Der Vergleich wurde anhand von vier Parametern durchgeführt, für die der neue Algorithmus in der Qualität die vorherigen Versionen übertraf.

Ergebnisse einer Studie an Freiwilligen

Nicht nur britische Wissenschaftler

Seit Beginn des Jahrhunderts arbeiten Forscher an der Übersetzung von Gebärdensprachen. Eines der bekanntesten Produkte ist der animierte virtuelle Übersetzer von IBM . Das Projekt wurde jedoch nicht entwickelt. Einige Jahre später wurde er reinkarniert in Novosibirsk. Das von Wissenschaftlern des Nowosibirsk Academgorodok erfundene Programm erkennt Sprache, analysiert die Bedeutung und übersetzt in Gebärdensprache. Dann zeigt der Avatar den Text auf dem Bildschirm.

Animierter Gebärdensprachübersetzer von Nowosibirsker Entwicklern

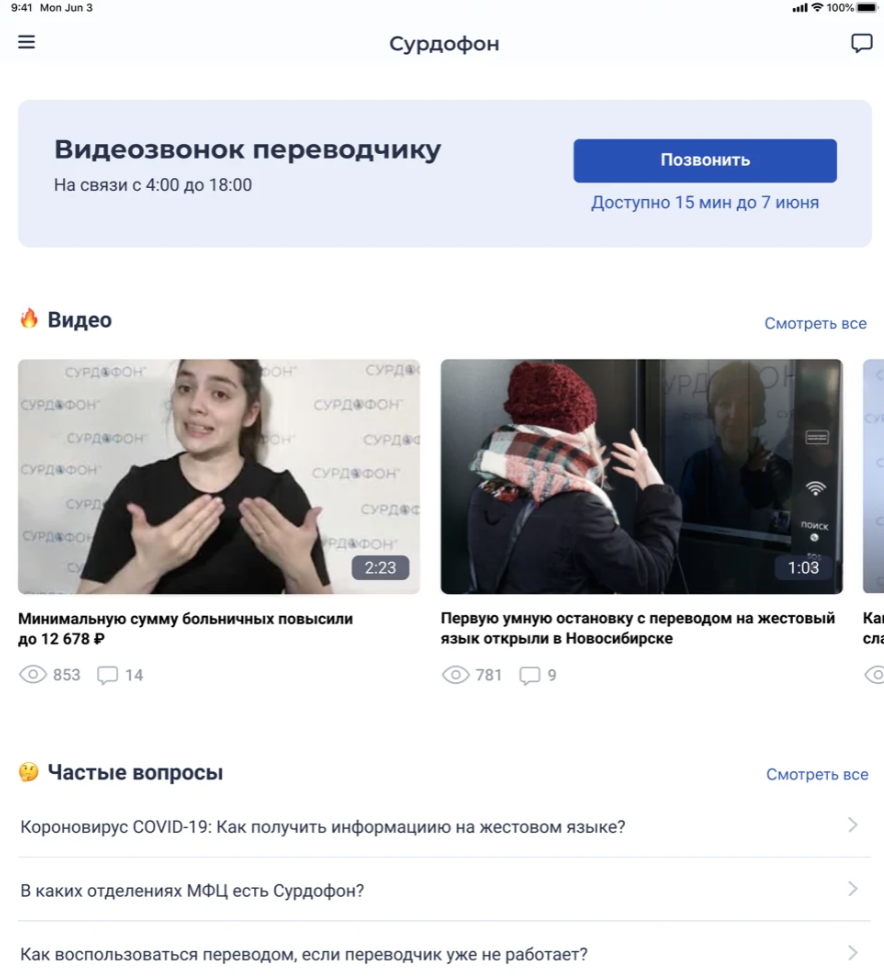

Damals glaubte man, dass die Entwicklung genauso populär werden würde wie Google Übersetzer. Jetzt können Sie das Programm in der Adaptis-Anwendung für den AppStore und Google Play testen .

Screenshot der Adaptis App im App Store

Vor einigen Jahren haben belgische Wissenschaftler eine 3D-Hand gedruckt, die von einem Arduino angetrieben wird und gleichzeitig als Gebärdensprachdolmetscher fungiert. Das Projekt wurde ASLAN genannt. Der Arm bestand aus 25 separaten PLA-Teilen. In Zukunft wollten sie eine weitere Hand und ein Robotergesicht hinzufügen, um Emotionen zu vermitteln.

Die Übersetzung von der Gebärdensprache in die gewohnte Sprache ist ebenfalls mit großen Schwierigkeiten verbunden. Russische Wissenschaftler vom Institut für Managementprobleme. V.A. Das Trapeznikov-Institut für Kontrollwissenschaften der Russischen Akademie der Wissenschaften (IPU RAS) hat vor einigen Jahren mit der Entwicklung einer solchen KI begonnen. Es wurde angenommen, dass er in Zukunft helfen würde, Gesten in Wörter, Phrasen und Buchstaben zu übersetzen. Wissenschaftler berichteten dann, dass die Erstellung eines Algorithmus mehr als ein Jahr dauern könnte.

Foto: ru.freepik.com Das

russische Programm basiert auf einer Website, die von einem hörgeschädigten Mitarbeiter des Instituts für Kontrollwissenschaften der Russischen Akademie der Wissenschaften erstellt wurde. Sie entwickelt seit mehreren Jahren die Surdoserver- Website. Gleichzeitig wurde berichtet, dass russische Wissenschaftler an einer mobilen Anwendung "Surdoservice" und einer tauben Wolke für den Informationsaustausch von hörgeschädigten Menschen arbeiten.