Empfehlungssysteme von Grund auf neu, Chatbots und mehr

Nachdem wir uns in den Abgrund der Textdaten gestürzt hatten, haben wir im Oktober dieses Jahres die ruGPT-3-Modelle trainiert - Modelle für die russische Sprache, die auf der Architektur von OpenAI basieren. Aber wozu sind diese Modelle fähig? In diesem Artikel werden wir die ersten Beispiele für die Anwendung des Modells sammeln - und neue ausprobieren.

Wir präsentieren die ersten Ergebnisse des größten trainierten Modells, ruGPT-3 Large, das in Zusammenarbeit mit den Teams SberDevices , Sber.AI und SberCloud entwickelt wurde . Lassen Sie uns mit Ihnen die Grenzen seiner Anwendung erkunden.

In diesem Jahr haben wir bei AI Journey einen Wettbewerb von Anwendungen vorbereitet. RuGPT-3 - jede Lösung, die ein Modell verwendet, das auf drei Skalen bewertet wird - Innovation, emotionales Engagement und geschäftliche Anwendbarkeit können auf der Strecke eingereicht werden.

Spoiler:

1 Million Rubel für den ersten Platz

Wie trainiere ich das Modell für eine neue Aufgabe?

Modelle und Code dafür befinden sich im sberbank-ai- Repository : Sie können die Transformator-Bibliothek oder Megatron-LM verwenden.

In diesem Artikel stelle ich Beispiele für Huggingface / Transformatoren vor - der Code für die Fälle ist hier angegeben:

- Feinabstimmung der Colab-Laptop- Modelle

- Nur einen Colab-Laptop generieren

Modellkarten in der Transformatorbibliothek: Groß Mittel Klein

Wenn Sie das Generierungsskript ausführen, ist es einfacher, alle auszuführen - und dann ein wenig zu warten, während das Modell geladen wird.

Das Skript in der letzten Zelle fordert Sie auf, den Anfang des Textes einzugeben - mein Lieblingssamen: "Brasilianische Wissenschaftler haben eine seltene Art von Zwerg-Einhörnern entdeckt, die im Westen Jütlands leben." Wir bekommen : Nur ruGPT-3 Small passt in einen Colab-Laptop, daher ist es besser, Karten mit mehr als 14 GB Speicher zu verwenden.

ruGPT-3 Small: , . Agence France-Presse. , Pygmaliona (. Pygmaliona pygmalioni), . 30 , — 1 . . , .

Übrigens gewähren wir den Teilnehmern der Strecke für die Dauer des Wettbewerbs Zugang zu den Einrichtungen von Christofari!

Für die Teilnehmer des ruGPT-3-Tracks haben wir 100 Konten zugewiesen - in jedem Konto 1 GPU Tesla V100-SXM3 32 GB kostenlos während des Wettbewerbs.

Wie bekomme ich ein Konto?

1) Registrieren Sie sich für den Track ruGPT-3 (AI 4 Humanities) ods.ai/tracks/aij2020

2) Schreiben Sie einen kurzen Brief mit dem Namen Ihres Teams und der Aufgabe an AIJ_ruGPT-3@sberbank.ru

Wenigschuss gegen Feinabstimmung

Bei großen generativen Modellen wie GPT-ähnlichen Architekturen gibt es verschiedene Möglichkeiten, diese zu "handhaben".

?

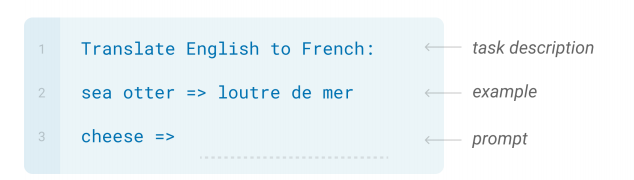

Die Umschulung großer Modelle kann sehr teuer sein. Durch diese Art der "Kommunikation" mit ihnen können Sie sogar dies vermeiden. Die Essenz der Seed-Programmierung besteht darin, solche vorbereiteten Beispiele und Anfänge für die Generierung auszuwählen, damit das Modell genau das produziert, was benötigt wird.

Durch Auswahl der Hyperparameter "Seed" und Generator (Temperatur, top_n, top_k) können nur aufgrund des vorläufigen Trainings des Modells akzeptable Antworten erzielt werden.

Ein Beispiel für einen Startwert mit einem Beispiel und einer Beschreibung des Problems.

Wir werden beide Methoden in der Praxis testen - wir werden versuchen, beliebte und spezifische Probleme von Grund auf neu zu lösen -, um sie durch zusätzliches Training zu lösen.

Empfehlungssysteme

Lassen Sie uns ein Empfehlungssystem ohne Schulung erstellen: Wir werden ruGPT-3 große Informationen über die Präferenzen des Benutzers in Form von Text übermitteln und beobachten, wie das Modell es fortsetzt. Wir können viele Optionen gleichzeitig generieren, um weitere Empfehlungen zu erhalten.

Filmempfehlungen: Nicht schlecht! Zumindest scheinen die Filme entsprechend dem Samen erzeugt zu werden. Da ich kein Kenner des sowjetischen Kinos bin, kannte ich den Film "Drei plus zwei" nicht einmal, aber er ist es. Für die Generierung haben wir die folgenden Hacks verwendet: Wir haben speziell Text mit einem offenen Anführungszeichen geliefert, um das Modell zu zwingen, Eigennamen zu generieren, und alle unnötigen nach dem ersten Satz abgeschnitten. Musikempfehlungen:

: — “”, “”, “

ruGPT-3 Large: — “”, “”, “ ”, “ ”, “ ”.

ruGPT-3 Large: — “”, “”, “ ”, “”, “” (, , , ).

ruGPT-3 Large: — “”, “”, “” .”

: : “ ”, “

ruGPT-3 Large: : “ ”, “ ” “ ”.

ruGPT-3 Large: : “ ”, “ ”.

ruGPT-3 Large: : “ ”, “ ”, “ ” .

: “ , “ ”, “ #( , )

ruGPT-3 Large: , “ ”, “” “”.

ruGPT-3 Large: , “ ”, “” “ ”.

ruGPT-3 Large: , “ ”, “”, “ ”, “ ”, “” “”.

Die Ergebnisse sind ständig unterschiedlich - Sie können möglicherweise N Varianten generieren, alle Gruppennamen extrahieren und den Zähler der beliebtesten sammeln - voila, ein Empfehlungssystem von Grund auf neu.

Bewertungen generieren

Nehmen wir eine schwierigere Aufgabe an - lassen Sie das Modell eine Person in Diskussionen oder Geschäften nachahmen: Wie Sie sehen, kann das Modell für im Internet weit verbreitete Themen kohärente Texte ohne Schulung generieren. Aber wo gibt es noch keinen Weg ohne zusätzliches Training? Es gibt 3 solcher Fälle:

: “ .

- ”

ruGPT-3 Large: “ .

- . , .”

: “ .

”

ruGPT-3 Large: “ .

.

, .

, , . , , .”

: .

"1+1"

ruGPT-3 Large: .

"1+1" — , . . . . " ", .

- komplexes Datenformat - wenn Sie während der Generierung ohne Training aufgrund der Generierung im falschen Format an Qualität verlieren - NER-Problem, Codegenerierung, symbolische Berechnungen usw.;

- , — QA , , , ;

- , , , — , .

StackOverflow

Erhöhen wir die Komplexität: Laden Sie Russisch [Stapelüberlauf] (https://ru.stackoverflow.com/) herunter und versuchen Sie, ein Frage-Antwort-System zu erstellen. Werden wir in der Lage sein, sofort sowohl den Stil der Antworten als auch das Wissen und mehrere Programmiersprachen zu lernen? Es ist nicht einfach, bei einem Taoki-Problem sofort ein gutes Ergebnis zu erzielen, aber wir können Spaß haben - über 5 Epochen hat das Modell gelernt, den Stil zu reproduzieren, da es inhaltlich sehr verwirrt ist. Aber ich habe die Links zur Dokumentation gut gelernt - ein ziemlich gutes Ergebnis für 5 Lernperioden.

Trainingsformat: Wir senden die Texte der Fragen und besten Antworten im Format Q: ”blabla” A: ”blabla”. (Es gibt eigentlich keine solche Bibliothek, das Modell hat einen Link zur Dokumentation generiert)

Q: python?

A: : push.log("Shalom").

- , .

set.log()**)

rGet = puts.random(extents) log.findIndex(puts.current) void join($window, command='unsetMainServer onManager') }

,

Q: python?

A: import pycode as pyc;

// ( href=https://docs.python.org/3/library/pycode.html )

Für solche Aufgaben können Sie zusätzliche Argumente eingeben, z. B. den Namen des Abschnitts / Betreffs / der Programmiersprache, auf den Sie antworten möchten, und das Modell anhand von Daten der Form {"Parameter": "Wert", "Frage": "Fragetext", "Antwort" trainieren: "Antworttext"}.

Sowohl in Bezug auf den Code als auch in Bezug auf den Text haben wir sofort eine Datei - vielleicht macht es jemand besser in der Spur? Es gibt bereits recht erfolgreiche Implementierungen des englischsprachigen Modells mit Code: Schreiben von HTML-Code von Webseitenelementen, Generieren von Figma-Vorlagen.

Andere Sprachen ausprobieren! Twitter und mehr

Die Hauptsprache des Modellunterrichts ist Russisch. Ist es jedoch möglich, das Modell in mehrsprachigen Aufgaben anzuwenden? Ein paar andere Sprachen fallen immer aus dem Internet in das Trainingsbeispiel, also gibt es Hoffnung. Der unkomplizierte Ansatz mit Seeds zeigt, dass das Modell ein wenig über das englische Modell weiß: Nun, fast: Manchmal funktioniert es überhaupt nicht: Warum nicht mit rein englischen Daten üben: Ich habe den Datensatz zur Klassifizierung von Twitter-Texten aus dem Kaggle-Wettbewerb genommen. Nach 5 Epochen mit fünftausend ersten Kommentaren (20 Minuten in Colab ) erhalten wir eine ziemlich erträgliche Erzeugung sehr toxischer Kommentare auf Englisch:

ruGPT-3 Large:

—> cat

—> dog

—> pear

—> coder

—> cat

—> dog

—> pear

—> Python

—> cat

—> dog

—> pear

—> bunch #

—> dog

—> cat

—> dog

Context >>> Is it

ruGPT-3 Small: Is it's the case that #Microsoft is using #SAP to manage #Microsoft’s business?

Context >>> It is

ruGPT-3 Small: It is the only one that I've been trying to do. Siri is on the verge of death, and I'm not aware of why she has to be on the verge.

Context >>> Why

ruGPT-3 Small: Why do I go here? I'm wondering if I can use the #Microsoft Windows 8 Pro for the #WindowsPhone phone? Thanks!

Dialogsysteme

Bereits ohne Vorschulung funktioniert die Anwendung des Modells auf Dialogsysteme recht gut: Das Modell kann die Chit-Chat-Funktion ausführen (über nichts sprechen) und frei über verschiedene Themen chatten. Mit zusätzlichen Schulungen zu bestimmten Szenarien und Domänen können Sie Geschäftsanwendungen implementieren.

Das folgende Beispiel ist ein Beispiel für einen Dialog ohne Schulung zu einem eng fokussierten Thema - der Unterstützung eines Internetanbieters.

Aussaat: erste 2 Linien - weitere Generation. Natürlich hat das Modell ohne Vorschulung keine klare Vorstellung von den Skripten und Skripten der Support-Spezialisten, aber selbst ein solcher Kaltstart zeigt bereits die Standardmethode, um „herauszufinden, was passiert ist - rumhängen - den Anruf umleiten“. Sie können sich an die Klassiker erinnern:

User1: , ! ?

User2: .

User1: ?

User2: 500

User1: ?

User2: . .. .

User1: ?

User2: . , - ...

User1: , , , , ?

User2:

User1: , . , .

User2: , . .

User1: . , , .

User2: , , ?

User1: ?

User2: . .

User1: ?

User2:

User1: . .

User1: , . - .

User2: , .

User1:

User2:

User1: «», 656, , .

User2: , 766—1669, : , , , , , , ?

User1: 1 . , , .

User2: , , , - ?

User1: , 1 . , - , , , . .

User2: , , , , - .

User1: .

User2: , ?

User1: , , .

User2: , , .

Im Allgemeinen "müssen Sie geduldig sein." Das Modell erinnerte sich sogar daran, dass Benutzer1 Dmitry heißt, und Benutzer2 verabschiedete sich entsprechend von ihm.

Anstelle einer Schlussfolgerung

Um die Richtung generativer Modelle weiterzuentwickeln und Architekturen bei NLP-Problemen zu verbessern, ist es immer notwendig, die Grenzen der Anwendbarkeit einer bestimmten Technologie - und ihre Relevanz - zu verstehen.

Jetzt mit jeder Veröffentlichung ähnlicher Architekturen - Reformer, Longformer, BigBird usw. - Wir betrachten große vorgefertigte Modelle auf eine etwas neue Art und Weise und stellen sie vor neue Herausforderungen.

Zusätzlich zu den oben genannten Fällen kann ruGPT-3 definitiv angewendet werden und ist vorteilhaft in Praktiken wie:

- Erweiterung von Textdaten für ML-Aufgaben

- Dialogmodelle für die Automatisierung

- generative Summationsaufgaben

- Umschreiben, Generieren von Nachrichten, Sportnotizen basierend auf strukturierten Informationen.

Hoffentlich kommen die Demos und Modelle der Community zugute - und machen Spaß!

Und natürlich warten wir bis Ende November auf Ihre Entscheidungen auf der ruGPT-3-Strecke!