In den letzten Jahren wurden bedeutende Fortschritte auf dem Gebiet der Verarbeitung natürlicher Sprache (NLP) erzielt , wo Modelle wie BERT , ALBERT , ELECTRA und XLNet bei verschiedenen Aufgaben eine erstaunliche Genauigkeit erzielt haben. Während des Vortrainings werden Vektordarstellungen auf der Grundlage eines umfangreichen Korpus von Texten (z. B. Wikipedia ) gebildet, die durch Maskieren von Wörtern und deren Vorhersage erhalten werden (sogenannte maskierte Sprachmodellierung)). Die resultierenden Darstellungen codieren eine große Menge an Informationen über die Sprache und die Beziehung zwischen Konzepten, beispielsweise zwischen einem Chirurgen und einem Skalpell. Dann beginnt die zweite Phase des Trainings - die Feinabstimmung - in der das Modell Daten verwendet, die für eine bestimmte Aufgabe geschärft wurden, um zu lernen, wie bestimmte Aufgaben wie die Klassifizierung unter Verwendung allgemeiner vorab trainierter Darstellungen ausgeführt werden . Angesichts der weit verbreiteten Verwendung solcher Modelle bei verschiedenen NLP-Problemen ist es wichtig zu verstehen, welche Informationen sie enthalten und wie sich gelernte Beziehungen auf die Ergebnisse des Modells in seinen Anwendungen auswirken, um sicherzustellen, dass sie den Prinzipien der künstlichen Intelligenz (KI) entsprechen .

Der Artikel „ Messung von Geschlechterkorrelationen in vorab trainierten NLP-Modellen “ untersucht das BERT-Modell und seinen leichten Cousin ALBERT auf der Suche nach geschlechtsspezifischen Beziehungen und formuliert eine Reihe von Best Practices für die Verwendung vorab trainierter Sprachmodelle. Die Autoren präsentieren experimentelle Ergebnisse in Form von öffentlichen Modellgewichten und explorativen Datensätzen, um die Anwendung von Best Practices zu demonstrieren und eine Grundlage für die weitere Untersuchung der Parameter zu schaffen, die über den Rahmen dieses Papiers hinausgeht. Außerdem planen die Autoren, eine Reihe von Zari- Gewichten zu erstellen , bei denen die Anzahl der Geschlechterkorrelationen verringert wird, bei Standard-NLP-Problemen jedoch eine hohe Qualität erhalten bleibt.

Korrelationen messen

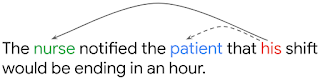

, , , . , . , , his («») nurse ( «»), patient («»).

– OntoNotes (Hovy et al., 2006). F1-, ( Tenney et al. 2019). OntoNotes , WinoGender, , , . ( 1) WinoGender , (.. nurse , ). , , , - , .

BERT ALBERT OntoNotes () WinoGender ( ). WinoGender , , .

, (Large) BERT, ALBERT WinoGender, ( 100%) (accuracy) OntoNotes. , . : , . , .. , , , , .

: NLP- ?

- : , , , . , BERT ALBERT 1% , 26% . : , WinoGender , , , , , , (male nurse).

- : , . , , , , . , , - (dropout regularization), : (dropout rate) BERT ALBERT, . , , , .

- : : , , WinoGender - . , OntoNotes ( BERT'), , - , . (. ).

, NLP-, . , . , , , , . , , , .

- — Kellie Webster

- Übersetzung - Ekaterina Smirnova

- Bearbeitung und Layout - Sergey Shkarin