Die Revolution der modernen künstlichen Intelligenz begann mit einem diskreten Forschungswettbewerb. Dies geschah 2012, dem dritten Jahr des ImageNet-Wettbewerbs. Die Herausforderung für die Teams bestand darin, eine Lösung zu entwickeln, die tausend Bilder erkennt, von Tieren und Menschen bis hin zu Landschaften.

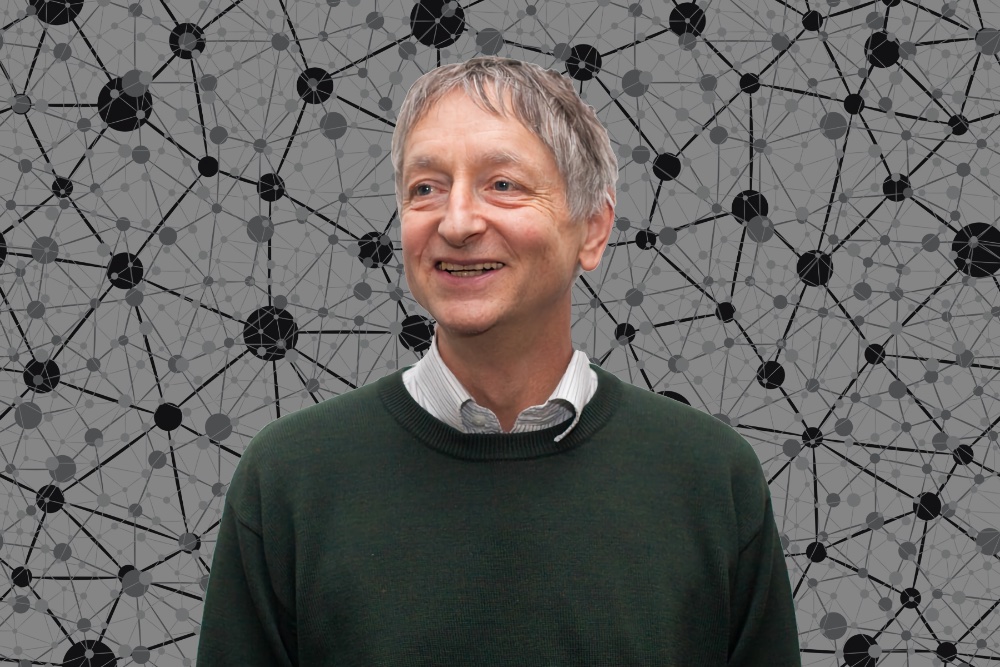

In den ersten zwei Jahren erreichten die Top-Teams nicht mehr als 75% Genauigkeit. Im dritten Jahr durchbrach plötzlich ein Forscherteam - ein Professor und seine Studenten - diese Decke. Sie gewannen den Wettbewerb mit erstaunlichen 10,8%. Der Name des Professors war Jeffrey Hinton, und seine Methode war tiefes Lernen.

Hinton hat seit den 1980er Jahren mit Deep Learning gearbeitet, aber die Effizienz wurde durch den Mangel an Daten und Rechenleistung eingeschränkt. Sein unerschütterlicher Glaube an die Methode zahlte sich letztendlich aus. Im vierten Jahr des Wettbewerbs wandte fast jedes Team tiefes Lernen an und erzielte auf wundersame Weise Genauigkeitsgewinne. Bald begann Deep Learning in verschiedenen Branchen und nicht nur bei Bilderkennungsaufgaben anzuwenden.

Im vergangenen Jahr wurde Hinton zusammen mit den Pionieren der künstlichen Intelligenz, Jan Lecun und Joshua Bengio, mit dem Turing-Preis für grundlegende Beiträge zu diesem Wissenschaftsbereich ausgezeichnet.

Sie denken, tiefes Lernen wird ausreichen, um die gesamte menschliche Intelligenz zu replizieren. Was macht dich so zuversichtlich?

Ich glaube, dass tiefes Lernen alles kann, aber ich denke, dass es einige konzeptionelle Durchbrüche geben muss. Zum Beispiel haben Ashish Vaswani und seine Kollegen 2017 Transformatoren eingeführt, die wirklich gute Vektoren ausgeben, die die Bedeutungen von Wörtern darstellen. Es war ein konzeptioneller Durchbruch. Es wird jetzt in fast allen der besten Verarbeitung natürlicher Sprache verwendet. Wir werden eine Reihe solcher Durchbrüche brauchen.

Und wenn wir solche Durchbrüche haben, werden wir künstliche Intelligenz durch tiefes Lernen der menschlichen Intelligenz näher bringen?

Ja. Insbesondere die Durchbrüche bezogen sich darauf, wie Sie große Vektoren neuronaler Aktivität erhalten, um Dinge wie Denken umzusetzen. Wir brauchen aber auch einen großen Umfang. Das menschliche Gehirn hat ungefähr hundert Billionen Parameter oder Synapsen. Das wirklich große Modell nennen wir jetzt GPT-3 mit 175 Milliarden Parametern. Das ist tausendmal kleiner als das Gehirn. GPT-3 kann jetzt ziemlich glaubwürdigen Text erzeugen, ist aber im Vergleich zum Gehirn immer noch winzig.

Wenn Sie über Skalierung sprechen, meinen Sie damit große neuronale Netze, Daten oder beides?

Beide. Es gibt ein Missverhältnis zwischen dem, was in der Informatik passiert, und dem, was beim Menschen passiert. Menschen haben eine große Anzahl von Parametern im Vergleich zu der Menge an Daten, die sie erhalten. Neuronale Netze sind überraschend gut mit viel weniger Daten und mehr Parametern, aber Menschen sind noch besser.

Viele KI-Spezialisten glauben, dass KI-Vernunft eine Fähigkeit ist, die weiter verfolgt werden muss. Sind Sie einverstanden?

Ich stimme zu, dass dies eines der wichtigsten Dinge ist. Ich denke auch, dass Bewegungssteuerung sehr wichtig ist, und Deep-Learning-Netzwerke werden heute gut darin. Insbesondere einige neuere Arbeiten von Google haben gezeigt, dass es möglich ist, Feinmotorik und Sprache so zu kombinieren, dass das System eine Schreibtischschublade öffnen, einen Block entfernen und in natürlicher Sprache mitteilen kann, was es getan hat.

Für Dinge wie GPT-3, das großartige Texte generiert, ist es klar, dass es viel verstehen muss, um Text zu generieren, aber es ist nicht ganz klar, wie viel es versteht. Aber wenn etwas eine Schublade öffnet, einen Block herausnimmt und sagt: "Ich habe gerade eine Schublade geöffnet und einen Block herausgenommen", ist es schwer zu sagen, dass es nicht versteht, was es tut.

KI-Spezialisten haben das menschliche Gehirn immer als unerschöpfliche Inspirationsquelle angesehen, und verschiedene Ansätze zur KI sind aus verschiedenen Theorien der Kognitionswissenschaft hervorgegangen. Denken Sie, dass das Gehirn wirklich eine Sicht auf die Welt aufbaut, um sie zu verstehen, oder ist es nur eine nützliche Denkweise?

In der Kognitionswissenschaft gibt es seit langem eine Debatte zwischen den beiden Denkschulen. Der Leiter der ersten Schule, Stephen Kosslin, glaubte, wenn das Gehirn mit visuellen Bildern arbeitet, sprechen wir über Pixel und ihre Bewegungen. Die zweite Schule entsprach eher der traditionellen KI. Seine Anhänger sagten: „Nein, nein, das ist Unsinn. Dies sind hierarchische, strukturelle Beschreibungen. Der Geist hat eine bestimmte symbolische Struktur, wir kontrollieren genau diese Struktur. "

Ich denke, beide Schulen haben den gleichen Fehler gemacht. Kosslin dachte, wir manipulieren Pixel, weil externe Bilder aus Pixeln bestehen und Pixel die Darstellung sind, die wir verstehen. Die zweite Schule dachte, weil wir symbolische Repräsentation manipulieren und Dinge durch Symbole darstellen, verstehen wir symbolische Repräsentation. Ich denke, diese Fehler sind gleichwertig. Im Gehirn befinden sich große Vektoren neuronaler Aktivität.

Es gibt Menschen, die immer noch glauben, dass symbolische Repräsentation ein Ansatz für KI ist.

Ganz richtig. Ich habe gute Freunde wie Hector Levesque, der wirklich an den symbolischen Ansatz glaubt und in diesem Sinne großartige Arbeit geleistet hat. Ich bin mit ihm nicht einverstanden, aber der symbolische Ansatz ist absolut vernünftig. Ich denke jedoch, dass wir am Ende erkennen, dass Symbole einfach in der Außenwelt existieren, und wir führen interne Operationen an großen Vektoren durch.

Welche Sichtweise der KI sehen Sie im Verhältnis zu anderen als das Gegenteil?

Mein Problem ist, dass ich diese gegensätzlichen Ansichten hatte und sie nach fünf Jahren zum Mainstream wurden. Die meisten meiner gegensätzlichen Ansichten aus den 1980er Jahren sind mittlerweile weit verbreitet. Es ist jetzt ziemlich schwierig, Leute zu finden, die mit ihnen nicht einverstanden sind. Also ja, meine gegensätzlichen Ansichten wurden auf irgendeine Weise untergraben.

Wer weiß, vielleicht sind Ihre Ansichten und Methoden zur Arbeit mit KI auch im Untergrund und werden in einigen Jahren zum Industriestandard. Die Hauptsache ist, nicht in Ihrem Fortschritt aufzuhören. Und wir helfen Ihnen gerne dabei, indem wir einen speziellen Promo-Code HABR präsentieren , der den Rabatt auf das Banner um 10% erhöht .

- Fortgeschrittenenkurs "Maschinelles Lernen Pro + Deep Learning"

- Kurs "Mathematik und maschinelles Lernen für Data Science"

- Kurs für maschinelles Lernen

- Data Science Berufsausbildung

- Data Analyst

- - Data Analytics