AI lernt, Bilder aus Signaturen zu generieren und beginnt unsere Welt besser zu verstehen

Von allen Modellen der künstlichen Intelligenz war es GPA-3 von OpenAI, das die Fantasie der Öffentlichkeit am meisten erregte. Ohne viel Aufforderung kann sie Gedichte, Kurzgeschichten und Lieder ausspucken, sodass Sie denken, dass dies das Werk einer Person ist. Aber Beredsamkeit ist nur eine Spielerei und sollte nicht mit echter Intelligenz verwechselt werden.

Die Forscher glauben jedoch, dass die gleichen Techniken, die zur Erstellung von GPT-3 verwendet wurden, ein Geheimnis für die Erstellung fortgeschrittener KI verbergen . GPT-3 wurde auf eine große Menge an Textinformationen trainiert. Was wäre, wenn die gleichen Techniken gleichzeitig auf Text und Bildern trainiert würden?

Eine neue Studie namens AI2 vom Paul Allen Institute for Artificial Intelligence hat diese Idee auf die nächste Stufe gebracht. Forscher haben ein spezielles visuell-sprachliches Modell erstellt. Es arbeitet mit Text und Bildern und kann letztere aus Signaturen generieren. Die Bilder sehen verstörend und seltsam aus, überhaupt nicht wie die hyperrealistischen Deepfakes, die durch generative Adversarial Networks (GANs) erzeugt werden. Aber sie könnten eine neue Richtung für mehr praktische Intelligenz einschlagen und vielleicht Roboter schlauer machen.

Die Lücke füllen

Der GPT-3 gehört zu einer Gruppe von Modellen, die als "Transformatoren" bekannt sind. Sie wurden zum ersten Mal dank des Erfolgs von BERT, dem Google-Algorithmus, populär. Vor BERT waren Sprachmodelle ziemlich schlecht. Ihre Vorhersagefähigkeiten reichten aus, um automatisch zu vervollständigen, aber nicht, um lange Sätze zu verfassen, in denen Grammatikregeln und gesunder Menschenverstand beachtet werden.

BERT änderte die Situation durch die Einführung einer neuen Technik namens Maskierung ( Hinweis - der ursprüngliche Name ist Maskierung). Dies impliziert, dass sich verschiedene Wörter im Satz verstecken und das Modell die Lücke füllen muss. Beispiele:

- Die Frau ging zu ___, um zu üben.

- Sie kauften ___ Brot, um Sandwiches zu machen.

Die Idee ist, dass, wenn Sie das Modell zwingen, diese Übungen oft millionenfach auszuführen, es Muster entdeckt, wie Wörter zu Sätzen und Sätze zu Absätzen zusammengesetzt werden. Infolgedessen generiert und interpretiert der Algorithmus den Text besser und kommt dem Verständnis der Bedeutung der Sprache näher. (Google verwendet jetzt BERT, um relevantere Suchergebnisse zu liefern.) Nachdem sich die Maskierung als äußerst effektiv erwiesen hatte, versuchten die Forscher, sie auf visuelle Sprachmodelle anzuwenden, indem sie Wörter in Signaturen versteckten. Auf diese Weise:

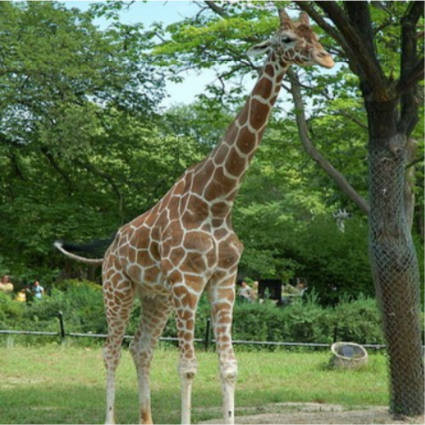

____ liegt neben einem Baum auf dem Boden. Quelle: AI2

Dieses Mal könnte das Modell die umgebenden Wörter und den Bildinhalt betrachten, um die Lücke zu füllen. Nach einer Million Wiederholungen lernte sie, nicht nur die Muster von Wörtern zu erkennen, sondern auch die Verbindung von Wörtern mit den Elementen jedes Bildes.

Infolgedessen können Modelle Textbeziehungen mit visuellen Beispielen verknüpfen, wie Babys Verbindungen zwischen gelernten Wörtern und Dingen herstellen, die sie sehen. Models können das Foto unten aufnehmen und eine aussagekräftige Bildunterschrift zusammenstellen, z. B. "Frauen spielen Feldhockey". Oder sie beantworten eine Frage wie "Welche Farbe hat der Ball?", Indem sie das Wort "Ball" einem kreisförmigen Objekt auf einem Foto zuordnen.

Ein visuellsprachiges Modell kann eine aussagekräftige Bildunterschrift für dieses Foto erstellen: "Frauen spielen Feldhockey". Quelle: JOHN TORCASIO / UNSPLASH

Besser das Bild einmal sehen

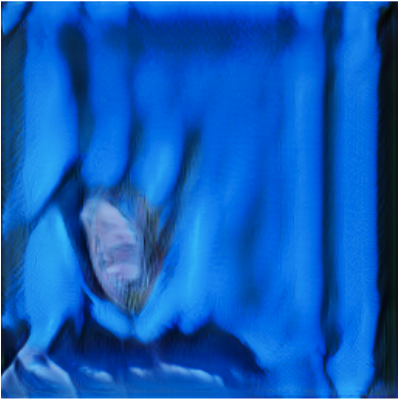

Die Forscher wollten wissen, ob diese Modelle ein konzeptionelles Verständnis der visuellen Welt entwickeln. Ein Kind, das ein Wort für ein Objekt gelernt hat, kann es nicht nur benennen, sondern das Objekt auch gemäß dem Hinweis zeichnen, selbst wenn das Objekt selbst nicht vorhanden ist. Das AI2-Projektteam schlug daher vor, dass die Modelle dasselbe tun: Bilder aus Untertiteln generieren. Alle Modelle produzierten bedeutungslosen Pixelmüll.

Ist es ein Vogel? Das ist ein Flugzeug? Nein, das ist Kauderwelsch, der durch künstliche Intelligenz erzeugt wird. Quelle: AI2

Es ist sinnvoll: Das Konvertieren von Text in ein Bild ist schwieriger als das Gegenteil. „Die Signatur definiert nicht alles auf dem Bild“, sagt Ani Kembhavi, Leiter des Computer Vision-Teams von AI2. Daher muss das Modell auf eine große Menge an Wissen über unsere Welt zurückgreifen, um fehlende Details hinzuzufügen.

Wenn ein Modell beispielsweise aufgefordert wird, eine "Giraffe, die eine Straße entlang geht" zu zeichnen, muss es zu dem Schluss kommen, dass die Straße eher grau als hellrosa ist und neben einem Feld und nicht am Meer verläuft. Obwohl all diese Informationen nicht explizit sind.

Also beschlossen Kembhavi und seine Kollegen Jemin Cho, Jiasen Lu und Hannane Hajishirzi zu prüfen, ob sie dem Modell all dieses verborgene visuelle Wissen beibringen könnten, indem sie den Ansatz zur Maskierung optimieren. Anstatt den Algorithmus zu trainieren, um einfach die "maskierten" Wörter in den Bildunterschriften der entsprechenden Fotos vorherzusagen, trainierten sie ihn auch, um die "maskierten" Pixel in den Fotos basierend auf den entsprechenden Bildunterschriften vorherzusagen.

Die vom Modell erstellten endgültigen Bilder sind nicht ganz realistisch. Aber es ist nicht wichtig. Sie enthalten die richtigen visuellen Konzepte auf hoher Ebene. KI verhält sich wie ein Kind, das einen Strichmännchen zeichnet, um eine Person darzustellen. (Sie können das Modell hier selbst testen ).

Beispielbilder, die vom AI2-Modell aus Untertiteln generiert wurden. Quelle: AI2

Die Fähigkeit visueller Sprachmodelle, solche Bilder zu erzeugen, ist ein wichtiger Fortschritt in der Forschung mit künstlicher Intelligenz. Dies deutet darauf hin, dass das Modell tatsächlich zu einer bestimmten Abstraktionsebene fähig ist - eine grundlegende Fähigkeit zum Verständnis der Welt.

Langfristig kann die Fähigkeit wichtige Auswirkungen auf die Robotik haben. Je besser der Roboter die Umgebung versteht und die Sprache zur Kommunikation verwendet, desto komplexere Aufgaben kann er ausführen. Kurzfristig, so Hajishirzi, wird die Visualisierung den Forschern helfen, besser zu verstehen, was genau das Modell lernt, das jetzt wie eine Black Box funktioniert.

In Zukunft plant das Team, mehr zu experimentieren, die Qualität der Bilderzeugung zu verbessern und das Bild und den Wortschatz des Modells zu erweitern: um mehr Themen, Objekte und Adjektive aufzunehmen.

„Die Erstellung der Bilder war wirklich das fehlende Puzzleteil“, sagt Lu. "Indem wir es hinzufügen, können wir dem Modell beibringen, unsere Welt besser zu verstehen."