50 Jahre Geschichte der Grafikkarten (1970-2020): Eine vollständige Geschichte der Grafikkarten und ihrer Vorfahren

Teil 1

Computergrafik. Wenn wir diese Worte hören, präsentieren wir atemberaubende Spezialeffekte von großen Blockbustern, wunderschöne Charaktermodelle aus AAA-Spielen und alles, was mit der visuellen Schönheit moderner Technologie zu tun hat. Aber Computergrafiken haben sich wie jeder technologische Aspekt seit mehr als einem Jahrzehnt entwickelt und den Weg von der Anzeige mehrerer Symbole auf einem monochromen Display zu erstaunlichen Landschaften und Helden überwunden, die von Jahr zu Jahr schwieriger von der Realität zu unterscheiden sind. Heute werden wir eine Geschichte darüber beginnen, wie die Geschichte der Computergrafik begann, wie der Begriff "Grafikkarte" und die Abkürzung für GPU entstanden sind und welche technischen Grenzen die Marktführer Jahr für Jahr überwunden haben, um ein neues Publikum zu erobern.

Vorwort der Ära. Die Geburt der Computer (1940er / 1950er Jahre)

Die Ära der Computertechnologie, die viele mit dem Beginn der Ära der Personal Computer in den frühen 80er Jahren verbinden, aber tatsächlich erschienen die ersten Computer viel früher. Die erste Entwicklung solcher Maschinen begann vor dem Zweiten Weltkrieg, und Prototypen, die vage an zukünftige PCs erinnern, wurden bereits 1947 veröffentlicht. Das erste derartige Gerät war der IBM 610, ein experimenteller Computer, der von John Lenz vom Watson Laboratory der Columbia University entwickelt wurde. Er war der erste in der Geschichte, der den stolzen Namen "Personal Automatic Computer" (PAC) erhielt, obwohl er leicht übertrieben war - die Maschine kostete 55.000 US-Dollar, und es wurden nur 150 Kopien hergestellt.

Die ersten beeindruckenden visuellen Systeme erschienen in den gleichen Jahren. Bereits 1951 entwickelte IBM unter Beteiligung von General Electric und einer Reihe von Militärunternehmern einen Flugsimulator für die Bedürfnisse der Armee. Es nutzte die Technologie der dreidimensionalen Virtualisierung - der Pilot, der sich hinter dem Simulator befand, sah die Projektion des Cockpits und konnte sich wie bei der Steuerung eines realen Flugzeugs verhalten. Später wurde der grafische Prototyp von Evans & Sutherland verwendet, der einen vollwertigen CT5-Pilotsimulator auf der Basis einer Reihe von DEC PDP-11-Computern entwickelte. Denken Sie nur - es sind noch die 50er Jahre, und wir hatten bereits dreidimensionale Grafiken!

1971-1972. Magnavox Odyssey und PONG

Der Boom in der Halbleitertechnologie und die Herstellung von Mikroschaltungen haben das Kräfteverhältnis in einem Markt, der früher zu sperrigen analogen Computern gehörte, die ganze Hallen besetzten, völlig verändert. Die Branche hat sich von Vakuumröhren und Lochkarten entfernt und ist in die Ära der Familienunterhaltung eingetreten. Sie hat die westliche Welt mit "Heimvideospielsystemen" bekannt gemacht, den Urgroßmüttern moderner Konsolen.

Ein Pionier in der Videospielunterhaltung war ein Gerät namens Odyssey Magnavox, das erste offiziell veröffentlichte Spielesystem. Die Odyssey hatte Controller, die nach modernen Maßstäben ausgefallen waren, und das gesamte Grafiksystem zeigte nur eine Linie und zwei Punkte auf dem Fernsehbildschirm an, die von den Spielern gesteuert wurden. Die Entwickler des Geräts näherten sich der Sache mit Fantasie, und die Konsole war mit speziellen farbigen Überlagerungen auf dem Bildschirm ausgestattet, die die Spielwelten mehrerer Projekte, die mit Odyssey geliefert wurden, "malen" konnten. Insgesamt wurden 28 Spiele für das Gerät veröffentlicht, darunter ein scheinbar einfaches Ping-Pong, das Enthusiasten der jungen Atari-Firma dazu inspirierte, einen Spielautomaten namens Pong mit einem identischen Spiel herauszubringen. Es war Pong, das den Beginn der Magie der Spielautomaten darstellte, die übrigens Anfang der 80er Jahre sowohl Japan als auch die westliche Welt vollständig eroberte.

Trotz ihrer offensichtlichen Einfachheit verwendete die Magnavox Odyssey echte Patronen - allerdings in vielerlei Hinsicht nur zur Wirkung. Es waren keine Speicherchips darin - die Patronen dienten als ein Satz von Jumpern, die eine Anordnung einer Linie mit Punkten auf magische Weise in eine andere verwandelten und dadurch das Spiel veränderten. Die primitive Set-Top-Box war weit entfernt von einem vollwertigen Videochip, aber die Popularität von Magnavox Odyssey zeigte ein klares Interesse der Öffentlichkeit, und viele Unternehmen begannen, ihre eigenen Geräte zu entwickeln, und spürten das Gewinnpotential.

1976-1977. Fairchild Channel F und Atari 2600

Es dauerte nicht lange, bis der erste ernsthafte Kampf um den neugeborenen Spielemarkt stattfand. 1975 verschwand die schnell alternde Magnavox Odyssey aus den Regalen, und an ihrer Stelle kämpften zwei Geräte um den Titel der besten Konsole der neuen Generation - Channel F von Fairchild und Atari VCS von der Firma, die der Welt Pong schenkte.

Trotz der Tatsache, dass die Entwicklung von Konsolen fast gleichzeitig vor sich ging, hatte Atari keine Zeit - und Fairchild war der erste, der sein Gerät namens Fairchild Video Entertainment System (VES) herausbrachte.

Die Fairchild-Konsole kam im November 1976 in die Läden und ist eine Fundgrube technischer Stärken. Anstelle von undeutlichen Odyssey-Controllern erschienen komfortable, gefälschte Kassetten wurden durch echte ersetzt (in denen sich ROM-Chips mit Spieldaten befanden), und in der Konsole wurde ein Lautsprecher installiert, der Sounds und Musik von einem laufenden Spiel wiedergab. Der Anhang konnte ein Bild mit einer 8-Farben-Palette (im Schwarzweiß-Linienmodus oder in der Farbe) mit einer Auflösung von 102 x 54 Pixel zeichnen. Unabhängig davon ist zu beachten, dass der im VES-System installierte Fairchild F8-Prozessor von Robert Noyce entwickelt wurde, der 1968 eine kleine, aber vielversprechende Firma Intel gründete.

Atari war am Rande der Verzweiflung - das Stella-Projekt, die Grundlage der zukünftigen Konsole, war in Bezug auf die Entwicklung weit zurückgeblieben, und der Markt wird, wie Sie wissen, nicht warten. Viele Dinge, die mit der Veröffentlichung von Fairchild VES innovativ erschienen, sollten ein wesentlicher Bestandteil aller zukünftigen Konsolen werden. Als Atari-Gründer Nolan Bushnell feststellt, dass alles auf dem Spiel steht, unterzeichnet er eine Vereinbarung mit Warner Communications, in der er seine Idee für 28 Millionen US-Dollar verkauft, unter der Bedingung, dass die Atari-Konsole so schnell wie möglich auf den Markt kommt.

Warner enttäuschte nicht und die Arbeit an der Konsole begann mit neuer Kraft zu kochen. Um die Logik zu vereinfachen und die Produktionskosten zu senken, war der berühmte Ingenieur Jay Miner an der Entwicklung beteiligt, der die TIA-Chips (Television Interface Adapter) für Videoausgabe und Audioverarbeitung zu einem einzigen Element überarbeitete. Dies war der letzte Schliff, bevor die Konsole fertig war. Um Fairchild zu ärgern, nannten Atari-Vermarkter die Konsole VCS (Video Computer System) und zwangen den Konkurrenten, Channel F umzubenennen.

Dies half Channel F jedoch nicht, erfolgreich mit dem neuen Produkt zu konkurrieren - obwohl zum Zeitpunkt der Veröffentlichung der Konsole im Jahr 1977 nur 9 Spiele fertig waren, erkannten die Entwickler schnell den Beginn eines neuen technologischen Zeitalters und begannen, die Leistung der Konsole voll auszuschöpfen. Der Atari VSC (später der Atari 2600) war die erste Set-Top-Box, die auf einem komplexen Chip basierte und nicht nur Video und Audio, sondern auch vom Joystick empfangene Befehle verarbeitete. Die bescheidenen Verkäufe, die Warner zunächst in Verlegenheit brachten, wurden durch phänomenalen Erfolg ersetzt, nachdem die japanische Firma Taito beschlossen hatte, die Arcade Space Invaders zu lizenzieren. Die Kassetten, die ursprünglich auf 4 KB Speicher begrenzt waren, wuchsen schließlich auf 32 KB, und die Anzahl der Spiele betrug Hunderte.

Das Erfolgsgeheimnis von Atari lag in der maximal vereinfachten Logik des Geräts, der Fähigkeit der Entwickler, Spiele mit 2600 Ressourcen flexibel zu programmieren (z. B. die Farbe des Sprites beim Zeichnen ändern zu können) sowie der externen Attraktivität und den praktischen Controllern, den so genannten Joysticks (vom wörtlichen Joystick - dem Stab des Glücks). ... Wenn Sie also nicht wissen, woher dieser Begriff stammt, können Sie den Atari-Entwicklern dafür danken. Sowie für das Hauptbild aller Retro-Spiele - ein lustiger Alien von Space Invaders.

Nachdem der Erfolg des Atari 2600 alle vorhergesagten Werte übertroffen hatte, verließ Fairchild den Videospielmarkt und entschied, dass die Richtung bald vergehen würde. Höchstwahrscheinlich bedauert das Unternehmen eine solche Entscheidung immer noch.

1981-1986. Die Ära des IBM PCs.

Trotz der Tatsache, dass Apple bereits 1979 den Apple II einführte, der das Image des zugänglichen Computers für immer veränderte, erschien das Konzept des "Personal Computers" wenig später und gehörte zu einem völlig anderen Unternehmen. Die monumentale IBM mit jahrzehntelangen umständlichen Großrechnern (Spulengeräusche und flackernde Lichter) trat plötzlich beiseite und schuf einen Markt, den es noch nie gab.

1981 wurde der legendäre IBM PC in den Handel gebracht, dem eine der besten Werbekampagnen in der Marketinggeschichte vorausging. "Niemand wurde jemals wegen des Kaufs von IBM entlassen", heißt es unter dem gleichen Motto, der für immer in die Werbegeschichte eingehen wird.

Es waren jedoch nicht nur Slogans und auffällige Werbebeilagen, die den Namen des IBM-Personalcomputers ausmachten. Für ihn wurde zum ersten Mal in der Geschichte ein komplexes Grafiksystem aus zwei Videoadaptern entwickelt - einem Monochrom-Anzeigeadapter (MDA, Monochrom-Anzeigeadapter) und einem Farbgrafikadapter (CGA, Farbgrafikadapter).

MDA war für die Eingabe mit Unterstützung für 80 Spalten und 25 Zeilen auf dem Bildschirm für ASCII-Zeichen mit einer Auflösung von 720 × 350 Pixel vorgesehen. Der Adapter verwendete einen 4K-Videospeicher und zeigte grünen Text auf einem schwarzen Bildschirm an. In diesem Modus war es einfach und bequem, mit Teams, Dokumenten und anderen täglichen Aufgaben des Unternehmenssektors zu arbeiten.

Das CGA hingegen könnte als Durchbruch in Bezug auf die Grafikfunktionen bezeichnet werden. Der Adapter unterstützte eine 4-Bit-Palette mit einer Auflösung von 640 x 200 Pixel, hatte 16 KB Speicher und bildete die Grundlage für den Computergrafikstandard für die aktiv wachsende Reihe von IBM PC-Computern.

Die Verwendung von zwei verschiedenen Videoausgangsadaptern hatte jedoch schwerwiegende Nachteile. Viele mögliche technische Probleme, hohe Gerätekosten und eine Reihe anderer Einschränkungen veranlassten Enthusiasten, an einer universellen Lösung zu arbeiten - einem Grafikadapter, der in zwei Modi gleichzeitig arbeiten kann. Das erste derartige Produkt auf dem Markt war die Hercules Graphics Card (HGC), die 1984 von der gleichnamigen Firma Hercules entwickelt wurde.

Herkules-Grafikkarte (HGC)

Der Legende nach entwickelte der Gründer der Firma Hercules, Van Suwannukul, ein System speziell für die Bearbeitung seiner Doktorarbeit in seiner thailändischen Muttersprache. Der Standard-IBM MDA-Adapter zeigte thailändische Schriftarten nicht korrekt an, was den Entwickler dazu veranlasste, 1982 mit der Erstellung von HGC zu beginnen.

Die Unterstützung von 720 x 348 Pixel für Text und Grafiken sowie die Möglichkeit, im MDA- und CGA-Modus zu arbeiten, sorgten für eine lange Lebensdauer des Hercules-Adapters. Das Erbe des Unternehmens in Form der universellen Videoausgabestandards HGC und HGC + wurde von Entwicklern von IBM-kompatiblen Computern und später einer Reihe anderer Systeme bis Ende der 90er Jahre genutzt. Die Welt stand jedoch nicht still und die rasante Entwicklung der Computerindustrie (sowie ihres grafischen Teils) zog viele andere Enthusiasten an - darunter vier Migranten aus Hongkong - Hwo Yuan Ho, Lee Lau und Francis Lau (Francis Lau) und Benny Lau (Benny Lau), die Array Technology Inc gegründet haben - das Unternehmen, das die ganze Welt als ATI Technologies Inc. anerkennen wird.

1986-1991. Der erste Boom auf dem Grafikkartenmarkt. Frühe Erfolge von ATI

Nach der Veröffentlichung des IBM-PCs blieb IBM nicht lange an der Spitze der Computertechnologie. Bereits 1984 stellte Steve Jobs den ersten Macintosh mit einer beeindruckenden grafischen Oberfläche vor, und vielen wurde klar, dass die grafische Technologie einen echten Sprung nach vorne machen würde. Trotz des Verlusts der Branchenführerschaft hat sich IBM in seiner Vision von Apple und anderen Wettbewerbern unterschieden. Die IBM-Philosophie offener Standards öffnete die Tür zu jedem kompatiblen Gerät, das zahlreiche Startups seiner Zeit auf den Markt brachte.

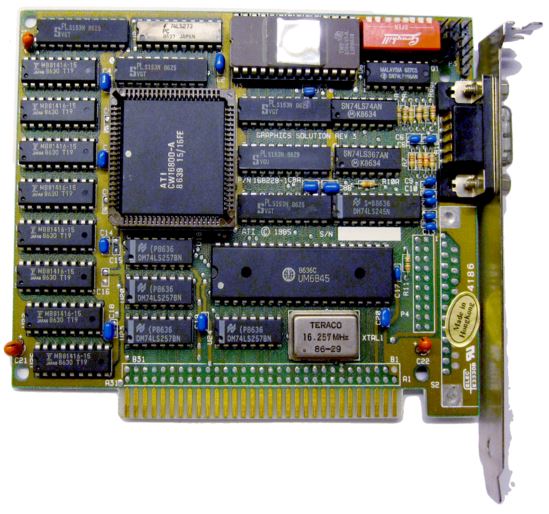

Unter ihnen war das junge Unternehmen ATI Technologies. 1986 stellten Hongkonger Spezialisten ihr erstes kommerzielles Produkt vor, die OEM Color Emulation Card.

Farbemulationskarte

Die ATI-Ingenieure erweiterten die Funktionen von Standard-Monochrom-Controllern und stellten drei Schriftfarben auf einem schwarzen Bildschirm bereit - Grün, Bernstein und Weiß. Der Adapter hatte 16 KB Speicher und erwies sich als Teil von Commodore-Computern. In seinem ersten Verkaufsjahr brachte das Produkt ATI über 10 Millionen US-Dollar ein.

Dies war natürlich nur der erste Schritt für ATI - nach der erweiterten Grafiklösung mit 64 KB Videospeicher und der Fähigkeit, in drei Modi (MDA, CGA, EGA) zu arbeiten, kam die ATI Wonder-Linie auf den Markt, mit deren Erscheinungsbild die bisherigen Standards in Archaismen geschrieben werden konnten ...

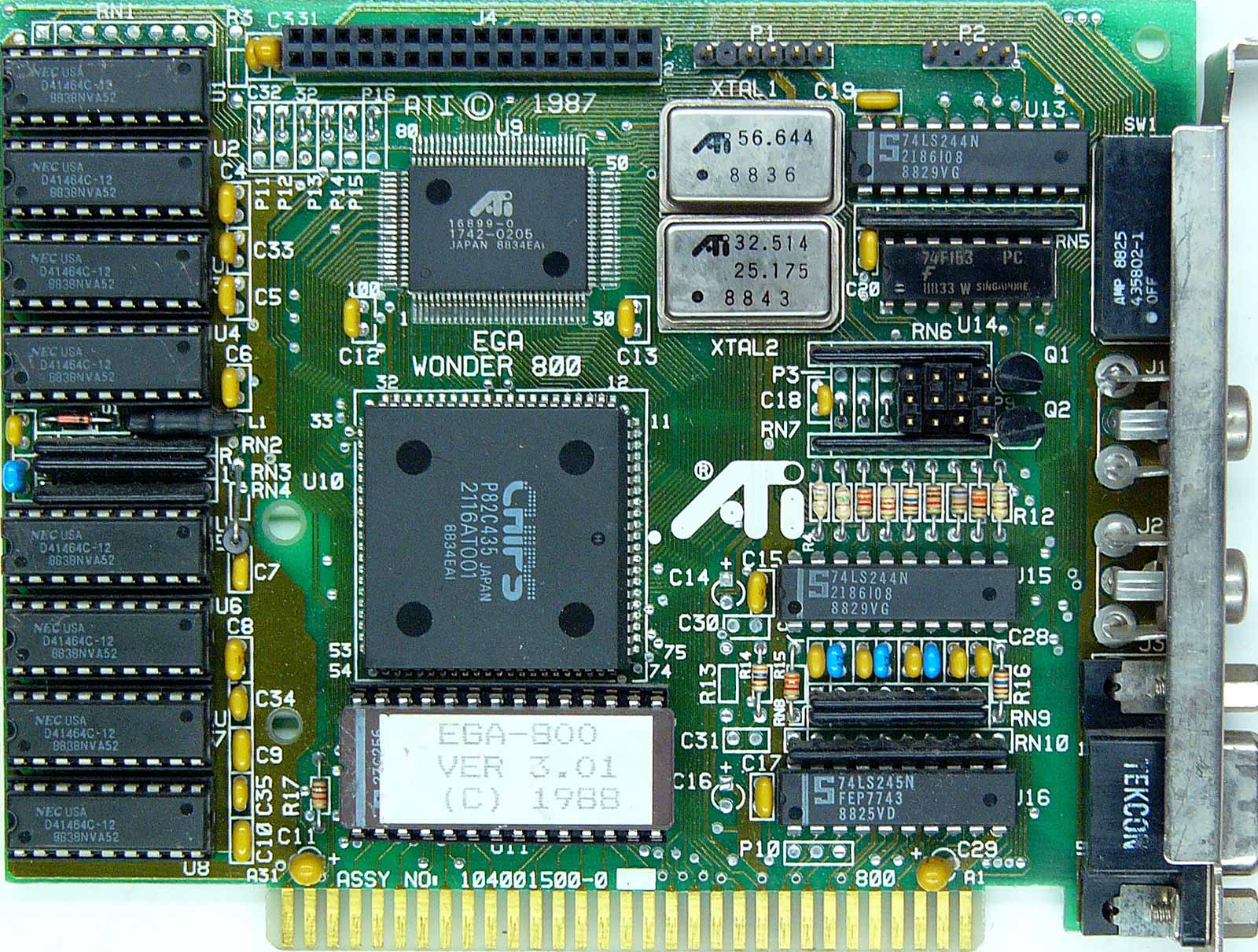

Klingt zu mutig? Überzeugen Sie sich selbst - Adapter der Wonder-Serie erhielten einen Puffer von 256 KB Videospeicher (viermal mehr!). Anstelle einer Vierfarbenpalette wurden 16 Farben mit einer Auflösung von 640 x 350 auf dem Bildschirm angezeigt. Gleichzeitig gab es keine Einschränkungen bei der Arbeit mit verschiedenen Ausgabeformaten - ATI Wonder emulierte erfolgreich einen der frühen Modi (MDA, CGA, EGA) und erhielt ab der 2. Serie Unterstützung für den neuesten Extend EGA-Standard.

ATi Wonder

Der Höhepunkt der Entwicklung der Linie im Jahr 1987 war der berühmte ATI EGA Wonder 800, der eine 16-Farben-Palette bereits im VGA-Format in einer unglaublich hohen Auflösung von 800 x 600 zeigte. Der Adapter wurde im günstigeren VIP-Format (VGA Improved Performance Card) mit eingeschränkter Unterstützung der VGA-Ausgabe verkauft.

Die erste Blütezeit des Grafikkartenmarktes. ATI-Innovationen, der Beginn des Wettbewerbs

Der bedeutende Erfolg von ATI bei der Entwicklung kommerzieller Grafikadapter zog die Aufmerksamkeit vieler anderer Unternehmen auf sich - von 1986 bis 1987 Marken wie Trident, SiS, Tamarack, Realtek, Oak Technology und LSI (G-2) Inc), Hualon, Cornerstone Imaging und Windbond. Neben neuen Gesichtern interessierten sich aktuelle Vertreter des Silicon Valley - Unternehmen wie AMD, Western Digital / Paradise Systems, Intergraph, Cirrus Logic, Texas Instruments, Gemini und Genua - für den Eintritt in den Grafikmarkt - jeder von ihnen präsentierte irgendwie das erste Grafikprodukt in die gleiche Zeitspanne.

1987 trat ATI als Zulieferer mit der Produktreihe Graphics Solution Plus in den OEM-Markt ein. Diese Leitung wurde für den 8-Bit-Bus von IBM PC / XT-Computern entwickelt, die auf der Intel 8086/8088-Plattform basieren. Die GSP-Adapter unterstützten auch die Ausgabeformate MDA, CGA und EGA, jedoch mit dem ursprünglichen Wechsel zwischen ihnen auf der Karte selbst. Das Gerät wurde auf dem Markt gut aufgenommen, und selbst ein ähnliches Modell von Paradise Systems mit 256 KB Videospeicher (GSP hatte nur 64 KB) hinderte Ati nicht daran, ein neues erfolgreiches Produkt in sein Portfolio aufzunehmen.

In den nächsten Jahren hat das kanadische Unternehmen ATI Technologies Inc. blieb auf dem Höhepunkt der grafischen Innovation und übertraf ständig die Konkurrenz. Die damals bekannte Wonder-Adapterreihe war die erste auf dem Markt, die auf 16-Bit-Farben umstellte. erhielt Unterstützung für EVGA (in Wonder 480 und Wonder 800+ Adapter) und SVGA (in Wonder 16). 1989 senkte ATI die Preise für die Wonder 16-Linie und fügte einen VESA-Anschluss hinzu, mit dem zwei Adapter miteinander verbunden werden können. Wir können sagen, dass dies die ersten Fantasien über Bündel mehrerer Geräte waren, die viel später auf den Markt kommen werden.

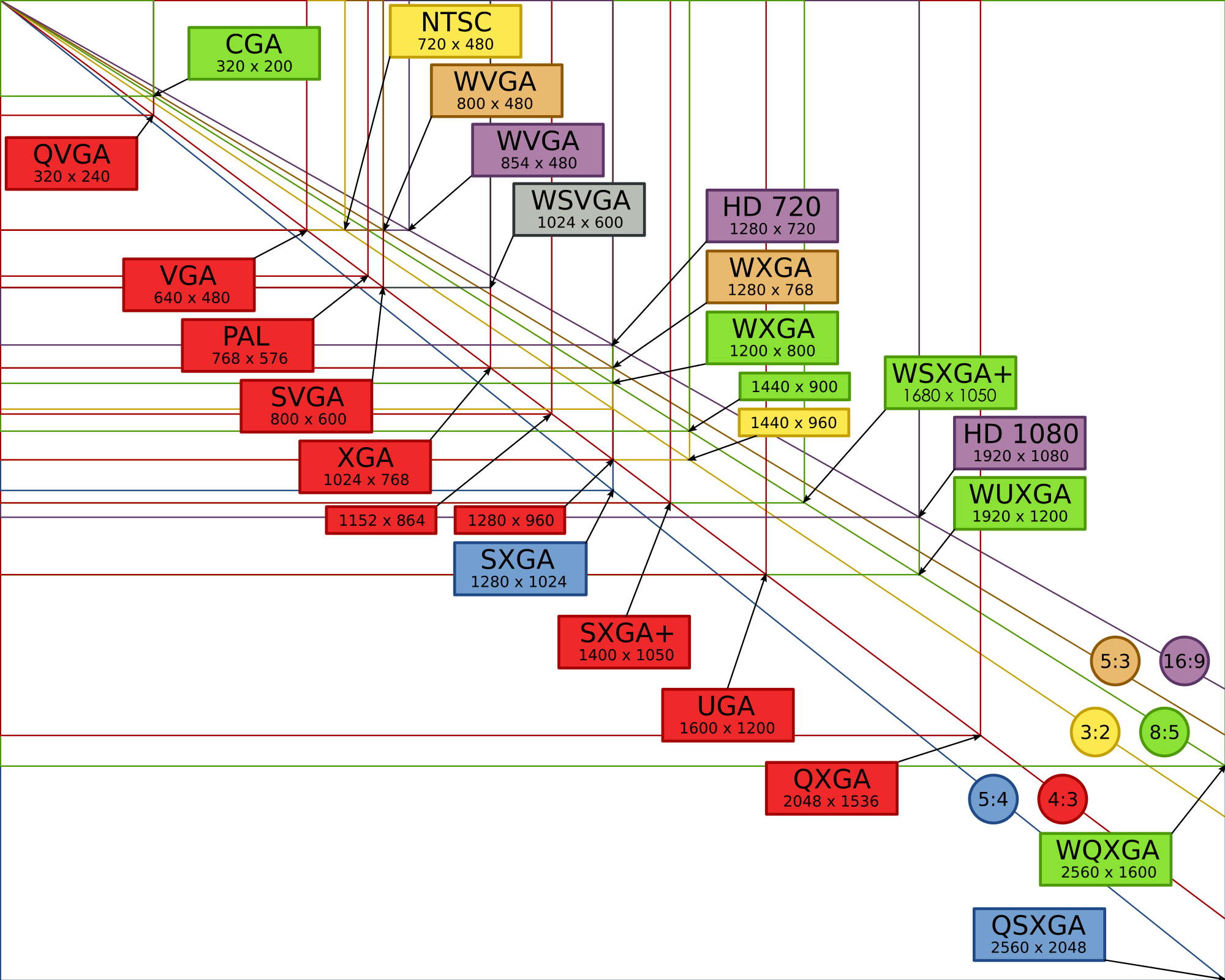

Aufgrund der Verbreitung eines Marktes mit unzähligen Formaten und Herstellern war eine spezielle Organisation erforderlich, um diese zu regulieren und Schlüsselstandards für Marktteilnehmer zu entwickeln. 1988 wurde die VESA (Video Electronics Standard Association) durch die Bemühungen von sechs Schlüsselherstellern gegründet, die die Zentralisierung von Standards und Auflösungsformaten sowie die Farbpalette von Grafikadaptern übernahmen. Das erste Format war SVGA (800 x 600 Pixel), das bereits in Ati Wonder 800-Karten verwendet wurde. Später gab es mehr davon, und einige (einschließlich HGC und HGC +) wurden jahrzehntelang verwendet.

Die technologische Führungsrolle von ATi setzte sich Anfang der neunziger Jahre fort. 1991 wurde Wonder XL in den Handel gebracht - der erste Grafikadapter mit Unterstützung für 32.000 Farben und Unterstützung für eine Auflösung von 800 x 600 bei einer Bildwiederholfrequenz von 60 Hz. Dies wurde durch den Einsatz des Sierra RAMDAC-Konverters erreicht. Darüber hinaus war Wonder XL der erste Adapter mit 1 MB integriertem Videospeicher.

Im Mai desselben Jahres stellte ATI Mach8 vor, das erste Produkt in einer neuen Mach-Linie für einfache 2D-Operationen wie Strichzeichnung, Farbfüllung und Bitmapping. Mach8 war sowohl als Chip (für die spätere Integration - zum Beispiel in Business-Systeme im OEM-Format) als auch als vollwertiges Board erhältlich. Nun, viele werden es seltsam finden, einen separaten Adapter für solche Dinge herauszubringen, aber vor 30 Jahren waren viele spezielle Berechnungen noch auf den Schultern des Zentralprozessors, während Grafikadapter für einen engen Bereich von Aufgaben gedacht waren.

Diese Vorgehensweise hielt jedoch nicht lange an - nach dem interessanten VGA-Stereo-F / X, der Symbiose aus Grafikadapter und Sound Blaster-Karte für die schnelle Emulation eines Codecs im Monoformat präsentierte der Branchenführer ein Produkt für die Arbeit mit 2D- und 3D-Grafiken. VGA Wonder GT. Durch die Kombination der Funktionen von Mach8 und Wonder Ati wurde erstmals das Problem gelöst, dass ein zusätzlicher Adapter für verschiedene Arten von Aufgaben erforderlich ist. Die Veröffentlichung des beliebten Windows 3.0-Betriebssystems, das sich erstmals auf eine Vielzahl von Aufgaben bei der Arbeit mit 2D-Grafiken konzentrierte, trug zum bedeutenden Erfolg der neuen Produkte bei. Wonder GT war bei Systemintegratoren gefragt, was sich positiv auf die Gewinne des Unternehmens auswirkte. 1991 lag der Umsatz von ATI bei über 100 Millionen US-Dollar. Die Zukunft versprach vielversprechend, aber der Wettbewerb auf dem Markt ließ nie nach - neue Herausforderungen erwarteten die Marktführer.

1992-1995. OpenGL-Entwicklung. Der zweite Boom auf dem Grafikkartenmarkt. Neue Grenzen in 2D und 3D

Im Januar 1992 stellte Silicon Graphics Inc die erste plattformübergreifende OpenGL 1.0-Programmierschnittstelle vor, die sowohl 2D- als auch 3D-Grafiken unterstützt.

Der zukünftige offene Standard basiert auf der proprietären Bibliothek IRIS GL (Integrierte Raster Imaging System Graphical Library, Integrierte Systembibliothek zur Verarbeitung von Rastergrafiken). Als SGI erkannte, dass viele Unternehmen ihre Bibliotheken dieser Art bald auf den Markt bringen werden, beschloss SGI, OpenGL zu einem offenen Standard zu machen, der mit allen Plattformen auf dem Markt kompatibel ist. Die Popularität dieses Ansatzes war schwer zu überschätzen - der gesamte Markt machte auf OpenGL aufmerksam.

Ursprünglich zielte Silicon Graphics auf den professionellen UNIX-Markt ab und plante spezifische Aufgaben für eine zukünftige offene Bibliothek. Dank seiner Verfügbarkeit für Entwickler und Enthusiasten konnte OpenGL jedoch schnell einen Platz im aufstrebenden 3D-Spielemarkt einnehmen.

Allerdings begrüßten nicht alle großen Marktteilnehmer diesen SGI-Ansatz. Etwa zur gleichen Zeit entwickelte Microsoft eine eigene Direct3D-Softwarebibliothek und hatte es nicht eilig, die OpenGL-Unterstützung in das Windows-Betriebssystem zu integrieren.

Direct3D wurde offen von dem berühmten Doom-Autor John Carmack kritisiert, der Quake persönlich auf OpenGL für Windows portierte und die Vorteile des einfachen und verständlichen Codes einer offenen Bibliothek vor dem Hintergrund einer komplexen und "Müll" -Version von Microsoft hervorhob.

John Carmack

Die Position von Microsoft blieb jedoch unverändert, und nach der Veröffentlichung von Windows 95 weigerte sich das Unternehmen, den OpenGL MCD-Treiber zu lizenzieren, wodurch der Benutzer unabhängig entscheiden konnte, über welche Bibliothek eine Anwendung oder ein neues Spiel gestartet werden soll. SGI hat eine Lücke gefunden, indem ein ICD-Treiber (Installable Client Driver) veröffentlicht wurde, der zusätzlich zur OpenGL-Rasterung Unterstützung für die Verarbeitung von Lichteffekten erhielt.

Das explosive Wachstum der Popularität von OpenGL führte dazu, dass die Lösung von SGI im Segment der Workstations populär wurde, was Microsoft dazu zwang, alle möglichen Ressourcen einzusetzen, um seine proprietäre Bibliothek in kürzester Zeit zu erstellen. Die Grundlage für die zukünftige API bildete das im Februar 1995 erworbene RenderMorphics-Studio, dessen Reality Lab-Softwarebibliothek die Grundprinzipien von Direct3D bildete.

Die Wiedergeburt des Grafikkartenmarktes. Die Welle der Fusionen und Übernahmen

Aber lassen Sie uns ein wenig in die Vergangenheit zurückkehren. 1993 erlebte der Grafikkartenmarkt eine Wiedergeburt, und die Öffentlichkeit wurde auf viele vielversprechende neue Unternehmen aufmerksam. Eine davon war NVidia, die im Januar 1993 von Jensen Huang, Curtis Prahm und Chris Malakhovsky gegründet wurde. Huang, der als Softwareentwickler bei LSI gearbeitet hat, hatte lange die Idee, eine Grafikkartenfirma zu gründen, und seine Kollegen bei Sun Microsystems haben es gerade geschafft, an der GX-Grafikarchitektur zu arbeiten. Indem sie sich zusammenschlossen und 40.000 US-Dollar sammelten, gründeten die drei Enthusiasten ein Unternehmen, das eine Schlüsselrolle in der Branche spielen sollte.

Jensen Huang

In jenen Jahren wagte es jedoch niemand, in die Zukunft zu schauen - der Markt veränderte sich rasant, fast jeden Monat tauchten neue proprietäre APIs und Technologien auf, und es war offensichtlich, dass nicht jeder im turbulenten Wettbewerbszyklus überleben würde. Viele der Unternehmen, die Ende der 1980er Jahre am Grafik-Wettrüsten teilnahmen, mussten Insolvenz anmelden - darunter Tamerack, Gemini Technology, Genoa Systems und Hualon, während Headland Technology von SPEA übernommen wurde und Acer, Motorola und Acumos Eigentum wurden Cirrus Logic.

Wie Sie vielleicht vermutet haben, hat sich ATI in diesem Cluster von Fusionen und Übernahmen hervorgetan. Die Kanadier arbeiteten weiter hart und produzierten innovative Produkte, egal was passierte - auch wenn es viel schwieriger wurde.

Im November 1993 stellte ATI die VideoIt! Video Capture Card vor! Das basiert auf dem 68890-Decoder-Chip, der ein Videosignal mit einer Auflösung von 320 x 240 bei 15 Bildern pro Sekunde oder 160 x 120 bei 30 Bildern pro Sekunde aufnehmen kann. Dank der Integration des Intel i750Pd VCP-Chips konnte der Besitzer der Neuheit das Videosignal in Echtzeit komprimieren und dekomprimieren, was besonders bei der Arbeit mit großen Datenmengen nützlich war. VideoIt! Dem ersten auf dem Markt wurde beigebracht, den zentralen Bus für die Kommunikation mit dem Grafikbeschleuniger zu verwenden, und wie zuvor waren keine Kabel und Stecker erforderlich.

ATI-Probleme und S3 Graphics-Erfolge

Für ATI war 1994 ein echter Test - aufgrund des starken Wettbewerbs musste das Unternehmen Verluste in Höhe von 4,7 Mio. USD hinnehmen. Die Hauptursache für kanadische Entwickler war der Erfolg von S3 Graphics. Der S3 Vision 968-Grafikbeschleuniger und der Trio64-Adapter haben ein Dutzend wichtige OEM-Verträge mit Marktführern wie Dell, HP und Compaq abgeschlossen. Was war der Grund für diese Popularität? Ein beispielloses Maß an Vereinheitlichung - der Trio64-Grafikchip vereinte einen Digital-Analog-Wandler (DAC), einen Frequenzsynthesizer und einen Grafikcontroller unter einer Abdeckung. Neu von S3 wurde ein gepoolter Framebuffer und unterstützte Hardware-Video-Overlays verwendet (implementiert durch Zuweisen eines Teils des Videospeichers während des Renderns).Die Vielzahl der Vorteile und das Fehlen offensichtlicher Mängel des Trio64-Chips und seines 32-Bit-Kollegen Trio32 führten dazu, dass viele Optionen für darauf basierende Partner-Boards entstanden. Diamond, ELSA, Sparkle, STB, Orchid, Hercules und Number Nine boten ihre Lösungen an. Die Variationen reichten von einfachen VirGe-basierten Adaptern für 169 US-Dollar bis zum leistungsstarken Diamond Stealth64 mit 4 MB Videospeicher für 569 US-Dollar.

Im März 1995 kehrte ATI mit einer Reihe von Innovationen mit der Einführung von Mach64, dem ersten 64-Bit-Grafikbeschleuniger auf dem Markt und dem ersten, der auf PC- und Mac-Systemen ausgeführt wird, zum großen Spiel zurück. Zusammen mit dem beliebten Trio 958 bot Mach64 hardwarebeschleunigte Videofunktionen. Mach64 eröffnete ATI den Einstieg in den professionellen Markt - die ersten Lösungen der Kanadier in diesem Bereich waren 3D Pro Turbo- und 3DProTurbo + PC2TV-Beschleuniger. Neue Artikel wurden zu einem Preis von 899 US-Dollar für bis zu 4 MB Videospeicher angeboten.

Ein weiterer wichtiger Neuling auf dem Markt für Grafikbeschleuniger ist das Technologie-Startup 3Dlabs. Die vorrangige Richtung für das junge Unternehmen war die Veröffentlichung von High-End-Grafikbeschleunigern für den professionellen Markt - Fujitsu Sapphire2SX mit 4 MB Videospeicher wurde zu einem Preis von 1600 USD angeboten, und ELSA Gloria 8 mit 8 MB Onboard-Speicher kostete in diesen Jahren unglaubliche 2600 USD. 3Dlabs haben versucht, mit dem Gaming Glint 300SX in den Markt für Massenspielgrafiken einzusteigen, aber der hohe Preis und nur 1 MB Videospeicher haben den Adapter nicht populär gemacht.

Andere Unternehmen präsentierten ihre Produkte auch dem Verbrauchermarkt. Trident, ein OEM-Anbieter von 2D-Grafiklösungen, hat den 9280-Chip vorgestellt, der alle Vorteile von Trio64 zu einem erschwinglichen Preis von 170 bis 200 US-Dollar bietet. Gleichzeitig wurden der Power Player 9130 von Weitek und der ProMotion 6410 von Alliance Semiconductor zum Verkauf angeboten, die während der Videowiedergabe eine hervorragende Laufruhe erzielten.

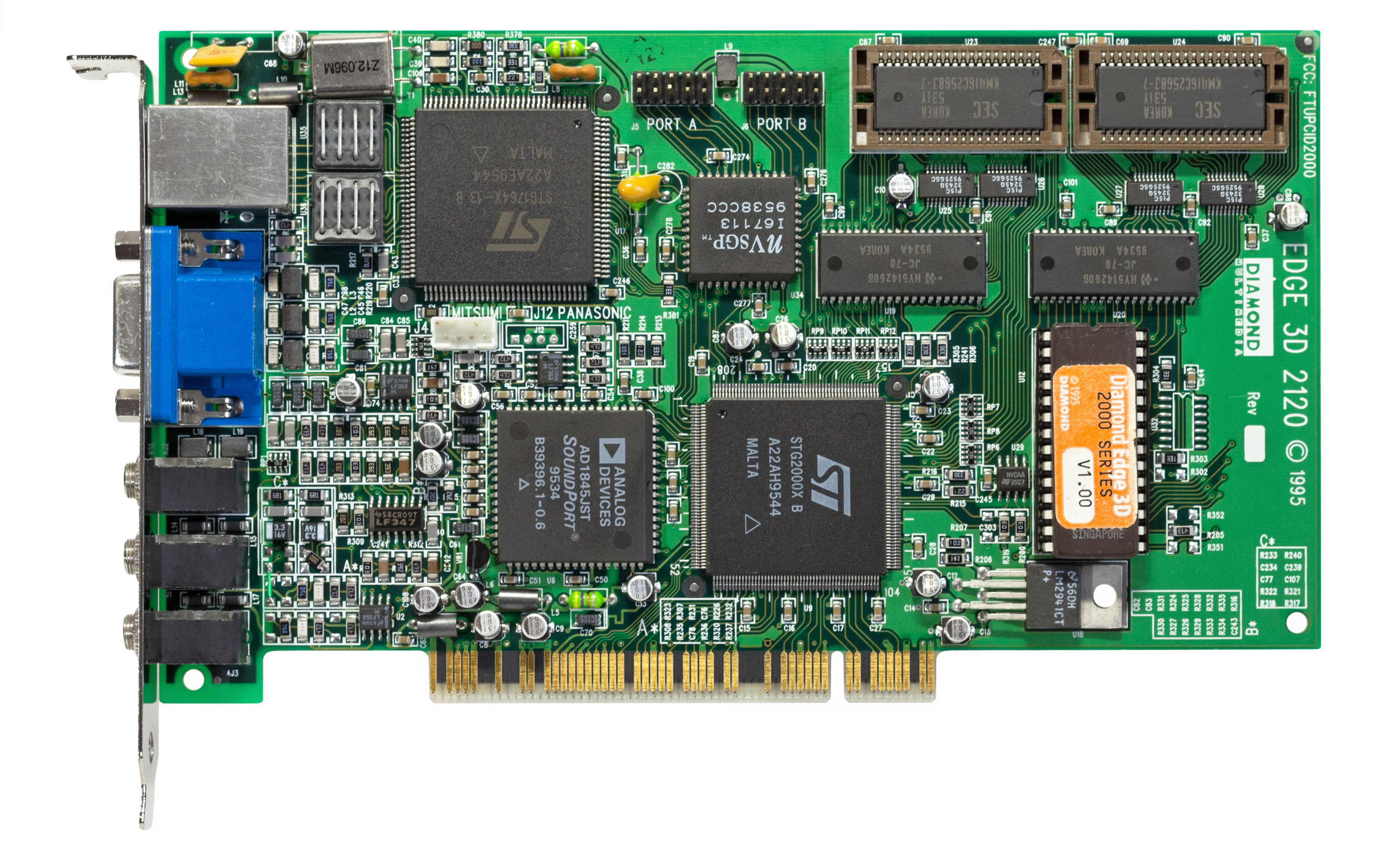

NV1 - NVidia-Debüt und Problembereiche

Im Mai 1995 schloss sich NVIDIA den Neuankömmlingen an und präsentierte seinen ersten Grafikbeschleuniger mit dem symbolischen Namen NV1. Das Produkt war das erste auf dem kommerziellen Markt, das die Funktionen von 3D-Rendering, Hardware-Videobeschleunigung und einer grafischen Oberfläche kombinierte. Der eingeschränkte kommerzielle Erfolg störte das junge Unternehmen in keiner Weise - Jen-Hsun Huang und seine Kollegen waren sich bewusst, dass es sehr schwierig sein würde, in einem Markt zu „schießen“, in dem jeden Monat neue Lösungen vorgestellt werden. Die Gewinne aus dem NV1-Verkauf reichten jedoch aus, um das Unternehmen am Leben zu erhalten und Anreize für die weitere Arbeit zu schaffen.

Diamant EDGE 3D 2120 (NV1)

ST Microelectronics war für die Herstellung von Chips auf Basis der 500-nm-Prozesstechnologie verantwortlich. Leider führte Microsoft für Nvidia wenige Monate nach der Einführung von Partnerlösungen auf NV1-Basis (z. B. Diamond Edge 3D) die erste Version der lang erwarteten DirectX 1.0-Grafik-API ein. "Schließlich!" - rief Spieler aus der ganzen Welt aus, aber die Hersteller von Grafikbeschleunigern teilten diese Begeisterung nicht.

Das Hauptmerkmal von DirectX sind dreieckige Polygone. Viele Menschen glauben fälschlicherweise, dass die berüchtigten Dreiecke immer existiert haben, aber tatsächlich ist dies eine Täuschung. Die Ingenieure von Nvidia haben in ihr erstes Produkt ein quadratisches Textur-Mapping aufgenommen (anstelle von Dreiecken-Polygonen gab es Quadrate), weshalb Anwendungen und die ersten Spiele mit DirectX-Unterstützung NV1-Besitzern viele Kompatibilitätsprobleme bereiteten. Um das Problem zu lösen, hat Nvidia einen Handler in den Treiber aufgenommen, um quadratische Texturen in dreieckige zu konvertieren. Die Leistung in diesem Format ließ jedoch zu wünschen übrig.

Die meisten Spiele mit Unterstützung für quadratische Texturzuordnungen wurden von der Sega Saturn-Konsole portiert. Nvidia hielt diese Projekte für so wichtig, dass zwei Ports der neuen Konsole auf dem 4 MB NV1-Modell platziert wurden, die über Flachbandanschlüsse mit der Karte verbunden waren. Als es in den Handel kam (September 1995), kostete das erste Produkt von Nvidia Kunden 450 US-Dollar.

Zum Zeitpunkt der Einführung der Microsoft-API waren die meisten Hersteller von Grafikbeschleunigern stark von proprietären Lösungen anderer Unternehmen abhängig. Als die Entwickler des Unternehmens von Bill Gates gerade mit der Arbeit an ihrer eigenen Grafikbibliothek begannen, gab es bereits viele APIs auf dem Markt, darunter S3d (S3), Matrox Simple Interface und Creative Grafikbibliothek, C-Schnittstelle (ATI) und SGL (PowerVR), später NVLIB (Nvidia), RRedline (Rendition) und der berühmte Glide. Diese Vielfalt hat das Leben der Entwickler der neuen Hardware erheblich erschwert, da die APIs nicht miteinander kompatibel waren und verschiedene Spiele unterschiedliche Bibliotheken unterstützten. Mit der Veröffentlichung von DirectX wurden alle Lösungen von Drittanbietern beendet, da die Verwendung anderer proprietärer APIs in Spielen für Windows einfach keinen Sinn ergab.

Wir können jedoch nicht sagen, dass das neue Produkt von Microsoft keine schwerwiegenden Mängel aufwies. Nach der Einführung des DirectX SDK haben viele Hersteller von Grafikbeschleunigern die Möglichkeit verloren, die Hardwareressourcen von Grafikkarten bei der Wiedergabe digitaler Videos zu steuern. Zahlreiche Treiberprobleme unter dem kürzlich veröffentlichten Windows 95 verärgerten Benutzer, die an den stabilen Betrieb von Windows 3.1 gewöhnt waren. Im Laufe der Zeit wurden alle Probleme gelöst, aber der Hauptkampf um den Markt lag vor uns - ATI, der eine Pause eingelegt hatte, bereitete sich darauf vor, das Universum der dreidimensionalen Spiele mit einer neuen Linie von 3D Rage zu erobern.

ATI Rage - 3D Rage

Die Demonstration des neuen Grafikbeschleunigers fand auf der Ausstellung E3 1995 in Los Angeles statt. Die ATI-Ingenieure haben die Vorteile des Mach 64-Chips (und seiner hervorragenden 2D-Grafikfunktionen) mit einem neuen 3D-Verarbeitungs-Chip kombiniert und dabei frühere Designs voll ausgenutzt. Der erste 3D-Beschleuniger ATI 3D Rage (auch als Mach 64 GT bekannt) kam im November 1995 auf den Markt.

ATI 3D Rage

Wie im Fall von Nvidia hatten die Ingenieure mit vielen Problemen zu kämpfen - die späteren Überarbeitungen von DirectX 1.0 verursachten zahlreiche Probleme, die mit dem Fehlen eines tiefen Puffers verbunden waren. Die Karte hatte nur 2 MB EDO-RAM, sodass 3D-Anwendungen und -Spiele mit einer Auflösung von nicht mehr als 640 x 480 bei 16-Bit-Farbe oder 400 x 300 bei 32-Bit-Farbe gestartet wurden, während die Bildschirmauflösung im 2D-Modus viel höher war - bis zu 1280 x 1024. Versuche, das Spiel in 32-Bit-Farben bei 640 x 480 auszuführen, führten normalerweise zu Farbartefakten auf dem Bildschirm, und die Spieleleistung von 3D Rage war nicht herausragend. Der einzige unbestreitbare Vorteil der Neuheit war die Möglichkeit, Videodateien im MPEG-Format im Vollbildmodus abzuspielen.

ATI arbeitete an Fehlern und gestaltete den Chip mit der Veröffentlichung von Rage II im September 1996 neu. Nachdem die Ingenieure die Hardwarefehler behoben und den MPEG2-Codec unterstützt hatten, dachten sie aus irgendeinem Grund nicht an die Notwendigkeit, die Speichergröße zu erhöhen. Die ersten Modelle verfügten immer noch über lächerliche 2 MB Videospeicher an Bord, was die Leistung bei der Verarbeitung von Geometrie und Perspektive zwangsläufig beeinträchtigte. Der Fehler wurde in späteren Revisionen des Adapters behoben - beispielsweise in Rage II + DVD und 3D Xpression + wuchs der Speicherpuffer auf 8 MB.

Der Krieg um den 3D-Markt hatte jedoch gerade erst begonnen, als drei neue Unternehmen ihre Produkte auf die neuesten Spiele vorbereiteten - Rendition, VideoLogic und 3dfx Interactive. Letzterem gelang es, in kürzester Zeit einen Grafikchip zu präsentieren, der alle Wettbewerber deutlich übertraf und eine neue Ära in der 3D-Grafik einleitete -3Dfx Voodoo-Grafik .

1996-1999. Die Ära von 3Dfx. Das größte Grafik-Startup aller Zeiten. Die letzte Phase des großen Wettbewerbs um den Markt

Die unglaubliche Geschichte von 3Dfx ist zu einer Lehrbuch-Verkörperung eines Startups geworden, das sowohl unglaublichen Erfolg und schwindelerregende Gewinne als auch die Inkompetenz selbstbewusster Führung und damit den Zusammenbruch und das Vergessen symbolisiert. Aber das traurige Ende und die bittere Erfahrung können das Offensichtliche nicht leugnen - 3Dfx hat im Alleingang eine Grafikrevolution geschaffen, die zahlreiche Konkurrenten überrascht und eine neue, phänomenal hohe Leistungsgrenze gesetzt hat. Weder vor noch nach dieser unglaublichen Zeit in der Geschichte der Entwicklung von Grafikkarten haben wir etwas gesehen, das dem verrückten Aufstieg von 3Dfx in der zweiten Hälfte der neunziger Jahre auch nur annähernd ähnlich ist.

3Dfx Voodoo Graphics war ein Grafikadapter, der ausschließlich für die Arbeit mit 3D-Grafiken gedacht war. Es wurde angenommen, dass der Käufer der Neuheit eine andere Platine verwendet, um mit zweidimensionalen Lasten zu arbeiten, und diese über einen zweiten VGA-Anschluss mit Voodoo verbindet.

Dieser Ansatz verwirrte nicht viele Enthusiasten, und die innovative Lösung zog sofort viele Partnerhersteller an, die ihre eigenen Voodoo-Varianten herausbrachten.

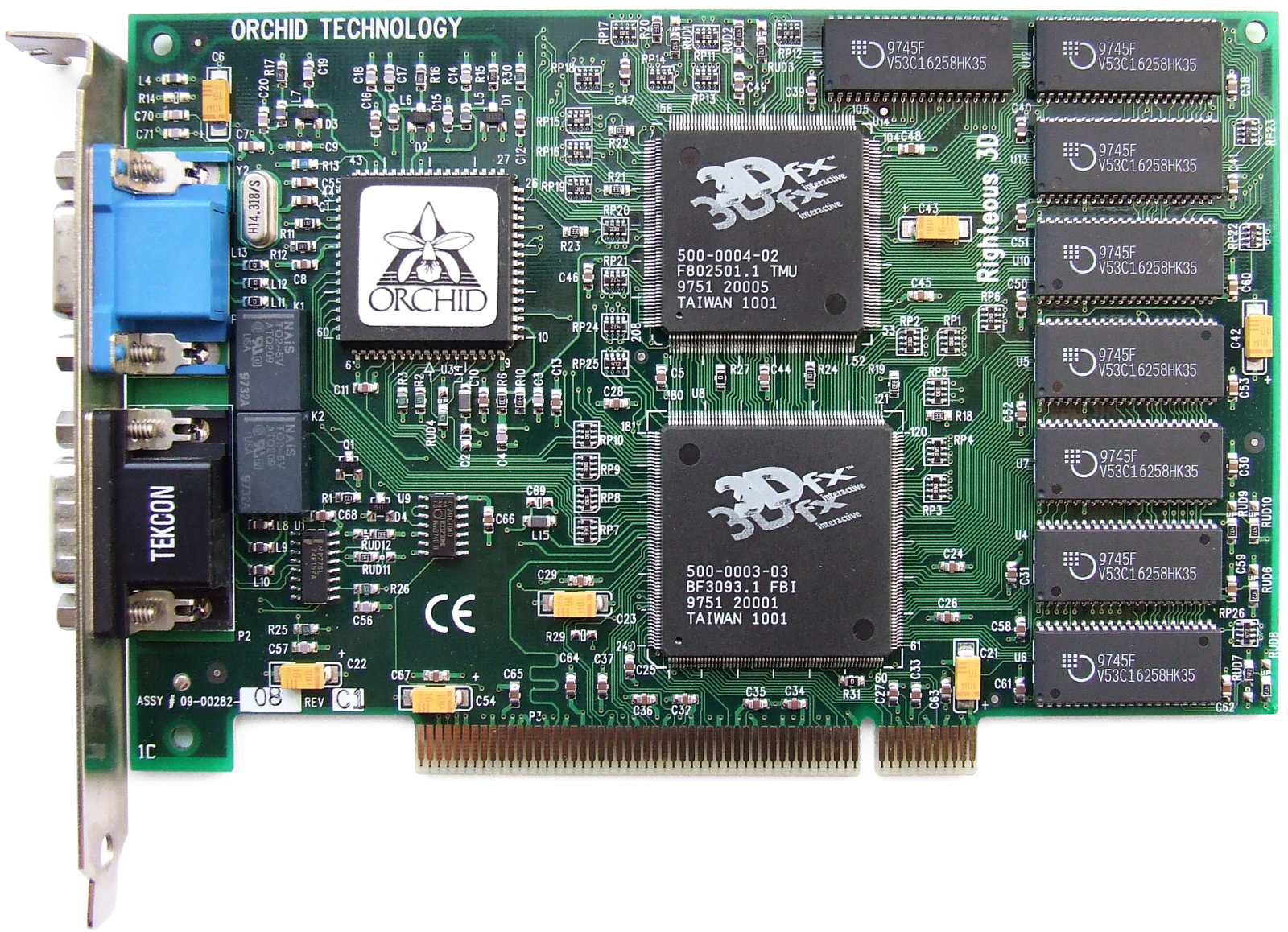

Eine der interessanten Karten, die auf dem ersten 3Dfx-Chip basierten, war Orchid Righteous 3D von Orchid Technologies. Das Markenzeichen des 299-Dollar-Adapters waren mechanische Relais, die beim Starten von 3D-Anwendungen oder -Spielen charakteristische Klicks abgeben.

Orchid Righteous 3D

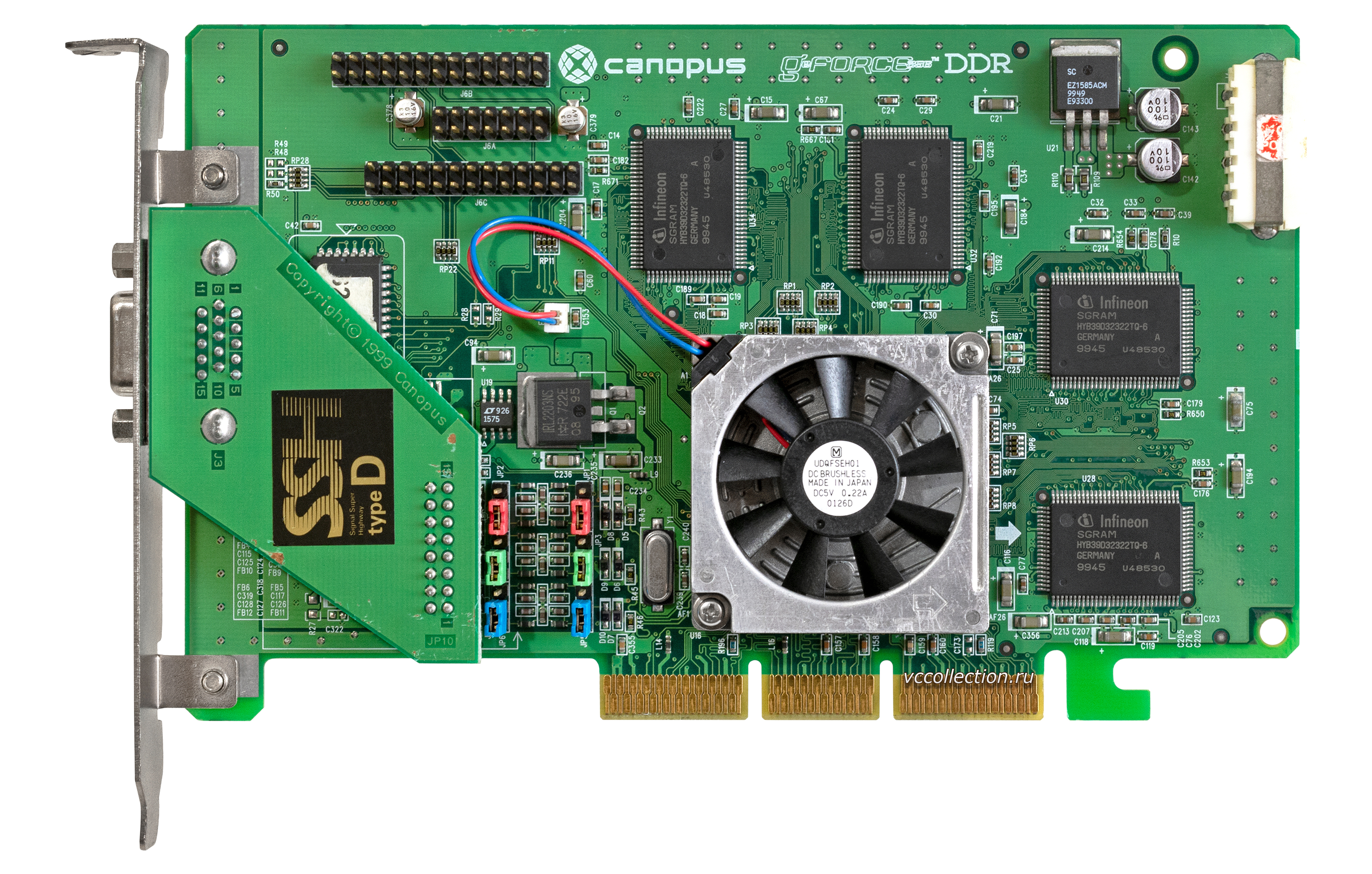

In späteren Revisionen wurden diese Relais durch Festkörperkomponenten ersetzt, und der alte Charme ging verloren. Zusammen mit Orchid, Diamond Multimedia (Monster 3D), Colormaster (Voodoo Mania), Canopus (Pure3D und Quantum3D), Miro (Hiscore), Skywell (Magic3D) und dem anspruchsvollsten einer Reihe von Titeln präsentierten 2theMAX Fantasy FX Power 3D auch ihre Versionen des neuesten Beschleunigers. ... Zuvor zögerten sie nicht, Grafikkarten zu benennen!

Die Gründe für diese Aufregung um die Neuheit waren offensichtlich - trotz aller möglichen Mängel hatte Voodoo Graphics eine unglaubliche Leistung und sein Aussehen machte viele andere Modelle sofort überflüssig - insbesondere diejenigen, die nur mit 2D-Grafiken funktionieren konnten. Trotz der Tatsache, dass 1996 mehr als die Hälfte des Marktes für 3D-Beschleuniger zu S3 gehörte, gewann 3Dfx schnell Millionen von Fans und bis Ende 1997 besaß das Unternehmen 85% des Marktes. Es war ein phänomenaler Erfolg.

Wettbewerber 3Dfx. Wiedergabe und VideoLogic

Die durchschlagenden Erfolge des gestrigen Newcomers haben die zuvor erwähnten Konkurrenten - VideoLogic und Rendition - nicht aus dem Spiel gestrichen. VideoLogic hat die TBRD-Technologie (Tiled Deferred Rendering) entwickelt, die das Vorpuffern eines Frames vor dem Z überflüssig macht. In der letzten Phase des Renderns wurden verborgene Pixel entfernt, und die Geometrieverarbeitung begann erst, nachdem Texturen, Schatten und Beleuchtung angewendet wurden. Die TBRD-Technologie arbeitete nach dem Prinzip der Aufteilung eines Rahmens in rechteckige Zellen, in denen Polygone unabhängig voneinander gerendert wurden. In diesem Fall wurden die außerhalb des sichtbaren Bereichs des Rahmens befindlichen Polygone entfernt, und das Rendern des Restes begann erst nach Berechnung der Gesamtzahl der Pixel. Dieser Ansatz ermöglichte es, eine Menge Rechenressourcen in der Phase des Frame-Renderings einzusparen.Deutliche Verbesserung der Gesamtleistung.

Das Unternehmen hat drei Generationen von Grafikchips von NEC und ST Micro auf den Markt gebracht. Die erste Generation war ein exklusives Produkt auf Compaq Presario-Computern namens Midas 3 (Midas 1 und 2 waren Prototypen, die in Arcade-Automaten verwendet wurden). Die später veröffentlichten PSX1 und PSX2 waren auf den OEM-Markt ausgerichtet.

Die Chips der zweiten Generation bildeten die Grundlage für den Sega Dreamcast, die japanische Plattform, die eine Rolle im traurigen Schicksal von 3Dfx spielte. Gleichzeitig hatte VideoLogic keine Zeit, in den Verbrauchermarkt für Grafikkarten einzusteigen. Zum Zeitpunkt der Premiere war das Neon 250-Modell moralisch veraltet und verlor gegen alle Budgetlösungen. Dies ist nicht überraschend, da die Neuheit erst 1999 in die Regale kam.

Rendition zeichnete sich auch durch Grafikinnovationen aus und schuf den ersten Vérité 1000-Grafikchip, der dank des Prozessorkerns in der RISC-Architektur sowie der Verwendung von Pixel-Pipelines nicht nur mit 2D-, sondern auch mit 3D-Grafiken gleichzeitig arbeiten kann. Der Verarbeiter war für die Verarbeitung der Polygone und den Mechanismus der Rendering-Pipelines verantwortlich.

Microsoft war an diesem Ansatz zum Erstellen und Verarbeiten von Bildern interessiert - das Unternehmen verwendete Vérité 1000 während der Entwicklung von DirectX, aber der Beschleuniger hatte seine eigenen architektonischen Mängel. Beispielsweise funktionierte es nur auf Motherboards mit Unterstützung der DMA-Technologie (Direct Memory Access), die Daten über den PCI-Bus übertragen. Aufgrund seiner Billigkeit und einer Vielzahl von Softwarevorteilen, einschließlich Anti-Aliasing und Hardwarebeschleunigung in Quake von id Software, war die Karte bis zur Veröffentlichung von Voodoo Graphics beliebt. Das neue Produkt von 3Dfx erwies sich als mehr als doppelt so produktiv, und die DMA-Technologie verlor schnell ihre Popularität bei Spieleentwicklern und schickte den einst vielversprechenden V1000 in den Mülleimer der Geschichte.

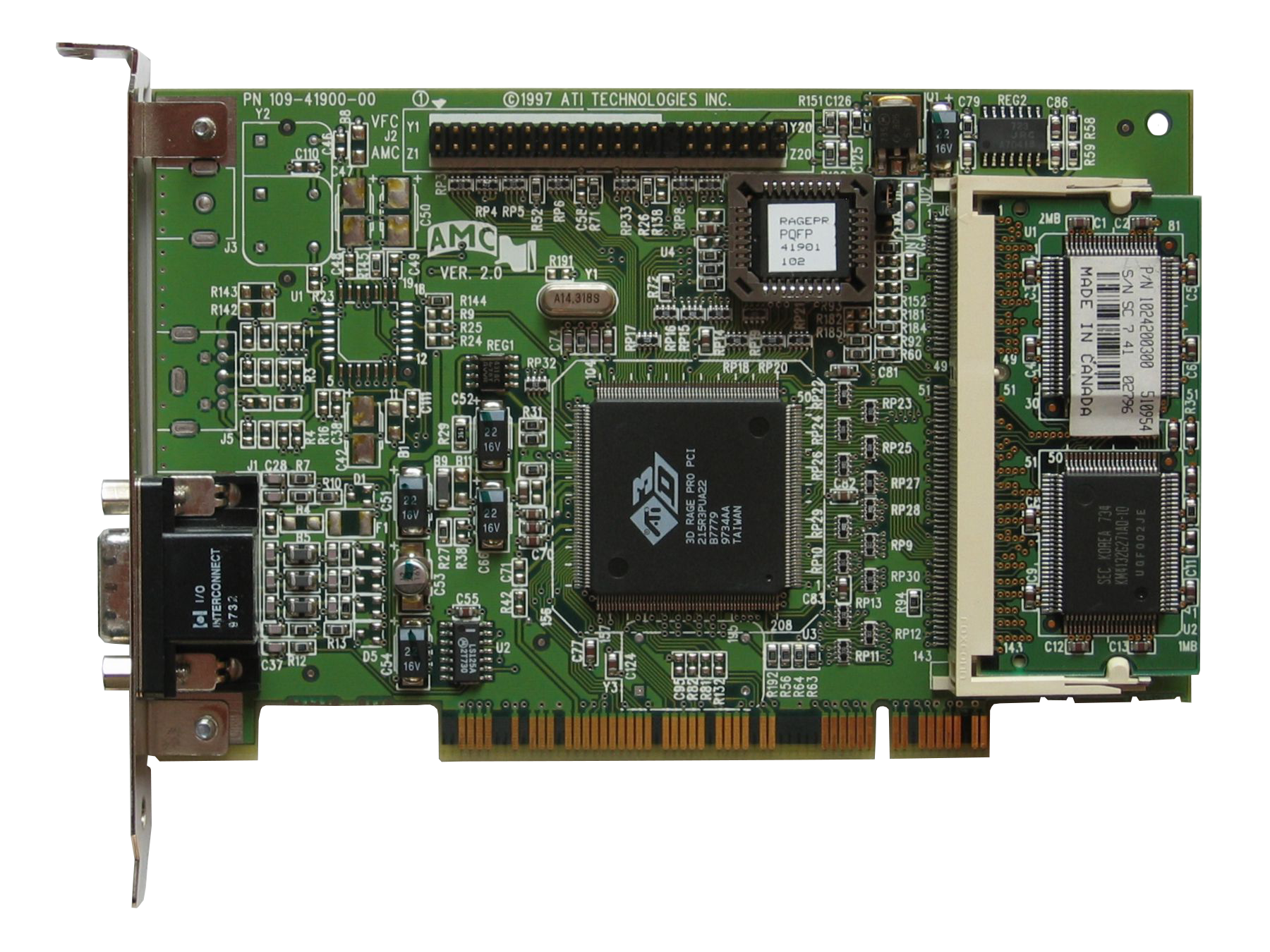

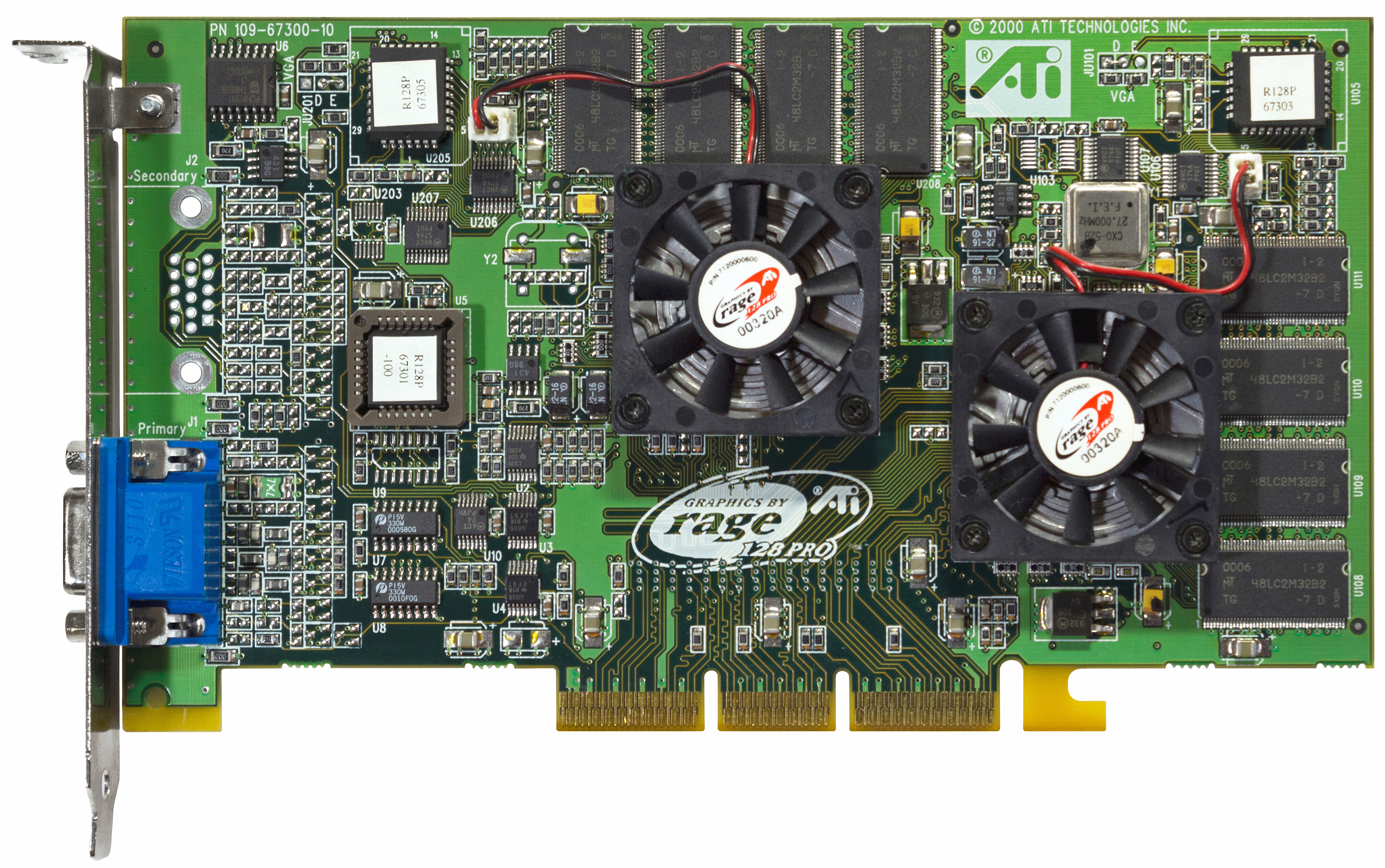

ATI - Rennen um Voodoo mit Rage II und Rage Pro

In der Zwischenzeit hat ATI nicht aufgehört, an neuen Revisionen von Rage zu arbeiten. Nach der Rage II im März 1997 wurde die Rage Pro vorgestellt - die erste AGP-Grafikkarte der ATI 3D Engineering Group, die am Vortag gegründet wurde.

Rage Pro mit 4 MB Videospeicher an Bord entsprach praktisch der Leistung des legendären Voodoo, und die Version auf dem AGP-Bus mit 8 MB Videospeicher übertraf in einigen Spielen sogar den berühmten Konkurrenten. In der Pro-Version der Karte haben die ATI-Ingenieure die Perspektivkorrektur und Texturverarbeitung verbessert und dank des vergrößerten Cache von 4 KB Unterstützung für Hardware-Anti-Aliasing und trilineare Filterung hinzugefügt. Um die Abhängigkeit der Leistung des Adapters vom Zentralprozessor im Computer zu verringern, wurde ein separater Chip zur Verarbeitung von Gleitkommaoperationen auf die Platine gelötet. Fans moderner Multimedia-Anwendungen schätzten die Unterstützung der Hardwarebeschleunigung beim Abspielen von Videos von DVD-Medien.

Mit Rage Pro konnte ATI seine Finanzen verbessern und seinen Nettogewinn bei einem Gesamtumsatz von mehr als 600 Millionen US-Dollar auf 47,7 Millionen US-Dollar steigern. Der größte Teil des finanziellen Erfolgs des Produkts resultierte aus OEM-Verträgen, der Implementierung des Grafikchips auf Motherboards und der Veröffentlichung einer mobilen Variante. Die Karte, die häufig in den Varianten Xpert @ Work und Xpert @ Play angeboten wurde, hatte viele Konfigurationen von 2 bis 16 MB Videospeicher für unterschiedliche Anforderungen und Marktsegmente.

Ein wichtiger strategischer Vorteil für die Mitarbeiter von ATI war die Übernahme von Tseng Labs im Wert von 3 Millionen US-Dollar, die an Technologien zur Integration von RAMDAC-Chips in Grafikkarten arbeiteten. Das Unternehmen entwickelte einen eigenen Grafikadapter, hatte jedoch technische Probleme, die zu einem Gegenangebot der kanadischen Marktführer führten. Neben dem geistigen Eigentum wurden 40 hochkarätige Ingenieure an die Mitarbeiter von ATI übertragen und begannen sofort mit der Arbeit.

Neue Wettbewerber. Permedia und RIVA 128

Profis von 3DLabs gaben nie die Hoffnung auf, die Interessen von Spielern zu erfassen. Zu diesem Zweck wurde eine Reihe von Permedia-Produkten veröffentlicht, die unter Verwendung der 350-nm-Prozesstechnologie von Texas Instruments hergestellt wurden. Das ursprüngliche Permedia hatte eine relativ schlechte Leistung, die in Permedia NT behoben wurde. Die neue Karte hatte einen separaten Delta-Chip für die Verarbeitung von Polygonen und einen Anti-Aliasing-Algorithmus, war aber gleichzeitig teuer - bis zu 600 US-Dollar. Als die aktualisierte Permedia 2-Linie Ende 1997 fertig war, konnte sie nicht mehr mit Spieleprodukten konkurrieren. 3DLabs änderte das Marketing und präsentierte neue Artikel als professionelle Karten für die Arbeit mit 2D-Anwendungen und eingeschränkte 3D-Unterstützung.

Nur einen Monat nach den neuesten 3DLabs- und ATI-Premieren ist Nvidia mit seinem RIVA 128, einem wettbewerbsintensiven Gaming-Portemonnaie, wieder auf dem Markt. Der erschwingliche Preis und die hervorragende Leistung von Direct3D stellten die universelle Anerkennung und den kommerziellen Erfolg des neuen Produkts sicher und ermöglichten es dem Unternehmen, einen Vertrag mit TSMC über die Herstellung von Chips für den aktualisierten RIVA 128ZX abzuschließen. Bis Ende 1997 brachten zwei erfolgreiche Grafikkarten Jensen Huang 24% des Marktes ein - fast alles, was der allmächtige 3Dfx nicht zu vernichten hatte.

Ironischerweise kreuzten sich die Wege zwischen Nvidia und dem Marktführer bereits, als Sega, der sich auf die Entwicklung der neuen Dreamcast-Konsole vorbereitete, mehrere Vorverträge mit Herstellern von Grafiklösungen abschloss. Unter ihnen waren Nvidia (mit dem NV2-Chip-Design) und 3Dfx (mit dem Blackbelt-Prototyp). Das 3Dfx-Management war völlig zuversichtlich, den Auftrag zu erhalten, wurde jedoch zu ihrer Überraschung abgelehnt - die Japaner gingen kein Risiko ein und wandten sich für die Entwicklung an NEC, die sich zuvor als Zusammenarbeit mit Nintendo erwiesen hatte. Vertreter von 3Dfx reichten eine Klage gegen Sega ein und beschuldigten das Unternehmen, im Zuge der Arbeiten am Prototyp proprietäre Entwicklungen unterschlagen zu wollen - ein langer Rechtsstreit endete 1998 mit der Zahlung einer Entschädigung in Höhe von 10,5 Millionen US-Dollar zugunsten des amerikanischen Unternehmens.

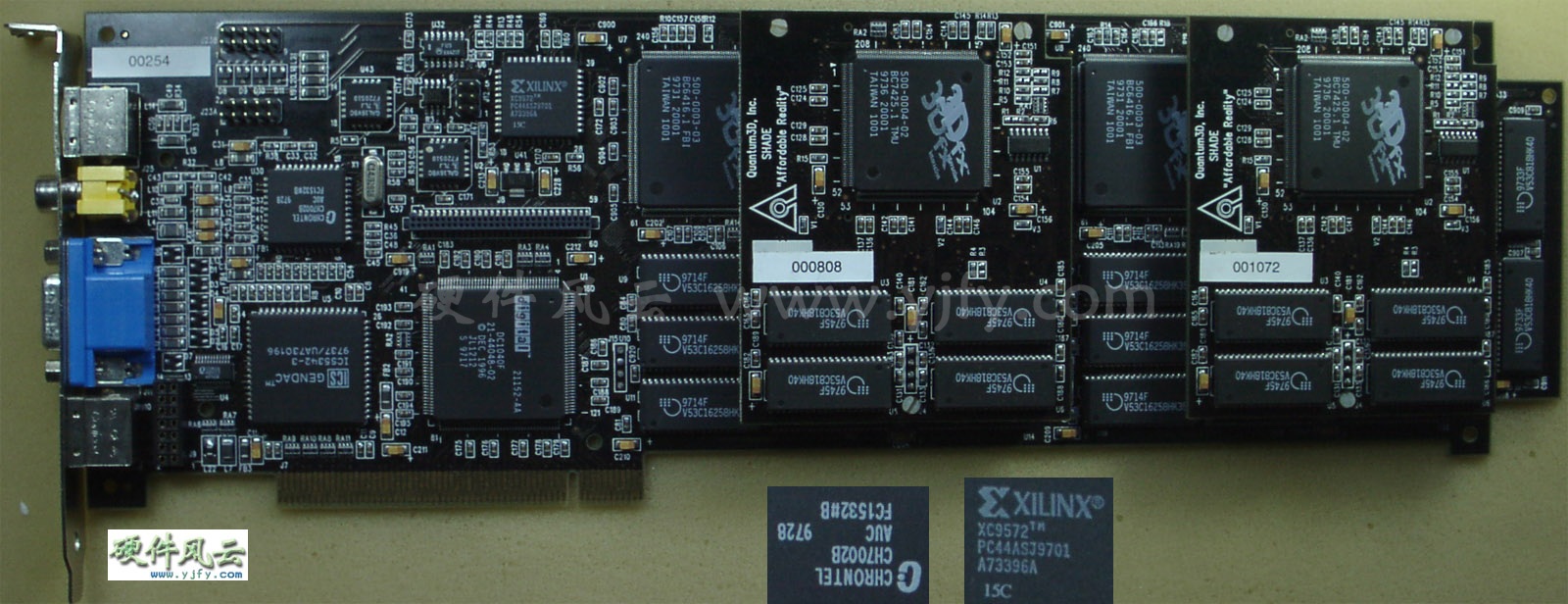

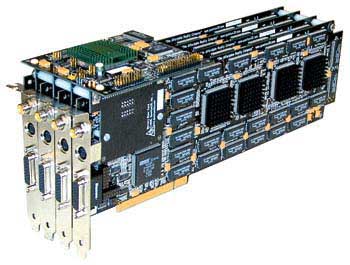

Quantum3D und die erste Verwendung von SLI

In der Zwischenzeit gelang es 3Dfx, eine Tochtergesellschaft zu erwerben. Sie war Quantum3D, die von SGI und Gemini Technology mehrere lukrative Aufträge für die Entwicklung professioneller Grafiklösungen auf höchstem Niveau erhielt. Die zukünftigen Produkte basierten auf der innovativen Entwicklung der 3Dfx-SLI - Technologie (Scan-Line Interleave) .

Die Technologie ging davon aus, dass zwei Grafikchips (jeder mit eigenem Speichercontroller und Puffer) auf einer Karte verwendet oder zwei separate Karten mit einem speziellen Flachbandkabel verbunden werden können. Ähnlich verbundene Karten (im Format einer Dual-Chip-Karte oder zweier separater Karten) teilten die Bildverarbeitung in zwei Hälften. Die SLI-Technologie ermöglichte die Erhöhung der Bildschirmauflösung von 800 x 600 auf 1024 x 768 Pixel. Ein solcher Luxus war jedoch nicht billig: Der Obsidian Pro 100DB-4440 (zwei gepaarte Karten mit Amethyst-Chips) wurde zu einem Preis von 2500 US-Dollar angeboten, während die 100-Chip-4440 / 4440V-Doppelchip-Karte den Käufer gekostet hätte bei 1895 $.

Obsidian Pro 100DB-4440

Spezialisierte Lösungen haben die Marktführer jedoch nicht von der Entwicklung neuer Voodoo-Karten abgelenkt.

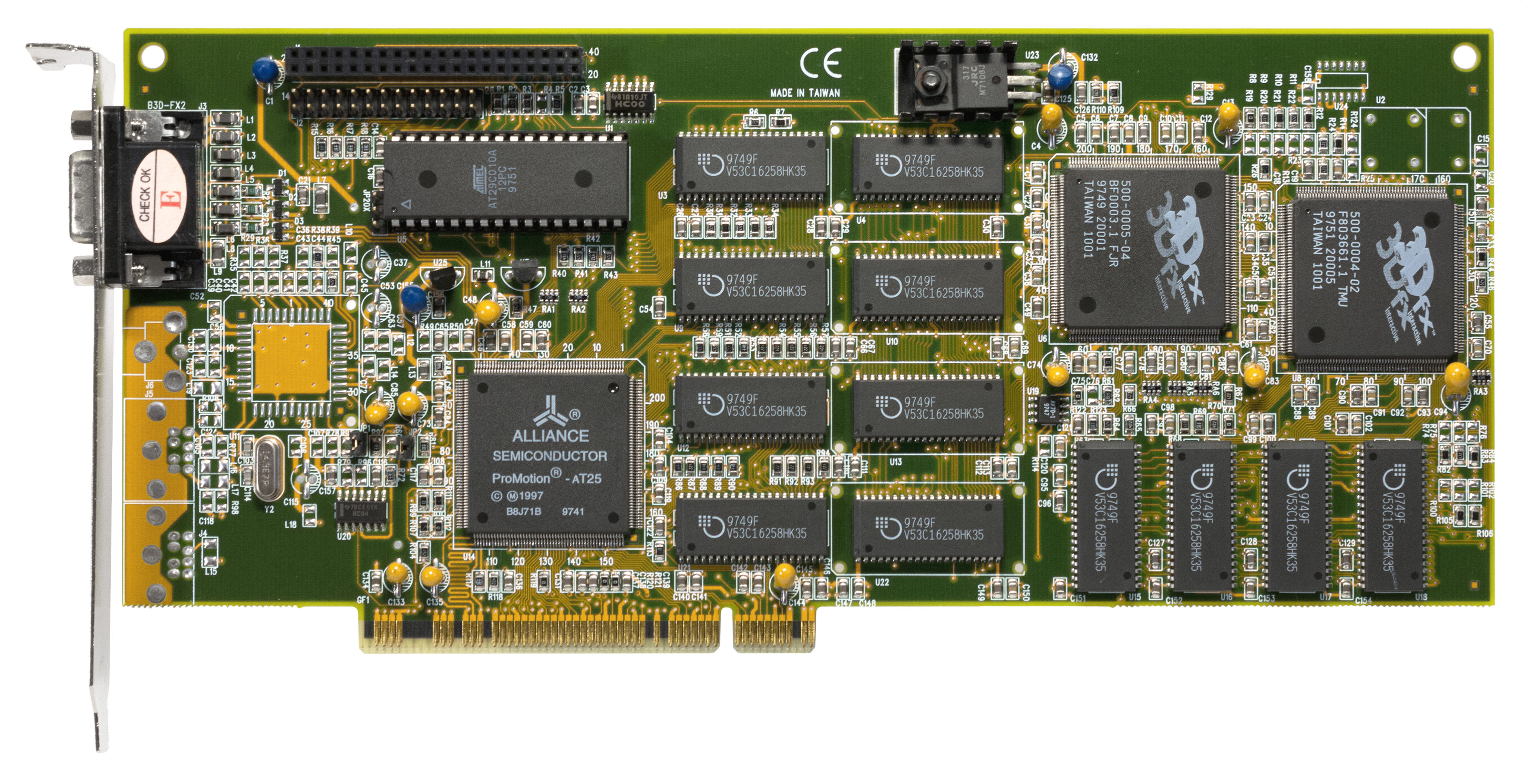

3Dfx Voodoo Rush. Eile, Budget und Frustration

Im Sommer 1997 ging 3Dfx an die Börse und versuchte, auf dem überwältigenden Erfolg von Voodoo aufzubauen, indem Voodoo Rush veröffentlicht wurde, eine Karte, die gleichzeitig mit 2D- und 3D-Grafiken funktioniert und keinen zweiten Adapter mehr benötigt. Ursprünglich sollte es auf dem neuen Rampage-Chip basieren, aber aufgrund technischer Probleme wurde die Veröffentlichung verzögert, und Rush basierte auf einer abgespeckten Version des ursprünglichen Voodoo. Um den beiden Arten von Grafik-Workloads gerecht zu werden, befanden sich auf dem Board zwei Chips - der SST-1 war für die Verarbeitung von 3D-Spielen mithilfe der Glide-API verantwortlich, während der mittelmäßigere Chip von Alliance oder Macronix für andere 2D- und 3D-Anwendungen und -Spiele verantwortlich war. Aufgrund der Desynchronisation arbeiteten die Chips bei verschiedenen Frequenzen (50 und 72 MHz), was zu zufälligen Artefakten auf dem Bildschirm und Verwirrung bei den Besitzern führte.

Voodoo-Ansturm

Darüber hinaus verfügte Voodoo Rush über einen gemeinsamen Videospeicherpuffer, den beide Chips gleichzeitig verwendeten. Die maximale Bildschirmauflösung litt darunter - sie betrug nur die Hälfte von 1024 x 768 (512 x 384 Pixel), und niedrige RAMDAC-Frequenzen ermöglichten nicht die Bereitstellung der gewünschten 60 Hz bei der Bildschirmaktualisierung.

Wiedergabe V2100 und V2200. Den Markt verlassen

Inmitten großer Probleme mit 3Dfx hat Rendition einen weiteren Versuch unternommen, den Massenmarkt mit den Rendition V2100 und V2200 angenehm zu überraschen. Die Neuheiten kamen kurz nach der Premiere von Voodoo Rush auf den Markt, aber zur Enttäuschung der Enthusiasten konnten sie nicht einmal mit dem abgespeckten Voodoo mithalten. Nicht beanspruchte Grafikkarten zwangen Rendition, als erster von vielen den Grafikkartenmarkt zu verlassen.

Infolgedessen befanden sich viele Projekte des Unternehmens noch im Prototypenstadium - eines davon war eine modifizierte Version des V2100 / V2200 mit einem geometrischen Fujitsu FXG-1-Prozessor (im Dual-Chip-Format). Es gab jedoch auch eine Single-Chip-Variante mit FXG-1, die als Produkt mit dem exquisitesten Namen in der Geschichte in die Geschichte einging - Hercules Thrilled Conspiracy. Zusammen mit anderen Entwicklungen (zum Beispiel den Chips V3300 und 4400E) wurde das Unternehmen im September 1998 für 93 Millionen US-Dollar an Micron verkauft.

Aggressive Wirtschaft. Kampf um das Budgetsegment

Das ständige Produktivitätswachstum und das Aufkommen neuer technischer Vorteile machten es für Hersteller der zweiten Klasse äußerst schwierig, mit Lösungen von ATI, Nvidia und 3Dfx zu konkurrieren, die nicht nur die Nische von Enthusiasten und Profis besetzten, sondern auch das „beliebte“ Segment des Adaptermarktes unter 200 US-Dollar.

Matrox stellte seine Mistique-Grafikkarte zu einem leckeren Preis von 120 bis 150 US-Dollar vor. Aufgrund des Mangels an OpenGL-Unterstützung fiel das neue Produkt jedoch sofort in die Kategorie der Außenseiter. S3 begann mit dem Verkauf der neuen ViRGE-Linie mit der größtmöglichen Reichweite - der mobilen Version des Adapters mit dynamischer Energieverwaltung (ViGRE / MX) und einer speziellen Version des Haupt-ViRGE mit Unterstützung für TV-Ausgang, S-Video-Anschluss und DVD-Wiedergabe (ViRGE) / GX2). Zwei Hauptadapter für den Budgetmarkt (ViRGE-, VIRGE DX- und ViRGE GX-Modelle) kosten zum Zeitpunkt der Veröffentlichung zwischen 120 USD für den jüngeren und 200 USD für den älteren.

Es ist schwer vorstellbar, aber die Ultra-Budget-Kategorie war auch ein Ort des harten Wettbewerbs. Laguna3D von CirrusLogic, die Modelle 9750/9850 von Trident und SiS 6326 konkurrierten um Geldbörsen von Benutzern, die bereit waren, nicht mehr als 99 US-Dollar für einen Grafikbeschleuniger zu zahlen. Alle diese Karten waren Kompromisslösungen mit einem Minimum an Funktionen.

Nach der Veröffentlichung von Laguna3D verließ CirrusLogic den Markt - 3D-Grafiken von geringer Qualität, mittelmäßige (und inkonsistente) Leistung sowie viel interessantere Konkurrenten (dieselbe ViRGE, die etwas mehr kostete) ließen den Branchenveteranen keine Überlebenschance. Die einzigen Einnahmequellen für CirrusLogic waren der Verkauf von antidiluvianischen 16-Bit-Grafikkarten für 50 US-Dollar, die nur für die wirtschaftlichsten Kunden interessant waren.

Trident sah auch Potenzial im „unterdurchschnittlichen“ Marktsegment - im Mai 1997 wurde das 3D Image 9750 veröffentlicht, und wenig später kam die 9850 mit Unterstützung für einen zweikanaligen AGP-Bus heraus. Nachdem viele der PCI-Bus-Probleme des 9750 behoben waren, litt der 9850 unter einer mittelmäßigen Texturverarbeitung und erhielt wenig Lob.

Unter den Karten, die für so gut wie nichts verkauft wurden, war die SiS 6326, die im Juni 1997 für unter 50 US-Dollar eingeführt wurde, die erfolgreichste. Mit guter Bildqualität und relativ hoher Leistung verkaufte sich der 6326 1998 über 8 Millionen Mal. In den späten 1990er Jahren wurde die Welt der Enthusiasten von einem Startup voller ernsthafter Versprechen erschüttert - BitBoys.

BitBoys - Wagemutige Jungs in einer fabelhaften 3D-Welt

BitBoys kündigte sich im Juni 1997 mit der Ankündigung des faszinierenden Pyramid3D-Projekts an. Der revolutionäre Grafikchip wurde vom Startup selbst gemeinsam mit Silicon VLSI Solutions Oy und TriTech entwickelt. Unglücklicherweise für Enthusiasten, abgesehen von lauten Worten bei den Präsentationen von Pyramid3D, erschien es nirgendwo und TriTech wurde verurteilt, das Patent eines anderen für einen Audio-Chip zu übernehmen, weshalb es später bankrott ging und geschlossen wurde.

Aber BitBoys hörte nicht auf zu arbeiten und kündigte ein zweites Projekt namens Glaze3D an. Unglaublicher Realismus, erstklassige Leistung und eine Vielzahl der neuesten Technologien wurden der Öffentlichkeit auf der SIGGRAPH99 gezeigt. Der funktionierende Prototyp des Grafikadapters verwendete den RAMBUS und 9 MB Videospeicher-DRAM von Infineon.

Leider führten Hardwareprobleme und Übertragungen wie beim ersten Mal dazu, dass die erwartete Revolution nicht wiederkam.

Ein Werbe-Screenshot, der den Realismus hervorheben soll, den Glaze3D-Karten erreichen sollten.

Viel später wurde das Projekt in Axe umbenannt, und Spiele mit DirectX 8.1-Unterstützung wurden als Wettbewerbsfeld ausgewählt. Der Prototyp erhielt sogar den offiziellen Namen Avalanche3D und versprach, den Markt 2001 zu "sprengen", aber nicht Es passierte. In der letzten Entwicklungsphase wechselte Ax zu Hammer, dem die Unterstützung von DirectX 9.0 versprochen wurde. Die Geschichte des anspruchsvollsten Langzeitbaus in der Geschichte der Grafik endete mit der Insolvenz von Infineon. Danach gab BitBoys das "Traumprojekt" auf und wechselte in das Segment der mobilen Grafik. Gehen wir jetzt zurück zum gemütlichen 1998.

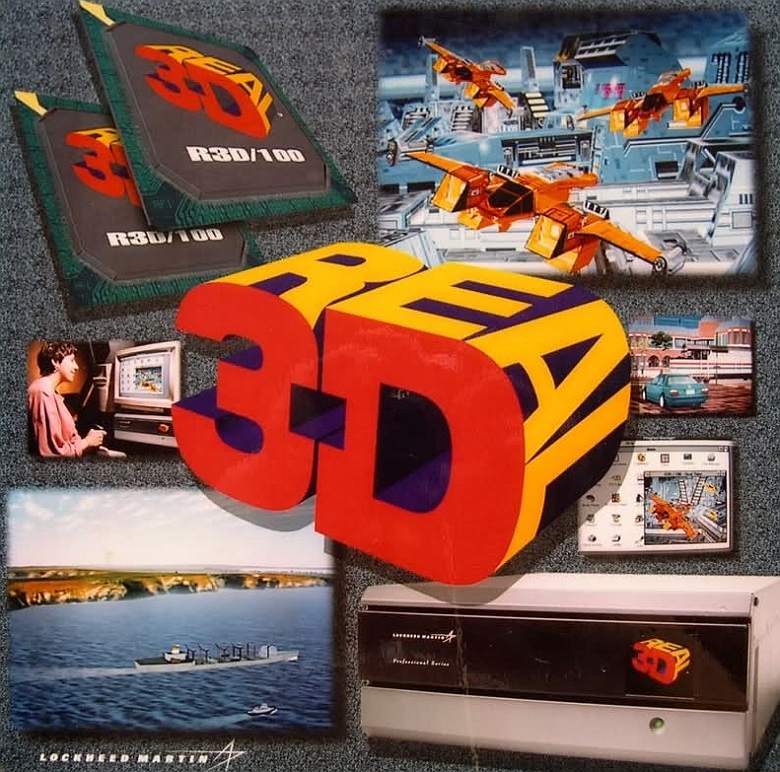

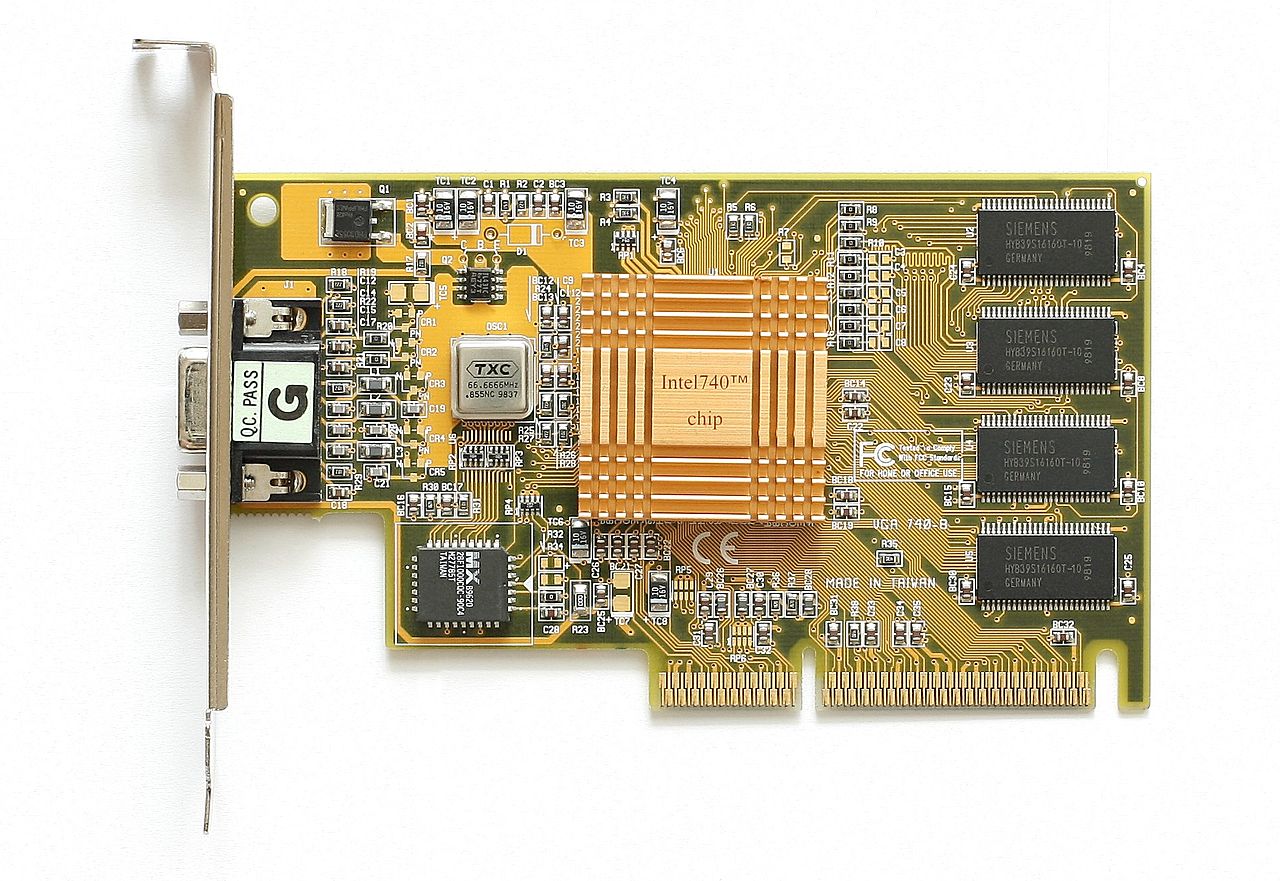

Intel i740 - Großer Misserfolg großer Profis

Intel veröffentlichte im Januar 1998 seine erste (und bislang letzte) Grafikkarte für 3D-Spiele mit dem Namen Intel i740. Das Projekt hatte eine interessante Geschichte, da es in einem Raumfahrtsimulationsprogramm verwurzelt war, das die NASA und General Electric für die berühmte Apollo-Serie von Mondmissionen erstellt hatten. Später wurden die Entwicklungen an Martin Marietta verkauft, eine Firma, die später Teil des Verteidigungsgiganten Lockheed wurde (und so erschien Lockheed-Martin). Lockheed-Martin hat auf der Grundlage des Projekts eine Reihe professioneller Read3D-Geräte entwickelt, die aus zwei Modellen von Grafikadaptern bestehen - Real3D / 100 und Real3D / Pro-1000. Ironischerweise ist trotz der militärischen Herkunft der Geräte eine der Anwendungen herausragender Technologien zu einem Sega-Arcade-Automaten mit zwei Pro-1000-Boards geworden.

Wenig später gab Lockheed-Martin den Start von Project Aurora bekannt, einer Zusammenarbeit mit Intel und Chips and Technologies. Einen Monat vor der Veröffentlichung des i740 erwarb Intel 20% des Real3D-Projekts und bis Juli 1997 vollständig Chips und Technologien.

Ein wesentliches Merkmal des Real3D-Projekts war die Verwendung von zwei separaten Chips für die Verarbeitung von Texturen und Grafiken. Intel kombinierte sie, um den i740 zu erstellen. Der Adapter verwendete einen ursprünglichen Ansatz zur Datenpufferung - der Inhalt des Bildpuffers und der Texturen wurden über den AGP-Bus direkt in den RAM des Computers geladen. In den Partnerversionen des i740 erfolgte der Zugriff auf den RAM nur, wenn der eigene Puffer des Adapters vollständig gefüllt oder stark segmentiert war. Der gleiche Ansatz wird heutzutage häufig verwendet: Wenn der Speicher an Bord der Grafikkarte erschöpft ist, erhöht das System den Puffer mithilfe von freiem RAM.

Aber zu einer Zeit, in der Puffer in Megabyte gezählt wurden und Texturen noch nicht auf obszöne Größen aufgebläht waren, mag dieser Ansatz zumindest seltsam erscheinen.

Um mögliche Latenzen bei der Arbeit mit dem Bus zu verringern, verwendete Intel eine seiner Funktionen - den direkten Zugriff auf den Speicherpuffer (Direct Memory Execute oder DiME). Diese Methode wurde auch als AGP-Texturierung bezeichnet und ermöglichte die Verwendung des RAM des Computers zum Zuordnen von Texturen und zum selektiven Verarbeiten. Die durchschnittliche Leistung in Verbindung mit einer mittelmäßigen Bildqualität ermöglichte es dem i740, das Niveau der Karten des letzten Jahres in seinem Preissegment zu erreichen.

Für das Modell mit 4 MB Videospeicher wurden 119 US-Dollar verlangt, und die Version mit 8 MB kostete 149 US-Dollar. Gleichzeitig erblickten neben der Basisversion von Intel nur zwei Partnerversionen das Licht - Real3D StarFighter und Diamond Stealth II G450.

Intel setzte auf den Erfolg und begann mit der Entwicklung des nächsten i752-Chips. Weder OEMs noch Enthusiasten zeigten Interesse an einem Budgetadapter, der den aktuellen Lösungen ernsthaft hinterherhinkt. Und das ist nicht verwunderlich, denn gleichzeitig wurde ViRGE von S3 zum Verkauf angeboten, dessen Kauf dem Benutzer viel mehr gefallen würde. Die Adapterproduktion wurde eingestellt und die auf den Markt gebrachten i752-Chips wurden für die Verwendung als integrierte Grafiklösungen umfunktioniert.

Im Oktober 1999 eliminierte Lockheed-Martin Real3D und die wohlhabenden Mitarbeiter gingen zu Intel und ATI.

ATI - Zurück im Spiel mit Rage Pro und Rage 128

ATI hat sich im Februar 1998 mit dem Rage Pro Turbo wieder etabliert, aber diese Karte erwies sich als nur eine Umbenennung des Rage Turbo mit Treiber-Optimierungen für herausragende Ergebnisse in synthetischen Texten. Die Rezensenten einiger Veröffentlichungen waren angenehm überrascht, aber der Preis von 449 US-Dollar war sehr schwer zu rechtfertigen. Mit dem Rage Pro Turbo trat jedoch erstmals das Finewine-Phänomen auf - die Treiber verbesserten die Leistung des Adapters mit jeder neuen Version schrittweise.

Mit der Veröffentlichung des Rage 128 GL und des Rage 128 VR im August desselben Jahres unternahm ATI einen viel ernsthafteren Versuch, das Kräfteverhältnis zu beeinflussen. Aufgrund von Lieferproblemen konnte ATI die Verfügbarkeit von Modellen in den Läden fast bis zu den Winterferien nicht sicherstellen, was die Werbung für neue Produkte stark beeinträchtigte. Im Gegensatz zu OEM-Verträgen, die den Kanadiern durchweg ernsthafte Gewinne bringen, konnten gewöhnliche Enthusiasten das neue Produkt aufgrund des Mangels an Adaptern auf dem Markt nicht schätzen. Aber es gab noch einen anderen Grund, warum die Verkäufe des Rage 128 niedriger waren als erwartet.

ATI bereitete den Rage 128 auf eine glänzende Grafikzukunft vor, indem es das neue Produkt mit 32 MB Videospeicher ausstattete (Versionen mit 16 MB wurden unter der Marke All-In-Wonder 128 hergestellt), der auf einem schnellen und effizienten Subsystem arbeitete - in 32-Bit-Farbe der direkte Konkurrent von NVidia Riva TNT keine Chancen. Leider funktionierten die meisten Spiele und Anwendungen zum Zeitpunkt der Veröffentlichung der Neuheit noch im 16-Bit-Modus, in dem sich der Rage 128 vor dem Hintergrund von NVidia und S3 in keiner Weise hervorhob (und in Bezug auf die Bildqualität sogar den Modellen von Matrox unterlegen war). Die breite Öffentlichkeit schätzte den Ansatz von ATI nicht, aber zu diesem Zeitpunkt waren die Kanadier zum ersten Mal ihrer Zeit voraus - nur ihr Ansatz wurde viel später gewürdigt.

1998 war ein Rekordjahr für ATI - mit einem Umsatz von 1,15 Milliarden US-Dollar belief sich der Nettogewinn des Unternehmens auf gut 168,4 Millionen US-Dollar. Das kanadische Unternehmen beendete das Jahr mit 27% des Marktes für Grafikbeschleuniger.

Im Oktober 1998 erwarb ATI Chromatic Research für 67 Millionen US-Dollar. Das Unternehmen, das für seine MPACT-Medienprozessoren bekannt ist, war ein PC-TV-Lösungsanbieter von Compaq und Gateway, der eine hervorragende MPEG2-Leistung, eine hohe Audioqualität und eine hervorragende 2D-Leistung bietet. Ironischerweise war es der einzige Nachteil von MPACT in Form einer schlechten 3D-Leistung, der Chromatic Research nur 4 Jahre nach seiner Gründung an den Rand des Bankrotts brachte. Die Zeit der universellen Lösungen rückte immer näher.

3Dfx Voodoo 2 und Voodoo Banshee - Marktführer Erfolgreicher Misserfolg

Während Intel versuchte, in den Grafikmarkt einzusteigen, führte sein Marktführer in der Person von 3Dfx Voodoo 2 ein, das in mehreren Bereichen gleichzeitig zu einem technologischen Durchbruch wurde. Der neue Grafikadapter von 3Dfx hatte ein einzigartiges Design - zusätzlich zum zentralen Chip verfügte das Board über zwei gepaarte Texturprozessoren, dank derer die Karte nicht nur aus drei Chips bestand, sondern auch die Möglichkeit der Mehrfachtexturverarbeitung in OpenGL bot (wenn zwei Texturen gleichzeitig auf ein Pixel angewendet wurden, wodurch das gesamte Rendering der Szene beschleunigt wurde). das wurde noch nie benutzt. Wie das ursprüngliche Voodoo arbeitete die Karte ausschließlich im 3D-Modus, aber im Gegensatz zu ihren Konkurrenten, die 2D- und 3D-Verarbeitung in einem einzigen Chip kombinierten, ging 3Dfx keine Kompromisse ein und verfolgte das Hauptziel - die Position des Marktführers zu verteidigen.

Die professionellen Versionen des neuen Adapters ließen nicht lange auf sich warten - die Tochtergesellschaft 3Dfx Quantum3D veröffentlichte drei bemerkenswerte Beschleuniger, die auf der Neuheit basierten - einen Zwei-Chip-Obsidian2 X-24, der zusammen mit einer 2D-Karte, SB200 / 200Sbi mit 24 MB EDO-Speicher an Bord, verwendet werden konnte. sowie Mercury Heavy Metal - ein exotisches Sandwich, in dem gepaarte 200Sbi durch eine Aalchemy-Kontaktplatine miteinander verbunden waren, die in Zukunft zum Prototyp der berühmten NVidia SLI-Brücke wurde.

Mercury Heavy Metal

Letzteres wurde für komplexe grafische Simulationen entwickelt und war für einen Platzpreis von 9999 US-Dollar erhältlich . Das MHM-Monster benötigte ein Server-Motherboard der Intel BX- oder GX-Serie mit vier PCI-Steckplätzen, um ordnungsgemäß zu funktionieren.

Im Juni 1998 stellte 3Dfx die Bedeutung der Kontrolle des Haushaltsmarktes vor und stellte Voodoo Banshee vor - den ersten Grafikbeschleuniger mit Unterstützung für 2D- und 3D-Betriebsarten. Entgegen den Erwartungen und Hoffnungen war der legendäre Rampage-Chip nie fertig, und die Karte hatte nur eine Texturverarbeitungseinheit an Bord, was die Leistung der Neuheit im multipolygonalen Rendering praktisch zerstörte - Voodoo 2 war um ein Vielfaches schneller. Aber selbst wenn eine wirtschaftliche Produktion mit einer erkennbaren Marke für Banshee einen guten Umsatz sicherstellte, verschwand die Enttäuschung der Fans nirgendwo - viel mehr wurde von den Machern von „genau diesem Voodoo“ erwartet, der über Nacht den Grafikmarkt drehte.

Darüber hinaus verringerte sich trotz der Führung von Voodoo 2 der Abstand zu Wettbewerbern rapide. Nachdem 3Dfx ATI und NVidia einen ernsthaften Wettbewerb auferlegt hatte, sah sich 3Dfx immer fortschrittlicheren Lösungen gegenüber, und nur dank eines effektiven Managements (3Dfx produzierte und verkaufte die Karten selbst ohne Beteiligung von Partnern) erzielte das Unternehmen einen erheblichen Gewinn aus dem Verkauf. Das 3Dfx-Management sah jedoch viele Möglichkeiten, eigene Fabriken für die Herstellung von Siliziumwafern zu erwerben. Daher kaufte das Unternehmen STB Technologies für 131 Millionen US-Dollar mit der Erwartung, die Produktionskosten drastisch zu senken und den Lieferanten Nvidia (TSMC) und ATI (UMC) den Wettbewerb aufzuzwingen. Dieser Deal wurde in der Geschichte von 3Dfx fatal - die mexikanischen STB-Fabriken blieben in Bezug auf die Produktqualität hoffnungslos hinter den asiatischen Wettbewerbern zurück und konnten im Wettlauf um den technologischen Prozess nicht mithalten.

Nachdem die Übernahme von STB Technologies bekannt wurde, unterstützten die meisten 3Dfx-Partner die zweifelhafte Entscheidung nicht und wechselten zu NVidia-Produkten.

Nvidia TNT - Antrag auf technische Führung

Der Grund dafür war das von Nvidia am 23. März 1998 eingeführte Riva TNT. Durch Hinzufügen einer parallelen Pixel-Pipeline zur Riva-Architektur verdoppelten die Ingenieure das Rendern und die Rendergeschwindigkeit, was zusammen mit 16 MB SDR-Speicher die Leistung erheblich steigerte. Der Voodoo 2 verwendete einen viel langsameren EDO-Speicher - und dies gab dem neuen Produkt von Nvidia einen signifikanten Vorteil. Leider hat die technische Komplexität des Chips Früchte getragen - aufgrund von Hardwarefehlern bei der Herstellung des 350-nm-TSMC-Chips funktionierte die Frequenz nicht auf den von den Ingenieuren konzipierten 125 MHz -, die Frequenz fiel häufig auf 90 MHz, weshalb Voodoo 2 den Titel des formalen Leistungsführers behalten konnte.

Trotz aller Mängel war der TNT ein beeindruckendes neues Produkt. Dank der Verwendung eines Zweikanal-AGP-Busses unterstützte die Karte Spielauflösungen von bis zu 1600 x 1200 mit 32-Bit-Farbe (und einem 24-Bit-Z-Puffer zur Gewährleistung der Bildtiefe). Vor dem Hintergrund von 16-Bit-Voodoo 2 sah das neue Produkt von nVidia wie eine echte Revolution in der Grafik aus. Obwohl TNT bei Benchmarks nicht führend war, blieb es gefährlich nahe an Voodoo 2 und Voodoo Banshee und bot dank des progressiven AGP-Busses mehr neue Technologien, eine bessere Skalierung bei der Prozessorfrequenz und eine qualitativ hochwertigere 2D- und Texturverarbeitung. Der einzige Nachteil, wie im Fall des Rage 128, waren Lieferverzögerungen - eine große Anzahl von Adaptern wurde erst im Herbst, im September 1998, zum Verkauf angeboten.

Ein weiterer Nachteil für den Ruf von Nvidia im Jahr 1998 war eine Klage von SGI, wonach NVidia Patentrechte für seine interne Textur-Mapping-Technologie verletzte. Infolge des ein Jahr dauernden Rechtsstreits wurde eine neue Vereinbarung geschlossen, wonach NVidia Zugang zu SGI-Technologien erhielt und SGI die Möglichkeit erhielt, die Entwicklungen von Nvidia zu nutzen. Gleichzeitig wurde die Grafikabteilung von SGI selbst aufgelöst, was nur dem zukünftigen Grafikführer zugute kam.

Nummer neun - Seitenschritt

In der Zwischenzeit, am 16. Juni 1998, beschloss der OEM-Grafikhersteller Number Nine, sein Glück auf dem Grafikmarkt zu versuchen, indem er seine eigene Marke der Revolution IV-Karte herausbrachte.

Number Nine ist weit hinter den Flaggschiff-Lösungen von ATI und Nvidia zurückgeblieben und hat sich auf den Geschäftsbereich konzentriert. Es bietet großen Unternehmen die Schwäche klassischer Karten für Spiele und 3D-Grafiken - Unterstützung für hohe Auflösungen in 32-Bit-Farben.

Um das Interesse großer Unternehmen zu wecken, integrierte Number Nine einen proprietären 36-poligen OpenLDI-Anschluss in seinen Revolution IV-FP und verkaufte die Karte im Lieferumfang eines 17,3-Zoll-SGI 1600SW-Monitors (mit einer Auflösung von 1600 x 1024). Das Set kostete 2795 US-Dollar.

Das Angebot war nicht sehr erfolgreich, und Number Nine kehrte zu Partner-S3- und Nvidia-Karten zurück, bis es im Dezember 1999 von S3 gekauft und dann an die ehemaligen Ingenieure des Unternehmens verkauft wurde, die Silicon Spectrum im Jahr 2002 gründeten.

S3 Savage3D - Eine kostengünstige Alternative zu Voodoo und TNT für 100 US-Dollar

Der Budget-Champion in der Person von S3 Savage debütierte auf der E3 1998 und kam im Gegensatz zu den langmütigen Dominatoren im obigen Segment (Voodoo Banshee und Nvidia TNT) einen Monat nach der Ankündigung in die Regale. Leider konnte der Ansturm nicht unbemerkt bleiben - die Treiber waren "roh" und die Unterstützung für OpenGL wurde nur in Quake implementiert, da S3 es sich nicht leisten konnte, eines der beliebtesten Spiele des Jahres zu ignorieren.

Die Frequenzen des S3 Savage waren ebenfalls nicht glatt. Aufgrund von Herstellungsfehlern und hohem Stromverbrauch wurden die Referenzadaptermodelle sehr heiß und lieferten nicht die beabsichtigte Frequenzschwelle von 125 MHz - die Frequenz schwebte normalerweise zwischen 90 und 110 MHz. Zur gleichen Zeit erhielten Rezensenten führender Veröffentlichungen technische Beispiele, die bei 125 MHz ordnungsgemäß funktionierten und schöne Zahlen in allen Arten von Benchmarks lieferten, zusammen mit dem Lob der Fachpresse. Später wurden frühe Probleme in Partnermodellen gelöst - Savage3D Supercharged arbeitete stabil bei 120 MHz und Terminator BEAST (Hercules) und Nitro 3200 (STB) eroberten den begehrten 125-MHz-Balken.Trotz der rohen Treiber und der mittelmäßigen Leistung vor dem Hintergrund der Führer der Big Three ermöglichte der demokratische Preis innerhalb von 100 US-Dollar und die Fähigkeit, qualitativ hochwertige Videos abzuspielen, dem S3 gute Verkäufe.

1997 und 1998 waren eine weitere Phase von Akquisitionen und Insolvenzen - viele Unternehmen konnten sich im Wettlauf um Leistung nicht behaupten und mussten die Branche verlassen. So blieben Cirrus Logic, Macronix und Alliance Semiconductor zurück, während Dynamic Pictures an 3DLabs verkauft wurde, Tseng Labs und Chromatic Research von ATI aufgekauft wurden, Rendition Micron verließ, AccelGraphics Evans & Sutherland übernahm und Chips and Technologies Teil von Intel wurde.

Trident, S3 und SiS - Die letzte Schlacht des Millenniums um Budgetgrafiken

Der OEM-Markt war schon immer der letzte Strohhalm für Hersteller, die hoffnungslos hinter der Konkurrenz in Bezug auf 3D-Grafik und Leistung zurückbleiben. Dies war auch bei SiS der Fall, das das Budget SiS 300 für die Bedürfnisse des Unternehmenssektors freigab. Trotz bedauerlicher 3D-Leistung (begrenzt durch eine einzelne Pixel-Pipeline) und einer hoffnungslosen 2D-Verzögerung hinter allen Wettbewerbern auf dem Mainstream-Markt eroberte der SiS 300 OEMs mit bestimmten Vorteilen - einem 128-Bit-Speicherbus (64-Bit im Fall des vereinfachten SiS 305). Unterstützung für 32-Bit-Farben, DirectX 6.0 (und sogar 7,0 im Fall des 305), Unterstützung für Multi-Textur-Rendering und Hardware-MPEG2-Decodierung. Es gab eine Grafikkarte und einen Fernseher.

Im Dezember 2000 erblickte der modernisierte SiS 315 das Licht, das über eine zweite Pixel-Pipeline und einen 256-Bit-Bus sowie vollständige Unterstützung für DirectX 8.0 und Vollbild-Anti-Aliasing verfügt. Die Karte erhielt eine neue Beleuchtungs- und Texturverarbeitungs-Engine, eine Kompensation für Verzögerungen beim Abspielen von Videos von DVD-Medien und Unterstützung für den DVI-Anschluss. Das Leistungsniveau lag im Bereich der GeForce 2 MX 200, was das Unternehmen jedoch überhaupt nicht störte.

SiS 315 kam ebenfalls auf den OEM-Markt, jedoch bereits im September 2001 als Teil des SiS 650-Chipsatzes für Motherboards auf Sockel 478 (Pentium IV) und 2003 auch als Teil des SiS552-SoC-Systems.

SiS war jedoch bei weitem nicht der einzige Hersteller, der interessante Lösungen im Budgetsegment anbot. Trident kämpfte auch mit dem Blade 3D um die Aufmerksamkeit der Käufer, dessen Gesamtleistung mit dem ausgefallenen Intel i740 vergleichbar war, aber der Preis von 75 US-Dollar deckte viele der Mängel mehr als ab. Später kam der Blade 3D Turbo auf den Markt, bei dem die Frequenzen von 110 auf 135 MHz anstiegen und die Gesamtleistung das Niveau von i752 erreichte. Leider hat Trident zu lange gebraucht, um seine Lösungen für den Markt zu entwickeln, auf dem alle paar Monate neue Produkte vorgestellt wurden. Bereits im April 2000 war dies der erste Schlag für das Unternehmen - VIA, für das Trident integrierte Grafiken entwickelte, erwarb das Unternehmen S3 und stellte die Zusammenarbeit mit dem ersteren ein Partner.

Trident hat sein Geschäftsmodell jedoch voll ausgenutzt und Massensendungen und niedrige Herstellungskosten für seine Budgetlösungen kombiniert. Der Mobilfunkmarkt blieb relativ leer, und Trident entwickelte speziell dafür mehrere Blade3D Turbo-Modelle - T16 und T64 (Betrieb mit 143 MHz) und XP (Betrieb mit 165 MHz). Der OEM-Markt, der viele Unternehmen anzog, unterstützte die Einfachheit von Trident jedoch nicht mehr - der wenig später erschienene SiS 315 gab der gesamten Trident-Produktlinie Kontrolle und Partner. Trident war nicht in der Lage, schnell eine tragfähige Alternative zu entwickeln, und beschloss 2003, die Grafiksparte an die SiS-Tochter XGI zu verkaufen.

S3 Savage4 unterschied sich von anderen Lösungen im Budgetbereich. Das neue Produkt wurde im Februar angekündigt und im Mai 1999 in den Handel gebracht. Es bietet 16 und 32 MB Onboard-Speicher, einen 64-Bit-Vierkanal-AGP-Bus und eine eigene Texturkomprimierungstechnologie, mit der der Adapter Blöcke mit einer Auflösung von bis zu 2048 x 2048 problemlos verarbeiten kann (obwohl dies schwierig ist) und wurde früher in Savage3D implementiert). Die Karte war auch in der Lage, mehrere Texturen zu rendern, aber selbst die debuggten Treiber und beeindruckenden technischen Eigenschaften konnten die Tatsache nicht verbergen, dass die Angebote von 3Dfx, Nvidia und ATI aus dem letzten Jahr wesentlich produktiver waren. Und dieser Zustand wiederholte sich ein Jahr später, als der Savage 2000 auf den Markt kam. Bei niedrigen Auflösungen (1024 x 768 und weniger) konnte das neue Produkt mit Nvidia TNT und Matrox G400 konkurrieren.Wenn jedoch eine höhere Auflösung gewählt wurde, änderte sich das Kräfteverhältnis radikal.

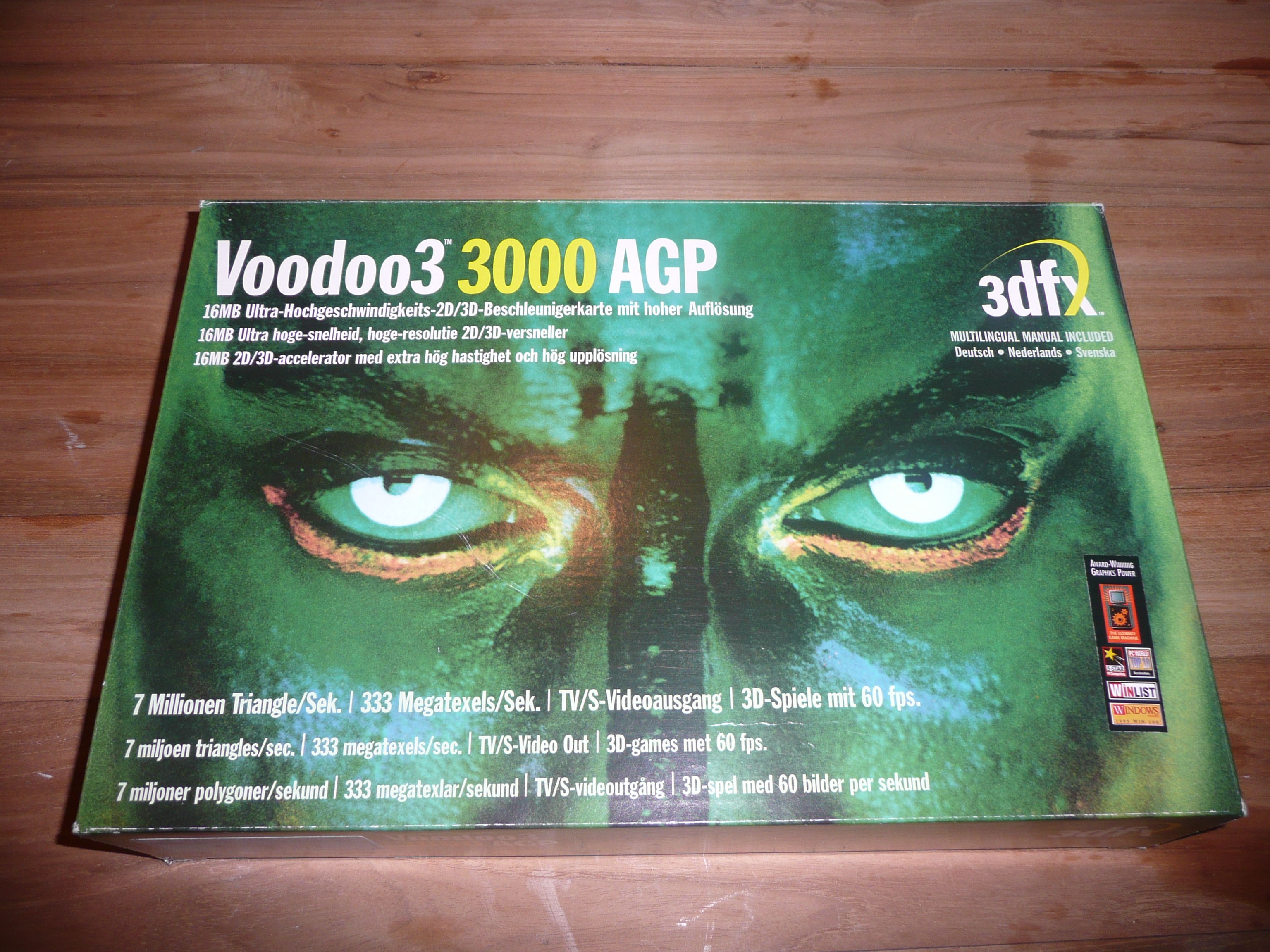

3Dfx Voodoo3 - Paphos, Lärm und leere Ausreden

3Dfx konnte nicht zulassen, dass sein neues Produkt vor dem Hintergrund fortschrittlicher Wettbewerber verloren ging. Daher wurde die Premiere von Voodoo3 im März 1999 von einer umfangreichen Werbekampagne begleitet - die Karte wurde in der Presse und im Fernsehen lebhaft beworben, und das kühne Design der Box zog die Augen potenzieller Käufer an, die von einer neuen grafischen Revolution träumten.

Leider war der Rampage-Chipsatz, der zum Stadtgespräch wurde, noch nicht fertig, und die architektonische Neuheit war ein Verwandter des Voodoo2, der auf dem Avenger-Chip basierte. Archaische Technologien wie die Unterstützung einer exklusiven 16-Bit-Farb- und Texturauflösung von nur 256 x 256 haben den Fans der Marke nicht gefallen, ebenso wie der völlige Mangel an Unterstützung für die Hardware-Verarbeitung von Beleuchtung und Geometrie. Viele Hersteller haben bereits eine Mode für hochauflösende Texturen, multipolygonales Rendering und 32-Bit-Farben eingeführt, sodass 3dfx zum ersten Mal bei allen Parametern zu den Nachzüglern gehörte.

Die Investoren mussten den Verlust von 16 Millionen US-Dollar durch das jüngste Erdbeben in Taiwan erklären, der jedoch nur geringe Auswirkungen auf den finanziellen Erfolg von ATI und Nvidia hatte. Das Unternehmen erkannte die offensichtlichen Vorteile der kostenlosen Verteilung von DirectX- und OpenGL-Bibliotheken und kündigte bereits im Dezember 1998 an, dass ihre Glide-API als Open Source verfügbar sein werde. Zwar waren zu dieser Zeit kaum zu viele Menschen bereit.

Riva TNT2 und G400 - Konkurrenten voraus

Gleichzeitig mit der bombastischen Premiere von Voodoo3 von 3Dfx präsentierte Nvidia bescheiden seine RIVA TNT 2 (mit den ersten Karten der Ultra-Serie in ihrer Geschichte, bei denen Spieler höhere Kern- und Speicherfrequenzen erhielten), und Matrox präsentierte den ebenso beeindruckenden G400.

Riva TNT2 wurde in TSMC-Werken mit 250-nm-Technologie hergestellt und konnte Nvidia ein beispielloses Leistungsniveau bieten. Die Neuheit hat Voodoo3 fast überall zerschlagen - die Ausnahme waren nur wenige Spiele, die AMD 3DNow verwendeten! Kombiniert mit OpenGL. Nvidia hielt auch mit der Technologie Schritt - die TNT2-Serie verfügte über einen DVI-Anschluss zur Unterstützung der neuesten Flachbildschirme.

Eine echte Überraschung für alle war Matrox G400, das sich als noch produktiver als TNT2 und Voodoo3 herausstellte und nur bei Spielen und Anwendungen mit OpenGL hinterherhinkte. Für seinen erschwinglichen Preis von 229 US-Dollar bot das neue Produkt von Matrox eine hervorragende Bildqualität, beneidenswerte Leistung und die Möglichkeit, zwei Monitore über einen gekoppelten DualHead-Anschluss anzuschließen. Der zweite Monitor war auf eine Auflösung von 1280 x 1024 beschränkt, aber viele Leute mochten die Idee.

Der G400 verfügt außerdem über EMBM (Environment Mapped Bump Mapping), um das allgemeine Textur-Rendering zu verbessern. Für diejenigen, die es immer vorzogen, das Beste zu kaufen, gab es die G400 MAX, die bis zur Veröffentlichung der GeForce 256 mit DDR-Speicher Anfang 2000 den Titel der produktivsten Karte auf dem Markt trug.

Matrox Parhelia 3DLabs Permedia –

Der große Erfolg auf dem Markt für Gaming-Grafikbeschleuniger inspirierte Matrox nicht, der auf den professionellen Markt zurückkehrte und nur einmal versucht war, den Erfolg des G400 mit Parhelia zu wiederholen. Im Jahr 2002 beherrschten die Konkurrenten DirectX 9.0 bereits mit Macht und Kraft, und die Unterstützung für drei Monitore schwand gleichzeitig vor dem Hintergrund einer bedauernswerten Gaming-Leistung.

Als es dem Publikum bereits gelungen war, die hochkarätigen Veröffentlichungen von drei Unternehmen zu verdauen, präsentierte 3DLabs die lang vorbereitete Permedia 3 Create! Das Hauptmerkmal der Neuheit war die Nischenpositionierung - 3DLabs hoffte, die Aufmerksamkeit von Profis auf sich zu ziehen, die es vorziehen, ihre Freizeit in Spielen zu verbringen. Das Unternehmen konzentrierte sich auf hohe Leistung in 2D und zog Spezialisten aus den 1998 erworbenen Dynamic Pictures an, den Autoren der professionellen Linie von Sauerstoffadaptern.

Unglücklicherweise für 3DLabs hatte die komplexe Polygonmodellierung in professionellen Karten Priorität, und häufig wurde eine hohe Leistung in dieser Richtung durch eine ernsthafte Verringerung der Texturverarbeitungsgeschwindigkeit erzielt. Spieladapter mit einer Priorität in 3D funktionierten genau umgekehrt - anstelle komplexer Berechnungen standen die Rendergeschwindigkeit und die Verarbeitung von Texturen mit hoher Bildqualität im Vordergrund.

Permedia war der jüngste Versuch von 3DLabs, ein Produkt auf den Markt für Gaming-Adapter zu bringen, weit hinter Voodoo3 und TNT 2 in Spielen und nicht weit hinter der Konkurrenz bei Arbeitsanwendungen und -aufgaben. Darüber hinaus haben die berühmten Grafikingenieure ihre Speziallinien GLINT R3 und R4 für die Oxygen-Architektur weiter ausgebaut und unterstützt. Die Modellvielfalt reichte vom Budget VX-1 für 299 USD bis zum Premium-GVX 420 für 1499 USD.

Zum Repertoire des Unternehmens gehörte auch die Wildcat-Adapterlinie, die auf den Intense3D-Entwicklungen basiert und im Juli 2000 von Integraph gekauft wurde. Während 3DLabs im Jahr 2002 die Entwicklung fortschrittlicher Grafikchips für die neuen Wildcat-Adapter aktiv abschloss, wurde das Unternehmen von Creative Technology mit seinen Plänen für die Linien P9 und P10 aufgekauft.

Im Jahr 2006 verließ das Unternehmen den Desktop-Computer-Markt und konzentrierte sich auf Lösungen für den Medienmarkt. Später wurde es Teil des Creative SoC und wurde als ZiiLab bekannt. Die 3DLabs-Geschichte endete schließlich 2012, als Intel das Unternehmen kaufte.

ATI Rage MAXX - Dual-Chip Madness Lagging

Seit der Veröffentlichung des erfolgreichen Rage 128 hatte ATI eine Reihe von Schwierigkeiten bei der Weiterentwicklung der Linie. Ende 1998 implementierten die Ingenieure erfolgreich die Unterstützung für den AGP 4x-Bus in der aktualisierten Version des Rage 128 Pro-Adapters und fügten der Anzahl der Anschlüsse einen TV-Ausgang hinzu. Im Allgemeinen zeigte sich der Grafikchip in Bezug auf die Spieleleistung ungefähr auf dem Niveau von TNT 2, aber nach der Veröffentlichung von TNT 2 Ultra ging die Meisterschaft erneut an Nvidia über, was die Kanadier nicht ertragen wollten - die Arbeit an Project Aurora begann.

Als klar wurde, dass das Rennen um die Leistung verloren ging, griffen die Ingenieure auf einen Trick zurück, der in Zukunft eines der Merkmale vieler Generationen roter Karten sein wird - sie veröffentlichten die Rage Fury MAXX, eine Grafikkarte mit zwei GPUs, auf deren Board zwei Rage 128-Profis arbeiteten.

Wut Wut MAXX

Beeindruckende Spezifikationen und die Möglichkeit des Parallelbetriebs von zwei Chips machten die Karte mit einem abscheulichen Namen zu einer ziemlich produktiven Lösung und brachten ATI voran, es war nicht möglich, die Führung für eine lange Zeit zu behalten. Selbst der S3 Savage 2000 kämpfte um den Titel der Besten, und die später vorgestellte GeForce 256 mit DDR-Speicher ließ dem Flaggschiff von ATI trotz der bedrohlichen Zahlen und fortschrittlichen Technologien keine Chance. Nvidia war gern die erste, und die junge Jen-Hsun Huang hatte es nicht eilig, dem Marktführer Platz zu machen.

GeForce 256 ist die erste echte "Grafikkarte". Die Geburt des Begriffs GPU

Weniger als zwei Monate sind vergangen, seit ATI mit der Ankündigung von Rage Fury MAXX einen Pyrrhussieg bei den Benchmarks errungen hat, als Nvidia die Antwort vorlegte, die den Status des Marktführers sicherte - der GeForce 256. Die Neuheit war die erste in der Geschichte, die am 1. Oktober 1999 verschiedene Arten von Videospeicher herausbrachte Eine Version mit SDR-Chips erblickte das Licht der Welt, und am 1. Februar 2000 begann der Verkauf einer aktualisierten Version mit DDR-Speicher.

GeForce 256 DDR

Ein Grafikchip mit 23 Millionen Transistoren wurde in TSMC-Fabriken unter Verwendung einer 220-nm-Prozesstechnologie hergestellt. Noch wichtiger ist jedoch, dass die GeForce 256 der erste Grafikadapter war, der als "Grafikkarte" bezeichnet wurde. Haben Sie bemerkt, wie sorgfältig wir diesen Begriff in der gesamten Geschichte vermieden haben? Das war der Punkt umständlicher Substitutionen. Der Begriff GPU (Graphics Processing Unit) stammt aus der Integration zuvor getrennter Textur- und Beleuchtungspipelines als Teil des Chips.