Die Geschichte klingt zunächst recht einfach: Das Speichersystem funktioniert drei Jahre lang gut mit einer erweiterten Garantie, das vierte ist relativ normal und ein neues wird anstelle des veralteten am fünften gekauft. Anbieter drücken Geld aus Ihnen heraus, indem sie die Supportkosten und alle Arten von kostenpflichtigen Funktionen wie den VDI-Support erhöhen. Kann dieses Schema gebrochen werden? Vielleicht ja.

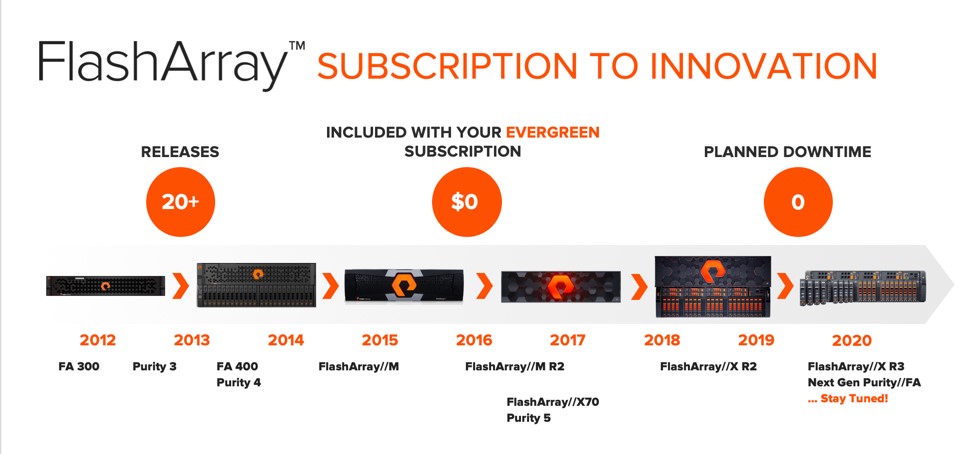

Das Unternehmen ist mit einem interessanten Vorschlag auf den Markt gekommen: Eine Hardware funktioniert immer, sie funktioniert immer schnell, die Supportkosten sind jedes Jahr gleich, alle Funktionen sind sofort verfügbar. Das heißt, sie haben nur die Box genommen und von Zeit zu Zeit die darin enthaltenen Komponenten so ausgetauscht, dass sie bei etwa der Geschwindigkeit des Austauschs veraltet sind. Die Steuerungen werden alle drei Jahre aktualisiert. Es ist möglich, alte Festplatten durch modernere zu ersetzen, dh der Platz, den das Speichersystem im Rack einnimmt, kann nicht nur wachsen, sondern auch abnehmen, während das Volumen und die Leistung zunehmen.

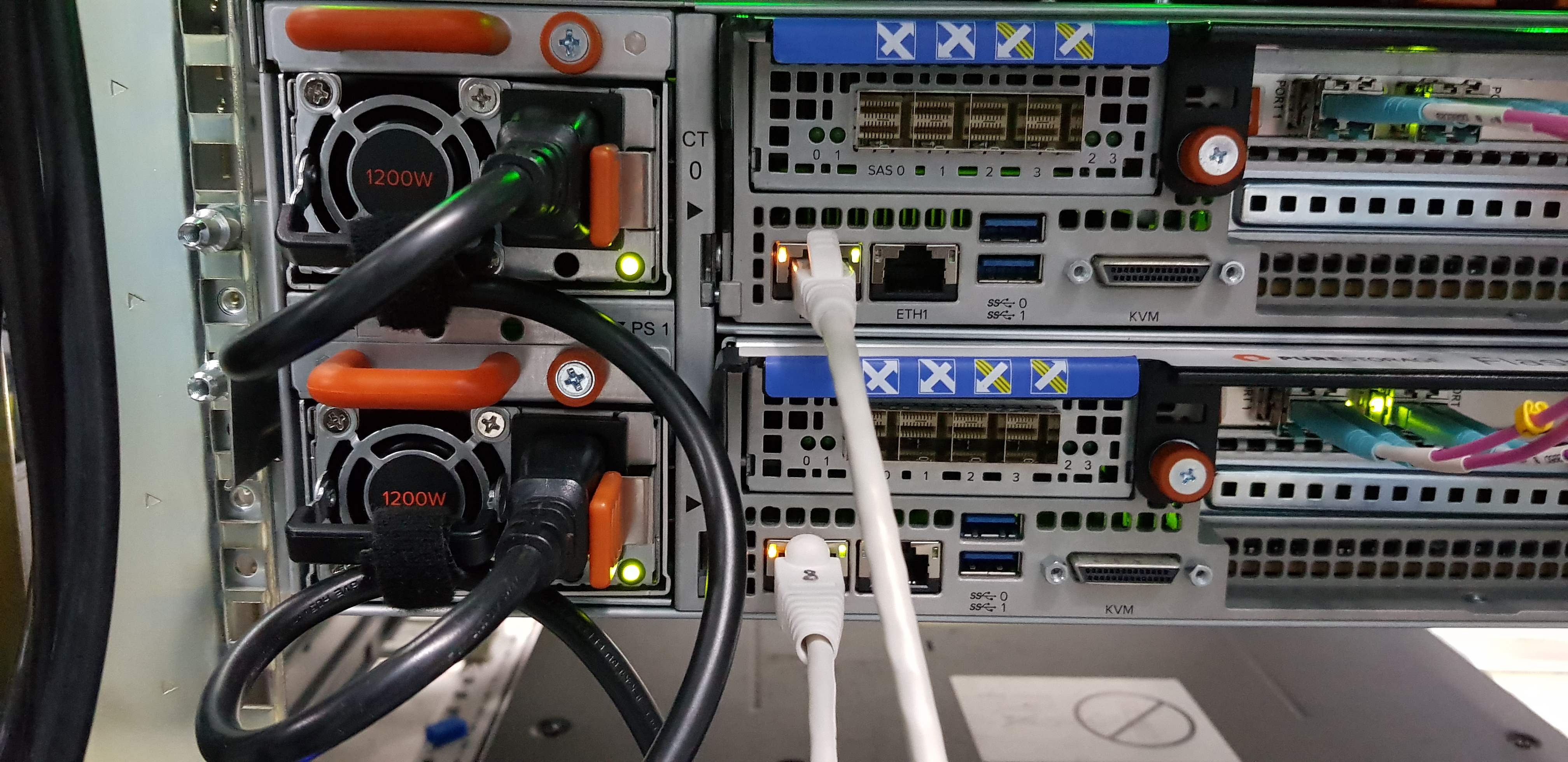

Das erste, was Sie im Rack sehen, sind die Griffe mit dem Modellnamen, mit denen Sie die Controller aus dem Array ziehen können und sollten.

Dies geschieht, ohne herunterzufahren, Geld zu verdienen, und die Produktivitätsspanne ist so bemessen, dass die Bankensysteme beim Austausch nicht langsamer werden. Zu diesem Zweck war es erforderlich, ein eigenes Dateisystem (genauer gesagt ein RAID-Analogon) zu schreiben, einen Cluster darin zusammenzustellen und einige Verbesserungen vorzunehmen, während gleichzeitig der von Festplatten geerbte Overhead weggeworfen wurde.

Mal sehen, was passiert ist und wie es ausgegangen ist. Beginnen wir mit der Architektur.

Zunächst enthält das Verfahren zum Arbeiten mit dem Array keine Netzschalter. Absolut. Wird nicht brauchen. Zum Herunterfahren ziehen Sie einfach die Kabel aus der PDU.

Reine Speicherarchitektur

Das Unternehmen ging von der Tatsache aus, dass es von Grund auf eine sehr gute Architektur entwickelte, die für Flash (seit 2017 - NVMe) geschärft wurde, und effektive Algorithmen für die Deduplizierung und Datenkomprimierung. Die Berechnung war wie folgt: Dann gab es Arrays von Festplatten, Hybridlösungen und SSD All-Flash auf dem Markt. Flash-Laufwerke waren teuer und Disc-Laufwerke waren langsam. Dementsprechend brachen sie mit Flash-Arrays auf Kosten des Besitzes von Festplatten-Arrays in das Wettbewerbsumfeld ein.

Wir haben das gemacht:

- Wir haben unser eigenes Betriebssystem für Festplatten geschrieben. Das Hauptmerkmal ist die schnelle Datenkomprimierung vor der Aufnahme und die anschließende Nachbearbeitung mit leistungsstarkem Dedup, mit der Sie sie noch dichter und genauer stempeln können.

- Wir haben nur Flash-Laufwerke (jetzt ist es im Allgemeinen ausschließlich NVMe) und leistungsstarke Hardware für die Datenverarbeitung verwendet.

Die ersten Implementierungen waren für VDI-Umgebungen, da die Daten dort sehr gut komprimiert wurden. Deduplizierungs- und Komprimierungsalgorithmen ergaben einen sechs- bis neunfachen Gewinn in dem verwendeten Raum, dh mit allen Vorteilen von All-Flash senkten sie die Preise um etwa eine Größenordnung. Außerdem hat mich das Wirtschaftsmodell bestochen: feste Kosten für den Support und die Möglichkeit, die Hardware nicht zu ändern. Dann sah ich den ersten Ersatz von zwei Racks für Versionen mit drei oder sechs Einheiten, aber ich glaubte immer noch nicht, dass dieses Stück Eisen irgendwo außerhalb von VDI verwendet werden würde.

Und dann begann LinkedIn, auf diesen Eisenstücken zu lagern. AT & T verbunden. Top-Banken und Telekommunikationsunternehmen in den USA kauften ebenfalls Produkte ein.

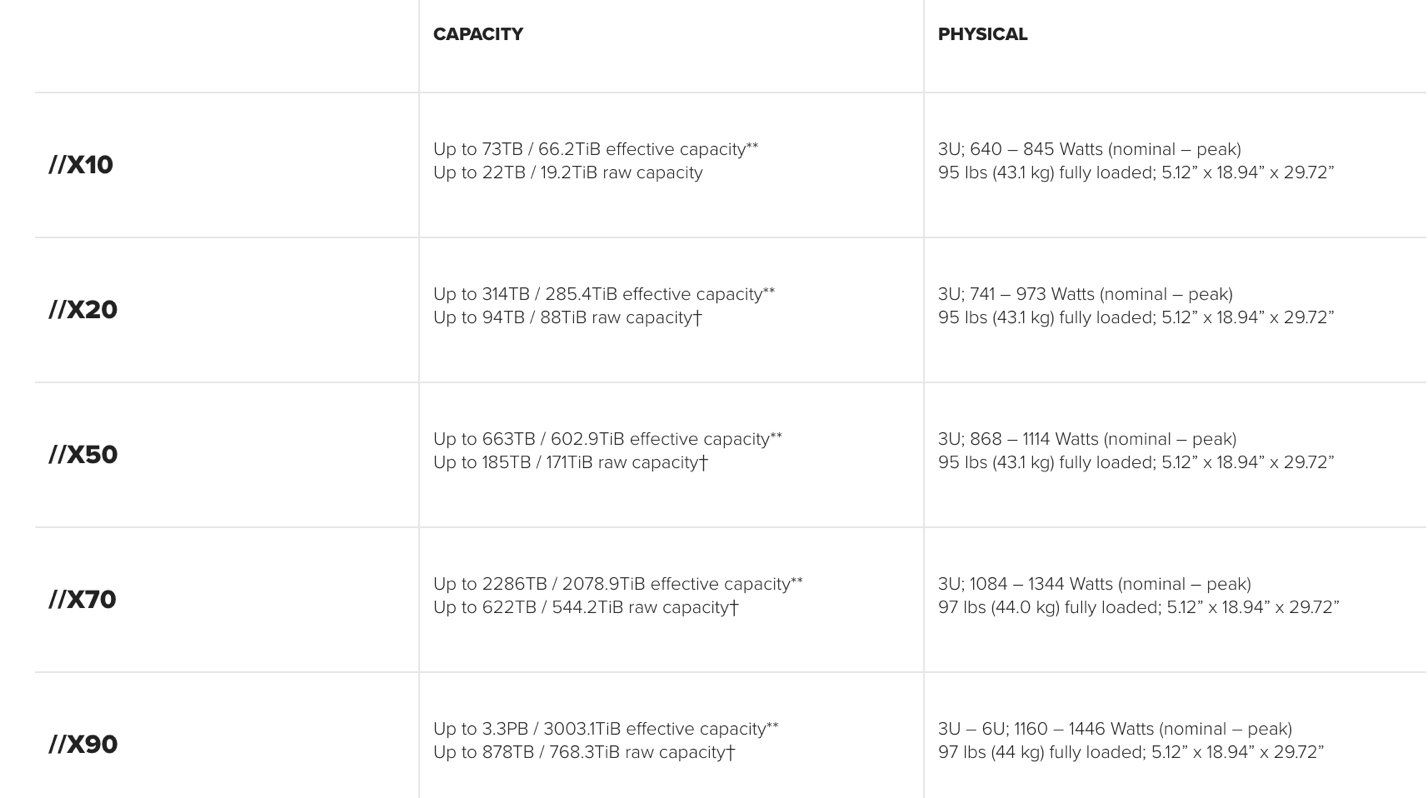

Es stellte sich heraus, dass Komprimierungsalgorithmen für Entwicklungs- und Testumgebungen sehr gut geeignet sind. Nach dem Ersatz von SSD durch NVME begann plötzlich der Wettbewerb in den herkömmlichen Transaktionsdatenbanken im Bankensegment. Da sich das Array aufgrund seiner Architektur als schnell und zuverlässig herausstellte, "können wir jederzeit zwei beliebige Flash-Module verlieren". Dann kam ein Flash-Array auf billigeren Chips (QLC) mit einer Reaktionszeit von 2 bis 4 ms und nicht von 1 ms wie bei Topmodellen heraus, und ich begann, die Entfernung des gleichen VNX und Compellent zu beobachten. Es wurde klar, dass das Stück Eisen ziemlich wettbewerbsfähig ist.

Natürlich sind die Kosten für TB weiterhin hoch, wenn inkompressible Daten vorhanden sind: Verschlüsselung, Archivierung, Video-Streams (Videoüberwachung) und Bildbibliotheken. Manchmal treten solche Implementierungen jedoch auch auf, wenn ein Client eine hohe Leistung benötigt. Ich kenne einen Fall, in dem ein Video um weitere 10% komprimiert wurde (scheinbar komprimierte Daten).

Aber selbst für herkömmliche Datenbanken erwies es sich zu einem Preis pro Gigabyte als durchaus praktikabel.

Und hier begann das Modell des "immergrünen" Speichersystems zu bestechen.

Ständiges Upgrade

Fünf Jahre lang verbleiben nur das Chassis und die Netzteile in dem Eisenstück des alten. Sie können mit Übertragungen in Ruckeln wechseln oder Komponenten wie in einem Cluster ändern. Tatsächlich ist dies der Cluster, der nur in einer Box mit drei Einheiten (oder sechs Einheiten) zusammengebaut ist. Eisen wurde von Grund auf neu hergestellt. Schauen wir uns zuerst die Architektur an und gehen wir dann zu dem Grund über, warum es zweckmäßig ist, sie Stück für Stück zu ändern.

Interessante Lösungen sind:

- Die Rechenleistung ist immer doppelt so hoch: Der Controller muss ausgetauscht werden, ohne die Leistung zu beeinträchtigen. Gleichzeitig arbeiten beide Controller auf der Vorderseite, und ein Controller im Backend wird zum Schreiben in Flash-Module verwendet.

- RAID- , N + 2, . , — , . .

- N + 2, , . , . RAID, , , , ( ) , .

- ! , , . , - .

- , ! , , ( ), - . , , , . . , RAID 10.

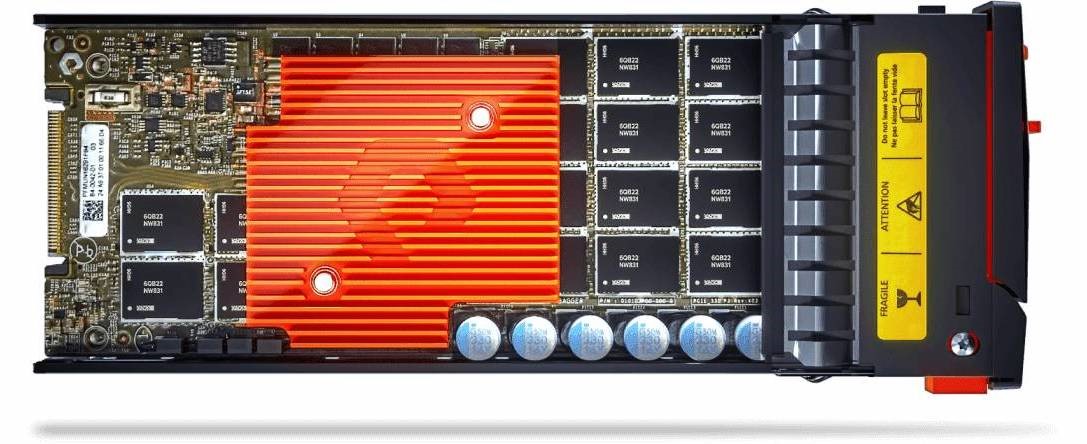

- — NVMe-, — NVRAM. Optane. — , ( SCM-), .

- . - , , . , .

- 3:1, . 512 , 8 . — , . . HDD, .

- ( ). , .

Es reichte dem Unternehmen jedoch nicht aus, seine Architektur zusammenzustellen und ein virtuelles Server-Betriebssystem dafür zu schreiben. Sie sind selbst in den niedrigen Pegel der Flash-Chips geraten und haben ihre eigenen veröffentlicht. Gleichzeitig sind sie aber auch mit Standards kompatibel. Oben befindet sich eine NVMe-Schnittstelle, im Inneren befinden sich Chips unseres eigenen Designs.

Violine nahm diesen Weg, der ihnen einst kosmisch schnelle Arrays gab. Nur sie haben ihren eigenen Standard gemacht, aber hier verwenden sie einen offenen und öffentlich zugänglichen. Wofür ist das? Die Chip-Firmware ist Teil der Controller-Firmware, und daher weiß das Speichersystem genau, was auf jedem einzelnen Baustein geschieht.

Wenn in einem normalen Festplattenregal jedes SSD- oder NVMe-Modul eine kleine Blackbox für einen Controller ist, dann sieht er hier alles. Dies war bei der Lösung des Problems eines großen adressierbaren Volumes erforderlich, da die Probleme bei Flash-Arrays dieselben sind: Verschleißmanagement, Speicherbereinigung usw. Dies erfolgt über die Firmware der Controller.

Das heißt, wie Sie sehen können, lautet das Rätsel wie folgt: Ein billiger Ort wird durch den Austausch gegen Leistung erreicht. Hohe Leistung bedeutet konstante CPU-Redundanz und RAID. Eine übermäßige Anzahl von Prozessoren bedeutet eine leistungsstarke Komprimierungsnachbearbeitung und die Möglichkeit, Teile zu verlieren, ohne an Leistung zu verlieren. RAID entspricht dieser Idee. Das heißt, all diese Vorteile geben dem Chip fast kostenlos die Möglichkeit, einen Teil des "Gewinns" herauszunehmen.

Als nächstes kommt das Marketing und bietet die große Aussage "zeitloser Speicher". Fester Support-Preis, inklusive aller Software, keine zusätzlichen Bundles. Aufgrund eines separaten Service-Levels können Sie die Controller alle drei Jahre kostenlos austauschen (Evergreen GOLD-Level). Es gibt Upgrades, wenn die Anforderungen steigen: Ich habe gesehen, wie XR2 zu XR3 geändert wurde. Ich habe ein Jahr lang gearbeitet, dann kam ein Geschäft und sagte, wir bräuchten ein neues. Der Anbieter hat die Möglichkeit, alte Controller zu handeln und neue im Voraus zu erwerben. Schönes Upgrade. Die Steuerungen wechseln jeweils einzeln.

Das Aktualisieren von Festplatten ist interessanter. Ein zusätzliches Serviceregal mit Festplatten wird ab Werk geliefert. Daten werden ohne Unterbrechung in das Regal migriert - alle Daten von den Medien, die ersetzt werden müssen. Das Regal funktioniert mit den Hauptcontrollern (es hat seine eigenen). Tatsächlich handelt es sich hierbei um ein temporäres Speicherpaket für Dateneinheiten. Nach Abschluss der Migration werden die Festplatten als OK markiert und vom Techniker aus dem Gehäuse entfernt. Anstelle der alten werden neue eingefügt und die umgekehrte Migration gestartet. Es dauert einen Tag oder länger, aber die Anwendungen und der Server werden nicht bemerkt. Da diese Speichersysteme häufig bei Dienstanbietern erhältlich sind, besteht die Möglichkeit des gleichzeitigen Austauschs und Upgrades: Im Rahmen von Evergreen GOLD können Sie alte Festplatten durch mehrere neue, leistungsstarke und schnelle ersetzen und dieselben kaufen.

Es ist also gut auszufüllen, der Schwachpunkt ist immer die Komprimierung!

Wir sind es gewohnt, dies von Festplattenspeichern zu hören. Dort ist die Geschichte Standard - die Funktionalität wurde während der Entwicklung der Architektur nicht bereitgestellt - sie schalteten die Komprimierung ein, die Anwendung wurde gestoppt und verbrachten viel Zeit damit, unter dem Missbrauch des Managements alles wieder herzustellen. Wie bereits erwähnt, hat Pure Storage einen anderen Weg eingeschlagen - die Deduplizierung mit Komprimierung wurde zu einer grundlegenden, nicht trennbaren Funktionalität. Das Ergebnis ist, dass Pure Storage jetzt mehr als 15.000 Installationen wert ist. Während der Initialisierung können Sie das Kontrollkästchen "Anonymisierte Statistiken bereitstellen" aktivieren. Anschließend wird Ihr Speichersystem an das Pure 1-Überwachungssystem gesendet. Die Garantie für Datenbanken beträgt beispielsweise 3,5: 1. Es gibt spezielle Funktionen - das gleiche VDI ab 7: 1. Arrays werden nicht an einem feuchten Ort verkauft, sondern in einem nützlichen Behälter mit der Garantie einer zusätzlichen Lieferung.Wenn sich herausstellt, dass Ihre Komprimierungsstufe während der Migration niedriger als garantiert ist, stellt der Anbieter mehr physische Festplatten kostenlos zur Verfügung. Der Hersteller gibt an, dass Laufwerke in etwa 9 bis 10% der Fälle ausgeliefert werden und der Fehler selten einige Laufwerke überschreitet. In Russland habe ich dies noch nie gesehen, die Koeffizienten waren bei allen Installationen gleich, außer in dem Fall, in dem verschlüsselte Daten "enthüllt" werden, über die der Kunde nicht gesagt hat, dass sie verschlüsselt sind.

Aufgrund der Art der Schnappschüsse sind Testumgebungen sehr effizient. Es gibt ein Beispiel für einen Kunden, der eine 7: 1-Dimensionierung in der Berechnung vorgenommen und 14 Kopeken zu einem erhalten hat.

Der Anbieter gibt Folgendes an:

- 3,5: 1-Datenbanken (Oracle, MS SQL).

- 4.2: 1-Servervirtualisierung (VMware, Hyper-V).

- 7.1: 1 VDI (Citrix, VMware).

- Durchschnittliches Verhältnis von 5: 1 über die gesamte installierte Basis.

Ebenfalls von der interessanten Funktionalität: Automatisierung und Integration mit modischen Jugendstücken wie Kubernetes sowie volle Unterstützung für VMware vvol. Hier ist alles einfach - die meisten westlichen Kunden von Pure Storage sind Cloud-Anbieter wie ServiceNow, deren Fall übrigens auf der Website veröffentlicht wird. Sie sind es gewohnt, alles so weit wie möglich zu automatisieren.

Gesamt

Es stellte sich als interessante Sache heraus, die zunächst seltsam und dann immer freudiger und freudiger aussieht. Fünf Jahre bei Gartner:

Natürlich ist das Wirtschaftsmodell von Evergreen nicht so billig und billig, aber es spart eine Reihe von Hämorrhoiden und sieht bei der Berechnung der Betriebskosten für mehrere Jahre recht wettbewerbsfähig aus.

PS Ein Online-Treffen ist unten verfügbar: "Datenspeichersysteme nach Abonnement: Wahrheit oder Fiktion."