Film verdoppelt sich

Sie haben wahrscheinlich mehr als einmal Doppelschauspieler auf dem Bildschirm gesehen und die Ersetzung höchstwahrscheinlich nicht einmal bemerkt. Wenn früher Maskenbildner für Ähnlichkeit verantwortlich waren, ziehen Regisseure jetzt zunehmend Entwicklungsteams aus der Spieleentwicklungsbranche an.

Gladiator, den ich als Beispiel angeführt habe, war einer der ersten Filme mit einem digitalen Zwilling. Diejenigen seiner Szenen, die keine Zeit hatten, mit Oliver Reed gefilmt zu werden, wurden aus teilweise gefilmtem Material gesammelt und mit 3D-Grafiken erstellte Frames hinzugefügt. Für 1999 haben wir ein absolut fantastisches Ergebnis erzielt, und selbst CG-Spezialisten bemerken die Substitution oft nicht.

Ein weiteres berühmtes Beispiel für die Nachbildung eines Filmhelden nach dem Tod eines Schauspielers ist der Film "Superman Returns" (2006) von Brian Singer. Marlon Brando zum Vater eines Übermenschen zu machen, war für den Regisseur eine Grundsatzfrage, denn Brando spielte 1978 die gleiche Rolle in Superman.

Aus Fotos wurde ein 3D-Modell des Gesichts des Schauspielers erstellt, und seine Animation - Mimik und Augenbewegungen - wurde auf der Grundlage des Filmmaterials des Schauspielers erstellt, das in der endgültigen Bearbeitungsversion nicht enthalten war. Im Allgemeinen ein sehr zeitaufwändiger Prozess.

Vor zehn Jahren wurden viele komplexe Operationen zur Erstellung eines fotorealistischen Modells manuell durchgeführt. Und die moderne Filmindustrie verfügt bereits über einen riesigen technologischen Stack für die gleichen Zwecke, und es besteht keine Notwendigkeit, das Rad neu zu erfinden.

Das vielleicht aussagekräftigste Beispiel für technologische Fortschritte ist der Prozess der Herstellung von Leder in 3D. Die menschliche Haut lässt Licht durch und ein durch sie hindurchtretender Strahl wird reflektiert und intern verteilt. In der Computergrafik wird dies als Streuung unter der Oberfläche bezeichnet - die Verteilung von Licht unter der Oberfläche. Moderne Render-Engines, die die Funktionalität von Streuungsmaterialien unter der Oberfläche implementieren, können diesen Effekt physikalisch korrekt berechnen. Und vor 10 Jahren musste man es programmieren oder eine "Fälschung" in der Nachbearbeitung erstellen.

Jetzt ist der Prozess automatisiert und Sie müssen nur noch die Farbe und Textur der Haut manuell ändern. Darüber hinaus kann das Farbmanagement durch einen biologisch korrekten Mechanismus durchgeführt werden - durch Änderung des Melaningehalts im Hautmaterial. Moderne digitale Zwillinge sind so realistisch, dass Sie kaum verstehen können, dass Sie in einem bestimmten Rahmen den digitalen Menschen sehen und nicht Ihren Lieblingsschauspieler.

Willst du trainieren? Sehen Sie sich die SuperBobrovs-Serie mit dem Stern des Hundeherzens Vladimir Tolokonnikov an. Leider konnte der Schauspieler, der allen für seine Rolle als Polygraph Poligrafovich Sharikov bekannt ist, die Dreharbeiten aufgrund eines Herzstillstands nicht abschließen. Alle fehlenden Szenen wurden also von seinem Avatar gespielt.

Schwerwiegende Fortschritte bei der Schaffung digitaler Zwillinge sind auch mit der Entwicklung der Rechenleistung verbunden. Wenn früher zur Berechnung einer Sequenz mit digitalem Zeichen ganze Farmen von Prozessoren und RAM benötigt wurden, wird jetzt auf einem Heimspielcomputer alles berücksichtigt - langsam aber sicher. Ich denke also, Antony Proximo könnte von drei von uns in ungefähr einem Monat gerendert werden. Wenn wir auch die Erstellung eines dreidimensionalen Modells berücksichtigen (der zeitaufwändigste und teuerste Teil der Arbeit), würde die Gesamtdauer des Projekts 2 bis 2,5 Monate betragen und das Budget könnte auf 100.000 USD begrenzt werden.

Business Content Factory

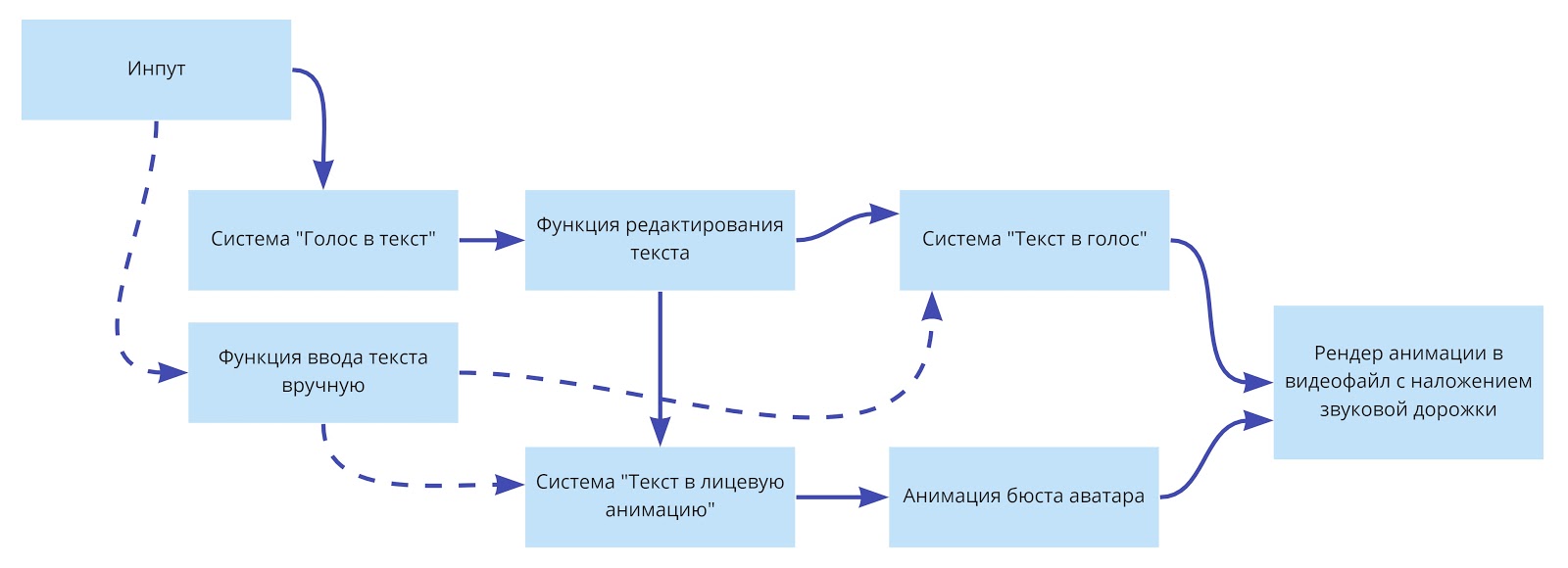

Fortschritte bei Technologien zur Erstellung fotorealistischer Modelle von Menschen gehen mit einem Sprung in der Entwicklung neuronaler Netze einher, mit denen Sie 3D-Modelle steuern können. Zusammen bildet dies die Grundlage für eine breitere Anwendung des digitalen Menschen. Durch die Kombination eines 3D-Modells mit neuronalen Netzen oder einem Chat-Bot können Sie eine ganze Fabrik für die Produktion von Videoinhalten organisieren: Sie „füttern“ den Text und Ihr Avatar liest ihn mit Mimik und Emotionen vor. Die Entwicklung eines solchen Szenarios ist bereits auf dem Markt , es werden jedoch keine 3D-Modelle verwendet, sondern Fotos von realen Personen.

Wenn man sich die Nachrichtensprecher auf Bundeskanälen ansieht, denken viele, dass sie so funktionieren. Nein, die Moderatoren lesen den Text nicht nur mit Mimik und Emotionen, sondern schreiben ihn auch für sich. Und in Zukunft können neuronale Netze natürlich Text für TV- und Videoblogs "schreiben" und Avatare können sie aussprechen. Und wenn Sie Berichte organisieren, können Sie auch Geld sparen - senden Sie nur den Bediener auf die Website und überlagern Sie einen Avatar-Stand-up mit dem Text, den der Editor auf das bereits gefilmte Videomaterial geschrieben hat.

Wir bei LANIT-Integration sind der Meinung, dass zwei Bereiche des Einsatzes digitaler Human-Technologien am vielversprechendsten sind.

Das erste ist, das Gesicht einer Person durch ein Video zu ersetzen.... Wahrscheinlich hat jeder bereits die Klone von Elon Musk gesehen, die sich mit Zoom-Konferenzen verbunden haben. Dieses Szenario heißt Deep Fake und wird, wie der Name schon sagt, für alle Arten von Fälschungen verwendet. Technologisch wird die gleiche Richtung auch als Face Swap bezeichnet, aber dieses Szenario gilt nicht mehr für schwarze PR, sondern für kommerzielle Zwecke, die keine ethischen Kontroversen hervorrufen. Sie können beispielsweise die Produktion von Bildungsinhalten debuggen.

Eine Bank mit einem Filialnetz des Bundes verfügt über viele Schulungsvideos unterschiedlicher Qualität. Einige von ihnen sind nur Aufzeichnungen von Zoom-Konferenzen. Die geringe Qualität des Videos und die Situation im Frame, die nicht dem Unternehmensstandard entspricht, erlauben es nicht, sie in einem einzigen Schulungskurs zusammenzufassen. Mit Hilfe von digitalen Avataren und neuronalen Netzen können Sie alles reparieren - sowohl den Hintergrund als auch das Erscheinungsbild des Sprechers ändern.

Ein ähnliches Szenario für die Erstellung von Videoprodukten ist für TV und Blogger interessant. Kürzlich wurden wir vom Produzenten eines thematischen Kanals kontaktiert und gebeten, die Kosten für die Produktion regelmäßiger Ausgaben mit einem digitalen Avatar als Moderator abzuschätzen. Natürlich wird Digital Human nicht alle Probleme lösen - es gibt immer noch keine Technologie, die es einem Avatar ermöglicht, Emotionen bei der Verarbeitung von Text durch ein neuronales Netzwerk zu reproduzieren -, dafür benötigen Sie immer noch eine lebende Person, deren Mimik und Bewegungen der Avatar verwendet. Darüber hinaus benötigen Sie einen Spezialisten, der das Schreiben von Skripten und Texten für die Sprachausgabe übernimmt. Es wird zwar völlig unwichtig, wie Menschen aussehen, die an der Produktion von Medieninhalten beteiligt sind, welches Geschlecht sie haben, wie ihre Klangfarbe ist und wo sie sich befinden. Zum Aufnehmen benötigen Sie einen Anzug für die Bewegungserfassung, einen Helm mit einer auf das Gesicht gerichteten Videokamera (um Gesichtsausdrücke zu "erfassen").und der Avatar selbst, der in Echtzeit alle Bewegungen des Offscreen-Arbeiters auf dem Bildschirm überträgt. Nach unseren Berechnungen wird diese Technologie die Kosten für die Videoproduktion um das Zehnfache senken.

Die zweite Richtung der Digital Human-Anwendung besteht darin , einen digitalen Avatar mit einem Chatbot und einem Sprachsynthesesystem zu kombinieren , und die Kommunikation mit Kunden kann sehr gefragt sein.

Chatbots werden heute in vielen Call Centern verwendet. Aber nicht alle Kunden können problemlos mit einem Roboter kommunizieren. Vielleicht wäre die Kommunikation angenehmer, wenn der Kunde seinen digitalen Gesprächspartner sehen würde.

Durch Verschrauben eines Chatbots, eines Mikrofons und eines Spracherkennungs- und Synthesesystems mit einem digitalen Avatar können Sie virtuelle Hostessen, Verkaufsberater und Berater in Regierungsinstitutionen erstellen ( Soul Machines hat einen ähnlichen Fall - die virtuelle Assistentin Ellakommuniziert mit Besuchern des neuseeländischen Polizeipräsidiums), Sommeliers - im Allgemeinen allen Mitarbeitern, deren Hauptaufgabe darin besteht, einfach Kundenfragen zu beantworten. Theoretisch können so Lohn- und Gehaltseinsparungen und Mitarbeiter eingespart werden, um das zu tun, was das neuronale Netzwerk noch nicht kann.

Experimente mit dem Aussehen

Die Basis für alle oben genannten Szenarien ist also ein digitaler Avatar. Ich habe bereits gesagt, dass seine Schaffung ein sehr mühsamer Prozess ist. Tatsächlich handelt es sich um eine virtuelle menschliche Skulptur, die von einem 3D-Bildhauer hergestellt wurde. Er arbeitet alle Details des Aussehens durch und "wächst" dann mit Simulationswerkzeugen das Haar.

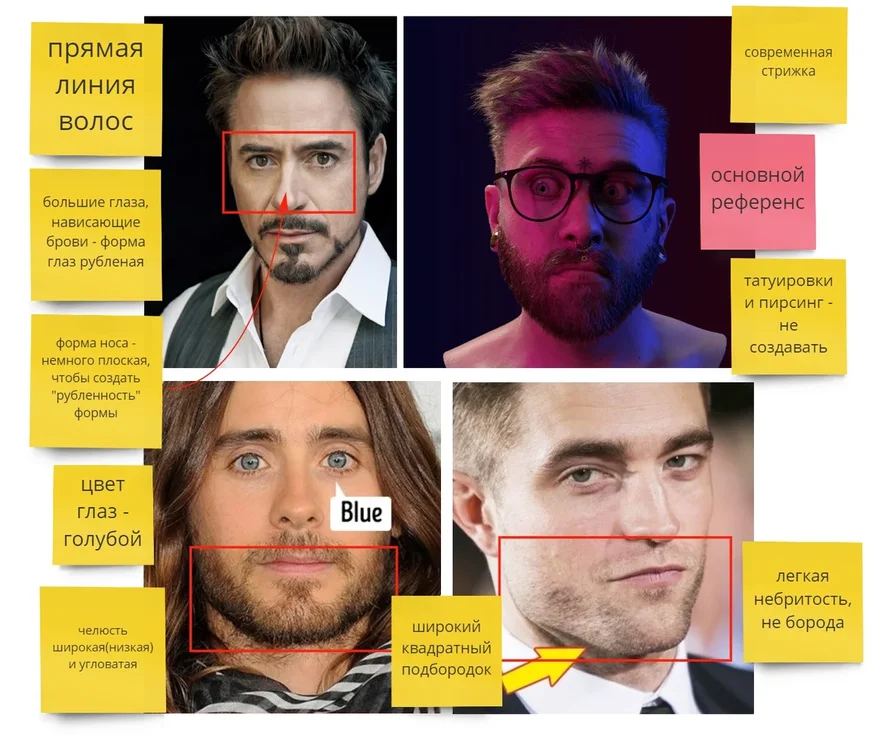

Fragen zum Aussehen treten nicht auf, wenn Sie eine Kopie einer Berühmtheit oder eines Models erstellen. Was ist, wenn Sie eine virtuelle Person von Grund auf neu erstellen müssen? Welche Eigenschaften wirst du ihm geben?

Als Experiment haben wir beschlossen, unseren eigenen digitalen Avatar zu erstellen - den LANIT-Botschafter. Natürlich können Sie alle Ihre Kollegen fragen, wie er aussehen soll. Aber erstens ist eine Umfrage unter mehreren tausend Menschen bereits zu viel, und zweitens müssten wir basierend auf diesen Daten einen zweiten Ken für Barbie erstellen - ein angenehmes verallgemeinertes Bild, völlig ohne Individualität. Nein, wir brauchen überhaupt keinen solchen Botschafter. Wir sind einen anderen Weg gegangen.

Jeder von uns hat im Laufe der Jahre eine Reihe von Stereotypen gebildet. Zum Beispiel ist ein dicker grauer Bart mit einer guten Disposition (wie dem Weihnachtsmann), breiten und geraden Augenbrauen verbunden - mit Geradlinigkeit und dominierendem Charakter usw.

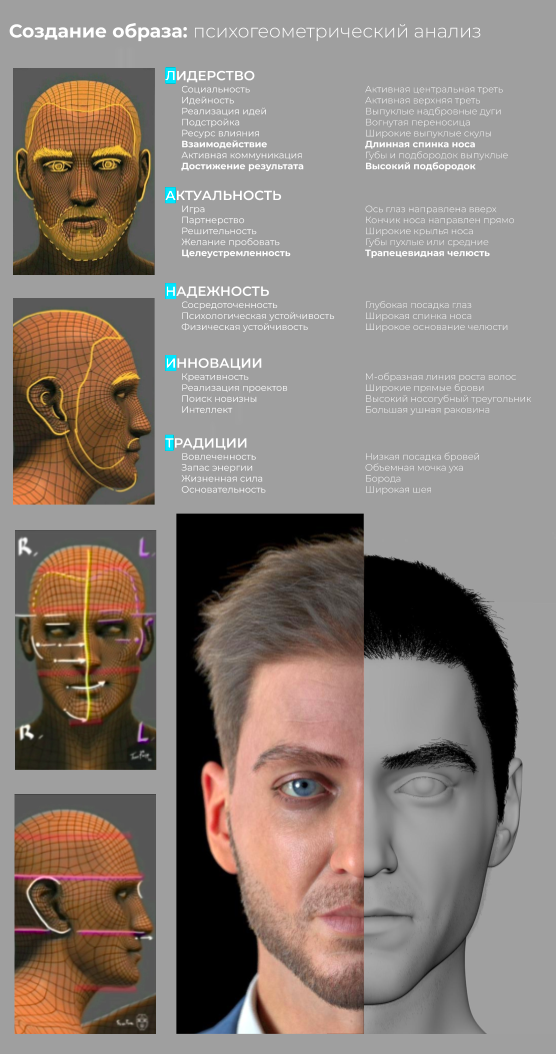

Wir haben eine Expertise in der Gesichtspsychogeometrie aufgebaut und das neuronale Netzwerk trainiert, um anhand von Wahrnehmungsmustern die Beziehung zwischen dem Aussehen einer Person und dem Eindruck zu identifizieren, den sie macht. Jetzt analysiert sie die Merkmale des Aussehens und gibt eine Reihe von Wörtern heraus, die beschreiben, wie eine Person anderen erscheinen kann, zum Beispiel freundlich, verletzlich, unsicher, ruhig usw. Wir nahmen diese Entwicklungen und begannen den Prozess in umgekehrter Reihenfolge - wir gaben dem neuronalen Netzwerk eine Beschreibung unseres zukünftigen Helden (wie die Zielgruppe ihn wahrnehmen sollte) und erhielten eine Reihe von Gesichtszügen.

Lassen Sie mich gleich einen wichtigen Vorbehalt machen: Wir behaupten in keiner Weise, für unser Experiment wissenschaftlich gültig zu sein. Darüber hinaus gibt es viele Untersuchungen, die bestätigen, dass es gefährlich ist, nach Beziehungen zwischen Gesichtszügen und beispielsweise Charakter oder (Gott bewahre) Intelligenz zu suchen. Wir erforschen also nicht das wissenschaftliche Gebiet, sondern die Möglichkeiten der Technologie.

Also haben wir neuronale Netze mit menschlichen Qualitäten „gespeist“, die den Merkmalen des Unternehmensgeistes entsprechen: Führung, Innovation, Zuverlässigkeit, Engagement usw.

Und selbst eine solch selektive Auswahl der notwendigen Eigenschaften führte dazu, dass wir einen völlig neutralen Charakter haben, der keine Emotionen hervorruft. Daher mussten die Ergebnisse, die das neuronale Netzwerk uns lieferte, manuell korrigiert werden.

Das Gesicht und im Allgemeinen alle Computergrafiken bestehen aus drei Komponenten:

- 3D-, ;

- , , ;

- ( , ).

1.

Kopf

Um Maxim (wie wir unseren Avatar nannten) zu erstellen, haben wir die vereinfachte Form eines menschlichen Kopfes zugrunde gelegt und die Details (Skulptur) in Zbrush geformt. Zunächst wurde ein High-Poly-Modell erstellt, in dem die kleinsten Details einschließlich der Poren auf der Haut herausgearbeitet wurden (dafür wurden Texturen entwickelt).

Wir verwenden 4K-Texturen. 8K-Texturen liefern bei Nahaufnahmen ein besseres Ergebnis, aber die Notwendigkeit ist selten. Daher haben wir uns aus Gründen der Leistung geweigert, 8K-Texturen zu verwenden. Nachdem das High-Poly-Modell fertig ist, erstellen wir eine Low-Poly-Kopie davon und übertragen kleine Details mithilfe normaler Karten (Oberflächen- "Extrusions" -Karten) darauf.

Haar

Es gibt viele Werkzeuge zum Erstellen von Haaren. Wir haben GroomBear für Houdini ausgewählt, um den Software-Stack flach zu halten - der größte Teil der technischen Arbeit wird in Houdini erledigt.

Kleidung.

Marvelous Designer wurde zum Modellieren von Kleidung verwendet, und Falten und kleine und charakteristische Details wurden in Blender vervollständigt.

2. Texturierung

Wir führen Texturen in Substance Painter durch - unserer Meinung nach bieten seine Werkzeuge den einfachsten und schnellsten Texturierungsprozess. Ein wichtiger Punkt ist der Hinweis : Um das Bild des Avatars zu korrigieren, reicht es aus, nur die Textur der Haut zu ändern, ohne die geometrische Basis zu berühren. Für Make-up-Liebhaber ist dies jedoch überhaupt kein Geheimnis. Chinesische Frauen erzielen mit Hilfe von Kosmetika täglich eine Wirkung, die mit der plastischen Chirurgie vergleichbar ist. Und für Avatare bedeutet eine so einfache Änderung des Erscheinungsbilds große Einsparungen bei der Produktion von Videoinhalten - drei Klicks, und das Bild Ihres Charakters hat sich dramatisch verändert - so sehr, dass es sich bereits um eine völlig andere Person handelt.

3. Animation

Unser Charakter ist auf Motion Capture-Systeme abgestimmt: den Xsense Body Mockup Suit und das Dynamixyz Face Mockup System. Wir haben keine optischen Bewegungserfassungssysteme verwendet, da diese sehr sperrig und nicht mobil sind, was bedeutet, dass der Prozess der Inhaltserstellung wesentlich mehr Einschränkungen unterliegt.

Xsense steuert die Bewegungen von Rumpf, Kopf und Gliedmaßen. Das Animationssystem ist hybride: Große Geometriearrays werden durch Knochen gesteuert, die wiederum durch die Daten des Mocap-Systems gesteuert werden, und Kleidungsfalten im Bereich der Gelenke und andere charakteristische Stellen werden durch Hilfsmischformen (Zustände des Modells mit charakteristischen Falten im Bereich der Gelenke) gesteuert, die einen korrekten Betrieb gewährleisten Geometrie, bei der die Knochenanimation nicht das richtige Ergebnis liefert.

Die Notwendigkeit, Mischformen zu erstellen, ist das Hauptproblem bei der Erstellung der Garderobe eines Charakters - es ist mühsam. Für jedes neue Kleidungsstück muss der Künstler Dutzende von Mischformen erstellen. Wir suchen aktiv nach Möglichkeiten, diese Routine zu automatisieren. Wenn Sie Ideen oder vorgefertigte Lösungen haben, werde ich diese gerne in den Kommentaren mit Ihnen besprechen.

Dynamixyz verwaltet Gesichtsanimationen, und das Einrichten von Gesichtsanimationen ist der schwierigste und zeitaufwändigste Teil der Pipeline. Tatsache ist, dass 57 Muskeln unter der Haut des Gesichts verborgen sind (25% der Gesamtzahl der Muskeln im menschlichen Körper) und die Bewegung jedes einzelnen von ihnen den Gesichtsausdruck beeinflusst.

Das Erkennen von Gesichtern und Emotionen ist eine äußerst wichtige Fähigkeit, die für die Existenz in der Gesellschaft erforderlich ist, sodass Menschen unplausible Gesichtsausdrücke sofort erfassen. Für den Avatar müssen Sie also eine Gesichtsanimation erstellen, die zu 100% realistisch ist.

Jedes Gesicht kann unendlich viele Ausdrücke haben, aber wie die Praxis gezeigt hat, reichen 150 Mischformen aus, um eine realistische Animation zu erstellen. Wir sind etwas weiter gegangen und haben 300 Mischformen erstellt (und erstellen weiterhin neue, wenn wir Situationen finden, in denen 300 nicht ausreichen).

Dynamixyz arbeitet nach folgendem Prinzip: Dem Schauspieler wird ein Helm auf den Kopf gesetzt, auf dem Spezialkameras mit extrem hohen Datenübertragungsraten befestigt sind. Das Video von diesen Kameras wird an die Workstation gesendet, wo das neuronale Netzwerk die Ankerpunkte auf dem Gesicht des Schauspielers bestimmt und sie in jedem Bild mit den Ankerpunkten auf der virtuellen Gesichtsmaske vergleicht, wodurch es sich bewegt. Ein System von Mischformen ist an die Bewegungen der Gesichtsmaske gebunden, die entsprechend der Art der Bewegung der Gesichtsmaske "umschalten". Jede Mischform wird für das gesamte Gesicht als Ganzes erstellt, kann jedoch während der Animation lokal umgeschaltet werden, z. B. im Bereich des Mundes oder des rechten Auges, getrennt vom Rest des Gesichts. Diese Schalter sind glatt und für das Auge völlig unsichtbar.

Es gibt alternative, weniger arbeitsintensive Gesichtsanimationssysteme, wie das kürzlich von der Sberbank patentierte. Die Reduzierung der Arbeitskosten geht jedoch zu Lasten von Qualität und Flexibilität, weshalb wir den Einsatz solcher Technologien aufgegeben haben.

4. Rendern

Unser Maxim lebt in Unreal Engine und Houdini.

In Unreal Engine (UE) rendern wir Animationen, die keine komplexe Nachbearbeitung erfordern, da das UE nicht die vollständigen Kanäle und Masken abruft, die für die Nachbearbeitung am Ausgang erforderlich sind, und auch eine Reihe von Einschränkungen aufweist (z. B. ist es nicht möglich, die richtige Haarmaske zu erstellen dass das UE nicht weiß, wie man die Masken durchscheinend macht). Wir haben einige Zeit mit Echtzeit-Raytracing (RTX) experimentiert, aber da wir keine signifikante Verbesserung der Bildqualität erhalten haben, haben wir die Verwendung aufgegeben.

Wir verwenden Arnold zum Rendern in Houdini. Dies ist ein CPU-Rendering, und es funktioniert im Vergleich zu GPU- und RealTime-Engines ziemlich langsam, aber die Wahl fiel darauf, da Vergleichstests zeigten, dass Sub Surface Scattering-Materialien (und das Hautmaterial ist genau das) und das Haarmaterial in Arnold funktionieren Die Reihenfolge ist besser als bei Rotverschiebung und Oktan, und Röntgenstrahlen erzeugen leider willkürlich Artefakte auf Materialien mit unterirdischer Streuung.

5. Interaktiv

Die aus unserer Sicht vielversprechendste (aber auch schwierigste) Entwicklungsrichtung für digitale Avatare ist die Kombination mit Softwareprodukten - Sprachassistenten, Chat-Bots, Speech2text-Systemen usw. Diese Integrationen öffnen die Tür zum Aufbau skalierbarer Produkte. Wir arbeiten derzeit aktiv in dieser Richtung und bauen Hypothesen und Prototypen auf. Wenn Sie Ideen für die Verwendung digitaler Avatare auf diese Weise haben, würde ich diese gerne diskutieren.

Süß oder ekelhaft? Bewegung verstärkt diesen Effekt.

Vielleicht erinnert dich Maxim an jemanden, den du kennst. Oder vielleicht haben Sie gestern mit einer ähnlichen Person verhandelt. War er süß oder nervig mit seiner Art zu kommunizieren? In jedem Fall ruft das Bild von Maxim Emotionen hervor.

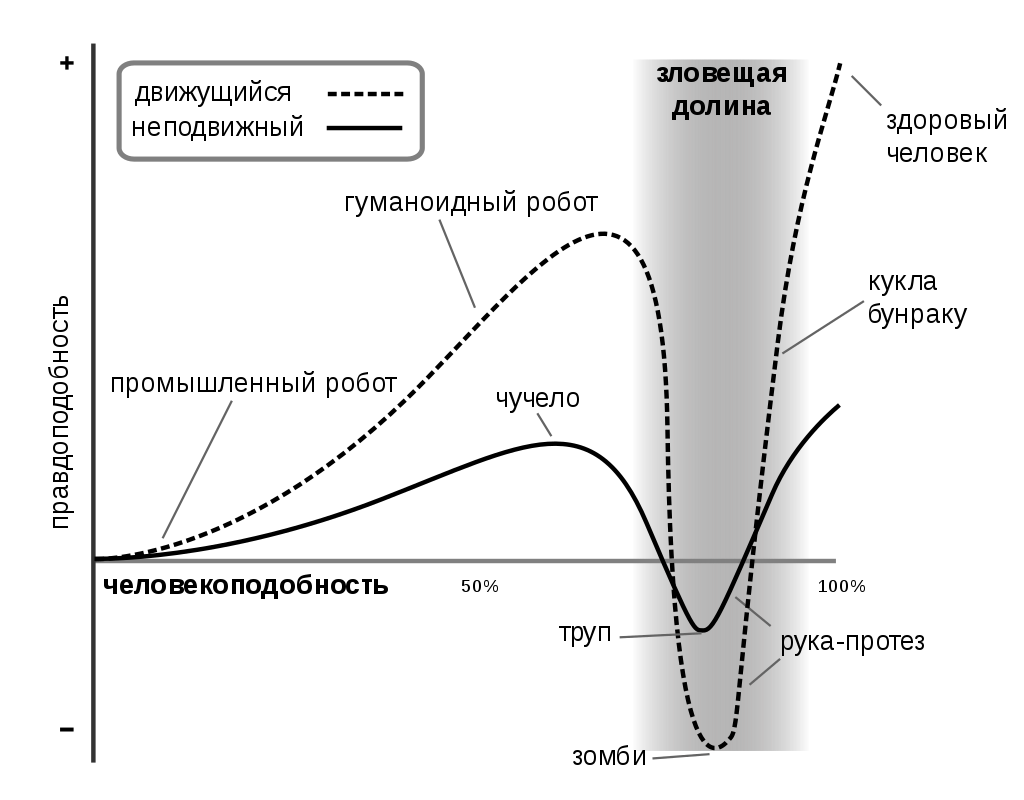

Bei der Erstellung haben wir aus eigener Erfahrung die Wirkung von "Evil Valley" getestet, die vom japanischen Masahiro Mori beschrieben wurde, der die Wahrnehmung humanoider Roboter durch Menschen untersuchte. Dies wird im Wiki detailliert beschrieben, aber kurz gesagt: Je mehr ein Roboter einem Menschen ähnelt, desto mehr Sympathie empfinden wir dafür. Dieser Effekt wächst bis zu einem bestimmten Punkt. Wenn ein Roboter von einer Person kaum zu unterscheiden ist, fühlen wir uns beim Betrachten unwohl und sogar ängstlich - alles nur, weil dem Roboter die kleinsten Details gegeben werden, die wir meistens nicht einmal identifizieren und benennen können. Diese abrupte Änderung unserer Reaktionen (entspricht dem Versagen in der Grafik) wird als "Evil Valley" bezeichnet. Gleichzeitig verstärkt die Animation sowohl die negativen als auch die positiven Effekte. Wie aus der Grafik ersichtlich, kann eine vollständige Ähnlichkeit mit einer Person nur mit Hilfe der Animation erreicht werden.

Also hat unser Maxim das "Ominous Valley" überquert, aber eine Nuance wirkt sich negativ auf seine Wahrnehmung aus - ohne Animation hat er überhaupt keinen Gesichtsausdruck, alle Gesichtsmuskeln sind entspannt, was bei einem lebenden Menschen nicht der Fall ist. Daher sieht er sehr distanziert aus, sieht den Gesprächspartner nicht an, sondern wie durch ihn, was sehr unangenehm ist.

Maxim scheint uns ein würdiger Vertreter der Avatar-Familie zu sein. Da Digital Human immer beliebter wird, freuen wir uns darauf, dass unsere Kunden und Partner bald beschließen, einen Avatar für Marketingzwecke zu erwerben. Dann wird Maxim vernünftige Brüder und Schwestern haben - natürlich künstlich.

In der Zwischenzeit untersucht allein Maxim die Möglichkeiten, die der B2B-Markt für digitale Avatare eröffnet: Im Oktober 2020 wird er an der Konferenz teilnehmen„Smart Solutions - Smart Country: Innovative Technologien für eine neue Realität“ und die Ausstellung Disartive Digital Art werden die Produkte und Dienstleistungen von LANIT in sozialen Medien bewerben und möglicherweise mehrere Interviews geben.

Der aufstrebende Markt für Digital Human

In Russland gibt es Unternehmen, die in eine ähnliche Richtung wie wir arbeiten. Aber nicht alle sind öffentlich - viele interagieren mit Gamedev-Studios und machen Charaktere für Spiele (und diese Welt lebt nach ihren eigenen Regeln, und sehr oft verwenden Studios das Hollywood-Modell, ohne ihre Auftragnehmer offenzulegen).

Das bekannteste Unternehmen ist vielleicht Malivar , in das die Sberbank 10 Millionen Rubel investiert hat. Sie besitzt die virtuelle Figur Aliona Pole - eine Künstlerin, Model und Autorin von Sammlungen "digitaler Kleidung".

In Sekundenbruchteilen tauscht ein digitales Modell eine rote Bluse gegen eine blaue aus und probiert neue Looks an, ohne die Bewegung anzuhalten. Und der Zuschauer, der auf Instagram Stories und TikTok aufgewachsen ist, freut sich, kurze Videos mit einer fantastischen Anzahl von Transformationen anzusehen, die einem lebenden Model nicht zur Verfügung stehen.

Aliona entfernt sich allmählich vom Bild eines Modells und erwirbt auf ihrem Instagram alle neuen menschlichen Eigenschaften. Sie fördert eine umweltfreundliche Haltung gegenüber der Welt, philosophiert über das Thema Persönlichkeitsgrenzen, mischt gewöhnliche und virtuelle Realität und „ertrinkt“ für Individualität und Körperpositivität.

Auf dem Weltmarkt gibt es ein interessantes digitales Avatar-Projekt: Samsung - Neon... Natürlich sind die Entwickler noch weit davon entfernt, eine neue Lebensform zu schaffen, aber sie haben ihren 3D-Modellen beigebracht, sich gut zu bewegen. Dank einer Schnittstelle, die Sprache in Text umwandeln kann, analysiert das Modell eingehende Informationen, wandelt sie in Lösungen um und gibt interne Befehle zum Bewegen der Hände und anderer Körperteile. Auf der CES 2019 präsentierte das Unternehmen Avatare einer Krankenschwester, eines Fernsehmoderators, eines Nationalpark-Scouts, eines Fitnesstrainers und mehrerer anderer. Ich habe

über das neuseeländische Projekt geschrieben, um oben Soulmachines- Assistenten zu schaffen . Wahrscheinlich gibt es andere Projekte, die Aufmerksamkeit verdienen, aber sie haben nur wenige wichtige Newsfeeds, obwohl ernsthafte Fonds jetzt in die Entwicklung digitaler Avatare investieren.

Was denkst du über Avatare? Ich würde gerne meinen digitalen Klon haben, um an Zoom-Meetings teilzunehmen und mit dem Chef zu kommunizieren, und natürlich eine Reihe digitaler Kleidung - immer ein gebügeltes Hemd, eine Jacke, eine Krawatte - alles.