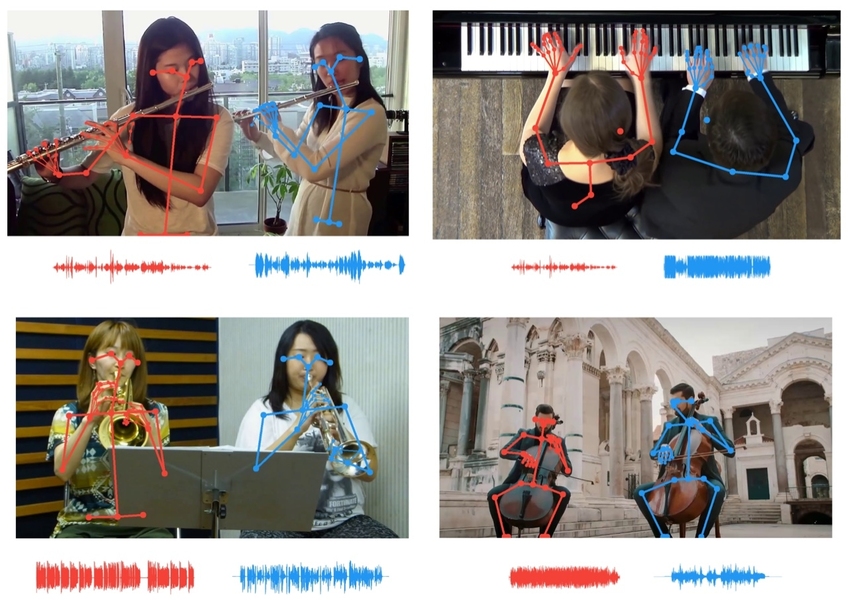

Ein auf künstlicher Intelligenz basierendes Tool zur Erkennung musikalischer Gesten, das am MIT-IBM Watson AI Lab entwickelt wurde, verwendet Körperbewegungen, um zwischen den Klängen einzelner Musikinstrumente zu unterscheiden.

Bild mit freundlicher Genehmigung der Forscher.

Die Forscher verwenden Skelett-Schlüsselpunktdaten, um die Bewegungen der Musiker mit dem Tempo ihrer Parts zu korrelieren, sodass die Hörer Instrumente isolieren können, die gleich klingen.

Bild mit freundlicher Genehmigung der Forscher.

Wir genießen die Musik nicht nur mit unseren Ohren, sondern auch mit unseren Augen und beobachten dankbar, wie die Finger des Pianisten über die Tasten fliegen und der Bogen des Geigers auf dem Kamm der Saiten schwankt. Wenn das Ohr nicht in der Lage ist, zwei Musikinstrumente zu trennen, helfen uns unsere Augen, indem sie die Bewegungen jedes Musikers mit dem Rhythmus jedes Teils abstimmen.

Neues Tool für künstliche Intelligenz, entwickelt vom MIT-IBM Watson AI Labverwendet virtuelle Augen und Computerohren, um Geräusche zu trennen, die so ähnlich sind, dass es für eine Person schwierig ist, sie zu unterscheiden. Das Instrument wurde gegenüber früheren Iterationen verbessert, indem die Bewegungen einzelner Musiker unter Verwendung der wichtigsten Punkte ihres Skeletts an das Tempo einzelner Teile angepasst wurden, wodurch der Hörer den Klang einer einzelnen Flöte oder Geige zwischen mehreren derselben Instrumente isolieren kann.

Mögliche Anwendungen für den Auftrag reichen vom Mischen von Ton und Erhöhen der Lautstärke eines Instruments in einer Aufnahme bis hin zum Verringern der Verwirrung, die dazu führt, dass sich Personen während Videokonferenzen gegenseitig unterbrechen. Die Arbeit wird diesen Monat auf der Computer Vision Pattern Recognition- Konferenz vorgestellt .

"Wichtige Punkte im Körper liefern aussagekräftige Strukturinformationen", sagte der Hauptautor Chuang Gang , ein Forscher im IBM-Labor. "Wir verwenden sie hier, um die Fähigkeit der KI zu verbessern, zuzuhören und Geräusche zu trennen."

In diesem und ähnlichen Projekten verwendeten die Forscher synchronisierte Audio-Video-Spuren, um die Art und Weise, wie Menschen lernen, nachzubilden. Ein künstliches Intelligenzsystem, das mit mehreren sensorischen Modalitäten lernt, kann schneller, mit weniger Daten und ohne manuelles Hinzufügen lästiger Verknüpfungen zu jeder realen Ansicht lernen. "Wir lernen von allen Sinnen", sagt Antonio Torralba, MIT-Professor und Mitautor der Studie. "Multisensorische Verarbeitung ist der Vorläufer von verkörperten Intelligenz- und künstlichen Intelligenzsystemen, die komplexere Aufgaben ausführen können."

Dieses Tool, das die Körpersprache verwendet, um Töne zu trennen, baut auf früheren Arbeiten auf, bei denen Bewegungshinweise in Bildsequenzen verwendet wurden. Die früheste Inkarnation, PixelPlayer, ermöglichte das Klicken auf ein Instrument in einem Live-Video, um es lauter oder leiser zu machen. Mit dem PixelPlayer- Update können Sie zwischen zwei Violinen in einem Duett unterscheiden, indem Sie die Bewegungen jedes Musikers mit dem Tempo seines Teils abgleichen. Diese neueste Version fügt wichtige Punktdaten hinzu (die Sportanalysten verwenden, um die Leistung von Athleten zu verfolgen und detailliertere Bewegungsdaten zu extrahieren), um nahezu identische Geräusche zu unterscheiden.

Die Arbeit hebt die Bedeutung visueller Hinweise für das Unterrichten von Computern hervor, damit diese besser hören können, und die Verwendung hörbarer Hinweise, um ihnen eine schärfere Sicht zu ermöglichen. So wie die aktuelle Studie visuelle Informationen über die Bewegungen eines Musikers verwendet, um Teile ähnlich klingender Musikinstrumente zu trennen, wurden in früheren Arbeiten Geräusche verwendet, um ähnliche Objekte und Tiere derselben Art zu trennen.

Torralba und Kollegen haben gezeigt, dass Deep-Learning-Modelle, die auf gepaarten Audio-Video-Daten trainiert sind, lernen können, natürliche Geräusche wie Vogelgezwitscher oder Wellen am Ufer zu erkennen. Sie können auch die geografischen Koordinaten eines sich bewegenden Fahrzeugs durch das Geräusch seines Motors und seiner Räder bestimmen, die sich auf das Mikrofon zu oder von diesem weg bewegen.

Die neuesten Forschungsergebnisse legen nahe, dass Audio-Tracking-Tools eine nützliche Ergänzung zu selbstfahrenden Autos sein könnten, um ihren Kameras bei schlechten Sichtverhältnissen zu helfen. „Soundtracker können besonders nachts oder bei schlechtem Wetter nützlich sein und dazu beitragen, Fahrzeuge zu markieren, die sonst möglicherweise übersehen worden wären“, sagt Hang Zhao, Ph.D. '19, der an der Erforschung von Bewegung und Soundtracking beteiligt war.

Andere Autoren der CVPR-Studie über musikalische Gesten sind Deng Huang und Joshua Tenenbaum vom MIT.

Das ist alles. Um mehr über den Kurs zu erfahren, laden wir Sie ein, sich unter dem folgenden Link für den Tag der offenen Tür anzumelden:

Weiterlesen:

Wie ich meinem Computer beigebracht habe, Doble mit OpenCV und Deep Learning zu spielen