Weltmeister Garry Kasparov besiegte 1996 den IBM Deep Blue-Computer, wurde jedoch 1997 mit 4: 2 besiegt.

Der Sieg des IBM Deep Blue-Computers 1997 über den Großmeister und Weltmeister Garry Kasparov gilt als triumphaler Wendepunkt in der Geschichte der Technologie, vergleichbar mit der Landung auf dem Mond. Sie scheint gezeigt zu haben, dass Computer Menschen in dem schlagen können, was für uns einzigartig war: Denken 1 . Die symbolischen KI-Technologien, die vom DeepBlue-Computer verwendet werden, gelten heute als veraltet, insbesondere für komplexere Spiele wie go, die vor zweieinhalbtausend Jahren in China erfunden wurden. Im Jahr 2016 wurde Weltmeister Lee Sedol vom DeepMind AlphaGo AI-System von Google besiegt. Der Forscher und Risikokapitalgeber Li Kaifu nannte diese Veranstaltung "Sputnik Moment" für China 2: Er glaubt, dass dies China dazu veranlasst hat, Milliarden von Dollar in KI-Forschung zu investieren, um die Vereinigten Staaten aufzuholen und vielleicht sogar zu übertreffen. Der Sieg von AlphaGo zeigt das Aufblühen eines neuen KI-Paradigmas - Deep Learning und neuronale Netze -, das im Zentrum der modernen KI-Revolution steht.

Warum waren Spiele wie Schach und Go in der Geschichte der KI so wichtig? Die Pioniere der Forschung im Bereich der künstlichen Intelligenz, darunter Herbert Simon, Allen Newell, John McCarthy und Marvin Minsky, betrachteten die menschliche Intelligenz durch das traditionelle Prisma der westlichen Philosophie, dessen Grundlagen von Aristoteles gelegt wurden. Diese männliche, eurozentrische Sichtweise der Intelligenz, die in der kartesischen Trennung von Geist und Körper verwurzelt ist, priorisierte die Fähigkeiten des Gehirns - Logik, Mathematik und die Fähigkeit, Probleme auf Kosten körperlicher, emotionaler, sozialer und kultureller Formen der Intelligenz zu lösen. Sie glaubten, wenn die Vernunft (d. H. Die Logik) den Menschen vom Tier unterscheidet, sollte die Logik die Grundlage der Intelligenz sein.

Blaise Pascal war Philosoph und Mathematiker. In den 1640er Jahren erfand er eine Maschine, die zusätzliche Leistungen erbringen konnte, um seinem Vater, einem Steuereintreiber, zu helfen.

Viele westliche Philosophen und Mathematiker, von Blaise Pascal bis George Boole und Bertrand Russell, haben versucht, die Berechnung / Logik, die sie mit dem Denken selbst gleichsetzten, entweder mathematisch strenger ("formaler") oder den nächsten Schritt zu machen - sie zu mechanisieren. Pascal selbst baute zu diesem Zweck eine Rechenmaschine, und der Höhepunkt dieses Impulses des westlichen Denkens war die Erfindung des digitalen Computers im 20. Jahrhundert. Die Pioniere der KI-Forschung in den 1950er und 1960er Jahren sahen in Spielen eine weitere Möglichkeit für den Menschen, Intelligenz durch Lösen von Problemen zu demonstrieren. Wenn KI-Forscher simulieren könnten, wie Spieler dies tun, könnten sie diesen Prozess automatisieren. Der Zweig der Mathematik namens Spieltheorie, der auf Wirtschaft und Militär angewendet wird, wurde vom Mathematiker und Computerpionier John von Neumann gegründet.Es ermöglichte die Optimierung von Strategien und Algorithmen, die in der Informatik weit verbreitet sind. Der KI-Forschungspionier Herbert Simon hat diese Theorien sowohl auf die Informatik als auch auf die Wirtschaft angewendet (in denen er den Nobelpreis gewann). Daher war die Idee, dass Spiele Aspekte der realen Welt ernsthaft modellieren können, von zentraler Bedeutung für die frühen Tage der Informatik. Insbesondere weil frühe Computer Schwierigkeiten hatten, die Komplexität der realen Welt zu simulieren, wurden Spiele als vereinfachte "Mikrowelt" angesehen, deren Einschränkungen und Regeln von den Computern gut verstanden wurden, die in den 1960er Jahren schnelle Fortschritte ermöglichten.Folglich war die Idee, dass Spiele Aspekte der realen Welt ernsthaft simulieren können, von zentraler Bedeutung für die Anfänge der Informatik. Insbesondere weil frühe Computer Schwierigkeiten hatten, die Komplexität der realen Welt zu simulieren, wurden Spiele als vereinfachte „Mikrowelt“ angesehen, deren Einschränkungen und Regeln von Computern gut verstanden wurden, die in den 1960er Jahren schnelle Fortschritte ermöglichten.Daher war die Idee, dass Spiele Aspekte der realen Welt ernsthaft modellieren können, von zentraler Bedeutung für die frühen Tage der Informatik. Insbesondere weil frühe Computer Schwierigkeiten hatten, die Komplexität der realen Welt zu simulieren, wurden Spiele als vereinfachte „Mikrowelt“ angesehen, deren Einschränkungen und Regeln von Computern gut verstanden wurden, die in den 1960er Jahren schnelle Fortschritte ermöglichten.

Wolfgang von Kempelens Turok-Schachmaschine wird von einem lebenden Spieler gesteuert, der sich darin versteckt.

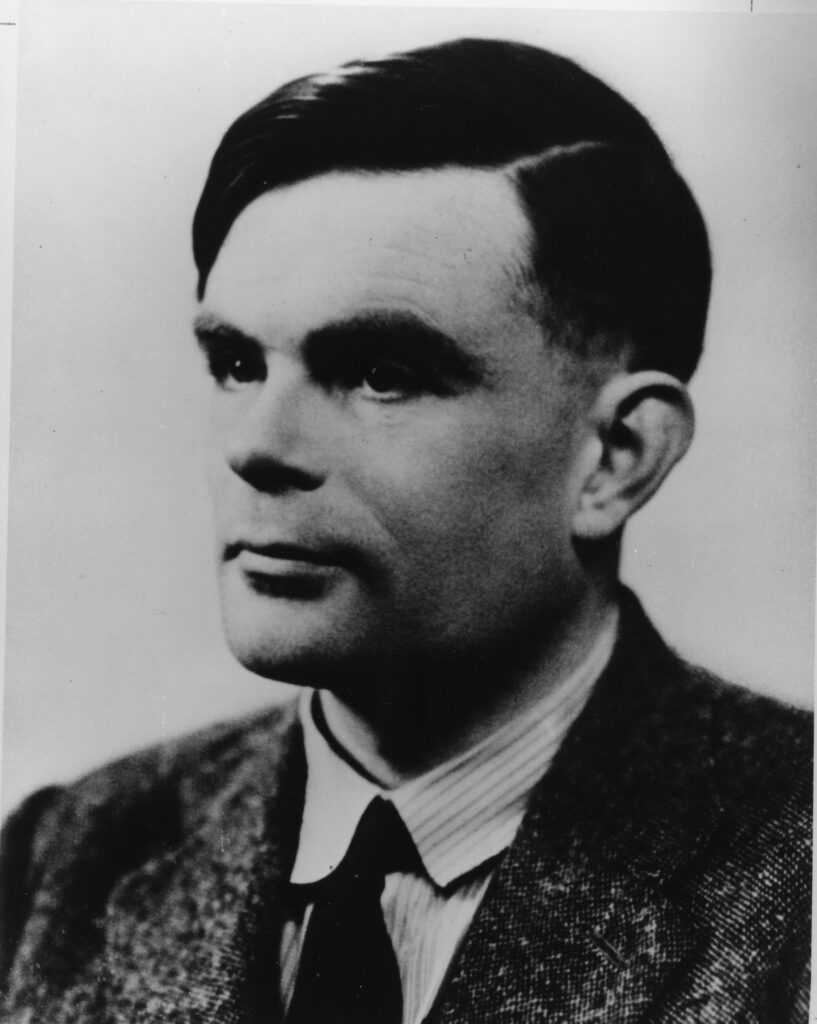

Insbesondere Schach wurde historisch als der Höhepunkt der intellektuellen Aktivität im Westen angesehen. Es war ein intellektuelles Spiel, das mit Logik und Strategie verbunden war. Denken Sie an Mr. Spock von Star Trekmenschliche Spieler im 3D-Schach besiegen. Schon im 18. Jahrhundert war die europäische Elite von der Idee von Maschinen fasziniert, die Schach spielen konnten. Wolfgang von Kempelen wurde berühmt für seinen "Mechanical Turk", eine Schachmaschine für die österreichische Kaiserin Maria Theresia, die Benjamin Franklin und Napoleon besiegte. Später stellte sich heraus, dass der "Türke" eine Fälschung war und sich ein lebender Spieler darin versteckte; Trotzdem erregte er die Fantasie von Edgar Allan Poe und Charles Babbage. Das Interesse am Schach als Indikator für Intelligenz erstreckte sich auf die Mathematiker, die im 20. Jahrhundert die Berechnungstheorie aufstellten: Alan Turing, Claude Shannon, John von Neumann, Norbert Wiener und natürlich die Pioniere der KI Herbert Simon, Allen Newell und John McCarthy. Insbesondere Newell und Simon betrachteten Schach als vorbildliche Herausforderung für die KI.Perfekt für ihre bevorzugte Lösung: Suche.

1947 .

MIT Bell Labs () 1950 , . MIT ( ). (. 1950 ).

, , 1980 .

Was ist Suche und wie können Sie sie beim Schachspielen verwenden? Im Zusammenhang mit KI bedeutet Suche nicht die Suche nach Text im Web mit Google (obwohl eine Websuchmaschine das Konzept der Suche in einem KI-Kontext verwenden kann). In der KI bezieht sich die Suche auf den Prozess des Versuchs und Irrtums beim Durchlaufen möglicher Lösungen für ein Problem. Die Suche ist eine der grundlegenden Methoden der klassischen KI, auch als "symbolische" KI bekannt, da solche Methoden das Manipulieren von Symbollisten beinhalten, beispielsweise wie bei algebraischen Problemen. Bei allen Arten von Problemlösungsprozessen, wie z. B. Theoremprüfung, Rätsellösung, Spiele und Labyrinthlösung, muss zunächst entschieden werden, was versucht werden soll. Diese Auswahlmöglichkeiten können als verzweigter Entscheidungsbaum modelliert werden.

.

-. , , - «».

Nehmen wir an, wir müssen eine Robotermaus erstellen, die nach einem Ausweg aus einem Labyrinth sucht (ungefähr das, was Claude Shannon 1950 getan hat). Wenn sie eine Kreuzung mit vier Türen trifft, kann sie sich nach rechts, vorwärts und links bewegen, aber es ist ihr verboten, zurück zu gehen. Dies gibt uns drei mögliche Möglichkeiten. Informatiker würden sagen, dass eine Maus einen „Verzweigungsfaktor“ von 3 hat. Der einfachste Weg, einen Computer so zu programmieren, dass er durch ein Labyrinth läuft (es löst), besteht darin, jede Option oder Verzweigung nacheinander zu überprüfen. Dies wird als Brute-Force-Suche bezeichnet: Wir testen jede Variation. Unsere Maus fährt jedoch natürlich zu einer weiteren Kreuzung, bevor sie die Möglichkeit erhält, zurückzukehren, um alle anderen Optionen an der ersten Kreuzung zu überprüfen. Jedes Mal erreicht sie eine neue KreuzungDie Maus kann zwischen drei weiteren neuen Pfaden wählen. Wir können die Anzahl der Kreuzungen festlegen, nach denen die Maus suchen kann, bevor wir zurückkehren und einen anderen Pfad ausprobieren.

Claude Shannon bewegt seine elektrische Maus in einem Labyrinth (um 1952).

Dies wird als Suchtiefe bezeichnet und im Zusammenhang mit Spielen als „Vorausschau“ bezeichnet. Wie Sie sehen, wächst die Anzahl der Pfade, die mit der Maus durchsucht werden müssen, sehr schnell: wie 3 (der Verzweigungsfaktor), multipliziert mit sich selbst so oft, wie wir den Entscheidungsbaum proaktiv überprüfen. Mit anderen Worten, das Problem wächst exponentiell. In der KI-Industrie wird dies oft als "kombinatorische Explosion" bezeichnet.

Das Schachbrett in frühen Theorien

Eine ähnliche Methode kann auch im Schach angewendet werden. Für jeden Zug eines Spielers haben wir die Wahl zwischen maximal 38 möglichen erlaubten Zügen, dh das Schachproblem hat einen Verzweigungsfaktor von 38. Um den besten dieser 38 Züge auszuwählen, wird eine quantitative Methode verwendet, um den relativen Vorteil einer Schachposition gegenüber einer anderen zu bewerten. Dies wird als "Bewertungsfunktion" bezeichnet. Das durchschnittliche Schachspiel dauert 42 Züge, und da es zwei Spieler gibt, muss dies mit zwei multipliziert werden, was ungefähr 38 84 ergibt - mehr als die Anzahl der Sterne im Universum. Schon in den frühen Stadien der Geschichte der KI wurde klar, dass eine solche Suche durch Brute-Force-Suche nach Schach und anderen Aufgaben auf der damaligen Ausrüstung einfach nicht funktionieren würde; Es gibt zu viele Optionen und Computer sind zu schwach. Claude Shannon war einer der ersten, der den Algorithmus verwendete "minimax "in einem Computerschachprogramm (dieser Algorithmus ist heute noch die Grundlage der meisten Schachprogramme), nachdem man festgestellt hat, dass man dank menschlichem Wissen und Erfahrung im Spiel schnell viele Zweige abschneiden kann, ohne sie anzusehen. Herbert Simon und Allen Newell schlugen vor," Heuristiken "zu verwenden, oder Faustregeln, die Menschen teilweise bei der Lösung von Problemen anwenden, meistens funktionieren sie, aber dies kommt nicht immer vor. Heuristiken sind die Art von menschlichem Wissen, das in einen Computer programmiert werden kann.

Schach

Schach hat viel mehr Zweige in seinem Entscheidungsbaum als Tic-Tac-Toe. Es wurde berechnet, dass die Anzahl der Varianten von Schachspielen ungefähr 10 120 entspricht , was mehr als die Anzahl der Atome im Universum ist.

Begrenzter Lookahead

Angesichts der großen Anzahl von Zweigen können Schachprogramme nur bis zu einer begrenzten Tiefe durch den Suchbaum blicken, da sonst die Suche für immer andauert.

Eine solche Heuristik, die sich im Schach als nützlich erwiesen hat, ist " Alpha-Beta-Cutoff"". Dies bedeutet, dass, wenn das Programm festgestellt hat, dass eine der Bewegungen vom Feind leicht kontert werden kann, nicht nach anderen Möglichkeiten gesucht werden muss, wie er derselben Bewegung entgegenwirken kann. Eine weitere Suche entlang dieses Pfades kann ignoriert werden, wodurch der gesamte Zweig vom Baum abgeschnitten wird Dies kann den Verzweigungsfaktor von 38 auf 6 und manchmal auf 3 erheblich reduzieren. Angesichts der Einschränkungen der Computer zu diesem Zeitpunkt konnten die meisten Programme nur 4 Schritte voraussehen. , wurde zwischen 1959 und 1962 von MIT-Student Alan Kotok unter der Leitung von John McCarthy erstellt. Das Kotoka-McCarthy-Programm verwendete Alpha-Beta-Clipping.

, IBM 7090 . , - . 1967 , , 3-1 .

1959 MIT , . , , . . 1962 .

Newell und Simon glaubten, dass alle KI-Probleme wie Schach durch Suchen in Kombination mit Heuristiken oder "heuristische Suche" gelöst werden könnten. Die heuristische Suche war die zentrale Idee hinter Newells und Simons frühen Durchbrüchen, dem Logiktheoretiker und allgemeinen Problemlöser, und wurde zu einer entscheidenden Säule in ihrer Theorie, dass Intelligenz für Mensch und Maschine in der einfachen Manipulation von Symbolen, den Grundbausteinen, liegt. Mathematik und Sprache. Diese Hypothese des "physischen Symbolsystems" wurde zur Prämisse, auf der das gesamte Projekt der symbolischen künstlichen Intelligenz von seiner Gründung in den 1950er bis zu den frühen 2000er Jahren basierte. Diese Theorie, die die Äquivalenz des "Gehirns" von Computern und Menschen postulierte, ist in der kognitiven Psychologie äußerst einflussreich geworden.und später sogar in die Popkultur gekommen, dank Arbeiten im Cyberpunk-Genre, in denen Menschen ihr Gehirn ins Internet hochladen oder durch Chips ersetzen konnten.

() , -, Logic Theorist, General Problem Solver NSS ( --). JOHNNIAC RAND.

Computer wurden schneller und Informatiker, die selbst erfahrene Schachspieler waren, wie Richard Greenblatt und Hans Berliner, erstellten ihre eigenen Schachprogramme. Sie stellten fest, dass die ersten Schachprogramme (wie das von Kotok geschriebene) äußerst schlecht spielten, und fügten ihren Programmen ihr eigenes Wissen darüber hinzu, wie Live-Spieler das Spiel angehen. Dieses Wissen bestand aus zusätzlichen Heuristiken, um die Schätzung der Position von Stücken, Datenbanken mit Eröffnungszügen und Endspielen sowie Erkennern von Mustern des Spielfelds zu verbessern. Im Laufe der Zeit wurde jedoch klar, dass Schachprogramme, die auf schnelleren Computern oder speziellen Geräten ausgeführt werden, Programme übertreffen können, in die eine große Menge menschlichen Wissens eingebaut ist. Dies geschah, weil keine Heuristik perfekt ist und nicht alle Situationen berücksichtigen kann.Manchmal entstehen geniale Züge, weil der Spieler versucht, etwas zu tun, das die meisten Leute als schlechten Zug betrachten würden. Die meisten Heuristiken würden einen solchen Schritt ohne weitere Suche abschneiden, was bedeutet, dass Programme, die menschliches Wissen verwenden, niemals einen solchen Schritt machen würden.

Hans Berliner (Hintergrund), Murray Campbell (links) und Feng Xiong Xu bei den 20. jährlichen ACM Computer Chess Championships in Reno, NV. Der erste Platz wurde von zwei Teams geteilt - HiTech (Berliner Team) und Deep Thought (Campbell und Xu Team); Beide vertraten die Carnegie Mellon University. Drei Mitglieder des Deep Thought-Teams (einschließlich Campbell und Xu) wurden später von IBM beauftragt, Deep Blue zu erstellen.

Als die Computer schneller wurden, konnten sie mit 6, 7, 8 Zügen tiefer nach vorne schauen und Programme, die nur 4 Züge voraussagten, leicht besiegen. Es wurde ein effizienterer Suchalgorithmus entdeckt, der als "iterative Vertiefungssuche" bezeichnet wird. Er konnte die Suchtiefe entlang des vielversprechendsten Pfades schrittweise erhöhen. Es wurde zuerst in Schach 4.5 verwendet.3 David Slate und Larry Atkins - das erste Programm, das 1976 in einem menschlichen Schachturnier gewann. Die Erhöhung des Speichers ermöglichte es den Programmen auch, zuvor überprüfte Positionen beizubehalten, wodurch die Anzahl der erforderlichen Suchvorgänge weiter reduziert wurde. Alle diese Innovationen (Alpha-Beta-Bereinigung, iterative Vertiefung, Speicherung verifizierter Positionen und eine Datenbank mit Eröffnungen und Endspielen) wurden von den Entwicklern von Schachprogrammen in Computerschachturnieren frei ausgetauscht, sodass sie zu Standardtechniken wurden.

1977 entwarfen Ken Thompson (besser bekannt als Co-Autor des Unix-Betriebssystems) und Joe Condon von Bell Laboratories die Belle, eine spezialisierte Schachmaschine. Belles spezialisierte Schachausrüstung und Endspieldatenbank haben das Computerschach revolutioniert.

Belle 13- . Belle , Cray Blitz. 1970 1994 (Association for Computing Machinery, ACM) .

1980- Belle, Bell Labs, . Belle CHAOS WCCC 1980 , , . Belle CHAOS .

Belle Chess 4.0 4- (WCCC), - 1983 . : , . : Chess . Cray Blitz, Bebe.

Trotz der Fortschritte in der Software wurden Schachprogramme mit der zunehmenden Geschwindigkeit der Computer in den 1970er Jahren ohne Software-Innovationen automatisch besser. In den 1980er Jahren war der Einsatz von Hardware zur Beschleunigung der Suche der dominierende Faktor für Fortschritte im Computerschach. Sie sind zu einer Herausforderung für das Computerdesign geworden, nicht zu einer Herausforderung für die KI. 1997 verwendete Deep Blue noch weitgehend die gleichen Programmiertechniken wie Schachprogramme vor 20 Jahren. Es gelang ihm jedoch, Kasparov zu besiegen, hauptsächlich weil er ein schneller Computer mit vielen spezialisierten Parallelprozessoren war. In gewisser Weise wurden Schachprogramme mit zunehmender Geschwindigkeit der Computer weniger intelligent.

Deep Thought I, 1988 . Deep Thought, — , Deep Blue.

Deep Blue.

IBM Deep Blue ( , , , , . . ).

1997 Deep Blue (-).

In den 1980er Jahren war die Tiefensuche als dominierendes Thema in der KI-Forschung bereits rückläufig. Ab den 1960er Jahren haben Forscher wie Ed Feigenbaum in Stanford sogenannte "Expertensysteme" geschaffen, in denen große Mengen menschlichen Expertenwissens in Form von Wenn-Dann-Regeln in KI-Programme eingebracht wurden. Wie bei den ersten heuristischen Programmen wurden diese Regeln in den Softwarecode programmiert, aber im Gegensatz zu heuristischen Systemen wurde die "Wissensbasis" von den logischen Teilen des Programms ("Inferenzmaschinen") getrennt. Feigenbaum und andere Anhänger von Expertensystemen argumentierten, dass "Wissen Macht ist". Mit anderen Worten, sie glaubten, dass eine große Wissensbasis das Fehlen komplexer Argumente kompensiert: Je mehr Wissen, desto weniger Suche und umgekehrt.

Tiger in einem Käfig: Anwendung von Wissensbasissystemen, Vortrag von Edward Feigenbaum, 1993

Diskussion der Geschichte der KI bei AAAI-17: Expertensysteme, 2017

In den 1980er Jahren haben Expertensysteme viele kommerzielle Unternehmen hervorgebracht. All diese Aktivitäten hatten fast keine Auswirkungen auf Schachprogramme, die sich zu dieser Zeit in eine andere Richtung entwickelten: Zurück zur Brute-Force-Suche mit Hilfe spezieller Ausrüstung. Die führenden Schachmaschinen dieses Typs waren Ken Thompsons Belle of Bell Labs und zwei separate Projekte der Carnegie Mellon University: Hans Berlins HiTech mit Feng Xiong Xu und Murray Campbells Deep Thought, das später zu IBMs Deep Blue wurde. Das heißt, als die Maschine Kasparov besiegte, waren Schachprogramme praktisch nicht mehr mit dem allgemeinen Bereich der KI-Forschung verbunden, obwohl sie gute Werbung lieferten.

Beunruhigender war jedoch der Angriff auf ein symbolisches KI-Projekt, das auf der physikalischen Symbolhypothese von Newell und Simon zu Beginn der neunziger Jahre beruhte. Seine Kritiker, insbesondere der Philosoph Hubert Dreyfus, begannen bereits in den 1960er Jahren, das Projekt der symbolischen KI in Frage zu stellen, und argumentierten, dass die philosophische Annahme der Trennung von Gehirn und Körper falsch und veraltet sei. Philosophen des 20. Jahrhunderts wie Martin Heidegger argumentierten, dass menschliches Denken nicht von körperlicher Erfahrung und dem unmittelbaren kulturellen Umfeld des Subjekts getrennt werden kann.

KI-Forscher reagierten sehr scharf auf Kritik an Dreyfus (obwohl er selbst nicht besonders diplomatisch war): Führende Behörden auf dem Gebiet der KI bedrohten Zeitschriften, als sie Dreyfus 'Arbeiten veröffentlichten. Sie freuten sich, als Dreyfus, der nicht sehr gut im Schach war, von Richard Greenblatts MacHack-Schachprogramm besiegt wurde. Der Erfolg von Schachprogrammen bewies jedoch nicht, dass Dreyfus 'Kritik falsch war. Die Tatsache, dass Schachprogramme wie Deep Blue Brute-Force-Suche verwendeten, bedeutete, dass sie in einem größeren Allzweck-KI-Projekt nur eine geringe Rolle spielten. Das Drama von Kasparovs donnernder Niederlage wurde als Meilenstein für den Sieg von Machines over Man gefeiert, aber in Wirklichkeit war es ein Triumph der Deep Blue-Ingenieure über einen Schachspieler. Und die Schöpfer von Deep Blue haben nicht behauptetdass ihr Computer intelligent war. Sie sagten: Wenn im Gebäude ein Feuer ausbrach, wäre Kasparov klug genug, um zu entkommen, und das Auto würde an Ort und Stelle bleiben. Und obwohl der frühere KI-Pionier John McCarthy Schach nach dem Sieg von Deep Blue als das Hauptziel der KI ansah, kritisierte er das Schach dafür, dass es keine einzige neue Theorie zur Nachahmung der menschlichen Intelligenz entwickelte.

Die Medien porträtierten die Wiederholung von 1997 zwischen dem Schachweltmeister Garry Kasparov und dem spezialisierten Supercomputer IBM Deep Blue als Kampf zwischen Mensch und Maschine. Auf dem Cover von Newsweek wurde sie "The Brain's Last Line of Defense" genannt. Solche Ansichten haben die Leistung des Computers übertrieben und die Arbeit der Leute, die die Maschine selbst gebaut haben, minimiert.

In den frühen neunziger Jahren nahmen die Forscher die Kritik an Dreyfus ernst und begannen, neue Arten von KI zu erfinden, beispielsweise solche mit nachdrücklichem Körper wie Rodney Brooks Roboter 4oder diejenigen, die sich mit Emotionen befassen. Wie wir im zweiten Teil dieses Artikels sehen werden, begann in den 2000er Jahren eine völlig andere Tradition der KI, das maschinelle Lernen, die symbolische KI zu ersetzen. Maschinelles Lernen ist in der Lage, Aufgaben auszuführen, die die symbolische KI noch nie besser als Menschen erledigt hat, z. B. das Erkennen von Gesichtern oder das Verstehen menschlicher Sprache. Gleiches gilt für ein Spiel, das Maschinen mit heuristischer Suche nicht konkurrenzfähig spielen konnten, nämlich go.

Während die Suche ihre Größe als primäre KI-Technik verloren hat, hat sie im breiteren Bereich der Informatik nie ihre Nützlichkeit verloren. Bei der Verbesserung der Suchalgorithmen für eine optimale und effiziente Problemlösung wurden erhebliche Fortschritte erzielt. Diese Technik ist so grundlegend, dass die Erstellung und Suche von Entscheidungsbäumen äußerst verbreitet ist. Es ist fast unmöglich, alle Programme aufzulisten, die es verwenden.

Die Suche spielt eine Rolle bei jeder Aufgabe, Informationen zu erhalten, von der Ausführung von Abfragen für Datenbanken bis zur Suche im Web. Ein * Suchalgorithmus, der zuerst für den Shakey- Roboter erfunden wurdeSRI wird üblicherweise für autonomes Fahrzeugrouting und GPS-Anwendungen verwendet. Und auch heute noch verwenden KI-Programme, die Spiele mit maschinellem Lernen spielen, verschiedene Arten der Suche, auch wenn dies nicht mehr die interessanteste Komponente davon ist. Wie andere Techniken, die früher als "künstliche Intelligenz" galten, wird die moderne Suche jedoch nur als eine andere grundlegende Computertechnik angesehen, die nicht intelligenter ist als ein reguläres Programm. Dies zeigt das historische Muster der KI-Entwicklung: Sobald sie zum Standard und automatisch wird, betrachten die Menschen sie nicht mehr als "Intelligenz". Früher, als wir über "KI" sprachen, bedeuteten sie höchstwahrscheinlich Suche. Wenn heute „KI“ erwähnt wird, bezieht es sich normalerweise auf den Nachfolger der symbolischen KI - maschinelles Lernen.

Im zweiten Teil dieses Artikels werden wir die Revolution des maschinellen Lernens in der künstlichen Intelligenz untersuchen, die Tiefe des Unterschieds zwischen Deep Learning und Suche und symbolischer KI und wie DeepMinds AlphaGo Deep Learning einsetzte, um den Weltmeister Lee Sedol zu besiegen.

Anmerkungen

1. Nathan Ensmenger: „Ist Schach die Drosophila der künstlichen Intelligenz? Eine Sozialgeschichte eines Algorithmus “, Social Studies of Science 42, No. 1 (Februar 2012): 22, https://doi.org/10.1177/0306312711424596 .

2. Kai-Fu Lee, KI-Supermächte: China, Silicon Valley und die Neue Weltordnung. (Boston; New York: Houghton Mifflin Harcourt, 2019), 1-5.

3. Stuart J. Russell und Peter Norvig, Künstliche Intelligenz: Ein moderner Ansatz , 3. Auflage, Prentice Hall-Reihe für Künstliche Intelligenz (Upper Saddle River, NJ: Pentice Hall, 2010), 110.

4. Rodney A. Brooks, „ Elefanten spielen kein Schach “, Robotik und autonome Systeme, Designing Autonomous Agents, 6, No. 1 (1. Juni 1990): 3-15, https://doi.org/10.1016/S0921-8890(05)80025-9 .

Werbung

Wenn Sie Server mit sofortiger Aktivierung unter Linux oder Windows benötigen, um zu funktionieren , kommen Sie auf jeden Fall zu uns - der Server ist in einer Minute nach Zahlungseingang betriebsbereit!