Heutzutage werden in Filmen und Videospielen am häufigsten Motion Capture-Technologien (Motion Capture) eingesetzt. Es gibt aber auch andere Möglichkeiten für ihre Verwendung: Heute hilft Motion Capture dabei, um den Titel des besten Maschinenbedieners zu konkurrieren, Gang zu diagnostizieren, die Tänze kleiner Völker für zukünftige Generationen zu bewahren und in Zukunft einen echten Krieg aus einem gemütlichen Bunker heraus zu führen.

Pferde, Modellproletarier und nukleare Explosionen: Was versuchten die Schöpfer von Bewegungserfassungen zu fotografieren?

1878 machte Leland Stanford, der Gouverneur von Kalifornien, Gründer der Stanford University und Reitbegeisterter, mit seinen Freunden eine Wette. Er argumentierte, dass ein Pferd, das in einem bestimmten Moment im Galopp läuft, alle vier Beine vom Boden abhebt. Die Freunde waren sich nicht einig, und es war unmöglich, die Annahme visuell zu beweisen oder zu bestätigen. Stanford holte dann den renommierten Fotografen und Tierbewegungsforscher Edward Muybridge, um den Streit beizulegen. Auf Lelands Farm in Palo Alto wurde ein spezielles "Fotodrom" gebaut - ein Korral bestehend aus einer weißen Wand und Kameras, die von der gegenüberliegenden Wand auf sie gerichtet sind. Seile wurden über den Korralweg gespannt und an die Kameratore gebunden. Als das Pferd zu galoppieren begann, führte der Reiter es zum Fotodrom, die Beine des Tieres berührten die Seile, die Tore funktionierten und eine Reihe von Bildern erschien.

Auf diese Weise wurde die Chronofotografie geboren, die erste Motion-Capture-Technologie, mit deren Hilfe ein Streit über 25.000 US-Dollar beigelegt werden konnte.

Stanford hat bewiesen, dass er Recht hatte: Im Galopp hebt ein Pferd wirklich alle vier Beine vom Boden ab, aber in diesem Moment sind sie unter dem Körper versteckt und nicht hin und her gestreckt, wie Künstler verschiedener Epochen oft dargestellt haben. Diese kleine Entdeckung sorgte bei Kunstkritikern und Künstlern um die Wende vom 19. zum 20. Jahrhundert für Furore. Übrigens wurden nur schwarze Pferde zum Schießen verwendet - ihre Bewegungen werden vor dem weißen Hintergrund des Fotodroms deutlicher aufgezeichnet. Quelle: Eadweard Muybridge / Wikimedia Commons

Die Technologie der Bewegungserfassung war jedoch nicht nur wegen der Möglichkeit, eine Wette zu gewinnen, interessant, und anschließend erschienen mehr als ein Gerät, das auf dem Prinzip der Chronofotografie basierte. Zum Beispiel erfand der Fotograf Arnold Lond 1891 den Chronophotographen mit 12 Linsen, um die Mimik der Patienten des Neurologen Jean Charcot festzuhalten. Von damals bis heute bestand die Haupt- und schwierigste Aufgabe darin, die erfassten Aktionen zu reproduzieren.

Die ersten, die sich für diese Gelegenheit interessierten, waren Multiplikatoren. Im ersten Jahrzehnt des 20. Jahrhunderts begann die Ära der Cartoons, die entweder Marionetten oder handgezeichnet waren. Die Künstler versuchten, die maximale Wahrscheinlichkeit der Bewegungen der gezeichneten Figuren zu erreichen. Dies tat der amerikanische Erfinder Max Fleischer, der 1914 zusammen mit seinem Bruder Dave das Rotoskopieren ("Photo-Shifting") erfand. Zunächst wurden echte Schauspieler gefilmt. Dann wurde diese Aufnahme Bild für Bild vergrößert, projiziert und auf ein Glaslumen reproduziert. Der Künstler zeichnete jedes Bild auf Transparentpapier nach. Das Ergebnis war ein neuer Film mit einem realistisch bewegenden Charakter.

, , , . Tantalizing Fly (« ») . . «», « 7 », « », «-», «», « » . : Mohamed El Amine CHRAIBI / YouTube

Realistische Reproduktion von Bewegungen mittels ihrer in diesen Jahren interessierten Videoaufnahme der Wissenschaftler Sowjetrusslands, die sich für die wissenschaftliche Organisation der Arbeit interessieren. Wenn Sie die Bewegungen der besten Vertreter des Proletariats gründlich studieren, können Sie andere Arbeiter unterrichten - das war die Logik der sowjetischen Führung und der Wissenschaftler. Dieses Thema wurde vom in Moskau gegründeten Zentralinstitut für Arbeit (CIT) behandelt und von Nikolai Bernstein, dem Begründer der wissenschaftlichen Leitung der Biomechanik, die sich mit menschlicher Bewegung befasst, betreut. In seinem Labor führte Bernstein zyklogrammetrische Studien durch: Das Subjekt trug einen speziellen Anzug, der aus Dutzenden kleiner Lampen bestand, die die Rolle von Markern spielten. Dann wurde unter Verwendung eines schnellen Filmens (100-200 Bilder pro Sekunde) ein Zyklogramm erhalten. Der Fehler beim Messen der Positionen einer sich bewegenden oder laufenden Person betrug nur 0,5 mm.

Im Laufe der Jahre hat Bernstein die Bewegungen von Sportlern, Arbeitern und Musikern untersucht, was dazu beigetragen hat, die Leistung bei Wettkämpfen zu verbessern und Lehrmethoden in verschiedenen Bereichen zu entwickeln. Trotz der Schande in der Zeit des Kampfes gegen die "Kosmopoliten" gelang es Bernstein immer noch, Empfehlungen zur Anpassung der Astronauten an den Zustand der Schwerelosigkeit abzugeben. Quelle: Thomas Oger / YouTube

Es ist bemerkenswert, dass Bernstein die Entstehung der optischen und akustischen Bewegungserfassung vorweggenommen hat, für die noch heute am menschlichen Körper angebrachte Sensoren verwendet werden.

Diese Idee wurde von dem Amerikaner Lee Harrison III entwickelt, der mit analogen Mikroschaltungen und Kathodenstrahlröhren experimentierte. 1959 entwarf er einen Anzug mit eingebauten Potentiometern (einstellbaren Widerständen) und konnte die Bewegungen eines Schauspielers in Echtzeit auf einer Kathodenstrahlröhre aufzeichnen und animieren. Obwohl es sich um ein primitives Setup handelte - der animierte Schauspieler sah aus wie eine Lichtsäule auf dem Bildschirm -, war es die erste Echtzeit-Bewegungserfassung.

Parallel dazu hat sich die fotooptische Methode durchgesetzt, als die Bewegungserfassung durch Fotografieren eines Objekts mit hoher Geschwindigkeit oder aus verschiedenen Blickwinkeln erreicht wurde. Harold Edgerton, der Erfinder der Rapatronic Chamber, die in den 1940er Jahren gegründet wurde, trug wesentlich dazu bei. Es ist in der Lage, ein Standbild mit einer Belichtungszeit von nur 10 Nanosekunden aufzunehmen. Dank dieses Geräts konnte der Wissenschaftler sehr schnelle Ereignisse erfassen - von einem Spritzer Wasser von einem fallenden Tropfen bis zu einer nuklearen Explosion.

Der Moment der Explosion einer Kernladung im Bruchteil einer Sekunde nach der Detonation, erfasst von einer rapatronischen Kamera. Quelle: Bundesregierung der Vereinigten Staaten / Wikimedia Commons

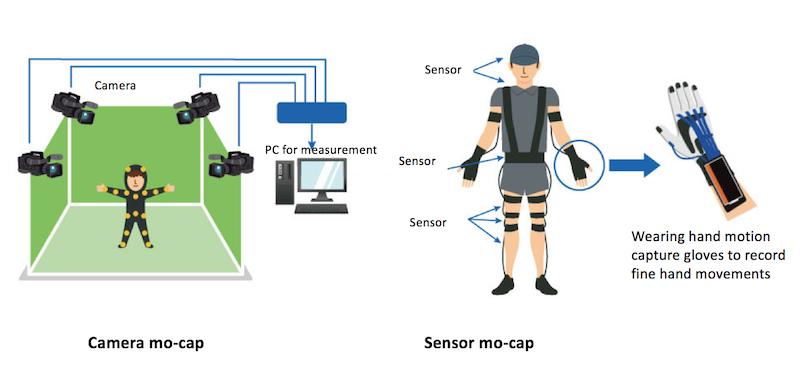

Bis zum Ende des 20. Jahrhunderts wurden zwei Haupttechnologien der Bewegungserfassung gebildet, die üblicherweise als marker und markerless bezeichnet werden. Im ersten Fall erfolgt die Bewegungserfassung mithilfe von Markern oder Sensoren, die am menschlichen Körper angebracht sind. Sie können unterschiedlich sein: Infrarot, magnetisch, gyroskopisch. Infrarotlicht kann entweder Licht reflektieren (passiv) oder emittieren (aktiv), magnetische verzerren den magnetischen Fluss und der Wellenempfänger bestimmt seine Position im Raum. Der Kreiselsensor überträgt auch Informationen über Änderungen der Position des Körpers im Raum.

Markerlose Systeme basieren auf optischer Erfassung. Im Raum sind viele Kameras montiert, die aus verschiedenen Winkeln aufnehmen. Die resultierenden Bilder werden dann zu einem 3D-Modell kombiniert. Ein anderer Typ ist ein Exoskelett, das am Körper befestigt ist und ein Animationsmodell erstellt, das Bewegungen erfasst.

Wenn das Modell des erfassten Charakters anschließend in einer virtuellen Umgebung platziert werden muss, wird es im grünen Raum (Chromakey) gefilmt. Grün steht in starkem Kontrast zu den Farben des menschlichen Körpers, sodass der Computer grüne Pixel besser aus Frames herausschneiden kann. Quelle: Toshiba

Motion Captures werden hauptsächlich in Filmen und Videospielen verwendet. Diese Technologie wird jedoch jedes Jahr zunehmend außerhalb der Unterhaltungsindustrie eingesetzt - in der Herstellung, Medizin, Bewahrung des kulturellen Erbes, im Sport und in militärischen Angelegenheiten.

Wiederholen Sie nach mir: Wie lehrt Toshiba die Verwendung von Dateien mit Motion Capture?

Sie können endlos Feuer, Wasser und die Arbeitsweise von jemandem betrachten. Und manchmal können Sie davon profitieren. Wir bei Toshiba haben dies vor langer Zeit herausgefunden, weshalb unser Corporate Manufacturing Engineering Center den Motion-Capture-Spezialisten Hiroaki Nakamura hat. Vor kurzem verfolgte er mit Begeisterung, wie die Teilnehmer der National Championship of Professionals - einem speziellen Wettbewerb für Handwerker in verschiedenen Bereichen - vom Backen bis zum Schweißen arbeiten.

Im Jahr 2018 beschloss Haruki Okabe, ein junger Arbeiter in einem der Toshiba-Unternehmen, an diesem Wettbewerb teilzunehmen, insbesondere an der Montage eines kleinen Geräts. Bei der Montage verwenden die Teilnehmer eine gute alte Datei für die endgültige Bearbeitung einiger Teile. Es wird angenommen, dass erstklassige Techniker in diesem Geschäft eine Bearbeitungsgenauigkeit von 0,001 mm oder weniger erreichen können, da das Gerät sonst nicht funktioniert. Hier stellte sich heraus, dass unser Kandidat schwach war und den Sieg im Wettbewerb verpasste.

Toshiba schickte einen 66-jährigen Ausbilder Tatsuo Matsui, der mehr als 50 Jahre als Akte in den Unternehmen des Unternehmens arbeitete, um den jungen Spezialisten zu betreuen. Allerdings wird nicht jeder Träger einzigartiger Fähigkeiten als guter Lehrer geboren, der sie vermitteln kann. Er erklärte, dass das Problem in der Position des Teilnehmers an der Maschine liege, die Angelegenheit jedoch nicht weiter fortgeschritten sei. Dann haben wir beide in Motion-Capture-Kostümen gekleidet. Sie werden nach dem Markierungsprinzip "genäht", dh Sensoren werden zur Aufzeichnung von Bewegungen verwendet. In diesem Fall sind Beschleunigungsmesser ungefähr die gleichen wie bei Smartphones. Es ist viel billiger als mehrere Kameras.

Beim Vergleich ihrer Daten stellten wir einen signifikanten Unterschied in der Balance zwischen ihren Füßen fest.

Die vertikale Achse ist der Widerstand des Trägers [N] und die horizontale ist die Zeit [S]. Da sich der Schwerpunkt des jungen Arbeiters im Vergleich zum erfahrenen Arbeiter stärker auf das vordere Bein konzentriert, besteht eine große Lücke zwischen seiner blauen und seiner grünen Kurve. (Okabe, ein junger Arbeiter, ist Linkshänder, und Matsui, ein Lehrer, ist Rechtshänder, daher sind die Linien in den Diagrammen umgekehrt.) Quelle: Toshiba

Es stellte sich heraus, dass der Schwerpunkt des jungen Arbeitnehmers stark nach vorne verschoben ist, nicht wie der des erfahrenen Spezialisten. Aus diesem Grund wird der Kandidat schnell müde, wenn er mit einer Datei arbeitet, und aus diesem Grund kommt es zu einer Ehe. Okabe erkannte seinen Fehler und konnte die Qualität seiner Datei verbessern. Und er holte Bronze bei der Japanese National Professional Championship. Vielleicht lernen unsere Nachkommen aus den Aufzeichnungen der Arbeit mit der Matsui-Datei. Und wir können ihnen auch eine andere Art verschwindender Kunst ersparen - das Tanzen.

: ?

Jeder hat wahrscheinlich von der UNESCO-Welterbeliste gehört, die mehr als 1.000 natürliche und vom Menschen geschaffene Stätten umfasst, die die Menschheit erhalten und an zukünftige Generationen weitergeben möchte. In den frühen 2000er Jahren dachten viele darüber nach, wie man das bewahrt, was nicht von Hand gebaut und nicht von der Natur geschaffen wurde - Gesang, Zeremonien, Theateraufführungen, Kunsthandwerk. So entstand das Konzept des immateriellen Kulturerbes (ICH), das seit 2003 ebenfalls akkumuliert und bewahrt wurde. Die Motion-Capture-Technologie trägt dazu bei, eines der Hauptobjekte des ICH-Tanzes zu erhalten.

Mehrere Projekte auf der ganzen Welt digitalisieren die Tänze der Völker der Welt (Wholedance, i-Treasures, AniAge und andere). Am häufigsten werden beim Aufzeichnen von Tänzen aktive und passive Sensoren verwendet, die am Körper des Tänzers angebracht sind.

Bewegungserfassungssysteme mit aktiven Sensoren verwenden LEDs, die ihr eigenes Licht abgeben. Beispielsweise besteht das Bewegungserfassungssystem Phasespace Impulse X2 aus acht Kameras, die Bewegungen mithilfe modulierter LEDs erfassen können. Der Tänzer zieht einen Anzug mit 38 Sensoren und aktiven LEDs an und beginnt zu tanzen.

Das WholoDance-Projekt experimentierte mit der Integration von Microsoft HoloLens als Visualisierungstool. Durch das drahtlose Streaming von Daten von Autodesk MotionBuilder zu einem Headset können Tänzer und Choreografen Hologramme in Echtzeit sehen. Quelle: Jasper Brekelmans / YouTube

In passiven Erfassungssystemen senden die Sensoren kein Signal aus, sondern reflektieren es nur mit speziellen Materialien, aus denen der Anzug besteht. Diese Technologie bietet dem Tänzer mehr Handlungsfreiheit, ermöglicht ihm scharfe Bewegungen, führt akrobatische Elemente aus und verringert gleichzeitig nicht die Genauigkeit und Geschwindigkeit der Fixierung. Jetzt erwarten Wissenschaftler, Motion-Capture-Marker-Technologien und 3D-Aufnahmen zu integrieren, da die Mimikry und das Kostüm des Tänzers am Tanz beteiligt sind.

Ähnliche Motion-Capture-Technologien werden für eine viel einfachere Form der körperlichen Aktivität als für den Tanz verwendet - für die Ganganalyse.

Vom Gang lernen: Wie hilft das Gangstudium Ärzten?

Gang kann viel über die Gesundheit eines Menschen erzählen. Timothy Niiler von der Pennsylvania State University weiß das - er sammelt die weltweit größte Sammlung menschlicher Gangarten mithilfe der Motion-Capture-Technologie. Er lädt Menschen im Alter von 18 bis 65 Jahren ein, unter 12 Hochgeschwindigkeitskameras in sein Labor zu gehen. Niiler bringt etwa 40 reflektierende Sensoren am Körper der Studienteilnehmer an. So entsteht eine Gangdatenbank, die anschließend von Ärzten genutzt wird. Zuallererst bietet die Kenntnis des normalen Gangs eine Grundlage für die Identifizierung nahezu aller orthopädischen Probleme, die bei Erwachsenen auftreten. Wenn beispielsweise die Wirksamkeit eines Hüft- oder Knieersatzes gemessen werden muss, "erfassen" Ärzte den Gang des Patienten und vergleichen ihn mit den durchschnittlichen Gangparametern aus einer Datenbank.

? 1/3 . 1/3 . : 2/3 . 2/3 . : Motion Analysis

Bewegungsanalysesysteme, beispielsweise GaitTrack, werden bereits direkt in medizinischen Zentren eingesetzt. Mit dieser Technologie berechnen und verallgemeinern Ärzte die grundlegenden biomechanischen Parameter beim Gehen oder Laufen, diagnostizieren Gelenkerkrankungen frühzeitig und erkennen das Risiko möglicher Verletzungen. Trainer und Sportler verwenden Motion Capture auf ähnliche Weise.

Schneller, höher, besser: Wie hat Motion Capture Basketballspielern geholfen?

Motion Capture ist im Sport weit verbreitet. Durch die Analyse der Aktionen von Spielern können Sie deren Fehler identifizieren oder eine Vielzahl von Geräten testen. Keith Pamment ist der Cheftrainer der Basketballmannschaft, die sich aus Rollstuhlfahrern zusammensetzt. Er ist auch Ingenieur und hat sich lange gefragt, wie Motion Capture die Leistung von Basketballteams verbessern kann. Insbesondere das Perception Neuron Motion Capture-System half dabei, die effektivsten Rollstühle für Basketballspieler mit Behinderungen zu finden. Die kostümierten Athleten sprinteten, manövrierten, tröpfelten und eins zu eins, während sie sechs verschiedene Stühle wechselten, während der Trainer die Bewegung ihrer Animationen in Echtzeit mit 16 Kameras untersuchte.

Die Avatare animierter Athleten wurden in 3D-Modelle von Rollstühlen integriert. Quelle: Rockets Science CIC / YouTube

An einem Tag des Studiums des Spielertrainings erarbeitete Keith technische Kriterien für Sportstühle für sein Team, die auf den Fähigkeiten, Stärken, Schwächen, Bewegungen und Spieltechniken des Athleten basierten. Jetzt bereitet der Trainer einen ganzen Kurs für seine Kollegen vor, die mit denselben Athleten arbeiten.

Während Motion-Capture-Technologien aufgrund ihrer relativen „Jugend“ und infolgedessen technischen Einschränkungen in „Nischenbereichen“ menschlicher Aktivitäten eingesetzt werden. Mit der Entwicklung der Robotik, des maschinellen Lernens sowie der erweiterten und virtuellen Realität wird sich ihr Anwendungsbereich jedoch erweitern.

Was kommt als nächstes: Roboteravatare, Teleportation und virtuelle Realität

Roboter werden immer agiler, schneller und cleverer, was bedeutet, dass die Leute sie zunehmend dorthin schicken, wo sie nicht hin wollen. Heutzutage werden unter den Schnittstellen für die Fernsteuerung von Autos hauptsächlich Joysticks oder Exoskelette verwendet. Solche Mittel sind nicht immer effektiv - ihr Hauptnachteil besteht darin, dass sie auf die eine oder andere Weise die Bewegung der Person selbst stören oder erschweren, die den Roboter fernsteuert. Optische Bewegungserfassungstechnologien können dieses Problem lösen.

Im Jahr 2018 gelang es einer Gruppe von Wissenschaftlern aus Großbritannien und Italien, einen Roboter namens Centauro durch Bewegungserfassung den Aktionen eines zerbrechlichen Mädchens auszusetzen. Dazu verwendeten sie das kostengünstige ASUS Xtion PRO-Bewegungserkennungssystem, das Infrarotsensoren und eine Farbbilderkennungsfunktion (RGB) enthält. Sie war für die Bewegungserfassung verantwortlich. Die empfangenen Informationen wurden von OpenPose verarbeitet, einem auf maschinellem Lernen basierenden Algorithmus, der Bewegungen des menschlichen Körpers in Echtzeit (8-10 Hz) mithilfe von 2D-Bildern von einer RGB-Kamera erfassen kann. Dreidimensionale Koordinaten menschlicher Gelenke und Gliedmaßen, die nach der Filtration aus dem System erhalten werden, werden übertragen, um den Centauro-Roboter zu steuern.

3D- , . : Dimitrios Kanoulas / YouTube

Natürlich kann der Centauro zwar nicht mit einem Sturmgewehr bewaffnet und an die Kontrolle eines erfahrenen Marines übergeben werden, aber in Zukunft ist die Schaffung solcher Systeme möglich. Bereits 2012 hatte die Defense Advanced Research Projects Agency (DARPA) ein Projekt unter dem unerwarteten Namen Avatar angekündigt, das „die Entwicklung von Schnittstellen und Algorithmen vorsah, die es einem Soldaten ermöglichen würden, effektiv mit einem halbautonomen Fahrzeug auf zwei Beinen zusammenzuarbeiten ( Bi-Pedal) als Ersatz für den Soldaten. " Offensichtlich wird ein solches System es tatsächlich ermöglichen, den Roboter mit den Fähigkeiten eines erfahrenen und gut ausgebildeten Soldaten auszustatten und ihn dank der Fernbedienung gleichzeitig in der schwierigsten Betriebsumgebung am Leben zu erhalten. Der Fortschritt der Studien wurde dann nicht berichtet.

2018 kündigte die XPrize Foundation einen Wettbewerb zur Erstellung des ANA Avatar XPrize-Roboter-Avatars an. Anschließend wurden 77 Teams ausgewählt, um Ende 2020 ihre Entwicklung von Avatar-Robotern vorzustellen. Gemäß den Wettbewerbsbedingungen müssen Entwickler Lösungen im Bereich Motion Capture, Sensitive Technologies, AR und VR kombinieren. Das ultimative Ziel, das 5 Millionen US-Dollar kosten wird, ist ein System, mit dem der Bediener verschiedene Aufgaben in einer entfernten Umgebung sehen, hören, bewegen und ausführen kann.

Der Avatar sollte drei Betriebsarten haben:

- Voll gesteuerter Modus: Der Roboter führt nur menschliche Befehle aus.

- Erweitert: Lösen Sie einige Aufgaben unabhängig voneinander, z. B. Umweltanalysen oder Kartierungen.

- halbautonom: unabhängige Entscheidungsfindung.

Tatsächlich handelt es sich um die "Teleportation" einer Person mit der Wirkung, am Kontrollpunkt des Roboters präsent zu sein. Diese Technologien werden in Zukunft die Fernsteuerung anthropomorpher Roboter in einer für den Menschen ungünstigen Umgebung ermöglichen: in einem Vulkankrater, im Weltraum, in Naturkatastrophengebieten oder im Krieg. Im Jahr 2020 werden wir die ersten Entwicklungen sehen, und im Jahr 2021 werden wir herausfinden, wer der Beste sein wird und 5 Millionen US-Dollar für weitere Forschung erhalten wird.