Zahl: Foto 1: Nikon D610-Foto mit AF-S 24-120 mm 1: 4-Objektiv bei 24 mm 1: 8 ISO100

Was sind die grundlegenden Schritte zum Rendern eines RAW-Bilds auf niedriger Ebene? In diesem Artikel werde ich beschreiben, was unter der Haube von Digitalkamerakonvertern vor sich geht, bei denen Rohdaten in ein sichtbares RAW-Bild konvertiert werden - manchmal auch als Rendering bezeichnet. Um die Transformation von Informationen aus dem Bild bei jedem Schritt zu demonstrieren, verwende ich das am Anfang des Artikels gezeigte Foto, das auf einer Nikon D610 mit einem AF-S 24-120 mm 1: 4-Objektiv und 24 mm 1: 8 ISO100-Einstellungen aufgenommen wurde.

Beim Rendern wird RAW konvertiert und bearbeitet

Das Rendern kann in zwei Hauptprozesse unterteilt werden: RAW-Konvertierung und -Bearbeitung. Die RAW-Konvertierung ist erforderlich, um die Rohbilddaten in ein Standardformat umzuwandeln, das Bildbearbeitung, Anzeigeprogramme und Geräte verstehen können. In der Regel wird dazu ein kolorimetrischer RGB-Farbraum wie Adobe oder sRGB verwendet.

Die Redakteure nehmen Informationen zu einem Bild in einem Standardfarbraum auf und nehmen Anpassungen vor, um das Bild für den Fotografen "passender" oder "angenehmer" zu machen.

Ein Beispiel für einen sauberen RAW-Konverter ist dcraw von David Coffin. Ein Beispiel für einen sauberen Editor ist Photoshop von Adobe. Die meisten RAW-Konverter kombinieren tatsächlich RAW-Konvertierungsfunktionen mit Editorfunktionen (z. B. Capture NX, LR, C1).

7 Schritte zur grundlegenden RAW-Konvertierung

Die Grenze zwischen dem Ende der Konvertierung und dem Beginn der Bearbeitung ist eher verschwommen. Abhängig davon, wie Sie sie trennen, sind im Hauptprozess der Konvertierung einer RAW-Datei in einen kolorimetrischen Standardfarbraum nur 7 Schritte erforderlich, z. B. sRGB. Die Schritte müssen nicht in dieser Reihenfolge ausgeführt werden, aber die folgende Reihenfolge ist ziemlich logisch.

- Laden Sie lineare Daten aus der RAW-Datei und subtrahieren Sie die Schwarzwerte.

- Weißabgleich.

- Korrigieren Sie die lineare Helligkeit.

- Bilddaten zuschneiden.

- Stellen Sie das Originalbild aus dem Mosaik wieder her ( Debayering ).

- Wenden Sie Farbtransformationen und Korrekturen an.

- Gamma auftragen.

Bei der grundlegenden RAW-Konvertierung bleibt der Prozess bis zum Ende linear. Idealerweise wird die Gammakurve im letzten Schritt von dem Gerät korrigiert, das das Bild anzeigt, sodass das Bildverarbeitungssystem vom Anfang bis zum Ende - vom Moment, in dem Licht auf den Sensor trifft, bis zum Moment, in dem das Licht das Auge erreicht - ungefähr linear ist. Wenn Sie ein Bild "ehrlich" so rendern müssen, wie es auf den Sensor gelangt ist, ist dies alles, was Sie von einem RAW-Konverter benötigen.

+ Tonzuordnung: An den Dynamikbereich des Ausgabegeräts anpassen

Wie wir jedoch sehen werden, führt die grundlegende Konvertierung von RAW-Dateien in vorhandenen Digitalkameras fast nie zu einem zufriedenstellenden Ergebnis, da die meisten Ausgabegeräte (Fotopapier, Monitore) schlechtere Kontrastverhältnisse aufweisen als gute Digitalkameras. Daher ist es praktisch notwendig, eine Tonkorrektur durchzuführen, um den weiten Dynamikbereich der Kamera auf den engen Dynamikbereich des Geräts zu bringen. Dies kann eine einfache Kontrastkurve sein - oder eine komplexere Tonzuordnung zusammen mit lokalen und globalen Anpassungen für Schatten, Lichter, Klarheit usw. (Standard-Schieberegler in kommerziellen Editoren und Konverter-Software). Dies geschieht normalerweise beim Bearbeiten eines Renderings. Wenn Sie jedoch eine "genaue" Farbe anstreben,Idealerweise sollte die Tonzuordnung Teil des 6. Schritts der Farbkorrektur während der RAW-Konvertierung sein (siehe.eine großartige Seite von Alex Torgera, die Farbprofile beschreibt).

Nach sieben grundlegenden Konvertierungsschritten können Sie mit dem Editor fortfahren, um die in einem bestimmten Frame und in einer bestimmten Bildausgabe an das Ausgabegerät festgestellten Mängel objektiv zu korrigieren - und das Bild für den Künstler subjektiv ansprechender zu gestalten. Korrigieren Sie beispielsweise die Linsenverzerrung und die laterale chromatische Aberration. Lärmreduzierung anwenden; Wenden Sie einen Schärffilter an. Es ist möglicherweise besser, einige dieser Funktionen vor bestimmten RAW-Konvertierungsschritten im linearen Raum auszuführen. Sie sind jedoch normalerweise optional und können nach dem Rendern im Gammaraum im Editor auf die gleiche Weise ausgeführt werden.

In diesem Artikel konzentrieren wir uns auf den grundlegenden Rendering-Teil der RAW-Konvertierung und lassen die Tonzuordnung und -bearbeitung für ein anderes Mal.

1. Laden Sie lineare Daten aus der RAW-Datei und subtrahieren Sie die Schwarzwerte

Der erste Schritt beim Konvertieren von RAW besteht darin, einfach Daten aus der RAW-Datei in den Speicher zu laden. Da sich die RAW-Formate von Kamera zu Kamera unterscheiden, verwenden die meisten Konverter Variationen der Open-Source-Programme LibRaw / dcraw . Die folgenden Befehle für LibRaw oder dcraw verpacken die RAW in ein lineares 16-Bit-TIF, das von Verarbeitungsanwendungen (Matlab, ImageJ, PS usw.) gelesen werden kann. Das Programm muss nicht installiert werden. Die ausführbare Datei muss sich lediglich in der Variablen PATH oder im selben Verzeichnis befinden.

unprocessed_raw -T yourRawFileoder

dcraw -d -4 -T yourRawFileWenn Ihr Bildsensor gut ausgelegt ist und den Spezifikationen entspricht, stehen die aufgezeichneten Daten in einem linearen Verhältnis zur Lichtintensität. Sie werden jedoch normalerweise mit kamera- und kanalabhängigen Vorspannungen gespeichert. T.N. Schwarzpegel haben Größen von mehreren hundert oder tausend DN und müssen von den ursprünglichen Rohdaten abgezogen werden, damit die Intensität von null Pixeln mit dem Licht von null übereinstimmt. dcraw mit der obigen Befehlszeile erledigt dies für Sie (wenn auch mit einigen Durchschnittswerten). Wenn Sie unprocessed_raw verwenden, müssen Sie den Schwarzwert für Ihre Kamera kennen und entsprechend subtrahieren (oder Sie können den Parameter –B verwenden, der in der aktuellen Version von LibRaw jedoch nicht unterstützt zu werden scheint).

Es stellt sich heraus, dass Nikon die Schwarzpegel von jedem Kanal subtrahiert, bevor in die D610-Dateien geschrieben wird. Für unsere Referenzaufnahme funktioniert also jeder Befehl. Ich habe es mit dem Befehl dcraw -d -4 -T geladen, der die Daten auch auf 16 Bit skaliert (siehe Schritt 3 für die Helligkeitskorrektur unten).

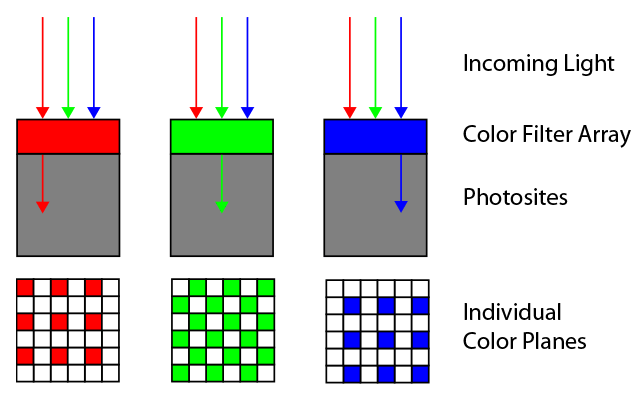

Die zu diesem Zeitpunkt geladenen Daten sind einfach die Graustufenintensität des Bildes. Sie entsprechen jedoch der Position auf der Matrix, die einem bestimmten Farbfilter zugeordnet ist, unter dem sie sich befinden. In Bayer-Matrizen gibt es Reihen abwechselnder roter und grüner Farben - und grüner und blauer - wie im Bild gezeigt. Die genaue Reihenfolge wird vom ersten Quartett des aktiven Bereichs der Matrix bestimmt - in diesem Fall handelt es sich um RGGB, es sind jedoch auch drei andere Optionen möglich.

Abb. 2: Bayer-Farbfiltermatrix: RGGB-Layout.

Die Bayer Matrix für den D610 verfügt über ein RGGB-Layout. Die Rohdaten in diesem Stadium sehen aus wie ein unterbelichtetes Schwarzweißbild:

Abb. 3: Schritt 1: Lineares Rohbild mit subtrahierten Schwarzwerten. Es sollte so hell aussehen wie das folgende Bild. 4. Wenn nicht, behandelt Ihr Browser Farben nicht richtig (ich verwende Chrome und er behandelt sie offensichtlich nicht richtig).

Wenn das Foto schwarz ist, weiß Ihr Browser nicht, wie korrekt beschriftete Liniendaten angezeigt werden. Interessanterweise zeigt der WordPress-Editor das Bild korrekt an, aber nachdem es in Chrome veröffentlicht wurde, sieht es nicht richtig aus (Hinweis: Dies wurde schließlich bis 2019 behoben) [Artikel 2016 / ca. übersetzt.]. So sollte dieses Bild aussehen:

Abb. 4: gleiches Foto, aber als CFA-Graustufen

So sehen die linearen CFA-Daten direkt in der Datei aus. Es sieht ein wenig dunkel aus, da ich die Belichtung nach rechts verschoben habe, um die Glanzlichter des Wasserfalls nicht abzuschneiden - wir werden dies später im Schritt der linearen Helligkeitsanpassung beheben.

Das Bild sieht aufgrund seiner geringen Größe wie ein vollwertiges Schwarzweißbild aus, in Wirklichkeit jedoch nicht: Selbst in gleichmäßig beleuchteten Bereichen ist eine Pixelierung sichtbar. Dies liegt an der Tatsache, dass benachbarte Farbfilter mit unterschiedlichen spektralen Empfindlichkeiten unterschiedliche Informationen über Farben sammeln. Dies ist leicht zu erkennen, wenn das Bild vergrößert wird. So sieht der Bildbereich direkt unter der WhiBal-Karte mit einer Vergrößerung von bis zu 600% aus:

Abbildung 5: Die CFA-Pixelung ist auf einer gleichmäßig grauen Karte (oben) und auf farbigen Blättern sichtbar.

2. Weißabgleichdaten

Aufgrund der spektralen Verteilung der Energie der Lichtquelle (in diesem Fall ist der Himmel teilweise von Wolken bedeckt, deren Licht durch das Laub dringt) und der spektralen Empfindlichkeit der auf der Matrix befindlichen Filter zeichnen verschiedenfarbige Pixel auch bei gleicher Beleuchtung proportional höhere oder niedrigere Werte auf. Dies zeigt sich insbesondere in den neutralen Teilen des Bildes, wo es den Anschein hat, dass auf allen Farbebenen die gleichen Durchschnittswerte angezeigt werden sollten. In diesem Fall zeichneten die roten und blauen Pixel auf der neutralen Graukarte Werte von 48,8% bzw. 75,4% des Grünwerts auf, sodass sie dunkler erscheinen.

Der nächste Schritt besteht also darin, den Weißabgleich auf die linearen CFA-Daten anzuwenden, indem jedes rote Pixel mit 2,0493 (1 / 48,8%) und jedes blaue Pixel mit 1,3256 (1 / 75,4%) multipliziert wird. In Adobe-Begriffen erhalten wir ein Schwarzweißbild, das für die Kamera neutral ist. Dann ist garantiert, dass mit Ausnahme des Rauschens alle Pixel auf neutralen Teilen des Bildes die gleichen linearen Werte zeigen.

Zahl: 6: Nach dem Weißabgleich verschwindet die Pixelkarte der Graukarte, ist jedoch auf farbigen Objekten weiterhin sichtbar.

Sehen Sie, wie die Pixelierung oben im Bild verschwunden ist - für die Kalibrierung wurde eine neutrale Graukarte verwendet. Aber natürlich ist die Pixelierung von Farbobjekten nicht verschwunden: Informationen über Farben werden in der Differenz zwischen den Intensitäten der drei Kanäle gespeichert.

3. Korrektur der linearen Helligkeit

Die meisten modernen Digitalkameras mit Wechselobjektiven liefern Rohdaten in 12 bis 14 linearen Bits. Die Standardbittiefe von Dateien (JPEG, TIFF, PNG) wird normalerweise als Multiplikator von 8 festgelegt, und 16 Bit ist heute die bevorzugte Tiefe der meisten Editoren. Wir können nicht einfach 14-Bit-Daten mit subtrahierten Schwarzwerten aufnehmen und in 16 Bit speichern - alles fällt in die unteren 25% des linearen Bereichs und ist zu dunkel. Idealerweise möchten wir die Daten nach dem Weißabgleich und dem Schwarz-Subtrahieren zuschneiden, um sie an die zugeschnittenen Daten in einer 16-Bit-Datei anzupassen, und sie entsprechend skalieren (siehe Schritt 4). Eine einfache Möglichkeit, die Daten grob umzuwandeln, besteht darin, die 14-Bit-Daten einfach mit 4 zu multiplizieren und auf 16 Bit zu skalieren. Dies ist genau das, was in Schritt 1 nach dem Subtrahieren von Schwarz getan wurde (dcraw -d -4 -T erledigt dies automatisch,und mit unprocessed_raw müssen Sie dies manuell tun).

Apropos Skalierung: Vielleicht möchten wir auch unsere Helligkeit optimieren. Dieser Schritt ist subjektiv und wahrscheinlich nicht wert, wenn Sie nach einem "ehrlichen" Rendern eines Bildes suchen, wie es auf dem Sensor angezeigt und in einer RAW-Datei aufgezeichnet wurde. Es ist jedoch niemand in der Lage, die perfekte Belichtung zu erzielen, und verschiedene Kameras messen häufig das durchschnittliche Grau bei unterschiedlichen Prozentsätzen der Rohdaten. Daher ist es nützlich, die Helligkeit anpassen zu können. Daher bezeichnen viele Konverter die relativen Schieberegler als "Belichtungskorrektur" oder "Belichtungskompensation". Adobe ist ein DNG-Label zugeordnet, das den Belichtungsmesser für verschiedene Kameras normalisiert: BaselineExposure. Für den D610 sind es 0,35 Schritte.

Unser Bild ist für meinen Geschmack etwas dunkel, und die WhiBal-Karte, die zu 50% reflektierend sein sollte, ist bei vollem Maßstab nur 17%. Die lineare Luma-Korrektur ist die Multiplikation jedes Pixels in den Daten mit einer Konstanten. Wenn wir berücksichtigen, dass wir in diesem Bild nicht die hellsten Bereiche des Bildes mit einer Helligkeit von mehr als 100% des gestreuten weißen Lichts beibehalten müssen, beträgt diese Konstante in diesem Beispiel 50/17, ungefähr 1,5 Korrekturschritte. In diesem Fall entschied ich mich für eine subjektiv-konservative Korrektur von +1,1 linearen Helligkeitsschritten, wobei alle Daten in der Datei mit 2,14 multipliziert wurden. Folgendes wurde erhalten:

Abb. 7: CFA-Bild nach Schwarzpegelsubtraktion, Weißabgleich, Zuschneiden, lineare Helligkeitskorrektur in 1,1 Schritten

Schon besser. Wie Sie jedoch sehen können, müssen Sie für die lineare Helligkeitskorrektur Teile des Wasserfalls beleuchten. Hier helfen die erweiterten nichtlinearen Schieberegler für die Wiederherstellung von Lichtern und Schatten, die in den meisten RAW-Konvertern zu finden sind.

4. Stellen Sie sicher, dass die Weißabgleichdaten gleichmäßig gekürzt werden

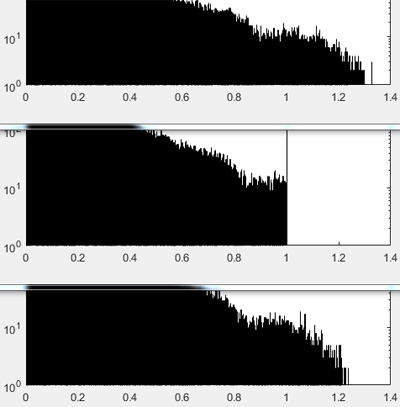

Wenn der grüne Kanal ursprünglich in den Rohdaten abgeschnitten wurde, müssen Sie möglicherweise die anderen beiden nach dem Anwenden von Weißabgleich-Multiplikatoren auf den vollen Maßstab zuschneiden, um die resultierende Nichtlinearität zu korrigieren. Der vollständige Maßstab wird in den folgenden Histogrammen als normalisierter Wert von 1,0 angezeigt. Sie können sehen, dass der grüne Kanal der ursprünglichen Rohdaten (aufgrund des Durcheinander von Werten) abgeschnitten wurde und die anderen nicht.

Zahl: 8: Von oben nach unten: R-, G-, B-Histogramme nach dem Anwenden von Weißabgleich-Multiplikatoren auf die Rohdaten vor dem Zuschneiden. Stellen Sie sicher, dass Sie alle drei auf das Niveau des kleineren Kanals zuschneiden, damit in hellen Bereichen keine falschen Farben auftreten. Die Bilddaten werden bei 0-1 aufgezeichnet, wobei 1 der volle Maßstab ist.

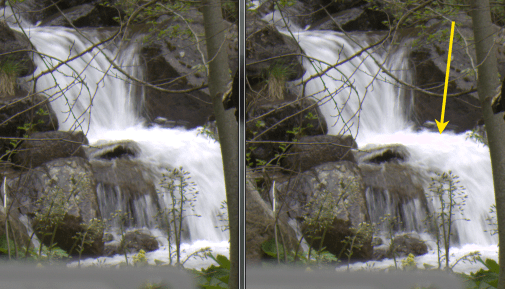

Das Zuschneiden in vollem Umfang ist erforderlich, da in Bereichen, in denen keine Daten von allen drei Kanälen vorliegen, die resultierende Farbe wahrscheinlich falsch ist. Im endgültigen Bild kann sich dies beispielsweise als rosa Farbton in Bereichen nahe der maximalen Helligkeit manifestieren. Dies ist zum Beispiel bei Bildern von schneebedeckten Bergen sehr ärgerlich. Daher löst das Beschneiden dieses Problem kompromisslos.

Zahl: 9: Links: Bild nach dem Anwenden des Weißabgleichs korrekt zugeschnitten. Rechts: Das Bild wird nicht beschnitten. Der gelbe Pfeil zeigt einen Bereich nahe der maximalen Helligkeit, in dem unvollständige Informationen aus den Farbkanälen einen rosa Farbton ergeben.

Anstatt zuzuschneiden, könnte man bestimmte Annahmen über die fehlenden Farben treffen und die relativen Daten ergänzen. In fortgeschrittenen RAW-Konvertern erfolgt dies durch Algorithmen oder Schieberegler mit Namen wie "Hervorhebungsrekonstruktion". Es gibt viele Möglichkeiten, dies zu tun. Wenn zum Beispiel nur ein Kanal fehlt, wie im Fall von Grün von 1,0 bis 1,2 in Abb. In 8 ist es am einfachsten anzunehmen, dass sich die Glanzlichter im neutralen Weißbereich befinden und die Rohbilddaten den richtigen Weißabgleich aufweisen. Dann ist in jedem Quartett, in dem die grüne Farbe abgeschnitten wird und die anderen beiden nicht, der Wert von Grün gleich dem Durchschnittswert der beiden anderen Kanäle. Für diese Aufnahme wäre diese Strategie in der Lage, nicht mehr als 1/4 eines Schritts in hellen Bereichen zu rekonstruieren (log 2)(1,2)). Dann wäre es notwendig, die Glanzlichter zu komprimieren und / oder den neuen vollen Maßstab wieder auf 1,0 zu normalisieren.

5. Debayerisierung von CFA-Daten

Bisher befand sich das CFA-Bild in derselben Schwarzweiß-Ebene, wodurch die farbigen Bereiche pixelig erschienen, wie in Abb. 2 zu sehen ist. 6. Es ist Zeit für das Debayering - Trennen der roten, grünen und blauen Pixel in Abb. 2 in separate Farbebenen in voller Größe durch Annäherung der fehlenden Daten (in der folgenden Abbildung sind sie als weiße Quadrate dargestellt).

Zahl: 10: Debayering - Ausfüllen fehlender Daten in jeder Farbebene unter Verwendung von Informationen aus allen drei Ebenen.

In diesem Schritt kann eine Vielzahl von erweiterten Debayering-Algorithmen verwendet werden. Die meisten von ihnen funktionieren sehr gut, aber einige sind je nach Situation besser als andere. Einige RAW-Konverter wie Open Source RawTherapee und dcraw fordern den Benutzer auf, einen Algorithmus aus einer Liste auszuwählen. Die meisten Konverter bieten diese Option nicht an und verwenden denselben Debayering-Algorithmus. Wissen Sie, welchen Debayering-Algorithmus Ihr bevorzugter RAW-Konverter verwendet?

In diesem Test habe ich beschlossen, jedes RGGB-Quartett zu betrügen und einfach zu einem einzigen RGB-Pixel zu komprimieren. Dabei wurden die R- und B-Werte für jedes Quartett wie in den Rohdaten belassen und G über zwei gemittelt (dies entspricht dem dcraw-h-Modus). Es ist ein 2 × 2-Debayering-Algorithmus für den nächsten Nachbarn. Es ergibt ein benutzerfreundlicheres Bild, das halb so groß ist (in linearen Abmessungen oder viermal in der Fläche).

Zahl: 11: Rohes RGB-Bild nach Schwarz-Subtraktion, Weißabgleich, Zuschneiden, linearer Helligkeitskorrektur und 2x2-Debayering für den nächsten Nachbarn (entspricht dcraw –h).

In Abb. In 11 können Sie sehen, dass unsere Rohdaten jetzt RGB mit drei vollständig gefüllten Farbebenen sind. Die Farben, die von der Kamera aufgenommen wurden, wurden vom Browser und vom Monitor angezeigt. Sie sehen langweilig aus, unterscheiden sich aber nicht wesentlich vom Original. Shades werden nicht im Standard-RGB-Bereich gespeichert, sodass Software und Hardware nicht immer wissen, was sie damit tun sollen. Der nächste Schritt besteht darin, diese Farben in einen gemeinsamen kolorimetrischen Standardfarbraum zu konvertieren.

6. Farbkonvertierung und -korrektur

Dies ist einer der am wenigsten intuitiven, aber wichtigsten Schritte, um ein fertiges Bild mit ansprechenden Farben zu erhalten. Alle Hersteller halten die Geheimnisse ihrer Farbfilter eifersüchtig im CFA ihrer Matrizen, aber mit der richtigen Ausrüstung ist es nicht allzu schwierig, spektrale Empfindlichkeitsfunktionen abzuleiten. Selbst mit einem billigen Spektrometer können Sie sich einen groben Überblick über die Funktionen Ihrer Kamera verschaffen .

Mit all dem ausgestattet und mit vielen Annahmen über typische Lichtquellen, Szenen und Betrachtungsmethoden kann ein lineares Kompromissarray generiert werden, das die Farbe von einem CFA-Bild (wie in Abbildung 11 gezeigt) in eine Standardfarbe konvertiert wird in der Lage sein, gängige Programme wie Editoren oder Browser sowie Geräte wie Displays und Drucker zu erkennen.

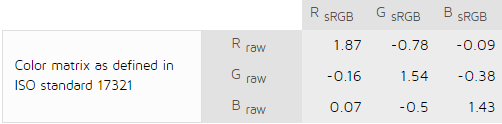

Zum Glück messen und berechnen mehrere hervorragende Labors diese Matrizen - und stellen sie dann öffentlich zur Verfügung. Beispielsweise erstellt DXOmark.com Matrizen zum Konvertieren von Rohfotodaten nach dem Weißabgleich in sRGB für zwei Quellen für jede Kamera in ihrer Datenbank. Hier ist zum Beispiel der Sensor für Nikon D610 undStandardlichtquelle D50:

Abb. 12: Farbmatrix aus dem DXO-Labor für Lichtquelle D50: von weißabgeglichenen und debayerisierten Daten zu sRGB.

Welche der Kompromissmatrizen die beste ist, hängt von der spektralen Verteilung der Energie der Lichtquelle zum Zeitpunkt der Aufnahme des Rahmens ab. Daher wird die reale Matrix normalerweise anhand einiger Referenzen interpoliert. In der heutigen Adobe-Welt sind dies die Standardlichtquellen A und D65, die für die Begrenzung des Bereichs typischer Beleuchtung in der Alltagsfotografie verantwortlich sind, von Wolfram über Tageslicht bis hin zur Innenfotografie. Die konvertierten Daten werden dann an eine Lichtquelle angepasst, die dem endgültigen Farbraum entspricht - für sRGB beispielsweise D65. Das Ergebnis ist eine Art Matrix, wie die in Abb. 12. Dann müssen Sie es nur noch mit den RGB-Werten jedes debayerisierten Pixels nach Schritt 5 multiplizieren.

In der SpezifikationAdobe empfiehlt einen flexibleren Prozess für seinen DNG-Konverter. Anstelle eines direkten Übergangs von der CFA-Kamera zum kolorimetrischen Farbraum konvertiert Adobe die Daten zunächst in den Farbraum der Profilverbindung (XYZ D50), multipliziert die Daten nach dem Weißabgleich und dem Debayering mit einer interpolierten Vorwärtsmatrix und gelangt dann zum endgültigen Farbraum wie sRGB. Manchmal wendet Adobe auch eine zusätzliche nichtlineare Farbkorrektur mit speziellen Profilen in XYZ an (in der DNG-Sprache sind dies HSV-Korrekturen über ProPhoto RGB, HueSatMap und LookTable).

Die direkten Matrizen der Kamera, die das Bild aufgenommen hat, werden in jeder DNG-Datei aufgezeichnet, lobt Adobe. Ich habe die Matrizen für D610 von dort und die Matrizen XYZD50 -> sRGBD65 von Bruce Lindblums Website heruntergeladen und bekommenEndbild:

Abb. 13: "Ziemlich" konvertiertes Bild. Rohdaten, Schwarzwerte subtrahiert, Weißabgleich durchgeführt, Zuschneiden, Helligkeit optimiert, 2x2-Debayering, Farboptimierung und Konvertierung in sRGB.

Jetzt sind die Farben das, was Programme und Geräte im sRGB-Farbraum erwarten. Falls Sie sich fragen, ist dieses Bild fast identisch mit dem des Nikon Flat Profile Capture NX-D-Konverters. Aufgrund des schlechten Kontrasts unserer Monitore sieht es jedoch nicht sehr scharf aus (siehe Tone Mapping).

7. Anwendung von Gamma

Der letzte Schritt hängt vom ausgewählten Farbraum ab. Das Gamma für den sRGB-Raum beträgt ungefähr 2,2 . Ich erwähne dies nur speziell, um zu zeigen, dass der Renderprozess an dieser Stelle nicht linear wird. Ab diesem Moment wird das Bild auf den kolorimetrischen Farbumfang des Farbraums reduziert und kann entweder in Ihren bevorzugten Editor geladen oder auf dem Bildschirm angezeigt werden. Theoretisch waren alle vorherigen Schritte linear, dh leicht reversibel.

+ Tonanzeige

Im Jahr 2016 ist fast immer eine Tonkorrektur erforderlich, um zu entscheiden, wie der hohe Dynamikbereich einer Kamera in einen kleinen Bereich des Bildgebungsgeräts gedrückt werden soll. Abhängig von Ihrer Rauschbeständigkeit beträgt der Dynamikbereich meines D610 beispielsweise 12 Stufen, während mein recht guter Monitor ein Kontrastverhältnis von 500: 1 oder etwa 9 Stufen aufweist. Dies bedeutet, dass die unteren drei Schritte von der Kamera aufgrund der Hintergrundbeleuchtung auf dem Monitor nicht sichtbar sind.

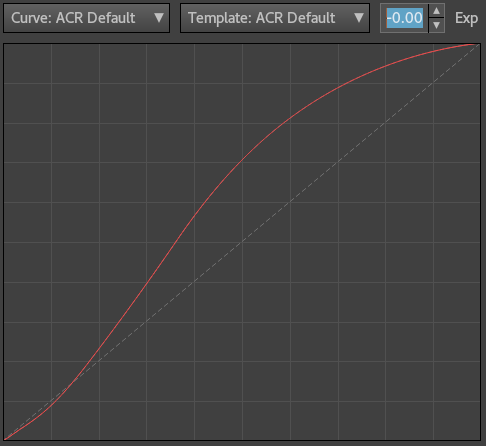

Die RGB-Kurve verteilt die Töne subjektiv über den Bereich neu, sodass einige Schatten auf Kosten einiger der hellsten Bereiche besser sichtbar sind (daher wird diese Kurve als "Tonkurve" bezeichnet). Zum Zeitpunkt dieses Schreibens wird eine solche Kurve normalerweise von Adobe in ACR / LR zum Rendern angewendet, bevor das Bild zum ersten Mal angezeigt wird:

Zahl: 14: Tonkurve, die von ACR / LR gegen Ende des Renderprozesses in Prozessversion 3 (2012-2016) angewendet wird. Die horizontale Achse ist nicht linear.

In diesem Fall habe ich es nicht benutzt. Ich habe gerade eine Kurve zum Erhöhen des Kontrasts angewendet und Abb. In Photoshop CS5 etwas Schärfe hinzugefügt. 13, um das endgültige Bild zu erhalten:

Abb. 15: Endgültiges sRGB-Bild. Anfängliche Rohdaten, subtrahierte Schwarzwerte, Weißabgleich, Zuschneiden, Helligkeitsoptimierung, Debayering, Farboptimierung, Tonkurve angewendet

Das Ändern einer Kontrastkurve zu einem späteren Zeitpunkt ändert natürlich die Farbart und Sättigung der Farben. Genau dies geschieht jedoch, wenn Sie diese Anpassungen nach dem Rendern des Bildes auf den RGB-Gammaraum anwenden. Historisch gesehen passierte so alles in Kameras und so passierte alles in gängigen RAW-Konvertern - das ist das Verfahren, an das wir uns im Laufe der Jahre gewöhnt haben. Eine Alternative zur Erzielung einer "Genauigkeit" der Farbwiedergabe besteht darin, das Farbprofil von der Torgera-Website zu verwenden und den Ton nicht mehr zu berühren.

Fassen wir zusammen

Für eine grundlegende RAW-Konvertierung mit linearer Anpassung von Helligkeit und Farbe benötigen Sie also:

- Laden Sie lineare Daten aus der RAW-Datei und subtrahieren Sie die Schwarzwerte.

- Weißabgleich.

- Korrigieren Sie die lineare Helligkeit.

- Bilddaten zuschneiden.

- Debayerize.

- Wenden Sie Farbtransformationen und Korrekturen an.

- Gamma auftragen.

Und das ist alles - der Schleier der Geheimhaltung bei der Konvertierung von Rohdaten wurde weggerissen.

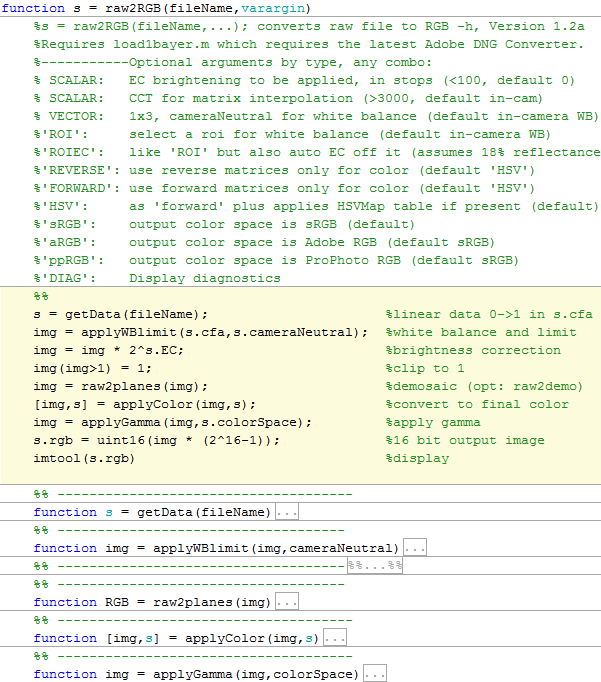

Skripte für Matlab zum Abrufen der in diesem Artikel angegebenen Bilder können über den Link heruntergeladen werden . Die 7 grundlegenden Schritte sind gelb markiert:

s = raw2RGB(‘DSC_4022’ , ‘ROI’ , 1.1)

Speichern Sie die Datei nach Verwendung des Skripts im TIFF-Format, laden Sie sie in den Farbeditor und wenden Sie den ausgewählten Farbraum an, um die richtigen Farben anzuzeigen.