Die technologische Welt hat einen neuen Hype angenommen - GPT-3.

Riesige Sprachmodelle (wie GPT-3) überraschen uns immer mehr mit ihren Fähigkeiten. Während das Vertrauen der Unternehmen in sie nicht ausreicht, um sie ihren Kunden zu präsentieren, zeigen diese Modelle die Anfänge der Intelligenz, die die Entwicklung der Automatisierung und die Fähigkeiten "intelligenter" Computersysteme beschleunigen wird. Lassen Sie uns die Aura des Geheimnisses aus GPT-3 herausnehmen und herausfinden, wie es lernt und wie es funktioniert.

Das trainierte Sprachmodell generiert Text. Wir können auch Text an die Eingabe des Modells senden und sehen, wie sich die Ausgabe ändert. Letzteres wird aus dem, was das Modell während der Trainingsperiode "gelernt" hat, durch Analyse großer Textmengen generiert.

Lernen ist der Prozess der Übertragung einer großen Textmenge auf ein Modell. Für GPT-3 ist dieser Prozess abgeschlossen und alle Experimente, die Sie sehen können, werden auf dem bereits trainierten Modell ausgeführt. Es wurde geschätzt, dass die Schulung 355 GPU-Jahre (355 Jahre Schulung auf einer einzelnen Grafikkarte) dauern und 4,6 Millionen US-Dollar kosten würde.

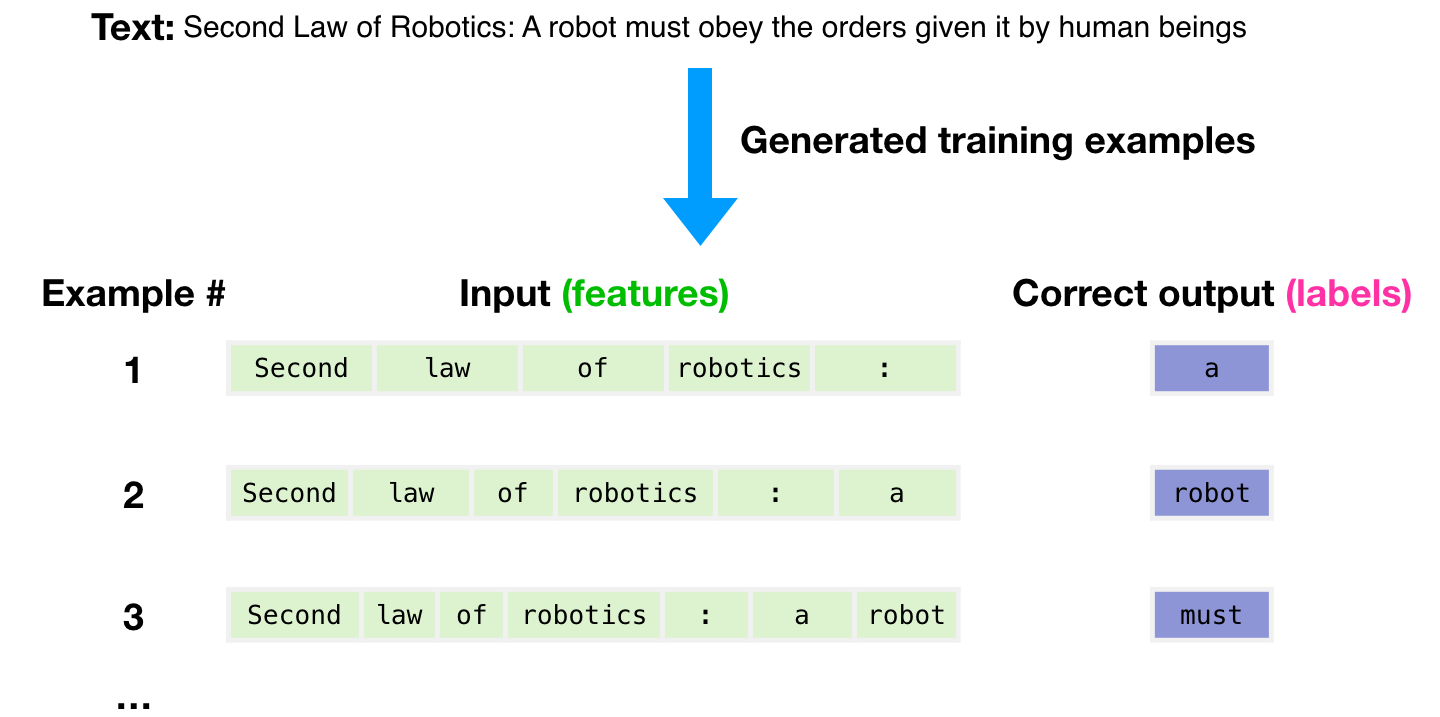

Ein Datensatz von 300 Milliarden Text-Token wurde verwendet, um Beispiele für das Training des Modells zu generieren. So sehen beispielsweise drei Trainingsbeispiele aus, die aus einem Satz oben abgeleitet wurden.

, , .

( ) .

. , .

.

.

GPT-3 ( , – ).

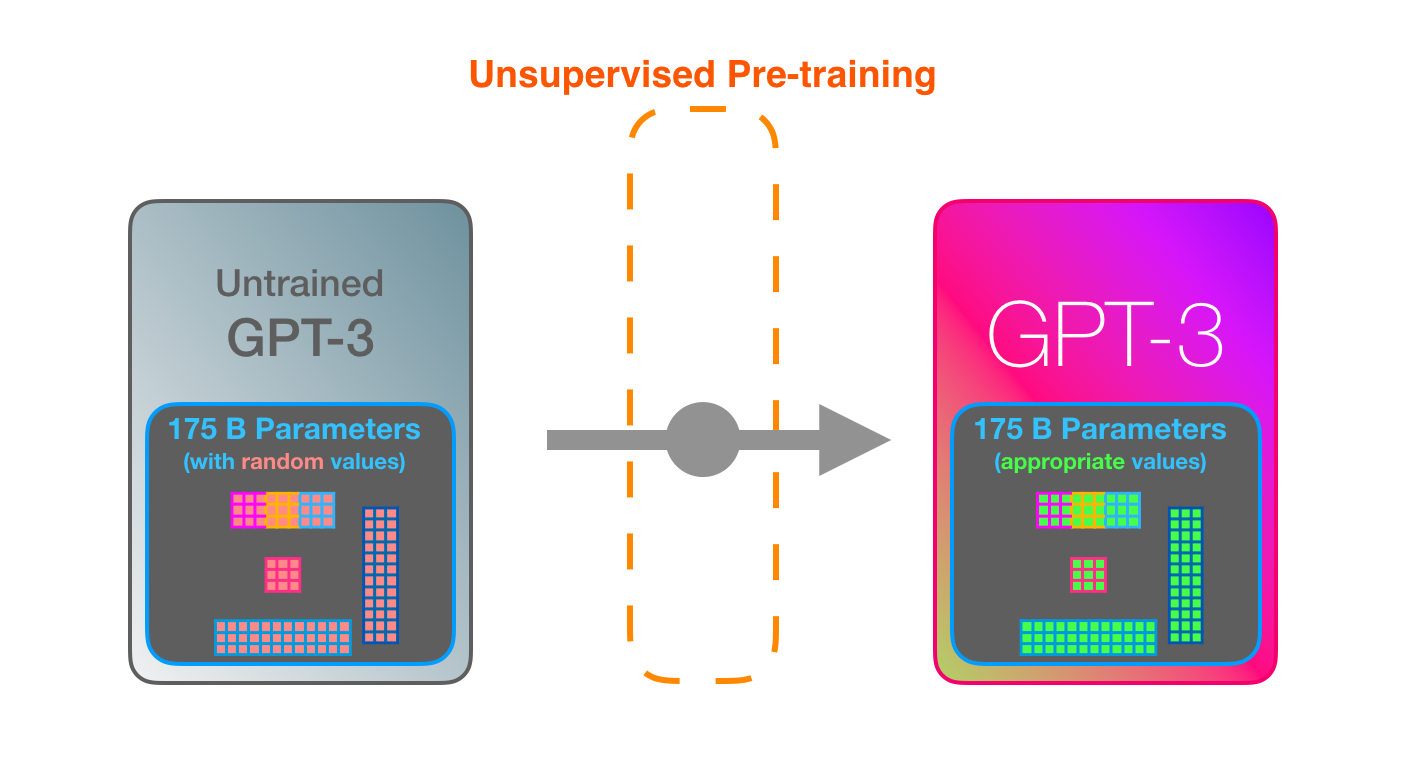

GPT-3 . , , 175 ( ). .

, , .

– , – , .

« Youtube» – 175- .

, , .

GPT-3 2048 – « », 2048 , .

. «robotics» «A»?

:

- ( ).

- .

- .

GPT-3 96 .

? «» « » (deep learning).

1.8 . «». :

, , GTP-2 .

GPT-3 (dense) (sparse) (self-attention).

«Okay human» GPT-3. , . : , . .

React ( ), , => . React , , .

Es kann davon ausgegangen werden, dass die ersten Beispiele und Beschreibungen zusammen mit speziellen Token, die die Beispiele vom Ergebnis trennen, zur Eingabe des Modells hinzugefügt wurden.

Die Art und Weise, wie es funktioniert, ist beeindruckend. Sie müssen nur warten, bis die GPT-3-Feinabstimmung abgeschlossen ist. Und die Möglichkeiten werden noch erstaunlicher sein.

Durch das Optimieren werden lediglich die Modellgewichte aktualisiert, um die Leistung für eine bestimmte Aufgabe zu verbessern.

Autoren

- Ursprünglicher Autor - Jay Alammar

- Übersetzung - Ekaterina Smirnova

- Bearbeitung und Layout - Sergey Shkarin