Das Thema der Aktualisierung des Moore'schen Gesetzes durch Auffinden komplexerer Abhängigkeiten der Evolution von Computersystemen, die zur Diskussion gestellt werden, wird heute von Forschern auf dem Gebiet der Plasmonik- und Nanophotonik-Technologien gut verstanden.

Wichtig: Die meisten Links im Artikel führen zu Materialien in englischer Sprache. In Russland gibt es nicht so viele einheimische Forscher der Photonik, und diejenigen, die es gibt, möchten lieber auf Englisch veröffentlicht werden.

Wenn Sie das Thema in Ruhe bei einer Tasse Tee studieren möchten , können Sie sich den Bericht von Dmitry Fedyanin anhören - einer der führenden russischen Forscher zur Anwendung von Nanophotonik-Technologien in Computersystemen.

Dmitry Fedyanin ist Senior Researcher am MIPT.

Und dann werden wir einen interessanten Artikel analysieren, in dem eine Gruppe von Autoren ein äußerst originelles Konzept der Produktivitätswachstumsmetrik vorschlägt, eine Alternative zum klassischen Mooreschen Gesetz. Die Idee ist dank der Analyse der natürlichen physikalischen Grenzen der vorhandenen Technologien für den Betrieb von Prozessorkernen sowie der experimentell bestätigten Aussichten auf neue Systeme auf Basis der Nanophotonik gereift.

Die ständigen Anforderungen des modernen Industriesystems an die Verbesserung der Recheneffizienz und der Kommunikationsbandbreite haben die Halbleitertechnologien in ihrem gegenwärtigen Zustand an ihre Grenzen gebracht. Dies hat zur Entstehung neuer Technologien geführt, die herkömmliche Lösungen übertreffen können. Wir sprechen von photonischen Präprozessoren oder Beschleunigern, Elektronen-Photonen-Hybridschaltungen und neuronalen Netzen. Die Bemühungen, die Entwicklung der Leistung von Computersystemen zu beschreiben und vorherzusagen, erlauben es jedoch nicht, die tatsächlich beobachtete Entwicklungsrate genau vorherzusagen und dadurch zu erklären. Das heißt, alle vorgeschlagenen Indikatoren weichen einige Jahre nach ihrem ursprünglichen Vorschlag letztendlich von ihrem Entwicklungsverlauf ab. Diese Diskrepanz erfordert eine ausgeglichene Metrik.Dies würde eine ganzheitliche Reihe von Triebkräften für die Entwicklung von Computersystemen beinhalten.

Das ursprüngliche Konzept einer neuen Metrik namens Fähigkeit zur Latenz-Mengen-Beständigkeit (CLEAR) wurde von einem internationalen Forscherteam (Shuai Sun, Vikram K. Narayana, Mario Miscuglio, Lionel C. Kimerling, Tarek El-Ghazawi, Volker J. Sorger) vorgeschlagen. Laut den Autoren des Artikels (siehe hier) Diese Metrik deckt die Dynamik von Änderungen der Synchronisationsraten, der Energieeffizienz, der Skalierung der physischen Größe von Computern und der wirtschaftlichen Kosten ab. Laut den Autoren ist CLEAR heute die einzige Metrik, die die historische Entwicklung von Computersystemen korrekt beschreibt. Selbst bei unterschiedlichen Optionen und gegenseitigen technologischen Kombinationen entspricht CLEAR der beobachteten konstanten Wachstumsrate, einschließlich der dominanten Computertechnologien, die für die zukünftige Implementierung vorgeschlagen werden (Prognose). CLEAR wird den Lesern als Leitfaden zur quantitativen Vorhersage des Produktivitätswachstums von Computersystemen jetzt und in Zukunft präsentiert.

Trotz der Tatsache, dass die Entwicklung der Rechenleistung im Allgemeinen ständig zunimmt, verlangsamt sich die beobachtete Leistungsgeschwindigkeit von Geräten, die auf der bestehenden Halbleiterindustrie basieren, merklich, insbesondere bei der 14-nm-Technologie (siehe hier und hier ). Dies ist sowohl auf natürliche physikalische Einschränkungen als auch auf die wachsenden wirtschaftlichen Kosten des kontinuierlichen industriellen Chipherstellungsprozesses zurückzuführen.

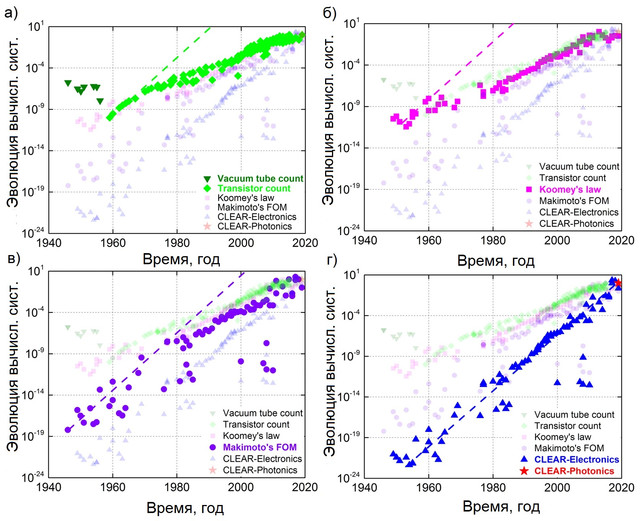

Aus diesen Gründen wurde das Mooresche Gesetz als Fahrplan für die Halbleiterindustrie mehrmals überarbeitet, um diese Hindernisse zu beseitigen (siehe hier)). In ähnlicher Weise weicht die Dynamik der Entwicklung (Abhängigkeit von der Zeit) anderer Beziehungen physikalischer Größen, wie beispielsweise der Indikator für die Effizienz der Nutzung der Rechenleistung ( Kumi-Gesetz ) oder der Indikator für die Rechenleistung, der sich aus dem Verhältnis von Energieverbrauch, Größe und Kosten ( Makimoto-Gesetz ) ergibt, gleichermaßen ab Im Vergleich zur beobachteten Geschwindigkeit der Technologieentwicklung (Abb. 1) kann die im Indikator gewählte Zeitfunktion (z. B. Multicore, Herstellungskosten) in der Praxis kein exponentielles Wachstum liefern.

Beispielsweise ist die Leistung eines Prozessors mit N Kernen immer noch durch das Verhältnis 1 / ((1-p) + p / N) begrenzt , wobei p der Parallelisierungsgrad ist (siehe.hier ). Daher wird es immer schwieriger, die Entwicklung der Leistung von Computersystemen zu verfolgen, wenn wir nur das Moore'sche Gesetz (oder andere vorhandene Vorhersagemetriken) verwenden, bei dem nur ein oder mehrere treibende Faktoren zur Beschreibung der Leistung eines Computersystems verwendet werden (siehe hier ). Darüber hinaus ändern sich die Vorteile verschiedener Hardware-Implementierungen (z. B. elektrisch, optisch) im Laufe der Zeit auf unterschiedliche Weise, was die evolutionäre Vorhersage noch schwieriger macht.

Beispielsweise können integrierte Photonik und möglicherweise Plasmonik bestimmte Kommunikationskanäle auf einer Platine oder sogar auf einem Chip erweitern. Infolgedessen werden Probleme mit der Wärmeableitung erheblich verringert und die Datenbandbreite erhöht, wobei die elektronische digitale Effizienzbarriere durch konzeptionelle Ansätze wie Wellenlängenmultiplex ( WDM ), optischen Drehimpuls oder höhere Modulationsformate wie Polarisationsamplitudenmodulation überwunden werden kann . Modulation (zum Beispiel QAM ), bei der Phasen- und Amplitudenpolarisation gleichzeitig verwendet werden (siehe hier und hier ).

In Bezug auf Kompromisse mit anderen Technologien nimmt ein elektronischer Transistor mit einem 14-nm-Prozessknoten eine Fläche ein, die 3 Größenordnungen kleiner ist als ein Ringmodulator einer photonischen Mikroscheibe. Die Photonik bietet jedoch eine Verbindung auf Kanalebene ohne kapazitive Lade- / Entladungsdrähte, obwohl sie in Bezug auf die obigen synergistisch ist einzigartige Eigenschaften, die Datenübertragungsraten bis zu Tbit / s unterstützen (siehe hier ). Abbildung 1. Die Art der Entwicklung von Computersystemen von 1946 bis heute kann in Form von vier verschiedenen Indikatoren dargestellt werden: (a) Mooresches Gesetz - basierend auf dem Wachstum der Anzahl von Komponenten auf einem Chip, gemessen in Einheiten der numerischen Anzahl von Transistoren; (b)

Kumis Gesetz - spiegelt die Energieeffizienz pro Recheneinheit wider, Bit / (s * Joule); (c) Makimoto-Index, der "Intelligenz", Leistung, Größe und Kosten des Systems enthält - gemessen in Einheiten von MIPS / (W * mm3 * $); und (d) den in Gleichung (4) definierten CLEAR-Score, der die Systemlatenz zusätzlich zum Makimoto-Score und die mit der Einführung der neuen Technologie verbundenen wirtschaftlichen Kosten berücksichtigt: MIPS / (s * W * mm3 * $). Photonische CLEAR-Daten basieren auf Intels Vorhersage der Siliziumphotonik. Gestrichelte Linien repräsentieren die lineare Anpassung (logarithmisch) basierend auf der anfänglichen Wachstumsrate, wobei sich die jährliche Produktivität verdoppelt.

Laut den Autoren ist der 5-Faktor-Indikator CLEAR (dessen Name die Abkürzung Capability-to-Latency-Energy-Amount-Resistance darstellt) bei weitem die zuverlässigste Beschreibung der Entwicklung der Rechenleistung während des bekannten historischen Zeitraums, beginnend mit dem Beginn der Entstehung von Computertechnologien in den 1940er Jahren. und bis heute. Dieser Indikator deckt sowohl physikalische als auch wirtschaftliche Faktoren ab, die mit dem Entwicklungstempo verschiedener Rechenoptionen verbunden sind. Somit kann CLEAR als technologieunabhängiger quantitativer Indikator verwendet werden, da es sowohl grundlegende physikalische als auch wirtschaftliche Abhängigkeiten umfasst.

Basierend auf Beobachtungen und Analysen ziehen die Autoren zwei wichtige Schlussfolgerungen:

- , ;

- ( ) , (.. CLEAR) ( ) .

Die Weiterentwicklung der Grundlagenphysik, das Management der Halbleitertechnologie und die wirtschaftlichen Kosten erfordern ständige Änderungen und Anpassungen, um die Technologie der Computersysteme schrittweise voranzutreiben. Seit der Gründung der Halbleiterindustrie hat das Moore'sche Gesetz die zugrunde liegenden Faktoren mehrmals geändert: Von der Zählung von Transistoren entfaltet sich die Branche aufgrund von Einschränkungen der Chipgröße und der erhöhten Komplexität des Gesamtsystems (siehe hier ).

Der zweite Sprung trat auf, als die Taktfrequenz aufgrund der durch das Dennard-Skalierungsgesetz beschriebenen Einschränkungen der Verlustleistung der Leistungsdichte an ihre Grenzen stieß (siehe hier)). Wenn sich die Skalierung von Transistoren grundlegenden physikalischen Grenzen nähert, nimmt die Anzahl der Transistoren zu diesem Zeitpunkt aufgrund der Parallelität, die in mehrkernigen und massiv parallelen heterogenen Architekturen implementiert ist, weiter zu. Dies erhöht den Engpass in der Verbindung, was dazu führt, dass bestimmte Bereiche des Chips ( "dunkles Silizium" ) deaktiviert werden müssen . Somit hat sich die Wachstumsrate von einer anfänglichen Verdoppelung alle 12 Monate auf jetzt etwa 24 Monate geändert.

In jüngster Zeit ist eine neue treibende Kraft aus einem völlig anderen Bereich hervorgegangen, der die Entwicklung von Computersystemen beeinflusst: integrierte Photonik und hybridisierte Nanophotonik, bei der die Weiterleitung des Lichtsignals durch passive integrierte photonische Komponenten erfolgt, während die elektrooptischen aktiven Komponenten durch neue Lösungen verstärkt werden:

- rekonfigurierbare Materialien;

- Starke Wechselwirkungen von Licht mit Materie wie Plasmonik oder Photonik ENZ (Epsilion nahe Null), die zusammen eine Datenverbindung und Bandbreite bieten, die die herkömmliche Elektronik auf zwei Ebenen übertreffen: dem Chip und dem Kern (siehe hier ).

Bei diesen neuen Technologien ist es nicht möglich, einfach die Anzahl der Komponenten pro Chip zu zählen oder den Platzbedarf und die Kosten als separate Metrik zu skalieren, da sie die tatsächliche Leistungsänderung nicht genauer widerspiegeln. Von großer Bedeutung ist auch der Trend zur Entstehung anderer Technologien, wie sie beispielsweise in der optischen Kommunikation verwendet werden, bei denen mehrere Signale mit unterschiedlichen Wellenlängen in denselben physikalischen Kanal gepackt werden und somit die Auslastung der Hardware verbessern. Dies ist ein wesentlicher Faktor bei der Bewertung der Systemleistung. Folglich ist eine ganzheitliche Metrik erforderlich, die mehrere treibende Kräfte berücksichtigt, um einen genauen Vergleich des Beitrags verschiedener technologischer Lösungen zur Entwicklung von Computersystemen zu ermöglichen.

Ein einziger Indikator für die Entwicklung von Computersystemen

Um eine technologieunabhängige Metrik zu erhalten, sammelten die Autoren Daten zur Leistung von Desktops, Laptops, Mobilgeräten, Servern, Workstations und Supercomputern seit den 1940er Jahren und verglichen sie mit herkömmlichen Metriken (Abbildung 1).

Insbesondere nimmt das Moore'sche Gesetz die Anzahl der Transistoren als einzigen ausreichenden Faktor an (Gleichung 1), während das Kumi'sche Gesetz bereits auf zwei Faktoren beruht: Energie und Anzahl der Berechnungen, wodurch die Basis für den Indikator, gemessen in Bits / (s * J), zusammengefasst wird. (Gleichung 2). Millionen von Anweisungen pro Sekunde (MIPS) pro Größen-Kosten-Leistungseinheit werden als Makimoto-Metrik bezeichnet, die bereits als 4-Faktor-Metrik definiert ist (Gleichung 3).

Moores Gesetz = Anzahl der Transistoren [Menge] (1)

Kumis Gesetz= Berechnungen / Energie [Bit / (s * J)] (2)

Makimoto-Score = Intelligenz / (Größe * Kosten * Leistung) [MIPS / (mm3 * $ * W)] (3)

Die Werte dieser drei Indikatoren zeigen ein ähnliches Wachstumsmuster : Der Aufwärtstrend verfolgt ihre Rohdaten gut, aber nur für einen begrenzten Zeitraum, und weicht schließlich von ihnen ab. Dies deutet darauf hin, dass die zugrunde liegenden Faktoren die tatsächliche treibende Kraft, die die Entwicklung von Computersystemen dominiert, nicht vollständig erfassen konnten.

Analyse der Trendlinien in Abb. 1 zeigt, dass die Anzahl der Transistoren ursprünglich (1950er - 1960er Jahre) Moores Gesetz des zweifachen jährlichen Wachstums gut widerspiegelt (gestrichelte hellgrüne Linie, Abb. 1). Die Skalierung der Energieeffizienz (dh das Kumi-Gesetz) wurde jedoch in der nächsten Zeit (1960er bis 1970er Jahre) zum dominierenden Faktor, da das einfache Hinzufügen weiterer Transistoren durch die Größe und Komplexität des Chips begrenzt war. Aus diesem Grund begann das Moore'sche Gesetz vom 2X / Jahr-Trend abzuweichen, während das Makimoto'sche Gesetz seine ursprüngliche Wachstumsrate beibehielt. Seit den späten 1970er Jahren haben Faktoren wie Größe und Leistungsskalierung aufgrund von Problemen mit deutlich komplexeren Herstellungsprozessen, Energieverlust und Wärmeableitung allmählich ihre Grenzen erreicht.Mit dem Aufkommen von Parallelität (d. H. Mehrkernprozessoren) und wirtschaftlicher Skalierung auf dem Markt weicht schließlich auch die Makimoto-Metrik ab (seit 1978). Die in Abb. 1 repräsentiert erste Prognosen des Produktivitätswachstums für jedes Gesetz. Diese Trendlinien zeigen, wie sich jeder zusätzliche Faktor, der durch die entsprechenden Gesetze eingeführt wird, auf seine eigene ursprüngliche Prognosemetrik auswirkt, die als Abweichung von der ursprünglichen Prognose angezeigt wird. Indem dieser Trend als theoretische Obergrenze für die Geschwindigkeit der Technologieentwicklung betrachtet wird, ist es jetzt möglich zu verstehen, ob der „behauptete“ Trend tatsächlich „tatsächlich“ ist oder nicht. Das heißt, ist das derzeitige Gesetz der Grund für die Verlangsamung der Technologieentwicklung oder beginnen neue Produktivitätsfaktoren zu dominieren.ebenfalls abgelehnt (seit 1978). Die in Abb. 1 repräsentiert erste Prognosen des Produktivitätswachstums für jedes Gesetz. Diese Trendlinien zeigen, wie sich jeder zusätzliche Faktor, der durch die entsprechenden Gesetze eingeführt wird, auf seine eigene ursprüngliche Prognosemetrik auswirkt, die als Abweichung von der ursprünglichen Prognose angezeigt wird. Indem dieser Trend als theoretische Obergrenze für die Geschwindigkeit der Technologieentwicklung betrachtet wird, ist es jetzt möglich zu verstehen, ob der „behauptete“ Trend tatsächlich „tatsächlich“ ist oder nicht. Das heißt, ist das derzeitige Gesetz der Grund für die Verlangsamung der Technologieentwicklung, oder beginnen neue Produktivitätsfaktoren zu dominieren.ebenfalls abgelehnt (seit 1978). Die in Abb. 1 repräsentiert erste Prognosen des Produktivitätswachstums für jedes Gesetz. Diese Trendlinien zeigen, wie sich jeder zusätzliche Faktor, der durch die entsprechenden Gesetze eingeführt wird, auf seine eigene ursprüngliche Prognosemetrik auswirkt, die als Abweichung von der ursprünglichen Prognose angezeigt wird. Indem dieser Trend als theoretische Obergrenze für die Geschwindigkeit der Technologieentwicklung betrachtet wird, ist es jetzt möglich zu verstehen, ob der „behauptete“ Trend tatsächlich „tatsächlich“ ist oder nicht. Das heißt, ist das derzeitige Gesetz der Grund für die Verlangsamung der Technologieentwicklung, oder beginnen neue Produktivitätsfaktoren zu dominieren.Wie sich jeder zusätzliche Faktor, der durch die einschlägigen Gesetze eingeführt wird, auf seine eigene ursprüngliche Prognosemetrik auswirkt, wird als Abweichung von der ursprünglichen Prognose angezeigt. Indem dieser Trend als theoretische Obergrenze für die Geschwindigkeit der Technologieentwicklung betrachtet wird, ist es jetzt möglich zu verstehen, ob der „behauptete“ Trend tatsächlich „tatsächlich“ ist oder nicht. Das heißt, ob das derzeitige Gesetz der Grund für die Verlangsamung der Technologieentwicklung ist oder neue Produktivitätsfaktoren zu dominieren beginnen.Wie sich jeder zusätzliche Faktor, der durch die einschlägigen Gesetze eingeführt wird, auf seine eigene ursprüngliche Prognosemetrik auswirkt, wird als Abweichung von der ursprünglichen Prognose angezeigt. Indem dieser Trend als theoretische Obergrenze für die Geschwindigkeit der Technologieentwicklung betrachtet wird, ist es jetzt möglich zu verstehen, ob der „behauptete“ Trend tatsächlich „tatsächlich“ ist oder nicht. Das heißt, ist das derzeitige Gesetz der Grund für die Verlangsamung der Technologieentwicklung, oder beginnen neue Produktivitätsfaktoren zu dominieren.ob das derzeitige Gesetz der Grund für die Verlangsamung der Technologieentwicklung ist oder ob neue Produktivitätsfaktoren zu dominieren beginnen.ob das derzeitige Gesetz der Grund für die Verlangsamung der Technologieentwicklung ist oder ob neue Produktivitätsfaktoren zu dominieren beginnen.

Daher gibt es bis heute keinen eindeutigen bekannten Indikator, der:

- die jüngsten Leistungsänderungen erklären;

- Geben Sie Anleitungen zur Vorhersage der zukünftigen Leistung.

Die von den Autoren eingeführte CLEAR-Metrik umfasst Produktivitätsfaktoren aus einer Vielzahl von Technologieoptionen, die sowohl physische als auch wirtschaftliche Einschränkungen umfassen. Die Hauptbehauptung der Autoren ist, dass die Faktoren, aus denen CLEAR besteht, nicht zufällig ausgewählt werden, sondern für technologische und wirtschaftliche Trends von grundlegender Bedeutung sind:

CLEAR = Fähigkeit / (Verzögerung * Energie * Menge * Widerstand) [[MIPS / (s * W * mm3 *) $)]] (4)

oder im Original:

CLEAR = (Fähigkeit) / (Latenz * Energie * Menge * Widerstand) [[MIPS / (s * W * mm3 * $)]]

Die Autoren, die eine Formel für den CLEAR-Indikator formuliert haben, bestimmen eine konstante Wachstumsrate während der gesamten Entwicklung von Computersystemen, die das Leistungswachstum über sieben Jahrzehnte um 4 Größenordnungen abdeckt. Darüber hinaus hat sich die tatsächlich beobachtete Entwicklungsrate alle 12 Monate konstant verdoppelt. Diese 5-Faktor-Bewertung wird basierend auf dem Konzept von Leistung und Kosten bestimmt. CLEAR kann auf Geräte-, Schema- und Systemebene angewendet werden.

Auf Systemebene ist CLEAR beispielsweise wie folgt strukturiert:

Fähigkeit C ist die Systemleistung, die anhand des Produkts aus Millionen von Befehlen pro Sekunde (MIPS) und Befehlslänge gemessen wird.

minimale Verzögerung L.bezieht sich auf die Taktfrequenz und ist durch das Zeitfenster zwischen zwei benachbarten Taktzyklen begrenzt;

Energie E stellt den Energieverbrauch eines solchen Systems dar, um eine bestimmte Leistung zu erhalten, ausgedrückt in Watteinheiten;

Die Größe A repräsentiert das räumliche Volumen (dh die physikalische Größe) des Systems und ist eine Funktion der Prozessdimension;

Der Widerstand R quantifiziert den wirtschaftlichen Widerstand gegen die Markteinführung neuer Technologien. Grundsätzlich verwenden die Autoren ein Wirtschaftsmodell, das auf der Erfahrungskurve der Boston Consulting Group (BCG) basiert und die Beziehung zwischen Gesamtproduktion und Stückkosten erklärt (siehe hier ).

Die Autoren leiten eine lineare Beziehung zwischen der logarithmischen Skala der Einheit von Preis und Zeit ab und bestätigen diese Beziehung durch Vergleich der historischen Daten (siehe hier und hier ) mit CLEAR.

Die Autoren stellen fest, dass die MIPS-Metrik als Maß für die Leistung aufgrund ihrer Anfälligkeit für den zugrunde liegenden Befehlssatz durch Metriken wie Gleitkommaoperationen (FLOPS) ersetzt wird. CLEAR wurde im Laufe der Geschichte auf verschiedene Prozessorarchitekturen angewendet, für die andere Leistungsmetriken in bekannten Benchmark-Suiten (wie SPEC oder LINPAC) nicht verfügbar sind. Um MIPS jedoch zu einer repräsentativen Leistungsmetrik zu machen, gewichteten die Autoren jeden Befehl mit seiner Länge (d. H. Multiplizierten ihn), wodurch die relative Gesamtmetrik in Bit / s angegeben wurde.

Trends bei der Entwicklung von Computersystemen

Nach dem Vergleich aller vier in Abb. 1 stellen wir fest, dass, wenn eine Metrik relevantere Faktoren enthält, ihre anfängliche Abweichung vom ursprünglichen Trend später auftritt. Im Gegensatz zu CLEAR, das die genaue Übereinstimmung der Daten in allem anzeigt. Wir stellen daher empirisch fest, dass die Rechenleistung mit einer festen Rate von etwa einer Verdoppelung pro Jahr ständig wächst und unabhängig von der Technologie ist. Wenn wir neue Rechenmaschinen testen, beispielsweise solche, die auf integrierter Photonik basieren, wie von IBM vorhergesagt (siehe hier ), stellen wir fest, dass solche Technologien den Entwicklungstrend der Entwicklung tatsächlich mit einem jährlichen zweifachen Wachstum fortsetzen könnten (rote Sterne in Abb. 1).

Darüber hinaus werden Sie feststellen, dass die relative Abweichung von der 2X / Jahr-Trendlinie zur Klassifizierung einer Computersystemmetrik verwendet werden kann. Beispielsweise zeigen die zusätzlichen Overhead-Kosten (d. H. Physische Größe, Parallelität, Kühlung, geringe Skaleneffekte und Herstellungskosten) auf Supercomputern die schlechtesten CLEAR-Werte im Vergleich zu allen anderen Computertypen wie Laptops und Mobilgeräten höhere Produktivität (gepunktete Kreise, Abb. 1 c, d). Die hohe Parallelität der in Supercomputern verwendeten Multicore-Technologien wurde durch die Rückkehr von der Berechnung zu der im Amdahlschen Gesetz beschriebenen Energie in Frage gestellt (siehe hier)). Obwohl Supercomputer eine Petaflop-Leistung bieten, ähnelt die gesamte Infrastruktur einer Computerinfrastruktur vor fünf bis dreißig Jahren, was die Skalierbarkeit der Zukunft in Frage stellt.

CLEAR-Analyse

Um ein detaillierteres Verständnis der relativen Auswirkungen jedes der 5 CLEAR-Faktoren zu erhalten, zerlegten die Autoren den Indikator in gegensätzliche Einzelfaktoren, um die tatsächlichen treibenden Kräfte im Laufe der Zeit aufzudecken.

Kombinationen von Faktoren, die in Fig. 1 verwendet werden. 2 stellen C gegen LEAR, CLE gegen AR und CLEA gegen R dar (Fig. 2, C = Fähigkeit, L = Verzögerung, E = Energie, A = Menge, R = Widerstand). Zusätzlich wird die Ausschlussrate C 'im Vergleich zu allen anderen Faktoren gezeigt, da der einzige Skalierungsfaktor in den frühen Jahren der Halbleiterindustrie die Anzahl der Komponenten auf einem Chip ist. Es ist wichtig zu beachten, dass die relativen Positionen jedes Datenpunkts wichtiger sind als die exakten Werte sowohl in der X- als auch in der Y-Achse. Daher werden beide Achsen auf eins normiert, sodass jeder Fall verglichen werden kann.

Da die blau und rot schattierten Bereiche lineare Wachstums- bzw. Sättigungsbereiche darstellen, können aufeinanderfolgende Drehpunktverschiebungen nach rechts leicht erfasst werden, wenn die Anzahl der für die x-Achse berücksichtigten Faktoren (d. H. Die relative Zeit) zunimmt. Um dies zu verstehen, können die Faktoren auf der X-Achse als Antriebskraft des Indikators angesehen werden, während die Werte auf der Y-Achse die tatsächlichen Verfolgungsbedingungen der betreffenden Antriebskräfte angeben. Folglich bedeutet eine lineare Domäne, dass Faktoren auf der X-Achse immer noch die Entwicklung der Technologie dominieren, während sich die treibende Kraft der Technologie beim Eintritt in die Sättigungsdomäne auf andere Faktoren zu verlagern beginnt. Dieses Ergebnis stimmt mit der Beobachtung überein, dass die Entwicklung eines Computersystems immer mit dieser konstanten Geschwindigkeit wächst und eine Diskrepanz mit dem Indikator nur dann auftritt, wennwenn andere treibende Kräfte auftreten.

Abbildung 2. Analyse der Antriebskraft LÖSCHEN.

Der CLEAR-Indikator ist in vier Gruppen unterteilt, von denen jede aus zwei Teilen besteht: einem Koeffizienten, der Faktoren bei der Entwicklung der Technologie zeigt (X-Achse), und einem Offenlegungsfaktor, der die Fähigkeit zeigt, einen ausgewählten Faktor oder eine Kombination von Faktoren (Y-Achse) zu verfolgen. Die Ergebnisse zeigen, dass eine spätere Abweichung von der normalisierten Entwicklung beobachtet wird, wenn mehr Faktoren berücksichtigt werden, um die Leistung von Computersystemen zu beschreiben. (a) schwer fassbare Geschwindigkeit C 'gegen Verzögerungsenergie-Mengen-Kosten (LEAR); (b) Fähigkeit C gegen Verzögerung-Energie-Menge-Kosten (LEAR); (c) Fähigkeit zur Verzögerungsenergie (CLE) gegenüber Mengenkosten (AR); (d)Verzögerungs-Energie-Mengen-Fähigkeit (CLEA) gegenüber Kosten R. Die X- und Y-Achse sind zum besseren Vergleich auf eins normiert. Lineare Wachstums- und Sättigungsbereiche sind mit blauen bzw. roten Schatten bedeckt.

Anwendung LÖSCHEN

Es ist wichtig, dass die Fähigkeit, die Entwicklung verschiedener Technologien nahtlos zu verfolgen, es CLEAR ermöglicht, zukünftige technologische Substitutionen vorherzusagen und den Standard für zukünftige Technologien zu bestimmen, einschließlich ihrer Hybridisierung beispielsweise zwischen Elektronik und Photonik (siehe hier , hier , hier und hier ).

Technologischer Wandel

In-Chip-photonische Verbindungen haben kürzlich eine hohe Datenübertragungskapazität (überlegen gegenüber herkömmlichen elektrischen Verbindungen) gezeigt, wenn sie mit aktiven plasmonischen Vorrichtungen hybridisiert wurden (siehe hier ). Während optisches Datenrouting als mögliche Lösung zur Beseitigung von Kommunikationsengpässen zwischen Rechenkernen angesehen wird und häufig in Rechenzentren und Supercomputern verwendet wird, muss die integrierte Photonik im Mainstream-Verbrauchersektor noch implementiert werden. Dies scheint zunächst überraschend, da frühere Studien überlegene Eigenschaften der Photon-Plasmon-Hybridisierung nahegelegt haben. Die Frage ist also, warum integrierte Photonik nicht in Massenmarktprodukten verwendet wird.

Um diese Frage zu beantworten, vergleichen wir CLEAR für elektronische Bindungen mit hybriden Photon-Plasmon-Bindungen in Abhängigkeit von der Evolutionszeit und der Signalausbreitungsentfernung (Abb. 3). Hier erfolgt die Manipulation des Lichts mit plasmonischen "aktiven" Bausteinen (Quelle, Modulator, Detektor, Schalter) (siehe hier und hier)), während die Lichtausbreitung durch verlustarme Photonik auf der Basis von Silizium- oder Siliziumnitridplattformen verarbeitet wird. Die Elektronik wird mit dieser Variante eines Plasmon-Photon-Hybrids verglichen, da die Trennung von aktiver und passiver Funktionalität in einem plasmon-photonischen Hybrid zu einer höheren Leistung führt (d. H. Geringere Latenz, höherer Durchsatz, geringere Energie pro Bit-Funktion). Die resultierenden Oberflächenkurven zeigen, dass CLEAR-Elektronik und Plasmon-Photonik eine Break-Even-Linie (Schnittpunkt von Oberflächen, Abb. 3) aufweisen, die sowohl zeitlich als auch in der Entfernung der Signalausbreitung skaliert ist. Interessanterweise ist die Elektronik auch heute noch mit einer Chipgröße von 1 cm bei der Informationsübertragungslänge der Photonik voraus.Daher wird Elektronik im Gegensatz zur Photonik immer noch kommerziell für Kristalle verwendet. Investitionen und Entwicklungen in der Elektronik im letzten halben Jahrhundert haben somit technologische Nachhaltigkeit (Eintrittsbarrieren) für andere Technologien geschaffen. Diese Skalierung hat dazu geführt, dass der Transistor nur ein Milliardstel der Kosten einer photonischen Vorrichtung oder weniger kostet.hier ). Abbildung 3. Vergleich der CLEAR-Indikatoren für elektrische (blau) und hybride photon-plasmonische (rot) Verbindungen auf einem Chip in Abhängigkeit von der Länge der Verbindung und dem Zeitpunkt der Technologieentwicklung. Chipgröße = 1 cm, Verbindungslänge und Schreibjahr (2019) sind rot markiert. Die folgenden Modelle wurden bereitgestellt. a) ein Modell der Bandbreite basierend auf der Anzahl der Transistoren und optischen Geräte auf einem Chip, das als das ursprüngliche Modell des Moore'schen Gesetzes angesehen werden kann; b) ein Energieeffizienzmodell basierend auf dem Kumi-Gesetz, das durch die Landauer-Grenze kB * T * ln (2) ≈ 2,75 sJ / Bit begrenzt ist (kB ist die Boltzmann-Konstante; T ist die Temperatur); beim)

ein wirtschaftliches Nachhaltigkeitsmodell, das auf Modellen der technologischen Entwicklung bis 2019 basiert und nach dem die Kosten eines elektronischen Kanals weniger als eine Milliarde oder ein Millionstel der Kosten eines Hybridkanals betragen; d) ein Parallelitätsmodell (nach 2006), das die Multicore-Architektur und die Einschränkungen von "dunklem Silizium" in elektrischen Verbindungen beschreibt. Der gelbe Punkt befindet sich an der Schnittstelle der beiden Technologien im Zeitraum von 2019, als die Hybrid-Plasmon-Photonics-Technologie gerade die Größe eines Chips erreicht hat und die beste CLEAR-Leistung auf einem Chip zu zeigen beginnt.

Wenn sich Technologie und Herstellungsprozesse verbessern, verringert sich die Break-Even-Distanz (dh CLEAR) für die Übertragung kleiner Informationsmengen zu einem Preis aufgrund der flacheren Kostenkurve der Elektronik im Vergleich zur Photonik, wobei letztere einem Leistungsgesetz über die Zeit folgt. Darüber hinaus beginnen die Kosten mit der Skalierung der Dichte der elektrischen Verbindung zu steigen, was mit zusätzlichen Kosten aufgrund grundlegender physikalischer Probleme an Transistorknoten von weniger als 10 nm verbunden ist (siehe hier ). Im Gegensatz dazu ist eine hybride photon-plasmonische Verbindung derzeit aufgrund der beginnenden Skalierung, die das Ziel des American Institute for Integrated Photonics Manufacturing ( AIM Photonics) ist, kostspielig). Aufgrund der jüngsten Fortschritte in der Nanophotonik ist jetzt eine Skalierung möglich. Das Konzept der Verbesserung der Wechselwirkung von Licht mit Materie ermöglicht die Erzeugung kompakter Wellenlängen in optoelektronischen Bauelementen mit den Vorteilen einer hohen Energieeffizienz und einer hohen Betriebsgeschwindigkeit aufgrund der geringen elektrischen Kapazität (siehe hier ). Infolgedessen wird erwartet, dass sich die Gewinnschwelle zwischen Elektronik und Hybrid-Photon-Plasmon-Technologien weiter verkürzt, wenn wir uns entlang der Zeitachse bewegen. Zum Beispiel ist der CMOS-basierte Silizium-Photonik-Chip, den IBM bereits 2015 demonstriert hat, kurz vor der Gewinnschwelle (siehe hier)). Integrierte Photonik kann Elektronik nur ersetzen, wenn die Geschwindigkeit ihrer CLEAR-Leistung dem allgemeinen Entwicklungstrend von Computersystemen entspricht.

Schlussfolgerungen

Wie aus den obigen Überlegungen hervorgeht, kann CLEAR nicht nur aufgrund seiner breiten hierarchischen Anwendbarkeit (Geräte, Verbindungen, Systemebenen), sondern auch aufgrund seiner Fähigkeit, sich an eine bestimmte technologische Anwendung anzupassen, als universeller technischer und wirtschaftlicher Indikator angesehen werden. Zum Beispiel zur Netzwerkhybridisierung innerhalb eines Kristalls. CLEAR kann nicht nur als Leistungsmetrik verwendet werden, um die Entwicklung einer Technologieplattform vorherzusagen, sondern es ist auch möglich, die Gesamtfähigkeit der Technologieplattform (en) unter verschiedenen Verwendungsbedingungen zu vergleichen, indem jedem Faktor in Gleichung (4) Gewichte hinzugefügt werden .

In dieser ursprünglich vorgeschlagenen CLEAR-Metrik wirken sich alle fünf Faktoren linear auf den CLEAR-Wert aus. Für eine bestimmte Anwendung, die entscheidend von einem bestimmten Faktor (oder einer Kombination von Faktoren) abhängt, kann jedoch jeder Faktor in CLEAR unterschiedlich gewichtet werden. Um die Vergleichbarkeit selbst unter solchen "abgestimmten" Metriken sicherzustellen, muss möglicherweise sichergestellt werden, dass die Summe aller Koeffizienten gleich 5 ist, ähnlich wie bei der Normalisierung auf Eins, wie beispielsweise dem Integral der Wellenfunktion in der Quantenmechanik. Beispielsweise kann ein tragbares Gerätesystem starke Energie- (E) und Volumenbeschränkungen (A) aufweisen, was zu einer CLEAR-Metrik C 0,8 L 0,8 E 1,2 A 1,2 R führtfür solche Technologie. In der Tat wäre es interessant, Trends aus verschiedenen abgestimmten Metriken mit der Fähigkeit zu vergleichen, Technologien in der Zukunft vorherzusagen.

Darüber hinaus können wir zukünftige Kommunikationskanäle oder -netzwerke als dynamisch rekonfigurierbar wahrnehmen, sodass der Chip seinen idealen Betriebspunkt in Abhängigkeit von der aktuellen Anwendung, Last, dem Leistungsmodus usw. ändern kann. Solche dynamischen datengesteuerten Systeme ( DDDAS)) sind aufgrund ihrer kombinierten kognitiven Verarbeitungsfähigkeit gefragt. Es wird erwartet, dass die Anpassung von Computersystemen an eine Vielzahl von Einschränkungen mit neuen informationstheoretischen Systemen wie neuromorphem und Reservoir-Computing zusammenwirkt, bei denen die Anpassung und Abstimmung von "Gewichten" maschinelles Lernen, Restkalkülarithmetik oder sogar eingebettete Siliziumphotonik des optischen Rechnens ermöglicht. (siehe hier , hier , hier und hier ).

Es ist auch erwähnenswert, dass CLEAR, wie es bei allen früheren prädiktiven Leistungsmetriken für Technologieplattformen geschehen ist, möglicherweise von seinem ursprünglichen Trend abweicht, wenn in der neuen Technologie einzigartigere physische Merkmale verwendet werden. Gegenwärtig deckt CLEAR alle vorherrschenden Leistungsfaktoren in modernen Technologien angemessen ab, was es ermöglicht, die Entwicklung von Computersystemen zum Zeitpunkt dieses Schreibens genau vorherzusagen.

Somit kann CLEAR nicht nur ein Werkzeug zur Kartierung und Prognose von potenziellen Kunden sein, sondern auch den Weg für hardwarebasierte intelligente und kognitive Computersteuerungsplattformen ebnen, bei denen Kompromisse zwischen Leistung und Kosten in Echtzeit überprüft und optimiert werden.

Infolgedessen kann CLEAR als neues Moore'sches Gesetz angesehen werden, das die Trends bei der Entwicklung von Technologien auf verschiedenen Ebenen der hierarchischen Anwendung ganzheitlich widerspiegelt.